为了满足用户对更高效、更智能搜索功能的需求,阿里云 AI 搜索开放平台 新增加 QwQ 模型,这一全新模型的加入将为企业和开发者带来更强大的搜索解决方案。

一、QwQ模型

开源版:

基于 Qwen2.5-32B 模型训练的 QwQ 推理模型,于2025年3月6日发布。通过强化学习大幅度提升了模型推理能力。模型数学代码等核心指标(AIME 24/25、LiveCodeBench)以及部分通用指标(IFEval、LiveBench等)达到DeepSeek-R1 满血版水平,各指标均显著超过同样基于 Qwen2.5-32B 的 DeepSeek-R1-Distill-Qwen-32B。

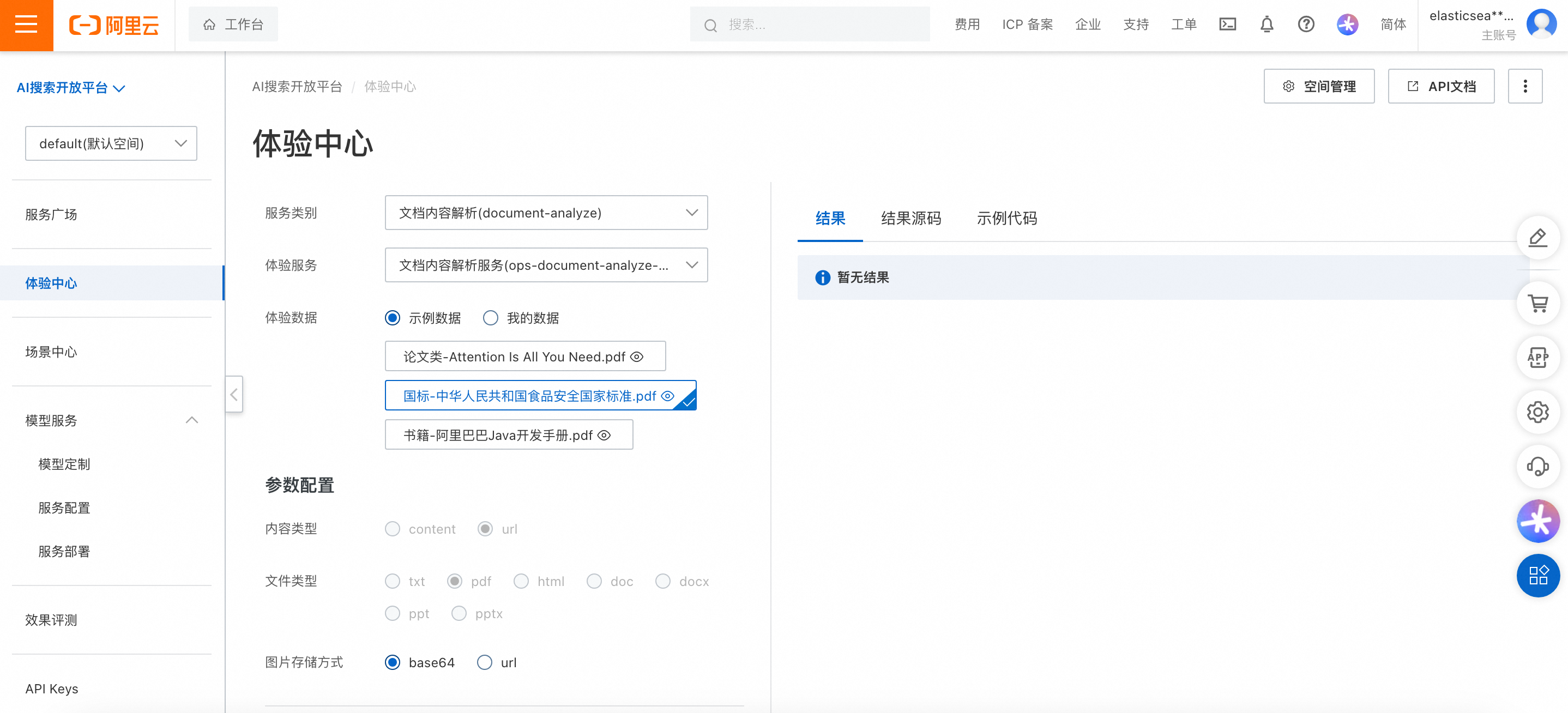

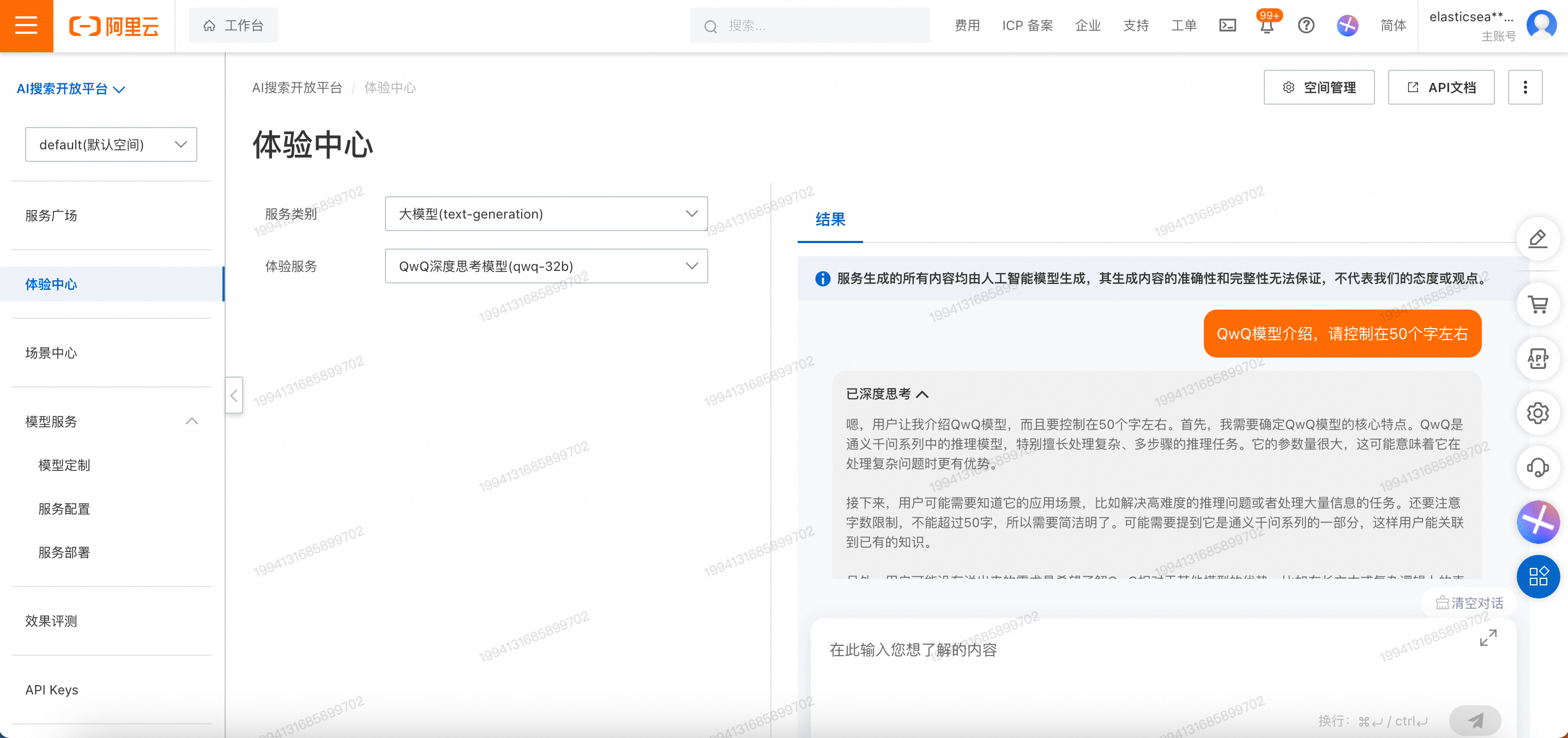

二、如何体验QwQ模型

两步即可体验新模型:

-

登录并开通 阿里云OpenSearch-AI 搜索开发工作台

-

选择qwq模型,同时可输出深度思考内容。

参考文档:QwQ 模型的用法_大模型服务平台百炼(Model Studio)-阿里云帮助中心

三、计费方式

计费项:按照 实际消耗的输入/输出token数

-

text-generation/qwq-32b/input_token

-

text-generation/qwq-32b/output_token

阿里云 AI 搜索开放平台的 QwQ 模型功能的加入,将为企业和开发者提供了更强大、更智能的搜索解决方案。通过深度结合大语言模型和联网搜索技术,为用户提供更优质的技术支持和服务,助力您的业务迈向新的高度。

453

453

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?