神经网络与深度学习——学习笔记(一)

概述

1.定义

人工智能(Artificial Intelligence): 是用机器去实现所有目前必须借助人类智慧才能实现的任务。其具体研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统。

2.人工神经网络概念

是从微观结构与功能上模拟人脑神经系统而建立的一类模型,是模拟人的智能的一条途径。

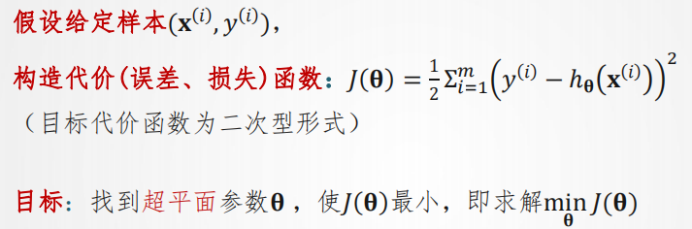

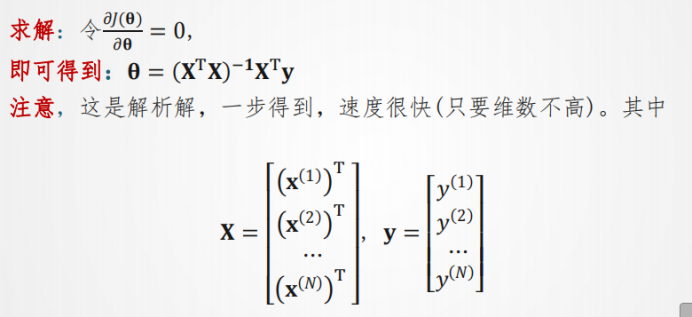

线性回归

线性回归

定义

利用数理统计中回归分析,来确定两种或两种以上变量间相互依赖的定量关系的一种统计分析方法。

要素

训练集、输出数据、模型。

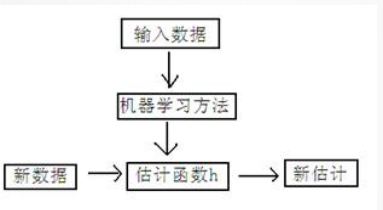

学习过程

实现过程

线性二分类问题

定义

线性分类器则透过特征的线性组合来做出分类决定,以达到此种目的。简言之,样本通过直线(或超平面)可分。

输入:特征向量

输出:二分类下,可以是0、1分类代号;或者是某类的概率。

线性分类与线性回归的差别

I.输出意义不同:属于某类的概率——回归具体值

Ii.最佳分类直线——最佳拟合直线

Iii.维数不同

构造“分界直线”

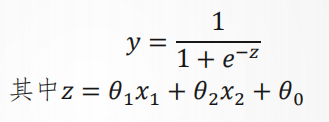

借助Sigmoid函数将值转换为0~1之间的概率

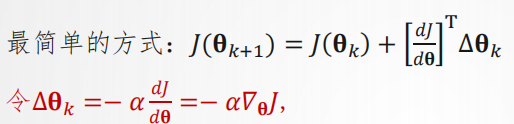

梯度下降法

由于非线性无法求解,这里构造序列,最简单的方法如下:

对数回归和多分类回归

指数回归

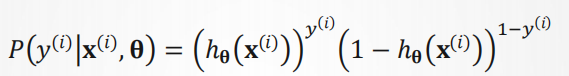

二分类问题可以使用条件概率描述:

假设各样本相互独立,服从Bernoulli分布。合理估计值应当是让所有样本时间产生的几率最大,即应当是极大似然的,取似然函数为:

本文介绍了神经网络的基础,包括线性回归、线性分类问题以及它们的区别。讨论了二分类问题中的Sigmoid函数和梯度下降法在解决非线性问题中的应用。接着,文章深入到多分类问题,提到了对数回归和Softmax函数,并阐述了感知机模型和BP神经网络的工作原理,特别是BP算法在多层前馈网络中的应用。最后,文章探讨了训练过程中防止过拟合和欠拟合的策略,如权重衰减和正则化。

本文介绍了神经网络的基础,包括线性回归、线性分类问题以及它们的区别。讨论了二分类问题中的Sigmoid函数和梯度下降法在解决非线性问题中的应用。接着,文章深入到多分类问题,提到了对数回归和Softmax函数,并阐述了感知机模型和BP神经网络的工作原理,特别是BP算法在多层前馈网络中的应用。最后,文章探讨了训练过程中防止过拟合和欠拟合的策略,如权重衰减和正则化。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

407

407

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?