目录

前言

🍨 本文为[🔗365天深度学习训练营](https://mp.weixin.qq.com/s/0dvHCaOoFnW8SCp3JpzKxg) 中的学习记录博客🍖 原作者:[K同学啊](https://mtyjkh.blog.youkuaiyun.com/)

说在前面

本周目标:本地读取并加载数据、了解循环神经网络(RNN)的构建过程、调整代码是的测试机acuuracy达到87%;拔高目标——测试集accuracy达到89%

我的环境:Python3.8、Pycharm2020、tensorflow2.4.0

数据来源:[K同学啊](https://mtyjkh.blog.youkuaiyun.com/)

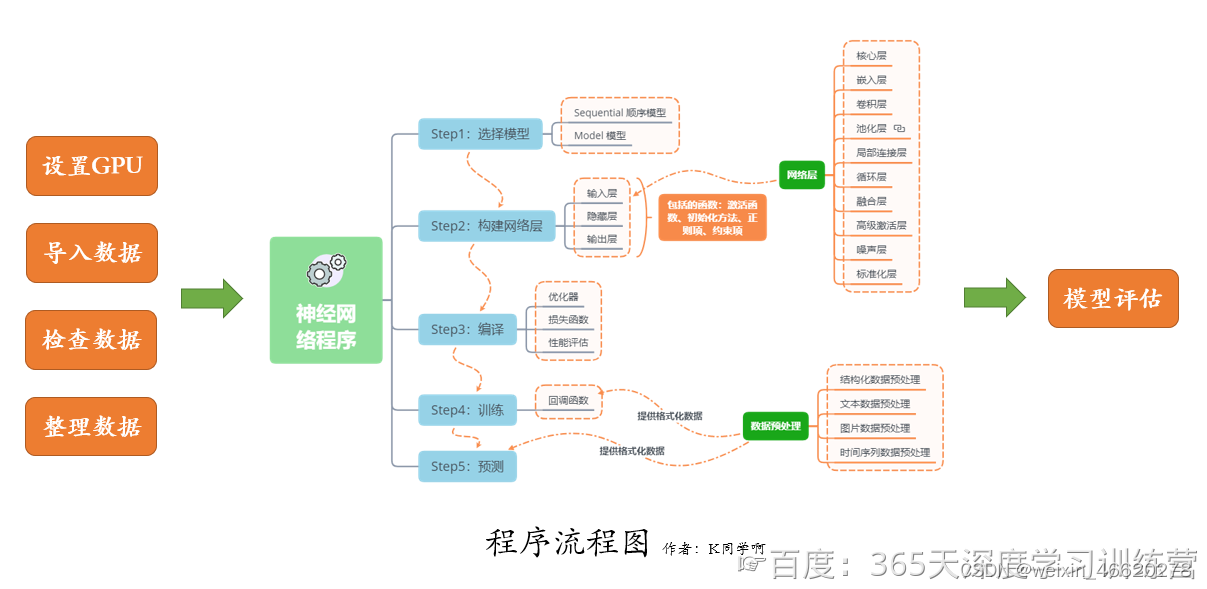

代码的流程图如下:

一、RNN简介

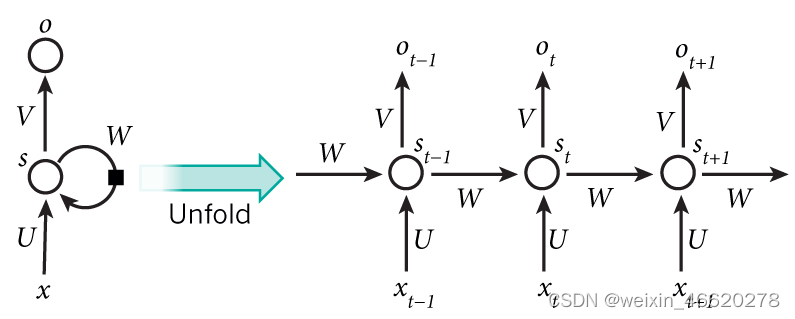

传统神经网络结构比较简单是输入层——隐藏层——输出层,而RNN与传统神经网络最大的区别在于每次都会将前一次的输出结果,带到下一次的隐藏层中,一起训练。如下图所示,左图为传统神经网络,右图为RNN

以一个案例具体分析RNN工作过程,用户说了一句“what time is it?”,我们的神经网络首先会将这句话分为五个基本单元(四个单词➕一个问号);然后按照顺序将5个基本单元输入RNN网络,what作为RNN的输入得到输出01,按照顺序将“time”输入RNN网络,得到输出02,这个过程中可以看到输入“time”的时候,前面“what”的输出也会对02的输出产生了影响(如下图中所示,隐藏层中有一半是黑色的),依次类推,前面所有的输入产生的结果都对后续的输出产生了印象(下图中最后的圆形中就包含了前面所有的颜色)

当神经网络判断意图的时候,只需要最后一层的输出05,如下图所示

循环神经网络(RNN)是一类用于处理序列数据的神经网络。不同于传统的前馈神经网络,RNN 能够处理序列长度变化的数据,如文本、语音等。RNN 的特点是在模型中引入循环,使得网络能够保持某种状态,从而在处理序列数据时表现出更好的性能。

上图左边简单描述 RNN 的原理,x 是输入层,o 是输出层,中间 s 是隐藏层,在 s 层进行一个循环,右边表示展开循环看到的逻辑,其实是和时间 t 相关的一个状态变化,也就是说神经网络在处理数据的时候,能看到前一时刻、后一时刻的状态,也就是常说的上下文

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?