一 算法思想

对于样本数据集所含变量都是可观测的,我们一般应用极大似然估计法或者贝叶斯估计法估计模型参数。但若样本数据集中存在不可观测的变量(隐变量),那么单纯的极大似然估计法是不可用的;EM算法(expectation maximization algorithm)分为E步和M步,其中E-step主要通过观察数据和现有模型来估计参数,然后用这个估计的参数值来计算似然函数的期望值;而 M-Step 是寻找似然函数最大化时对应的参数。由于算法会保证在每次迭代之后似然函数都会增加,所以函数最终会收敛。

二 适用范围

无监督学习,样本数据中含有隐变量。

算法的核心思想是找到一个下界,并不断优化(提高)下界,有望得到一个极大值,但不能保证是全局最大值。

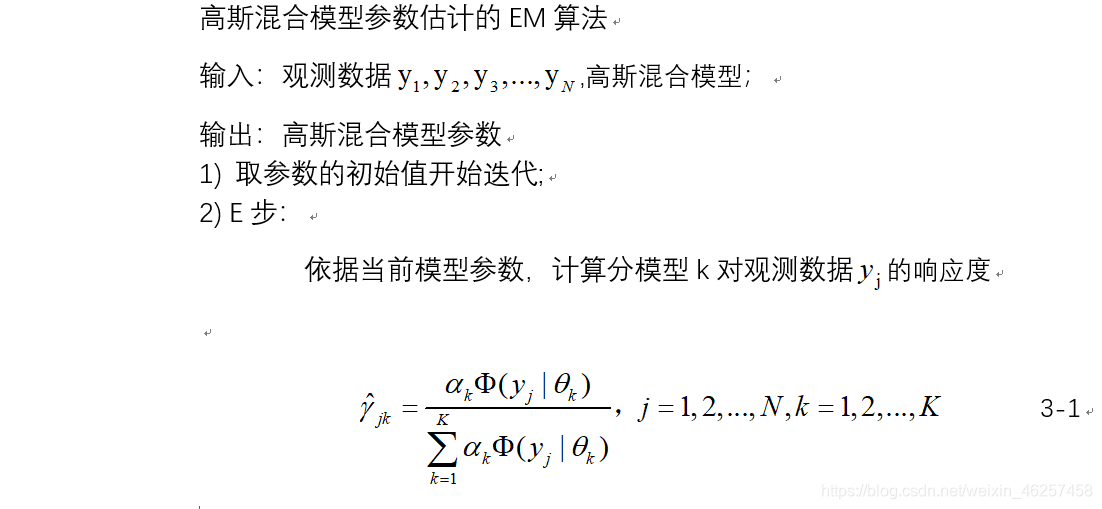

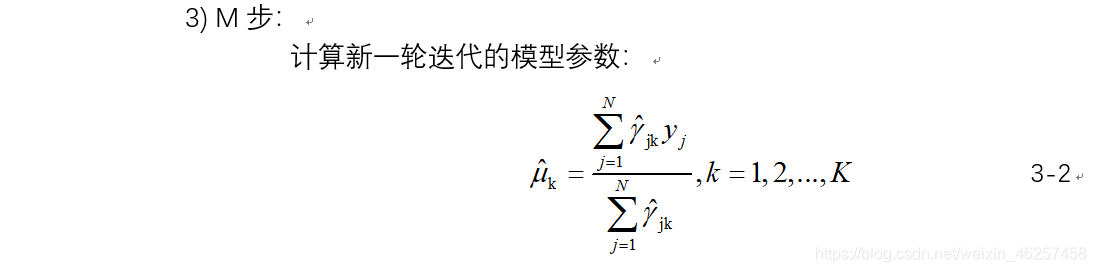

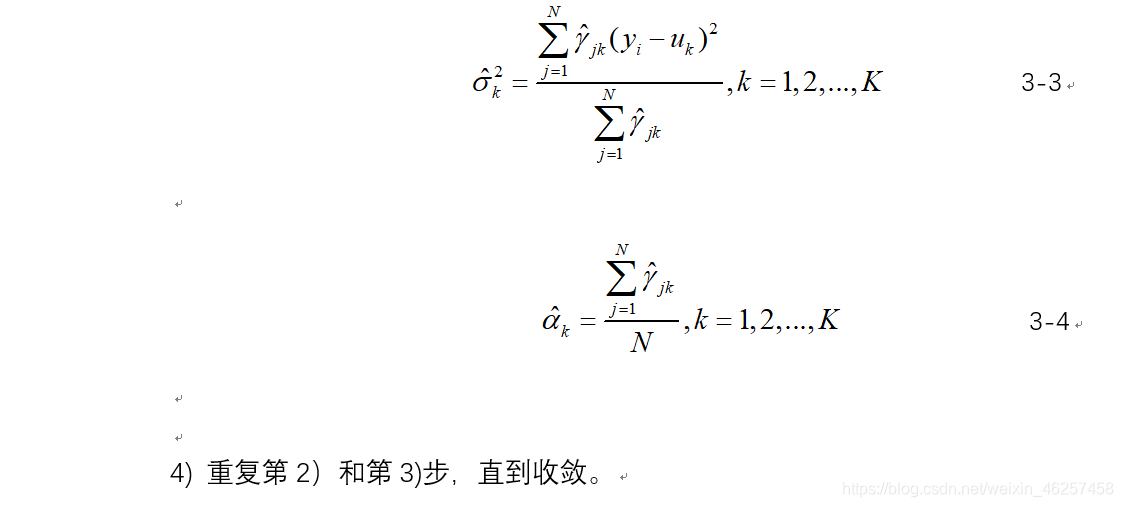

三 算法步骤

在这里插入图片描述

四 EM算法实验测试

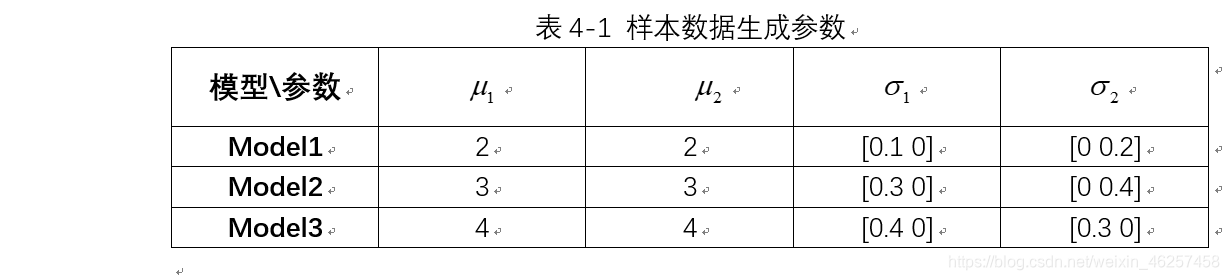

4.1 样本数据生成

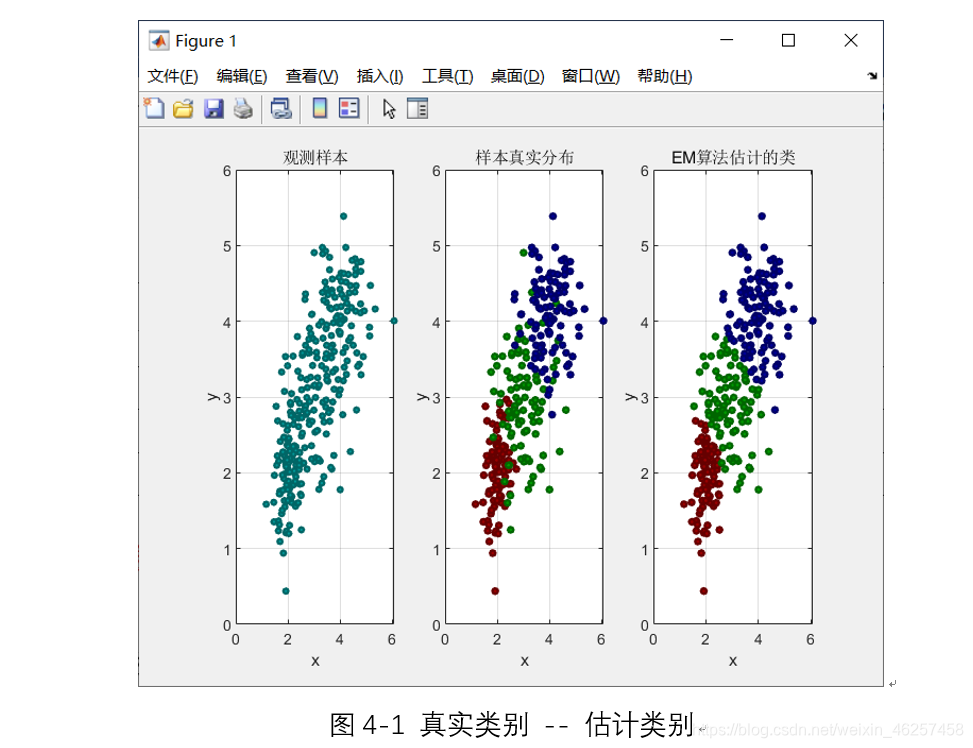

为了方便可视化的美观性,我选择了生成二维特征的样本数据,并且设置每一维度的标准差较小(这样生成的样本数据更为紧凑),共包括3中高斯模型,每类高斯模型生成100条样本数据。

4.2 EM算法估计参数

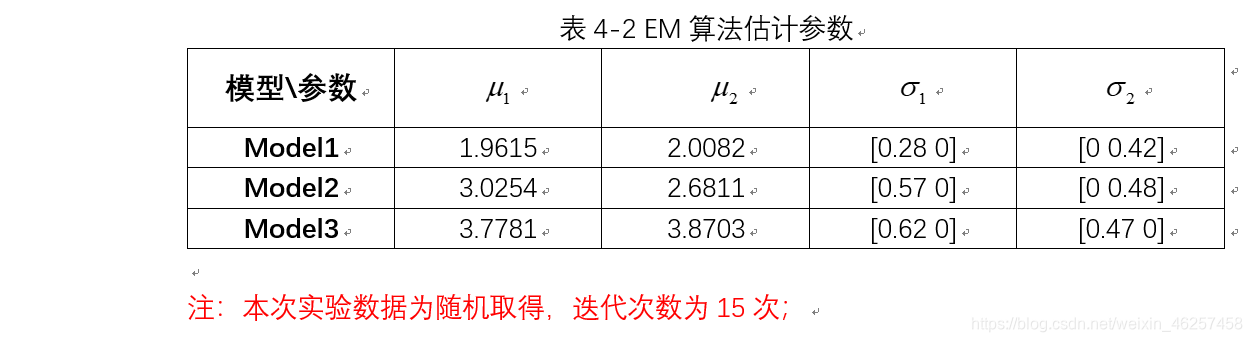

为了节省时间复杂度,并没有采取迭代够足够多轮数的方式,而是设置一个误差容允值,只要误差低于此值即不再进行参数的迭代和更新。表5-2为某次实验中的数据。

4.3 基于EM参数估计聚类

在进行EM算法的同时,得到每一个样本属于某个模型的概率,取max,即取最可能属于的类别当作其预测的类别,并进行可视化如图5-1.

4.4 实验现象

在实验中,起初采用了生成的随机数对参数进行初始化,结果EM算法表现非常不鲁棒,即使误差收敛到很小的值,但明显参数估计是错误的。这说明EM算法对于参数的初值是很敏感的。

五 EM算法课后题

5.1 第9.1题

5.2 第9.2题

参考

【机器学习】EM——期望最大

https://zhuanlan.zhihu.com/p/78311644

人人都懂EM算法

https://www.zhihu.com/search?type=content&q=EM%E7%AE%97%E6%B3%95

统计学习方法

https://blog.youkuaiyun.com/qq_41562704/article/details/106541040

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?