手撕RNN代码算什么?我把神经网络微分方程刻在了子弹上!

你还在用TensorFlow调包?还在被反向传播的梯度搞得晕头转向?今天带你走进真正的硬核战场——手算循环神经网络!不是PPT讲解,不是调参技巧,是真正用纸笔征服AI最凶险的数学高地!

一、时间战场:RNN的杀戮逻辑

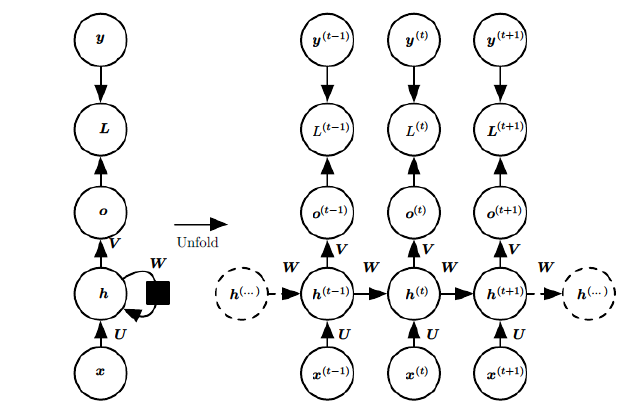

当其他神经网络还在处理静态数据时,真正的战士早已在时间维度展开厮杀。循环神经网络的秘密武器,是把整个时间线变成叠加态的杀戮链条!每个隐藏状态都是穿越时空的子弹,参数共享机制就是最狠的以战养战——用同一组权重矩阵轰穿所有时间节点!

看看这个死亡方程式:

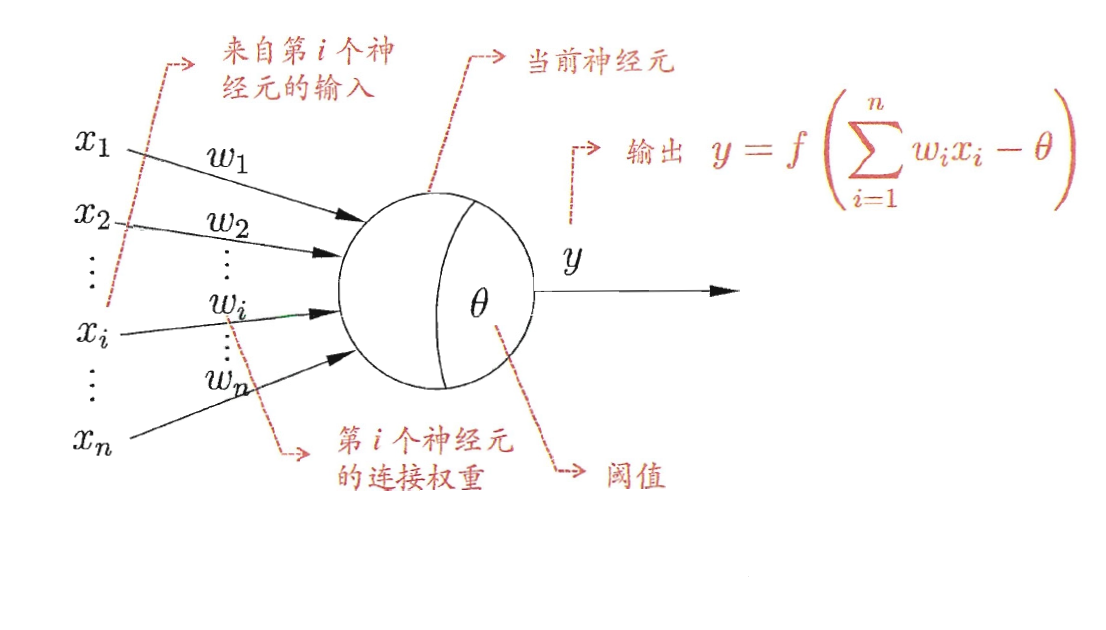

s_t = W·a_{t-1} + U·x_t + b

a_t = tanh(s_t)

o_t = V·a_t + c

这可不是什么数学公式,这是刻在子弹上的杀戮代码!每个时间步的激活值都是沾着前一个时间步鲜血的利刃!

二、反向绞杀:穿越时空的微分风暴

你以为前向传播就是全部?真正的战斗从反向传播才刚开始!BPTT算法是穿越22个时间维度的时空猎杀,每个梯度都是带着链式法则的追踪导弹。看看这个死亡链式:

dL/dW = Σ(dL/da_t * da_t/ds_t * ds_t/dW)

每个时间步的梯度残差必须精确制导,否则整个网络立即陷入梯度爆炸的核爆现场!知道为什么LSTM能称王称霸吗?因为普通RNN的梯度流根本就是战场上的敢死队!

三、生死一瞬:梯度爆炸的拆弹艺术

调试过RNN的人都知道,参数初始化就是俄罗斯轮盘赌!当学习率调到0.5,隐层开到128单元时,你会看到这样的死亡日志:

epoch=3 Loss: [nan]

epoch=5 Loss: [nan]

这不是程序报错,这是梯度核爆的辐射残留!三种拆弹方案立即执行:

1️⃣ 学习率机枪点射(降到0.001)

2️⃣ 隐层敢死队缩编(砍到32单元)

3️⃣ 梯度裁剪战术(torch.nn.utils.clip_grad_norm_)

记住,在RNN战场,nan不是错误,是烈士墓碑!

四、造轮子战役:从numpy敢死队到TensorFlow装甲师

真男人就要用numpy手撕RNN!看看这血与火的代码:

class HiddenLayer:

def __init__(self, input_size, hidden_size):

self.W = np.random.randn(hidden_size, hidden_size) * 0.01 # 死亡初始化

self.delta_W = np.zeros_like(self.W) # 梯度坟场

def activate(self, x, prev_a):

s = np.dot(self.W, prev_a) + ... # 矩阵乘法就是子弹上膛

return np.tanh(s) # 激活函数是扣动扳机

但当战场扩大到工业级数据,我们立即呼叫TensorFlow装甲集群:

model = tf.keras.Sequential([

tf.keras.layers.SimpleRNN(64, activation='tanh'), # 钢铁洪流

tf.keras.layers.Dense(26) # 终结者输出

])

十行代码建立时空要塞,这才是现代化战争!

五、终极启示:代码是战场,键盘是武器

现在,打开Google Sheet战场沙盘(https://by-hand.ai/s/rnn),亲手操作每个时间步的矩阵绞杀。记住,在RNN的世界里:

- 每个tanh激活都是神经元的咆哮

- 每个softmax输出都是概率论的刺刀

- 每个epoch都是向loss深渊发起的白刃冲锋

不要相信任何封装好的API,真正的战士要把微分方程刻进骨髓!点击下载222KB的死亡笔记(https://aibyhand.substack.com/api/v1/file/4ff9a0bc-6540-4344-8958-68c24772b5e8.pdf),让每个数学符号都变成你枪膛里的火药!

最后的战吼:要么在梯度下降中涅槃,要么在维度爆炸中永生!RNN战场没有撤退可言!

25万+

25万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?