本文首发于公众号【DeepDriving】,欢迎关注。

1. 前言

自动驾驶感知系统中有两个很重要的任务:3D目标检测和BEV分割。传统的3D目标检测主要依赖于激光雷达输出的点云,但是使用激光雷达的成本比较高,另一个选择是使用多个相机的图像作为输入去实现车身周围360°的目标检测任务。BEV分割的目标是在BEV框架中对周围环境进行语义分割,比如可行驶区域和车道边界的分割。

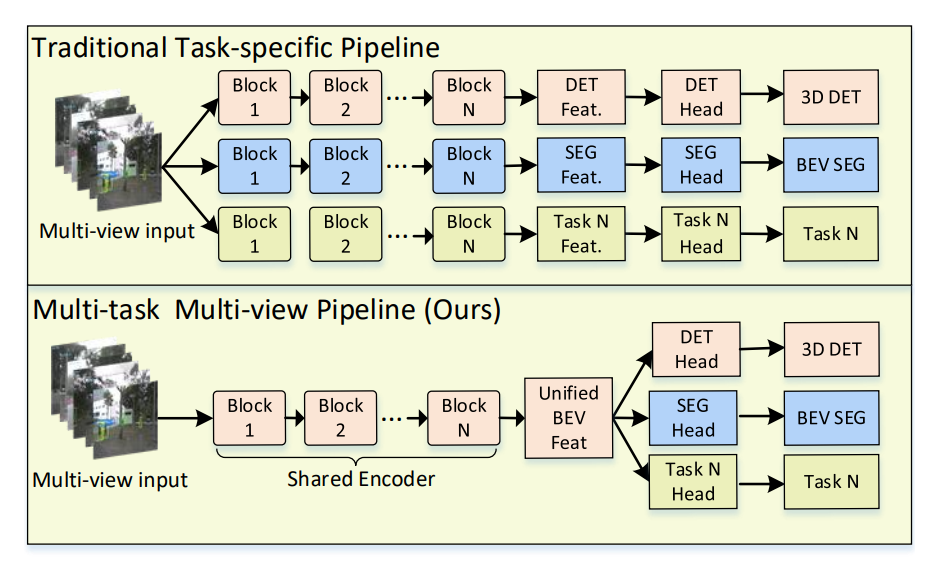

在一个统一的框架中去感知周围物体和环境的能力是自动驾驶车辆的核心要求,但是现有的基于相机的方法并不适合做360°多任务感知,M2BEV提出一种高效地将多个视角的2D图像特征转换为基于自车坐标系的3D特征表示的方法,是第一个用统一的框架去实现3D目标检测和BEV分割的多任务模型。

订阅专栏 解锁全文

订阅专栏 解锁全文

3176

3176

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?