1. 背景介绍

近些年大模型成为发展通用人工智能的途径,并且离用户越来越近,广泛应用于生产实践中。企业和个人用户对于大模型的需求日益旺盛,而开源模型是对大模型针对性改进的重要途径。

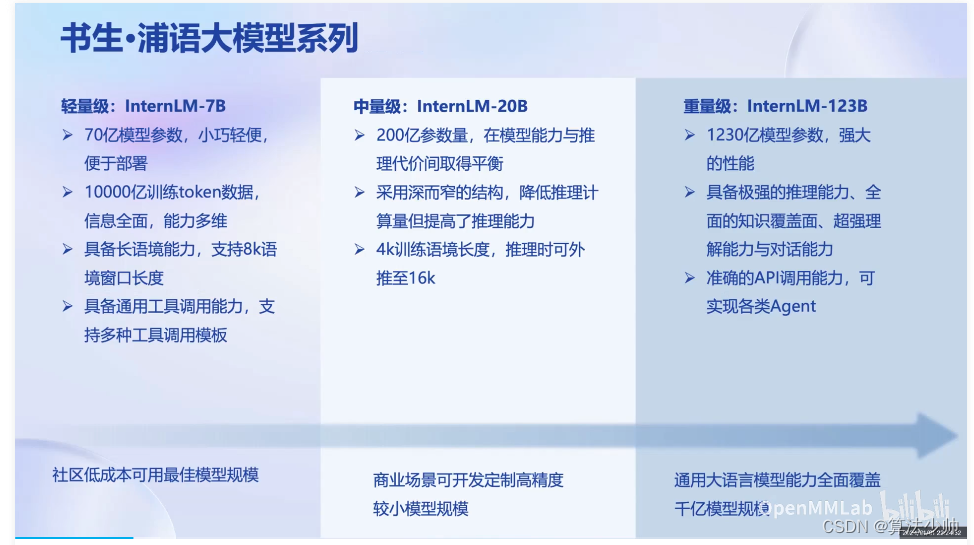

书生·浦语大模型包含了7B、20B以及123B等诸多中文预训练模型,为中文应用提供基座模型支撑。同时它整合了大量开源数据集,为国产大模型应用与训练建立数据基础 。此外还为模型微调、模型评估、模型推理等建立了相应的程序框架方便了国产大模型的训练和部署。

就性能来讲,国产开源模型在测试数据集上的性能已经可以ChatGPT比肩,由于国外训练数据以英文为主,只有中文语料训练的大模型才更贴近中国人的思维,更能满足中国人的针对化需求。

2. 开源框架分类

为了方便调用与研究,书生·浦语大模型建立了诸多开源框架。其中包括:

- 基础模型框架InternLM

- 微调模型框架XTuner

- 部署模型框架LMDeploy

- 评测模型框架OpenCompass

- 应用集成Langent

3. 数据集

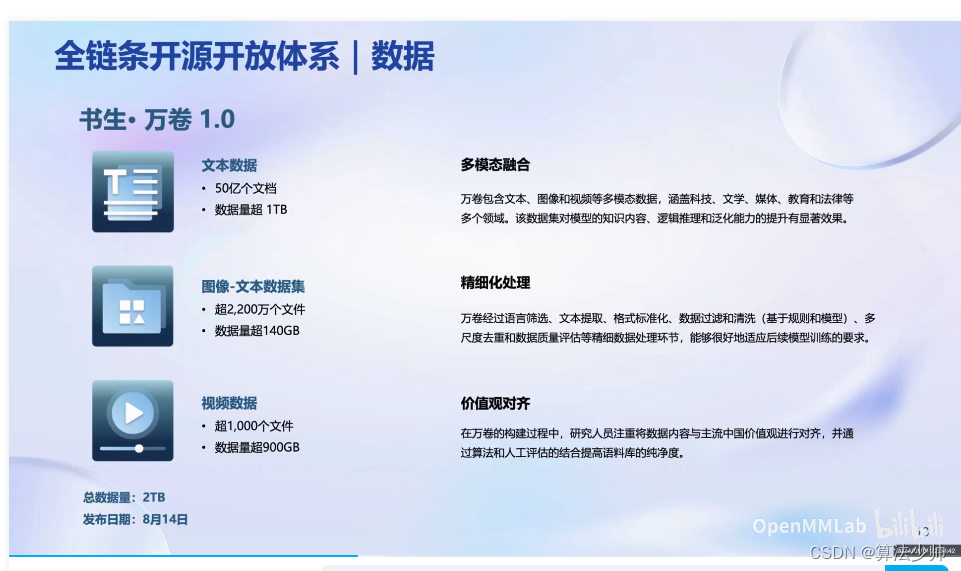

数据是训练的基础,为此书生·浦语大模型包含大量对齐过的文字、图片、音频、视频等数据集,为用户构建自己的数据集提供方便。

Github地址https://github.com/InternLM

2073

2073

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?