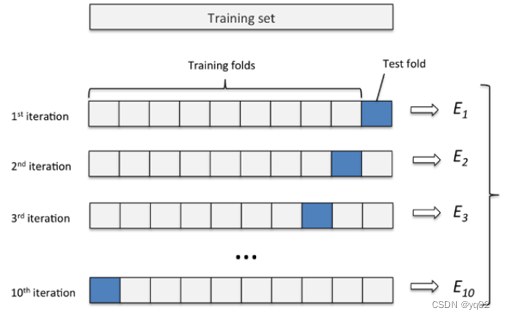

交叉验证

在深度学习训练过程中,标准的做法是将数据集划分为三个子集:训练集、验证集和测试集。训练集用于模型的训练,验证集用于模型调优和参数选择,测试集用于最终验证,测试模型泛化能力。

然而,很多情况下都未划分验证集,这样做的原因一般是因为数据集较小,划分出验证集后整个训练过程所能接触到的数据将会更少,不利于模型训练。交叉验证方法便是解决这一问题的潜在方法之一。交叉验证仍需要测试集做最后的模型评估,但不再需要验证集。

集成学习

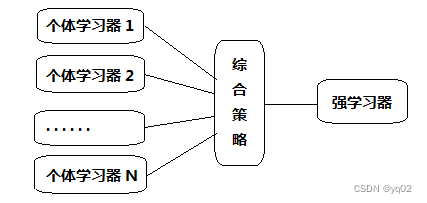

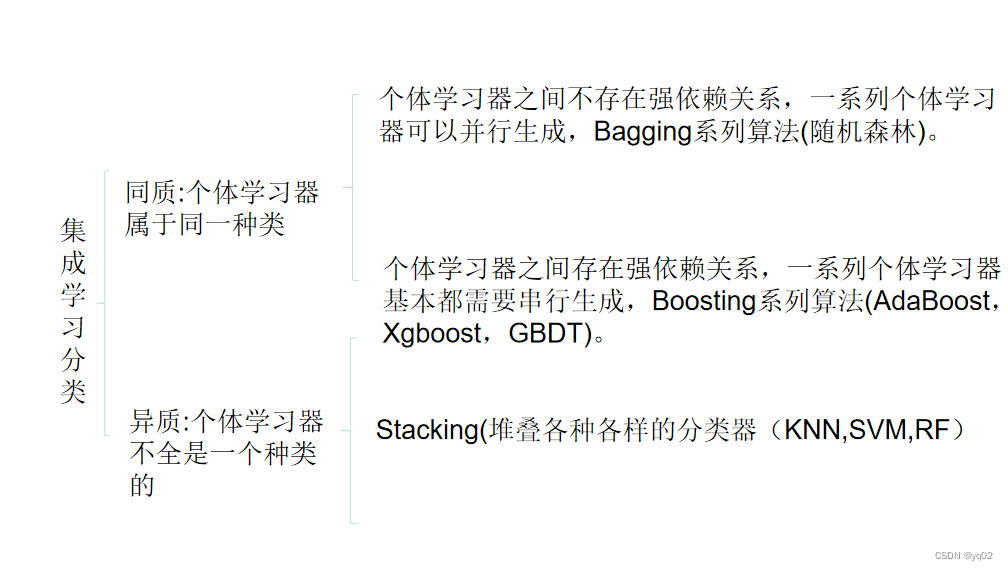

集成学习就是组合这里的多个弱监督模型以期得到一个更好更全面的强监督模型,集成学习潜在的思想是即便某一个弱分类器得到了错误的预测,其他的弱分类器也可以将错误纠正回来。

集成学习法的特点:

- ① 将多个分类方法聚集在一起,以提高分类的准确率(这些算法可以不同也可以是相同);

- ② 集成学习法由训练数据构建一组基分类器,然后通过对每个基分类器的预测进行投票来进行分类;

- ③ 严格来说,集成学习并不算是一种分类器,而是一种分类器结合的方法;

- ④ 通常一个集成分类器的分类性能会好于单个分类器;

- ⑤ 如果把单个分类器比作一个决策者的话,集成学习的方法就相当于多个决策者共同进行一项决策。

726

726

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?