Paper2:VGG Notes

本模型源于论文: 《Very Deep Convolutional Networks for Large-Scale Image Recognition》

背景

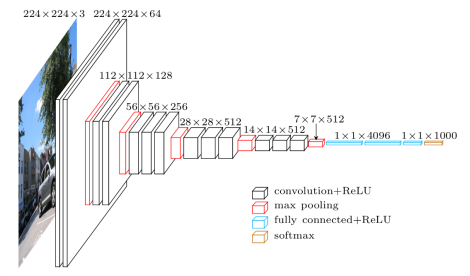

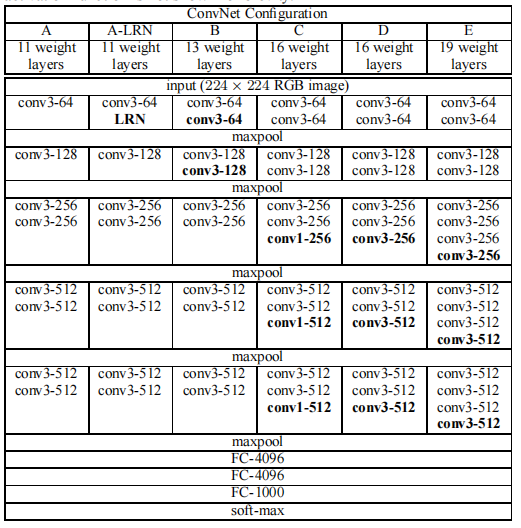

VGG名字是由牛津大学(Oxford)的Visual Geometry Group组提出的。VGG在2014年的ImageNet分类竞赛中获得了亚军(分类冠军是 GoogleNet),定位竞赛中获得了冠军,虽然在分类竞赛中获得了亚军,但其影响力一点也不低于冠军GoogleNet。该模型简洁,将常规、经典、续贯的深度神经网络结构发挥到了极致,但参数量较大(主要集中在第一个全连接层),参数量较大导致模型略显臃肿,训练时速度较慢。

VGG的创新点主要是通过使用3×3的小卷积核取代大卷积核(5×5、7×7),网络深度可以达到19层,宽度逐层加宽。论文中提出的VGG16、VGG19模型可以作为迁移学习的基模型。

VGG原理

VGG16相比于AlexNet的一个改进就是采用连续的3×3卷积核代替AlexNet中5×5或者7×7的卷积(2个3×3卷积可以替代1个5×5卷积,3个3×3卷积可以替代一个7x7卷积),这样做的好处是在保证具有相同感受野的条件下,提升了网络的深度,在一定程度上提升了神经网络的效果。

理解了上图之后,我们可能会想,这样代替为什么好?

我们可以通过参数证明的方式,假设输入图像是H×W×C,并且我们使用C个卷积核(步长为1,padding选能使长宽不变的!)

①对于一个7×7的卷积,那么权重数量就是:

C × ( 7 × 7 × C ) = 49 C 2 C×\left( 7×7×C \right) =49C^2\,\, C×(7×7×C)=49C2

②对于3个3×3的卷积,那么权重数数量就是:

3 × C × ( 3 × 3 × C ) = 27 C 2 3×C×\left( 3×3×C \right) =27C^2\,\, 3×C×

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8308

8308

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?