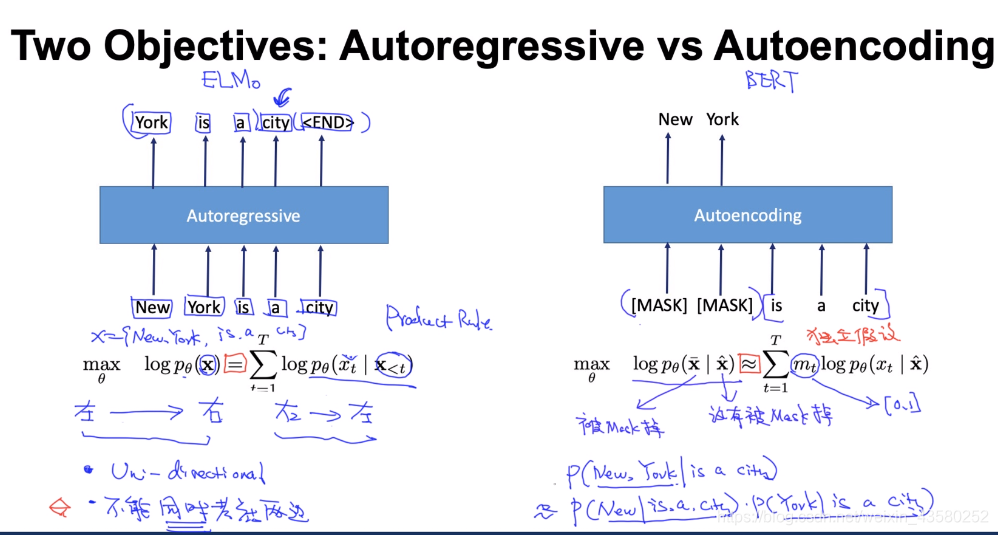

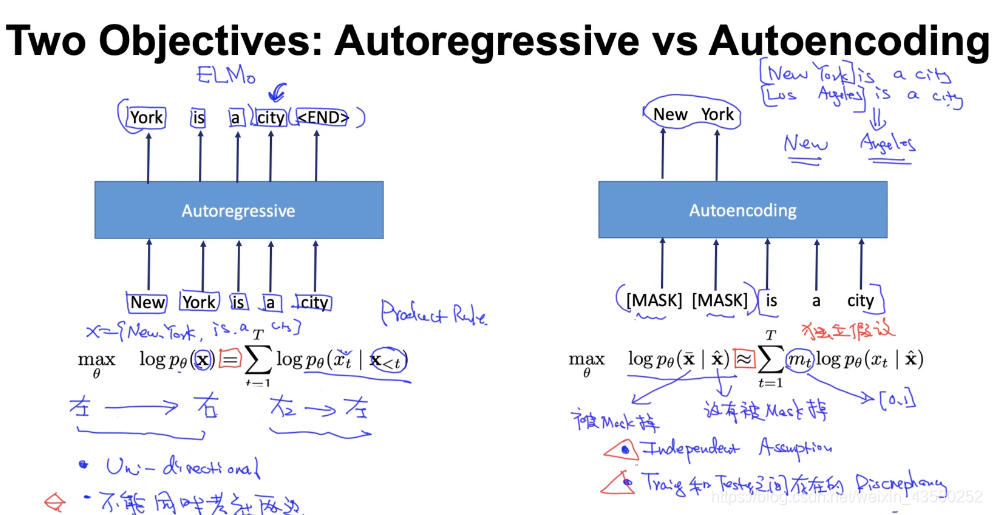

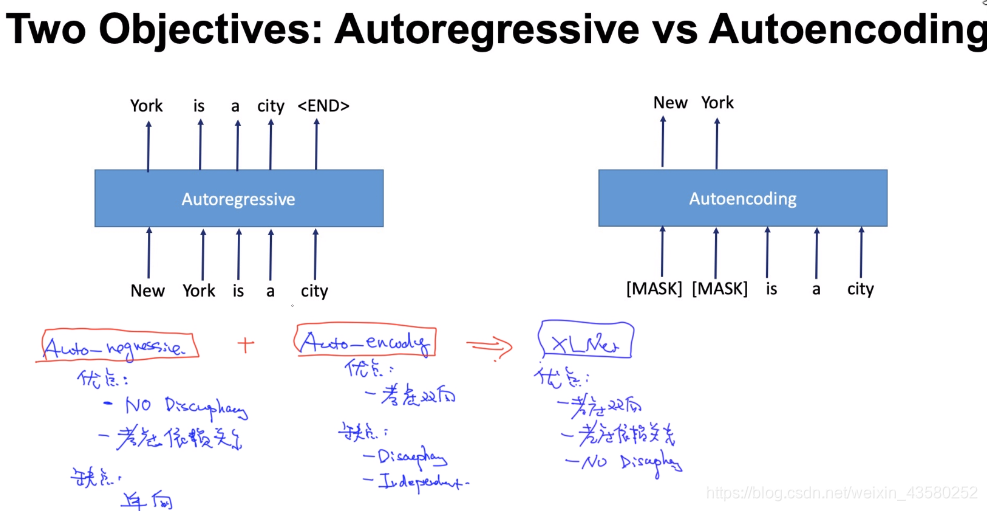

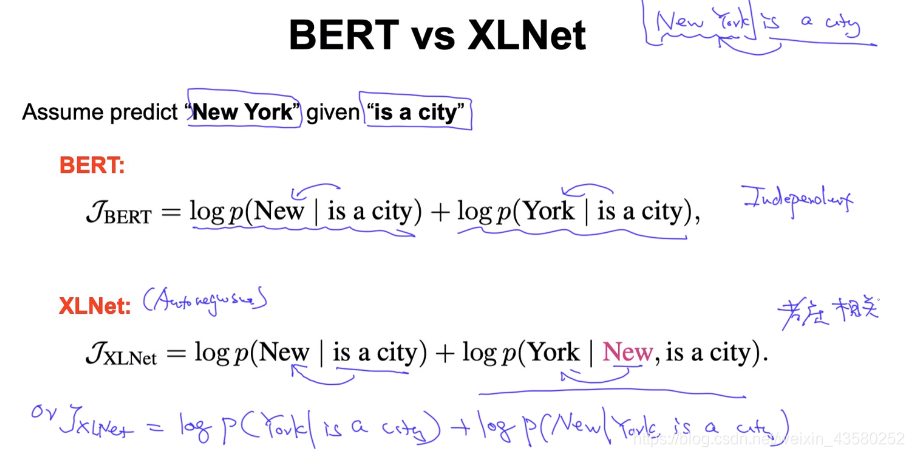

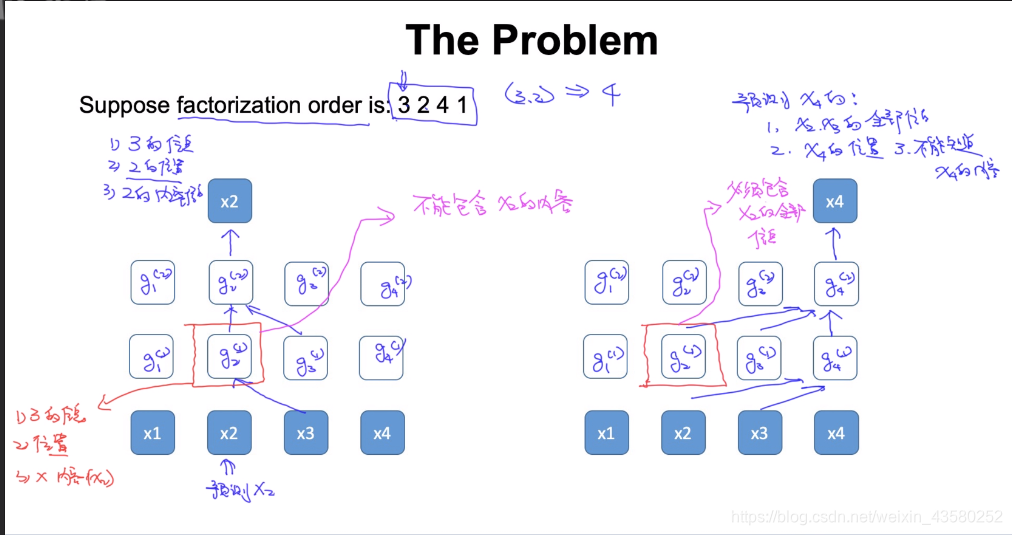

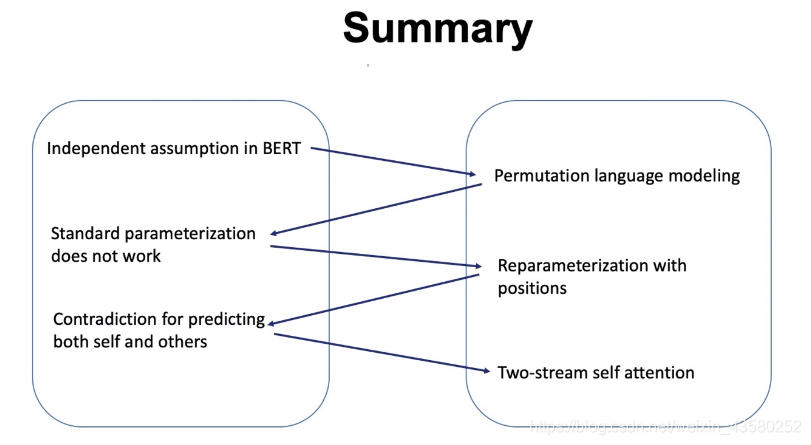

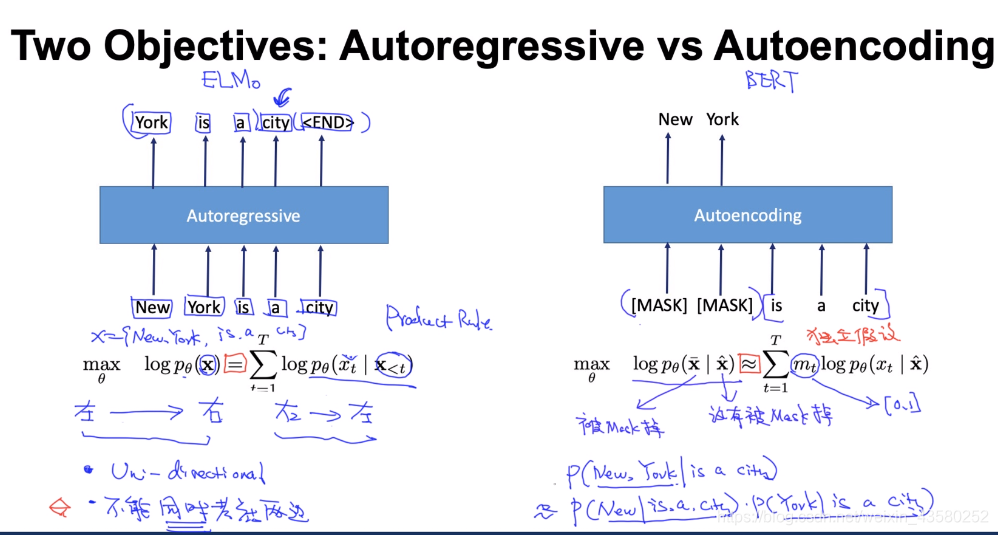

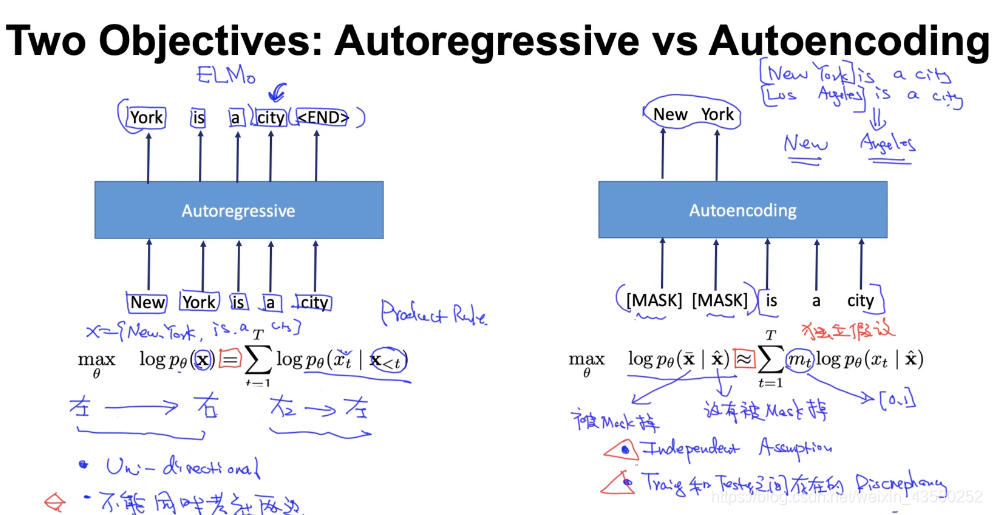

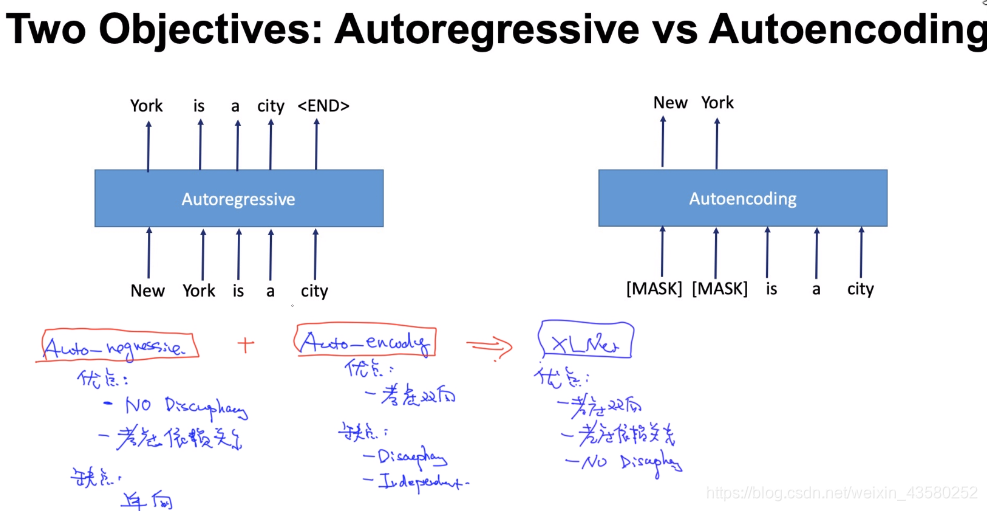

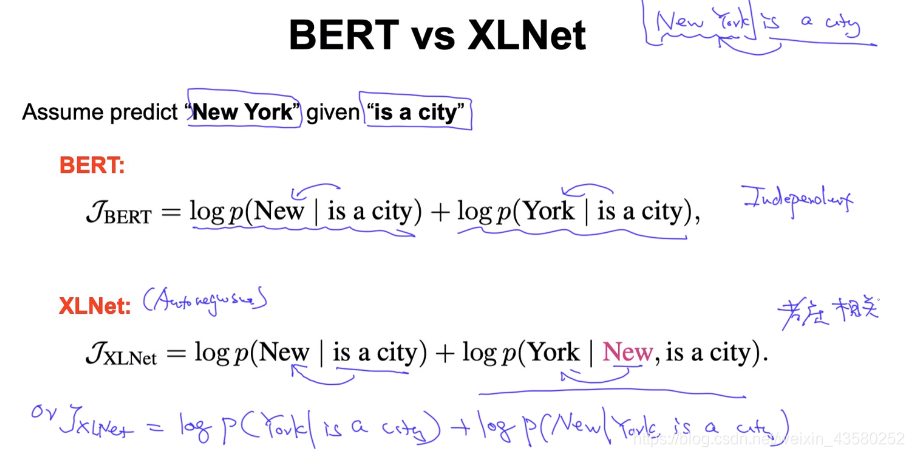

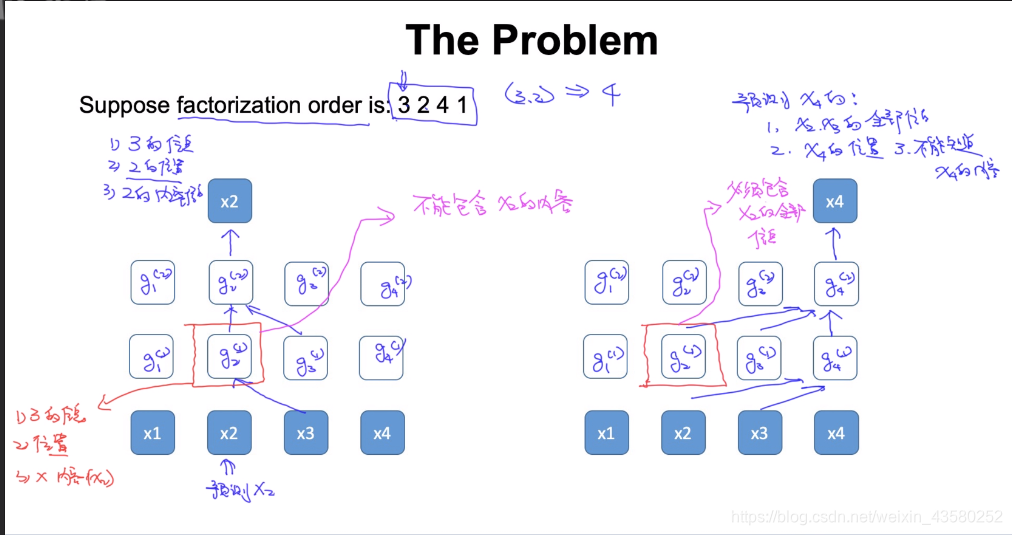

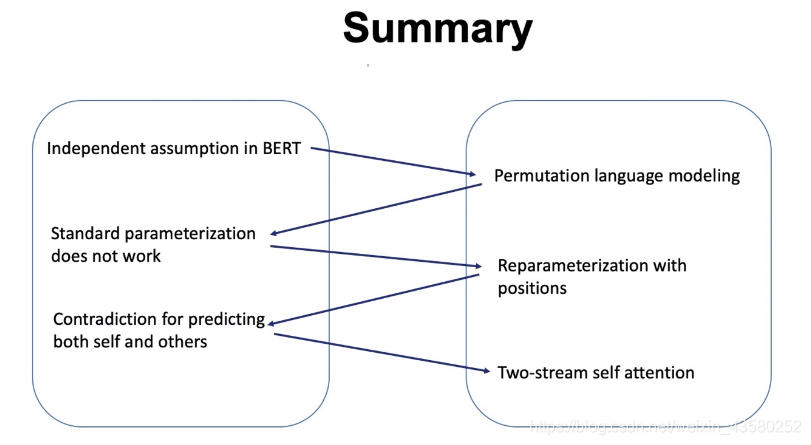

bert两个缺点(图右):

被预测单词的联系性没有考虑;

discrepancy差异性:训练和测试环境不一致性(mask token)

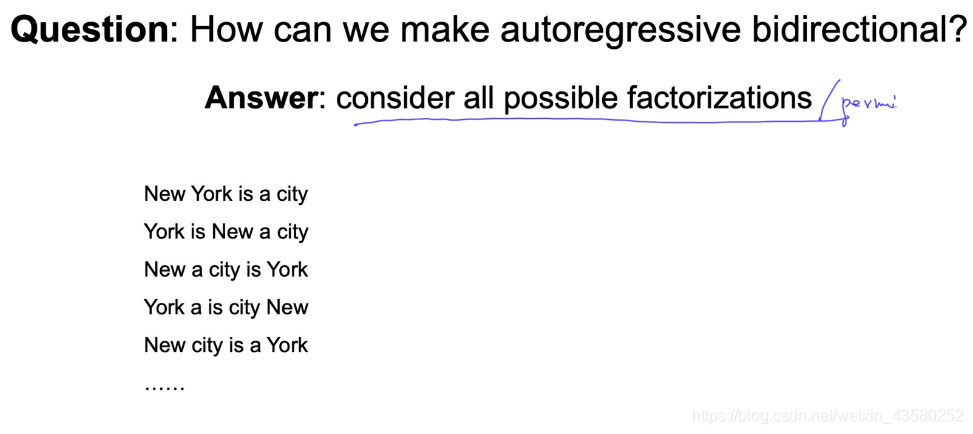

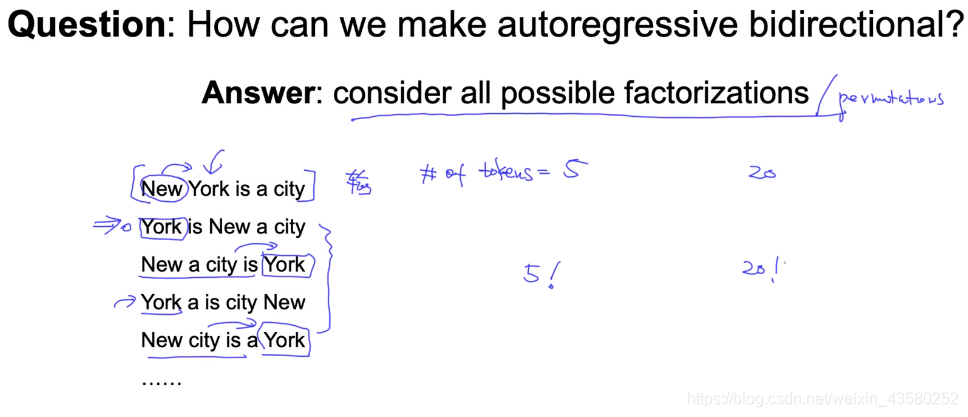

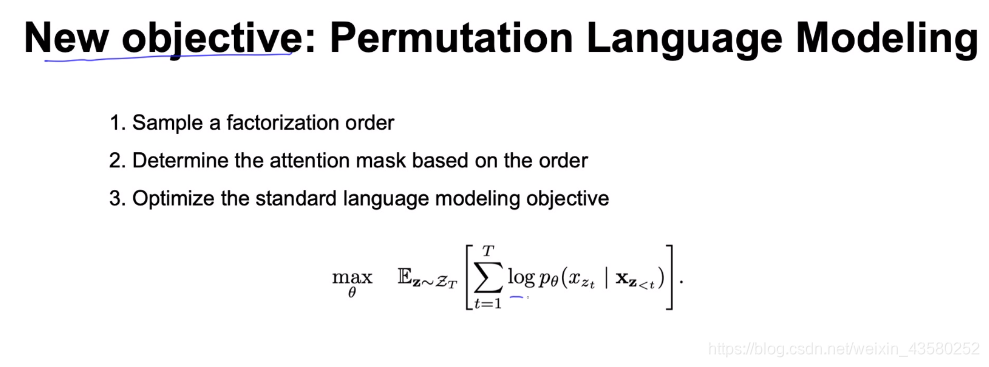

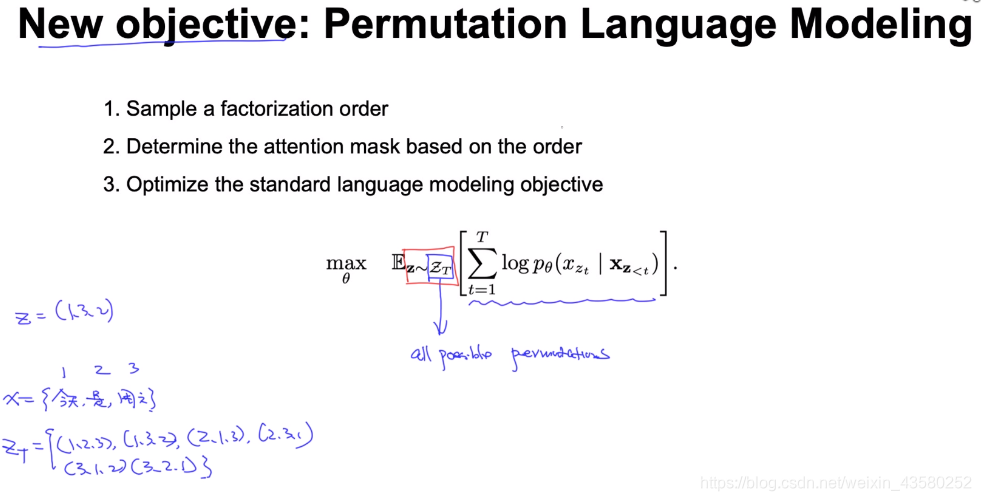

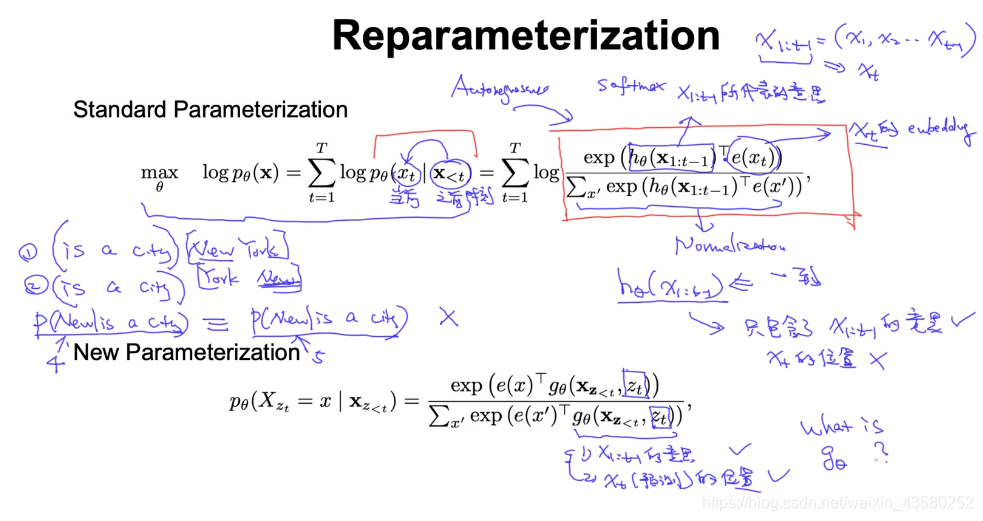

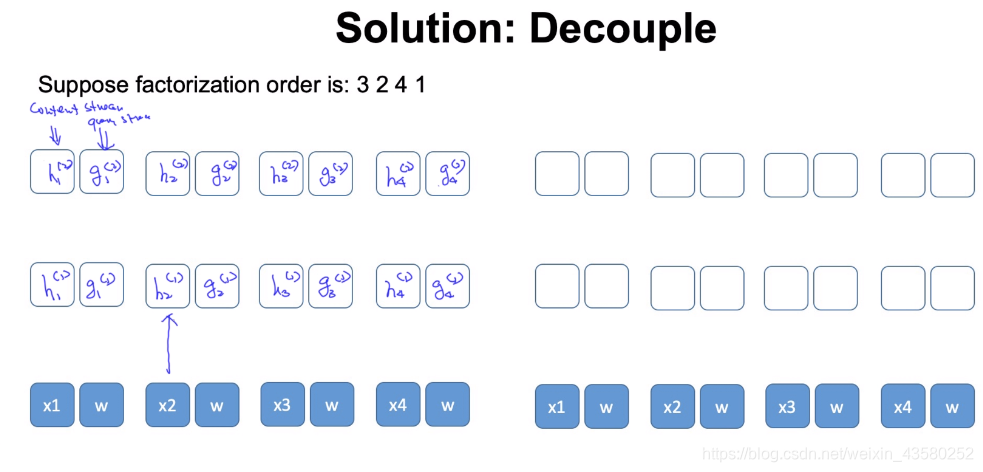

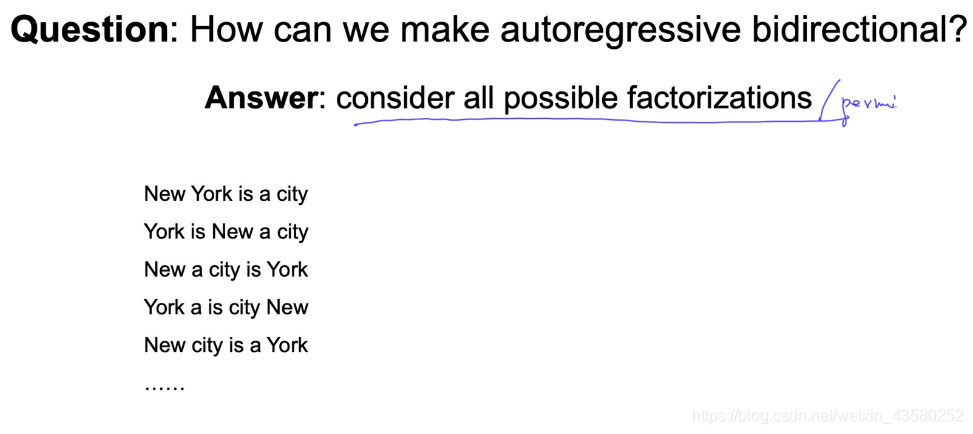

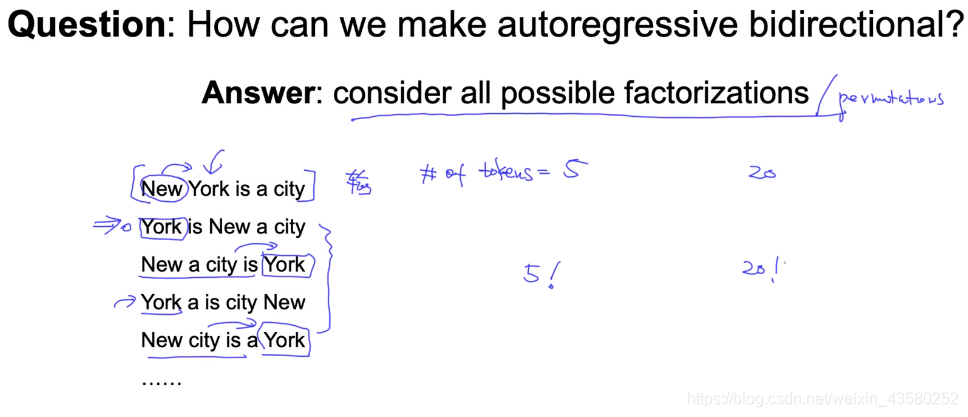

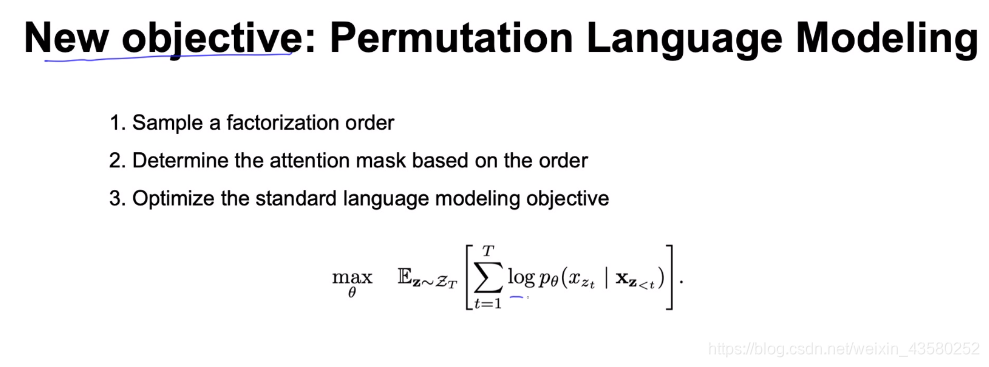

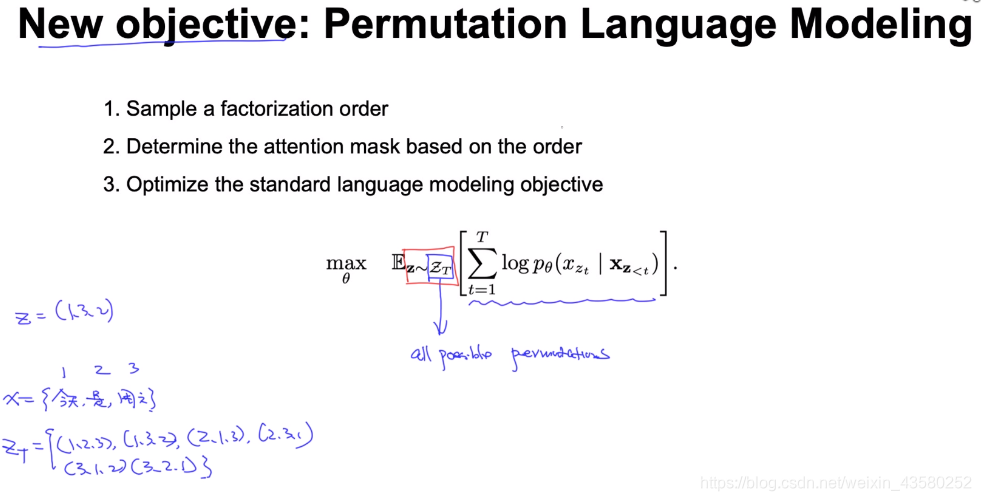

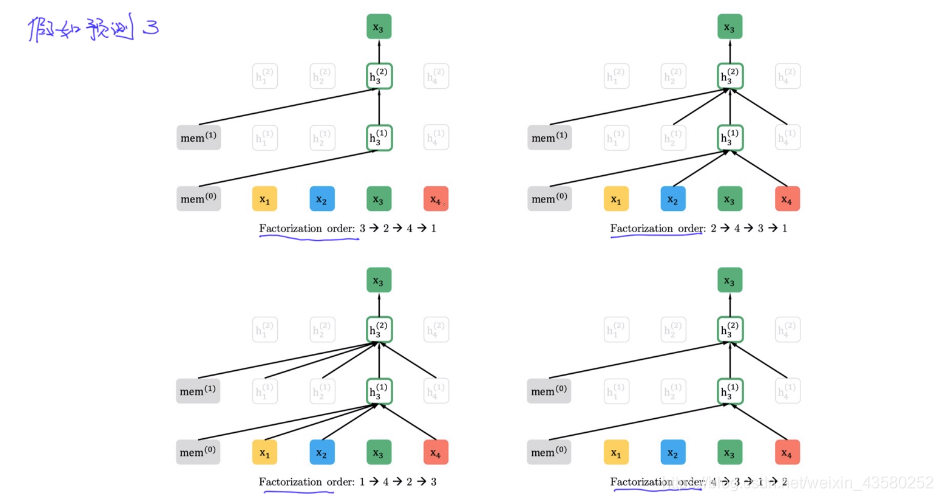

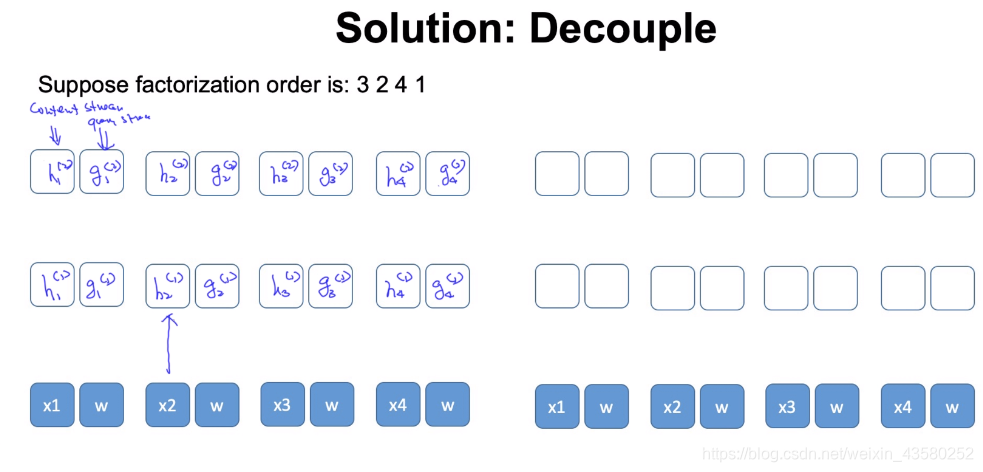

模型不能改变,改变数据的方式:

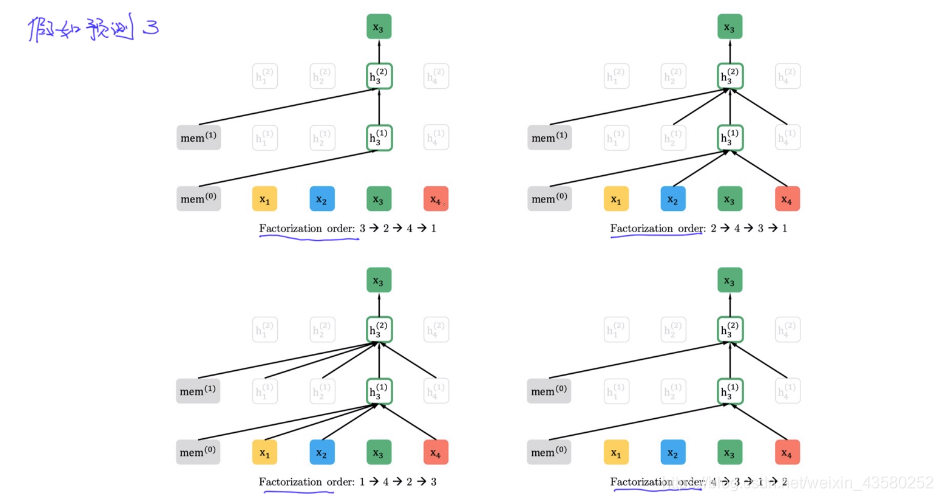

位置不能换,那就在模型里增加attention mask 告诉它学习哪些

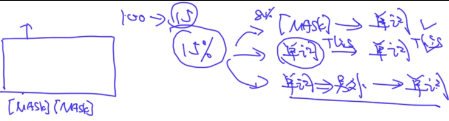

attention mask

附件:bert中有的mask,有些保持不变,有些改变

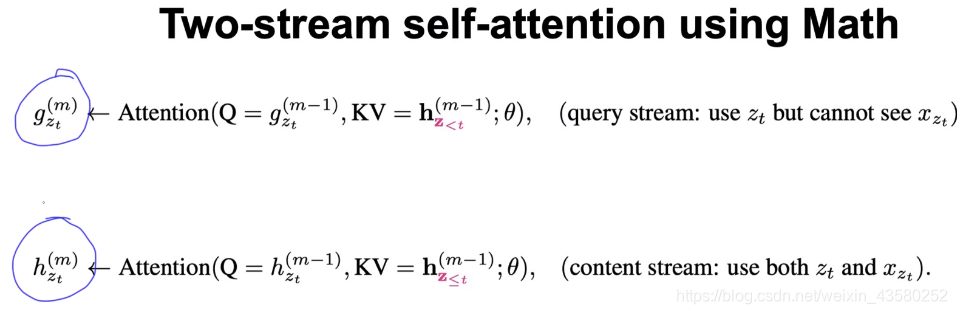

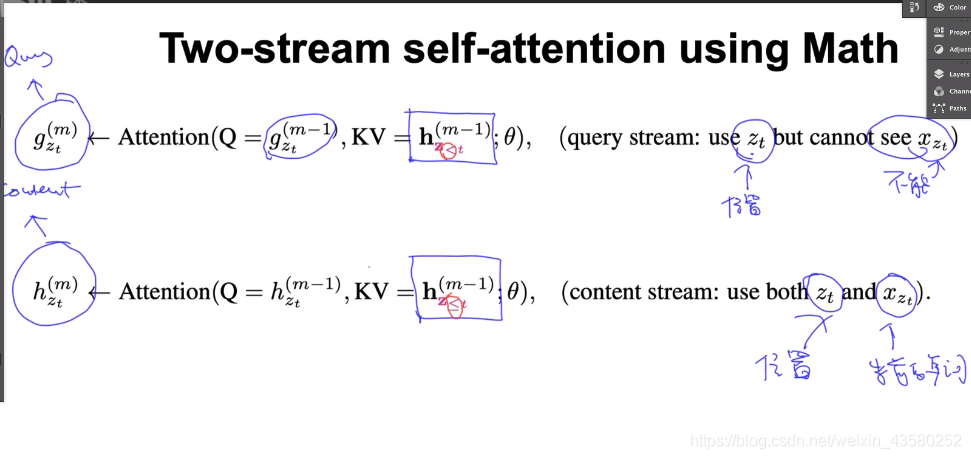

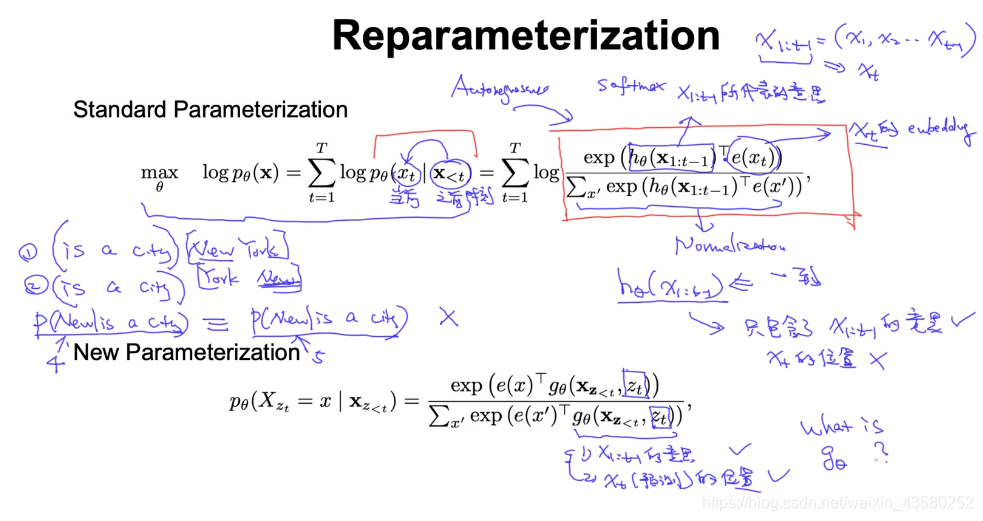

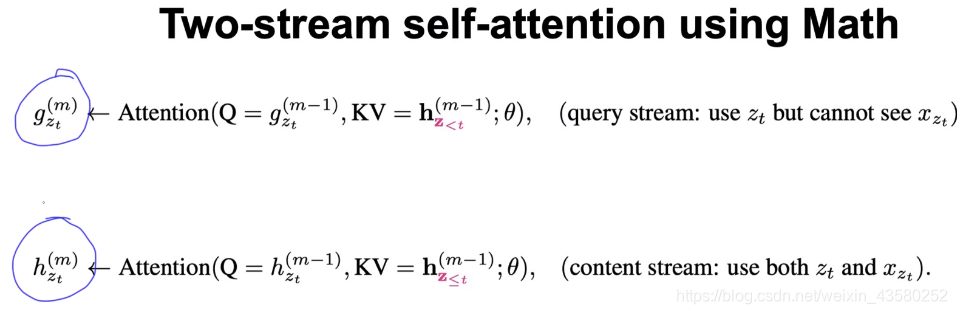

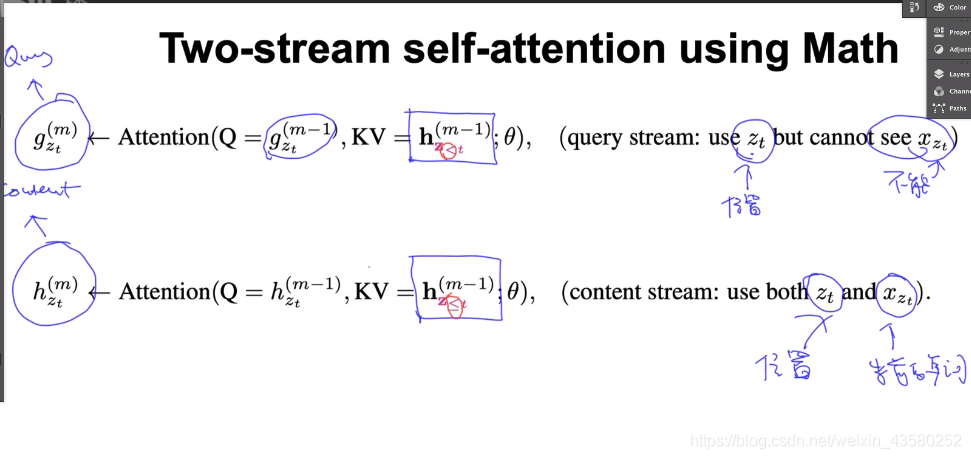

左边考虑位置,邮编考虑位置和内容

h考虑位置和内容,g只考虑位置

bert两个缺点(图右):

被预测单词的联系性没有考虑;

discrepancy差异性:训练和测试环境不一致性(mask token)

模型不能改变,改变数据的方式:

位置不能换,那就在模型里增加attention mask 告诉它学习哪些

attention mask

附件:bert中有的mask,有些保持不变,有些改变

左边考虑位置,邮编考虑位置和内容

h考虑位置和内容,g只考虑位置

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?