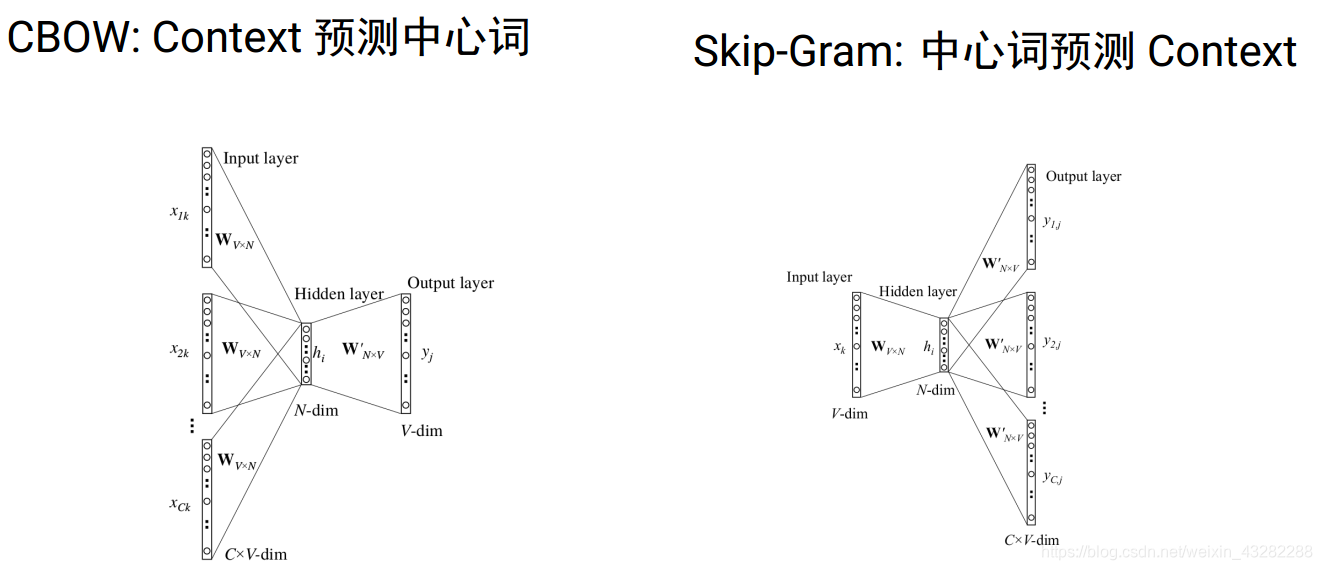

常用、流行的词嵌入方法,就是Word2Vec。这是Tomas Mikolov在谷歌工作时发明的一类方法,也是由谷歌开源的一个工具包的名称。具体来说,Word2Vec中涉及到了两种算法,一个是CBOW一个是Skip-Gram。这也是因为深度学习流行起来之后,基于神经网络来完成的Word Embedding方法。

当前Deep Learning在NLP领域的三个阶段为

还有BERT的变形ALBERT和超越BERT, 19年最佳NLP预训练模型ELECTRA

关于word2vec有两种模型,1是根据上下文预测中心词,2是根据中心词预测上下文

这里推荐这个文章https://blog.youkuaiyun.com/itplus/article/details/37969519

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?