论文题目: MobileNetV2: Inverted Residuals and Linear Bottlenecks

论文代码: MobileNetV2——Pytorch版本

摘要

在本文中,我们提出了一个新的移动架构——MobileNetV2。同时,我们也描述了一种应用这些移动模型到目标检测的有效方法——SSDLite。另外,我们也证明了如何利用一个简化的DeepLabV3构建移动的语义分割模型——MobileDeepLabv3。

MobileNetv2模型基于反向残差结构,shortcut连接位于薄的瓶颈层之间。中间膨胀层使用轻量级的深度卷积来过滤作为非线性来源的特征。此外,我们发现,为了保持表征能力,移除挤压层的非线性是重要的。

一、介绍

神经网络已经彻底改变了机器智能的许多领域,使具有挑战性的图像识别任务具有超人的精确性。然而,提高准确性往往是有代价的。现代先进的网络需要高计算资源,超出了许多移动和嵌入式的能力。

本文介绍了一种专门针对移动和资源受限环境的新型神经网络结构。我们的网络推动了移动计算机视觉模型的最新技术,显著减少操作和内存的数量,同时保持同样的精度。

我们的主要贡献是:带有线性瓶颈的反向残差。该模块首先将输入的低维压缩表征扩展到高维,使用轻量级深度卷积经过过滤;随后通过线性瓶颈将特征投影回低维压缩表征。

二、相关工作

如何使得深度神经网络在精度和性能之间取得最佳平衡,是近几年的热门话题。研究方向包括以下几部分:

- 改进先进模型以达到更好的性能

- 超参数调优以及各种网络修剪方法和连通性学习

- 改变内容卷积块的联通结构,例如ShuffleNet引入稀疏性等

- 最近,也有一个新方向将靠阔遗传算法和强化学习在内的优化算法引入,这使得得到的模型非常复杂。

MobileNetV2是基于MobileNetV1的,保留了该模型的简单性,显著的提高了其准确性,达到了针对移动应用的分类和检测应用的先进水平

三、深度可分离卷积

对于很多高效的神经网络结构来说,深度可分离卷积是一个关键的构建块。我们也在之前的工作当中使用深度可分离卷积块。相比于常规卷积,深度可分离卷积能够有效的降低计算量。在MobileNetV2中使用k=3(3x3深度可分离卷积),因此计算量比常规卷积降低了8-9倍。

3.1 常规卷积

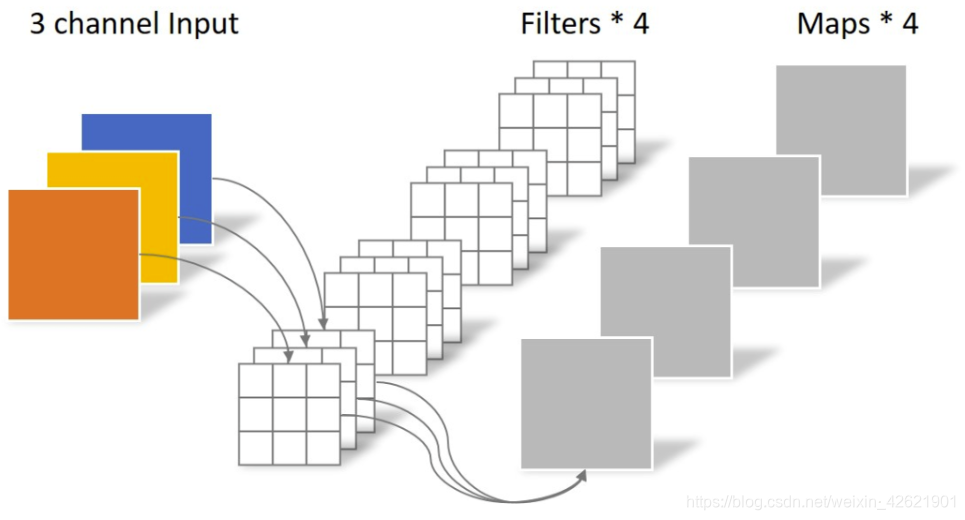

对于一个5x5大小,3通道的图像(shape为5x5x3),经过3x3的卷积核(假设输出通道数为4),得到的特征图shape为5x5x4(假设使用了padding)。

3.2 Depthwise and Pointwise Convolution

深度可分离卷积由两部分组成:逐通道卷积+逐点卷积

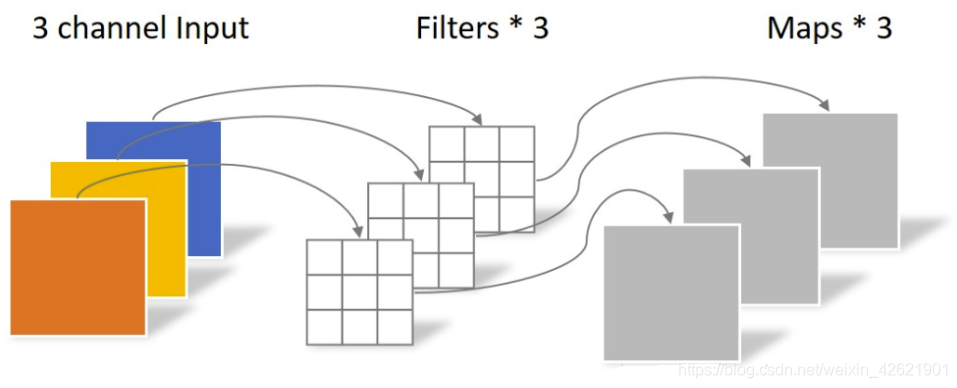

- 逐通道卷积

Depthwise Convolution 的一个卷积核负责一个通道。一个5x5,3通道的图像(shape为5x5x3)。首先对图像进行第一次卷积,最后得到3个特征图(shape为5x5x3)。

- 逐点卷积

Pointwise Convolution的运算与常规卷积运算非常相似,它的卷积核为1x1xM,M为上一层的通道数。有几个卷积核就会输出多少个特征图。

本文详细介绍了MobileNetV2的架构创新,包括反向残差结构和线性瓶颈层,以及深度可分离卷积在减少计算量和保持准确性方面的优势。MobileNetV2在移动和资源受限环境下实现了高性能,同时适用于分类和检测任务。

本文详细介绍了MobileNetV2的架构创新,包括反向残差结构和线性瓶颈层,以及深度可分离卷积在减少计算量和保持准确性方面的优势。MobileNetV2在移动和资源受限环境下实现了高性能,同时适用于分类和检测任务。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2624

2624

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?