提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

前言

提示:这里可以添加本文要记录的大概内容:

例如:随着人工智能的不断发展,机器学习这门技术也越来越重要,很多人都开启了学习机器学习,本文就介绍了机器学习的基础内容。

提示:以下是本篇文章正文内容,下面案例可供参考

一、什么ollama?

简单来说 :仅需一行命令即可在本快速部署大语言模型

二、使用步骤

1.安装

在官网下载适合自己系统的版本

https://ollama.com/

2.快速部署模型

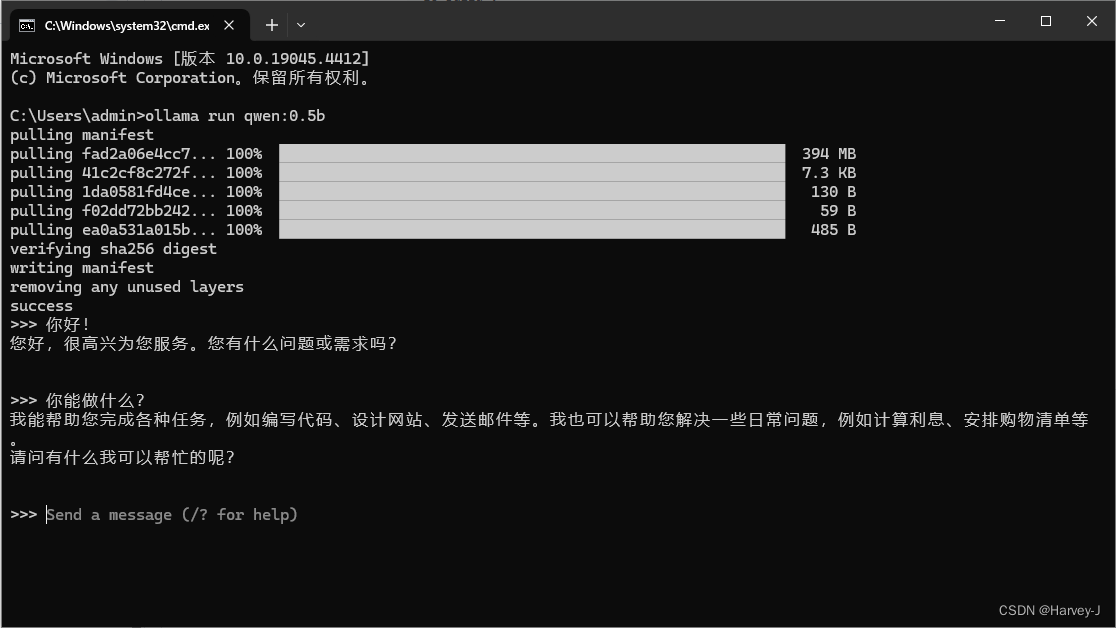

以Qwen0.5b为例–为了节省下载时间

ollama run qwen:0.5b

- 出现success代表下载模型部署完成

- Send a message 输入你向模型提问

- 得到回复

3.使用本地模型

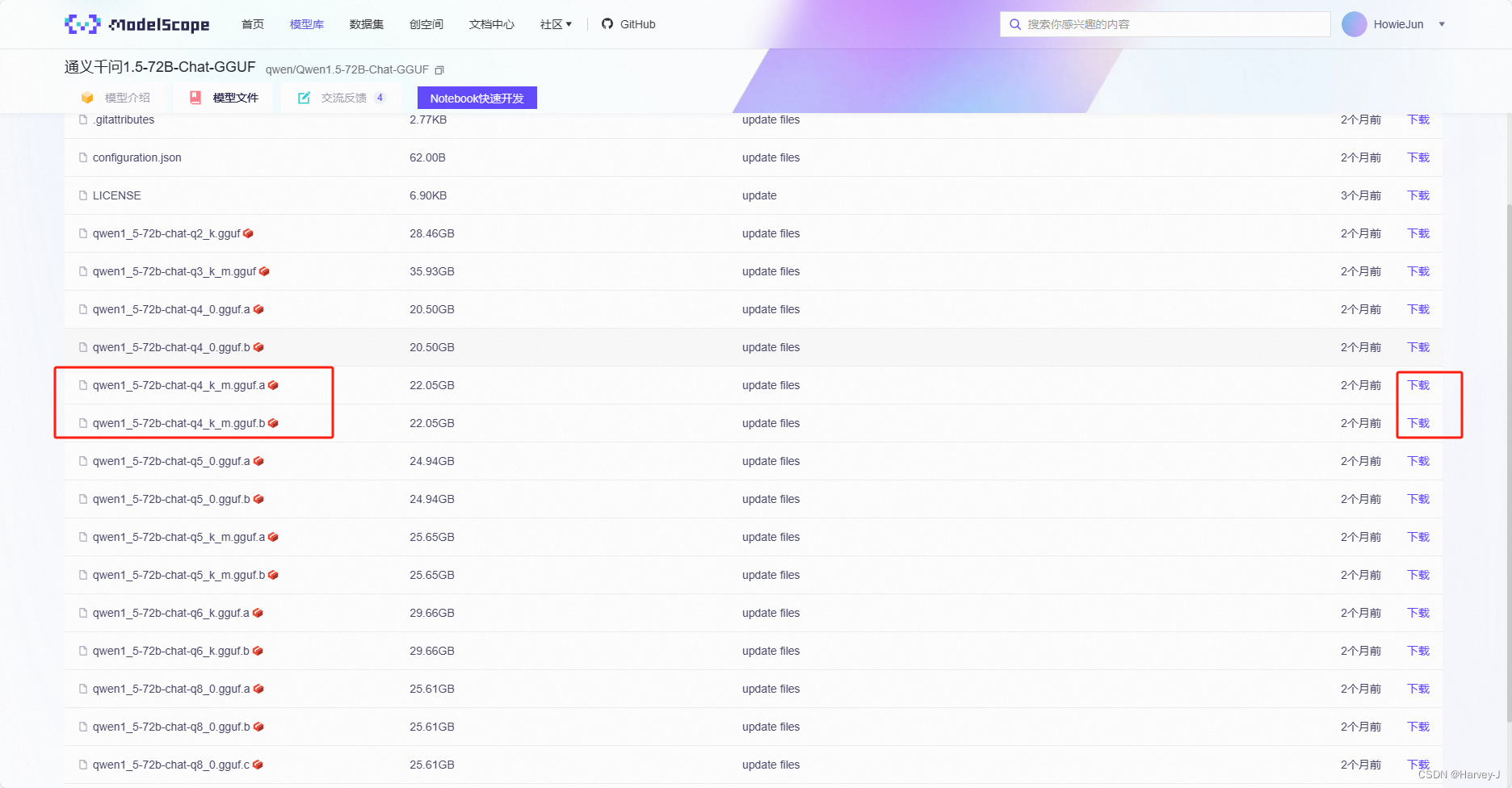

使用Qwen-72b-chat-GGUF为例

- 下载模型文件

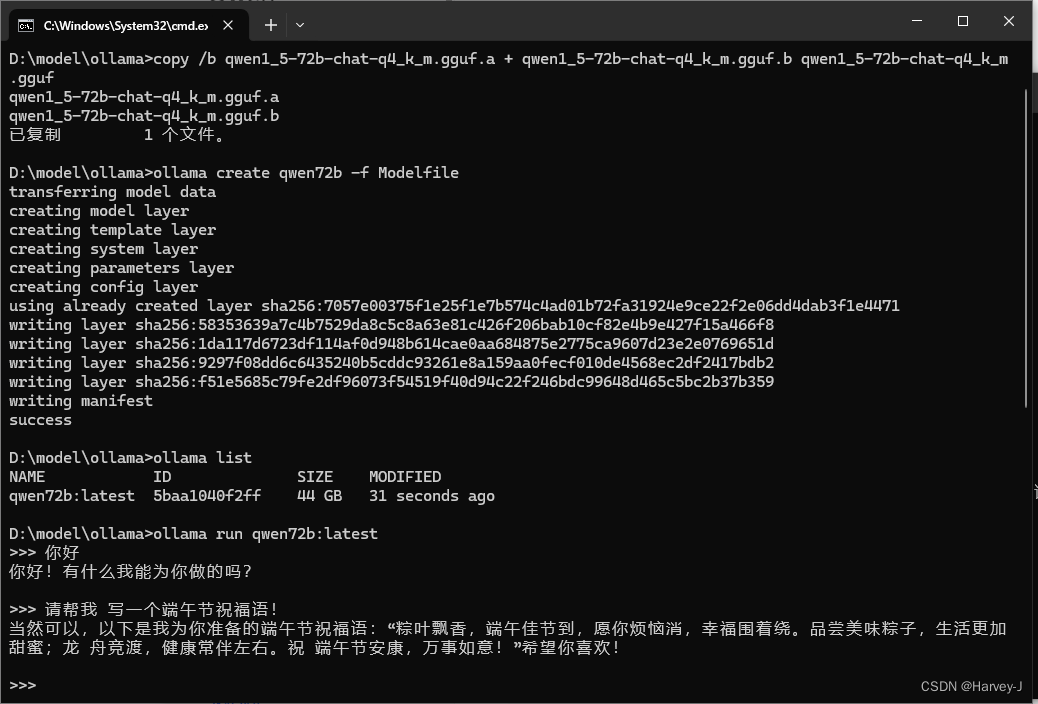

- 合并文件

copy /b qwen1_5-72b-chat-q4_k_m.gguf.a + qwen1_5-72b-chat-q4_k_m.gguf.b qwen1_5-72b-chat-q4_k_m.gguf

-

编写Modelfile 参考Qwen BlogQwen Blog

-

Modelfile内容如下

FROM qwen1_5-72b-chat-q4_k_m.gguf

# set the temperature to 1 [higher is more creative, lower is more coherent]

PARAMETER temperature 0.7

PARAMETER top_p 0.8

PARAMETER repeat_penalty 1.05

PARAMETER top_k 20

TEMPLATE """{{ if and .First .System }}<|im_start|>system

{{ .System }}<|im_end|>

{{ end }}<|im_start|>user

{{ .Prompt }}<|im_end|>

<|im_start|>assistant

{{ .Response }}"""

# set the system message

SYSTEM """

You are a helpful assistant.

"""

- 根据Modelfile创建适合ollama的模型

ollama create qwen72b -f Modelfile

- 运行本地制作好的ollama模型

ollama run qwen72b:latest

- 终端日志如下

4.扩展-模型上传

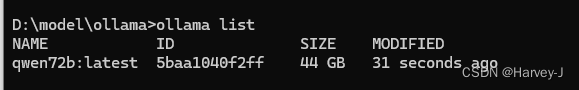

- 上一步在本地已经得到一个qwen72b模型

- 通过ollama list 查看

准备工作

在发布模型之前,您需要完成以下准备工作:

- 创建ollama账户:访问ollama官方网站创建您的账户,

- 复制您的Ollama公钥:您需要将您的公钥添加到ollama账户中以验证您的身份。

- macOS用户可以使用命令cat ~/.ollama/id_ed25519.pub 来查看公钥。

- Windows用户可以使用命令 type %SERPROFILE%.ollama\id_ed25519.pub

- Linux用户可以使用命令 cat /usr/share/ollama/.ollama/id_ed25519.pub。

- 添加公钥到您的ollama账户:登录到您的olama账户设置,将公钥添加到您的账户中。

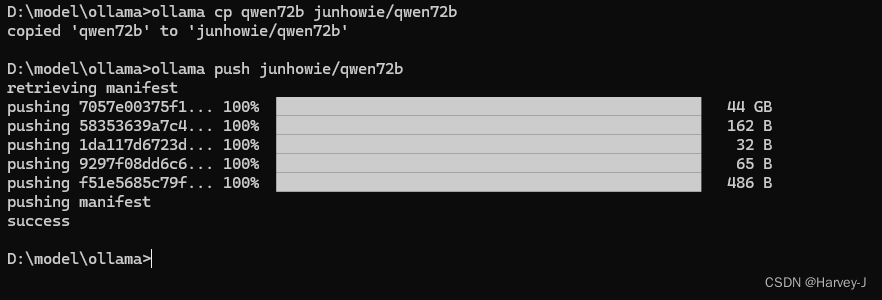

# 将本地模型复制到用户空间下

ollama cp qwen72b junhowie/qwen72b

#推送模型到ollama Model library中

ollama push junhowie/qwen72b

终端日志记录

推送完成可以在自己的用户空间中查看

使用刚刚上传的模型

# 任意用户都可以使用我刚刚上传的模型,仅需下面这一行命令

ollama run junhowie/qwen72b

相关参考链接

https://qwen.readthedocs.io/zh-cn/latest/run_locally/ollama.html

https://github.com/ollama/ollama/blob/main/README.md

总结

以上就是今天要讲的内容,本文仅仅简单介绍了ollama的使用

写在最后

欢迎移步我的Github仓库,https://github.com/Jun-Howie/erniebot-openai-api

本仓库使用飞桨星河社区接入ernie-4.0联网功能,如果你需要可以Fork我的仓库,还请给个Star让我知道

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?