本文记录了本地化部署Qwen 1.8B以及7B chat模型的过程。

1、克隆项目文件

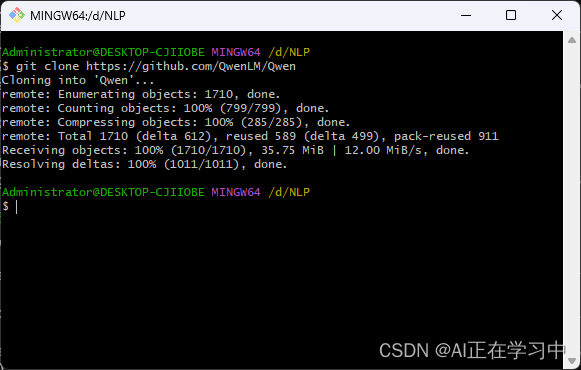

1.1 克隆qwen项目到本地

git clone https://github.com/QwenLM/Qwen

1.2 创建虚拟环境

conda create -n qwen python=3.11

conda activate qwen1.3 创建安装依赖环境

pip install -r requirements.txt1.4 安装GPU版本的pytorh

conda install pytorch=

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5245

5245

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?