部署yolov5 Triton Pipelines

1. 为什么使用Triton pipelines

众所周知,模型服务不仅包含 GPU based Inference,还包括preprocess和postprocess。Triton Pipelines是一种workflow, 它可以组合不同的模型服务组合成一个完整的应用, 同一个模型服务还可以被不同的workflow使用。

因此可以单独将preprocess或postprocess单独部署,然后通过Pipeline将它们和infer模块串联起来。这样做的好处是:

-

每个子模块都可以分别申请不同种类和大小的资源、配置不同的参数,以达到最大化模型服务效率的同时,充分利用计算资源。

-

可以避免传输中间张量的开销,减小通过网络传输的数据大小,并最大限度地减少必须发送到 Triton 的请求数量。

2. Triton Pipelines的实现方式

Nvidia Triton提供了两种Pipleline的部署方式:分别为Business Logic Scripting(BLS)和Ensemble。下面简单介绍一下这两种方式。

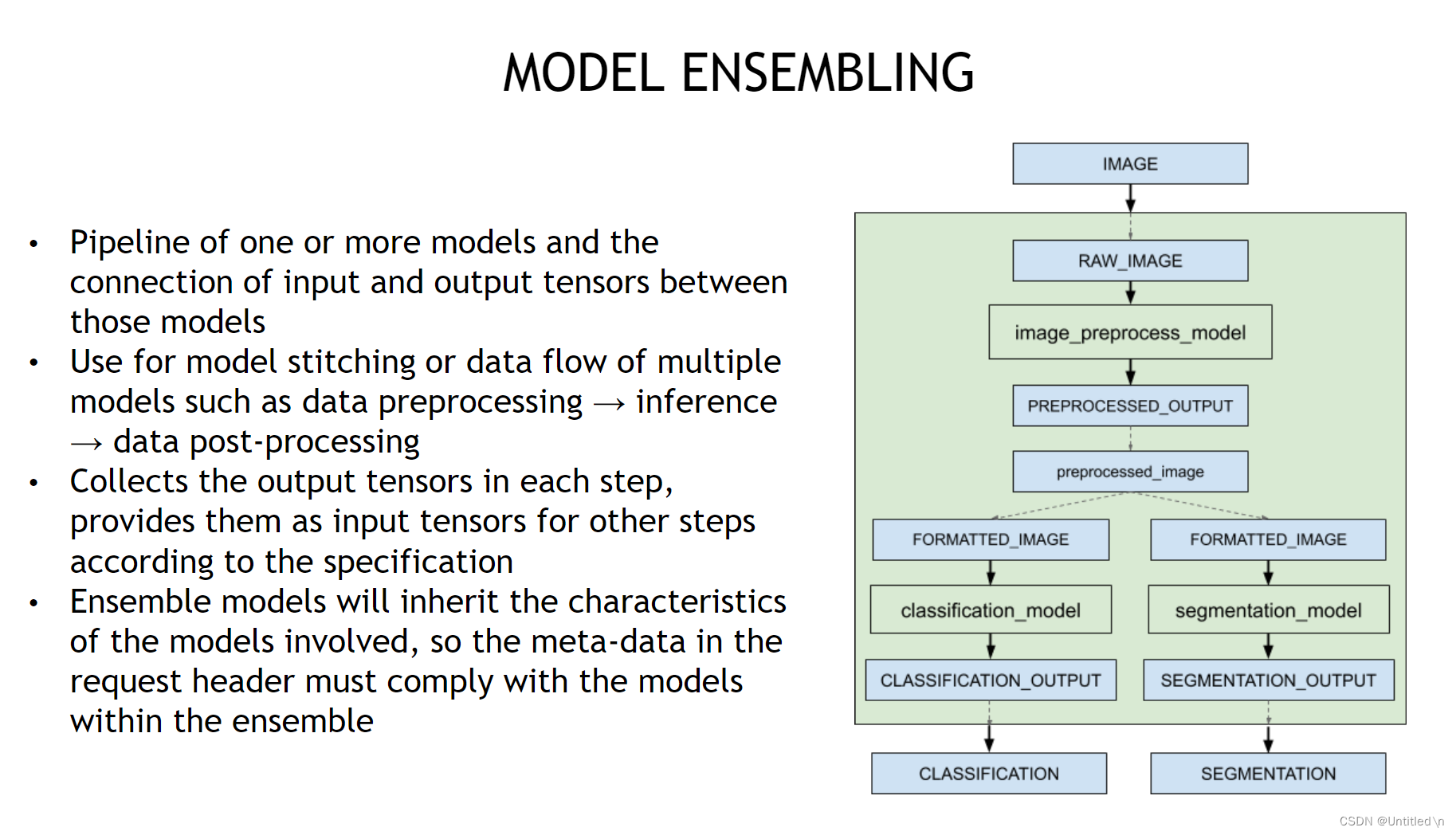

- Ensemble

通过组合model repository里的各类模型成为一个workflow。是一种pipeline调度策略,而不是具体的model。 ensemble效率更高,但无法加入条件逻辑判断,数据只能按照设定的pipeline流动,适合pipeline结构固定的场景

- BLS

一种特殊的python backend,通过python code调用其他model instance。BLS灵活性更高,可以加入一些逻辑和循环来动态组合不同的模型,从而控制数据的流动

本文介绍了Triton Pipelines在模型服务中的应用。它是一种工作流,可将不同模型服务组合成完整应用。其实现方式有BLS和Ensemble,前者灵活性高,后者效率高。还阐述了部署方法,以目标检测为例,将nms模块单独部署,通过pipelines连接相关模块,并给出了工作流及处理输出数量不固定的方法。

本文介绍了Triton Pipelines在模型服务中的应用。它是一种工作流,可将不同模型服务组合成完整应用。其实现方式有BLS和Ensemble,前者灵活性高,后者效率高。还阐述了部署方法,以目标检测为例,将nms模块单独部署,通过pipelines连接相关模块,并给出了工作流及处理输出数量不固定的方法。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1560

1560

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?