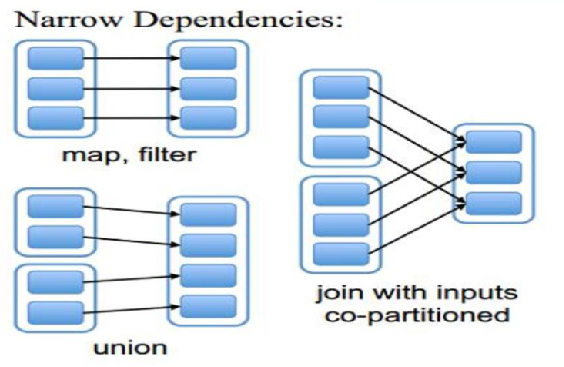

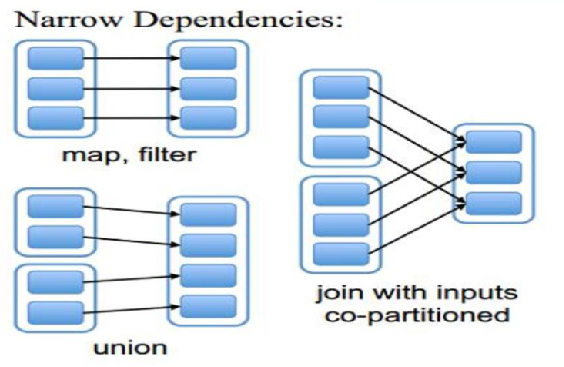

窄依赖指的是每一个父RDD的Partition最多被子RDD的一个Partition使用。

窄依赖的算子有:map, filter, union, join(父RDD是hash-partitioned ), mapPartitions, mapValues。

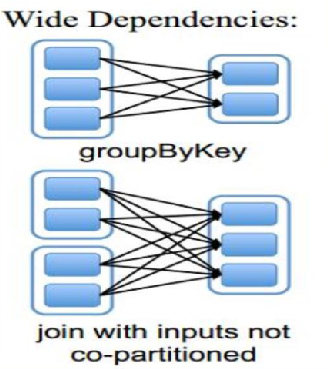

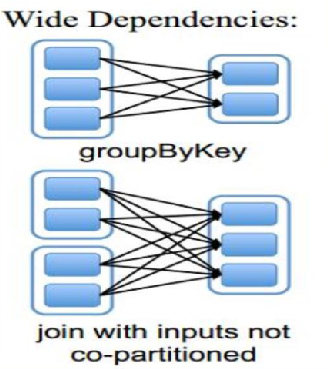

宽依赖指的是多个子RDD的Partition会依赖同一个父RDD的Partition。

宽依赖的算子有:groupByKey, join(父RDD不是hash-partitioned ), partitionBy。

窄依赖指的是每一个父RDD的Partition最多被子RDD的一个Partition使用。

窄依赖的算子有:map, filter, union, join(父RDD是hash-partitioned ), mapPartitions, mapValues。

宽依赖指的是多个子RDD的Partition会依赖同一个父RDD的Partition。

宽依赖的算子有:groupByKey, join(父RDD不是hash-partitioned ), partitionBy。

2975

2975

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?