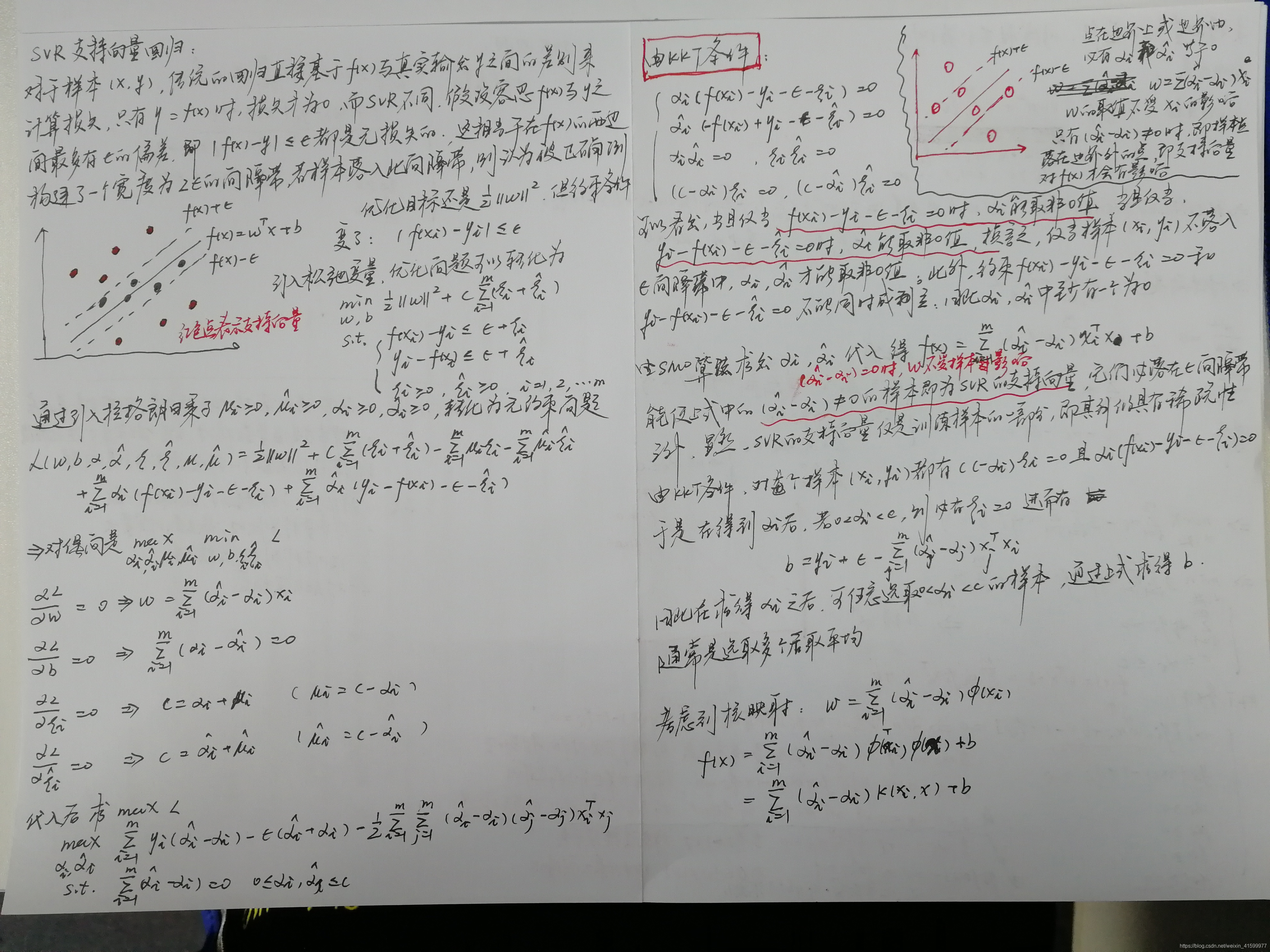

SVM除了具有线性分类和非线性分类之外,还支持回归(SVR)。与传统的回归问题有所不同,在定义损失的时候,容忍f(x)与y之间有一定的偏差,具体推导过程如下图。由于回归问题引入了容忍偏差,松弛变量,式子相较于SVM分类更复杂一些,但是总体的求解思路是一致的,包括:定义目标函数、目标函数转换为无约束优化问题、对偶问题、SMO求解α,根据KKT条件找支持向量并计算b。

上图中把W带入化简过程已省略,感兴趣的可以自己推一下,与SVM分类的化简过程相似,本人偷了个懒…

上图中把W带入化简过程已省略,感兴趣的可以自己推一下,与SVM分类的化简过程相似,本人偷了个懒…

最近计划把所有常用的机器学习算法都从头到尾手写一遍,以后关于机器学习方面的内容大都以图片的形式展现,如果阅读困难可以留言交流,提前祝大家六一儿童节快乐,也祝我的母校110周年生日快乐!

机器学习sklearn之支持向量回归(SVR)

最新推荐文章于 2025-06-02 14:55:18 发布

博客介绍了SVM除分类外还支持回归(SVR),其与传统回归不同,定义损失时容忍一定偏差,式子比SVM分类更复杂,但求解思路一致,包括定义目标函数等步骤,还提及后续计划以图片展现机器学习内容。

博客介绍了SVM除分类外还支持回归(SVR),其与传统回归不同,定义损失时容忍一定偏差,式子比SVM分类更复杂,但求解思路一致,包括定义目标函数等步骤,还提及后续计划以图片展现机器学习内容。

1026

1026

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?