这一节将开始介绍关于神经网络的相关内容。

1. Motivations [动机]:(略)。

2. Neural Networks [神经网络]:

2.1 Model Representation (1) [ 模型表示法(1)]:

2.1.1 让我们从非常简单的神经元的机理来讨论这个问题,神经元可以看做是一个计算单元,其从树突(们)[Dendrites]接收输入,这些输入可以被当做带电输入(被称为“spikes [尖波]”),相应的输出从axons [轴突]输出带电尖波。

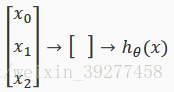

2.1.2 在我们的模型中,我们的树突就像输入的特征x1、x2、x3等,输出是我们的假设函数的结果。在这个模型中,我们的x0输入节点有时被称为“Bias Unit [偏差(置)单元]”,它的值总是等于1。

2.1.3 此外,在神经网络中,我们将使用与分类问题相同的逻辑函数,但我们有时称它为sigmoid(逻辑)激励函数。这种情况下,“theta”参数有时也被称为“权重”。形象第一种简单的示意图表示如下:

2.1.4 输入节点(层1)也称为“输入层”,进入另一个节点(第二层)后最终输出假设函数,即所谓的“输出层”。在输入和输出层之间的中间层被称为“隐藏层”。在本例中,我们将这些中间或“隐藏”层节点标记为a0方……an方,并将其称为“Activation Units [激励单元]”。

2.1.5 具体来说,某隐藏层将会是如下一形式。而每个激励Node [节点] 的值由如下二得到。

本文深入探讨神经网络的动机与模型表示。首先介绍了神经元的基本工作原理,随后详细阐述了神经网络的模型表示,包括输入、隐藏和输出层的结构,以及权重矩阵在计算中的作用。此外,通过示例展示了如何使用神经网络实现逻辑运算,包括AND、NOR、OR以及XNOR,并探讨了神经网络在多类分类问题中的应用。

本文深入探讨神经网络的动机与模型表示。首先介绍了神经元的基本工作原理,随后详细阐述了神经网络的模型表示,包括输入、隐藏和输出层的结构,以及权重矩阵在计算中的作用。此外,通过示例展示了如何使用神经网络实现逻辑运算,包括AND、NOR、OR以及XNOR,并探讨了神经网络在多类分类问题中的应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2615

2615

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?