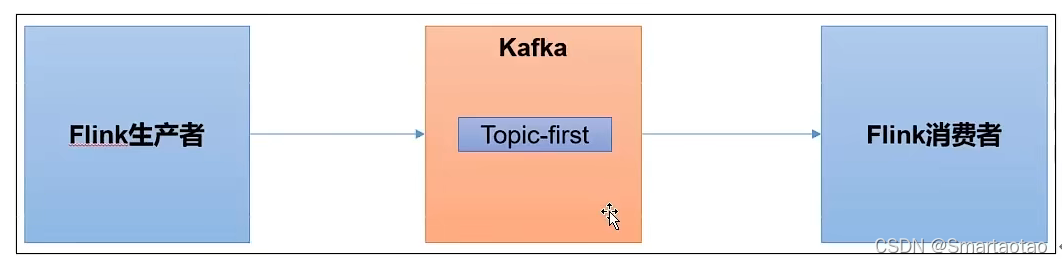

Flink是一个在大数据开发中非常常用的组件。可以用于Kafka的生产者,亦可以用于Flink的消费者

一、Flink环境准备

- 创建一个maven项目flink-kafka

- 添加配置文件

<dependencies>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-java</artifactId>

<version>1.13.0</version>

</dependency>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-streaming-java_2.12</artifactId>

<version>1.13.0</version>

</dependency>

<dependency>

<groupId>org.apache.flink</groupId></

本文档介绍了如何集成Flink与Kafka,包括Flink环境的准备,创建Flink Kafka Producer发送数据,以及构建Flink Kafka Consumer进行数据消费。详细步骤包括在Maven项目中配置log4j.properties,创建Flink Kafka Producer和Consumer的Java类并提供示例代码。

本文档介绍了如何集成Flink与Kafka,包括Flink环境的准备,创建Flink Kafka Producer发送数据,以及构建Flink Kafka Consumer进行数据消费。详细步骤包括在Maven项目中配置log4j.properties,创建Flink Kafka Producer和Consumer的Java类并提供示例代码。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1392

1392

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?