最近参加了一次kaggle竞赛Jigsaw Unintended Bias in Toxicity Classification,经过一个多月的努力探索,从5月20日左右到6月26日提交最终的两个kernel,在public dataset上最终排名为4%(115/3167),说实话以前也并没有怎么接触过NLP方面的东西,对深度学习的理解也不是特别深刻。

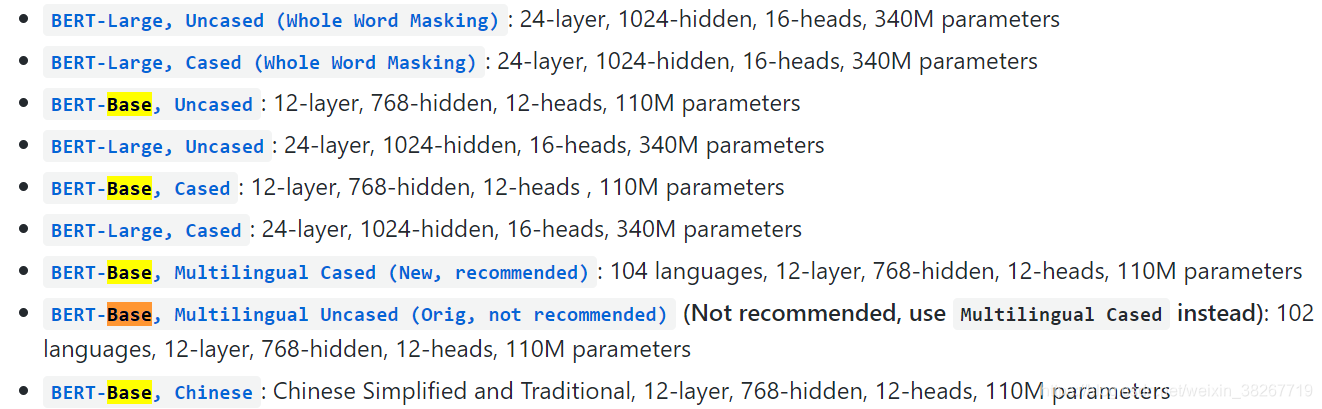

BERT是目前非常火的NLP模型,采用两段式的训练方式,分为pretrain和fine-tune两部分,pretrain部分由谷歌在TPU集群上训练完成,并给出部分模型供免费下载使用。其中包括’cased_l-24_h-1024_a-16’, ‘chinese_l-12_h-768_a-12’, ‘uncased_l-12_h-768_a-12’, ‘uncased_l-24_h-1024_a-16’, ‘multi_cased_l-12_h-768_a-12’, ‘cased_l-12_h-768_a-12’

github上的下载地址为

https://github.com/google-research/bert

在本次比赛中主要采用的是BERT-Base,uncased的这个model,训练全数据180万左右的样本,样本长度设为220,在四卡Titan的GPU卡上训练的时间接近6小时,BERT-Large,uncased的训练时间大概是33小时左右。uncased和cased的区别在于uncased将全部样本变为小写,而cased则要区分大小写,将cased和uncased的模型训练结果进行融合也会有一定程度的提升。

比赛的主要代码是在一个以色列大佬的kernrl上进行修改,比赛结束时已经被fork了将近1595,代码地址

https://www.kaggle.com/yuval6967/toxic-bert-plain-vanila,非常感谢这位无私的大佬

代码详解

将样本文本转为成bert-format

def convert_lines(example, max_seq_length,tokenizer):

max_seq_length -=2

all_tokens = []

longer = 0

for text in tqdm_notebook(example):

tokens_a = tokenizer.tokenize(text)

if len(tokens_a)>max

本文介绍了作者在Kaggle Jigsaw比赛中的经验,利用BERT模型进行文本分类。重点讨论了BERT的预训练和微调过程,以及在训练过程中对损失函数、epoch数、参数调整等方面的理解和实践,分享了提高预测准确率的关键步骤。

本文介绍了作者在Kaggle Jigsaw比赛中的经验,利用BERT模型进行文本分类。重点讨论了BERT的预训练和微调过程,以及在训练过程中对损失函数、epoch数、参数调整等方面的理解和实践,分享了提高预测准确率的关键步骤。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

835

835

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?