一、准备工作:

1、下载release版spark 0.9.1,本次用的版本是spark-0.9.1-bin-cdh4。

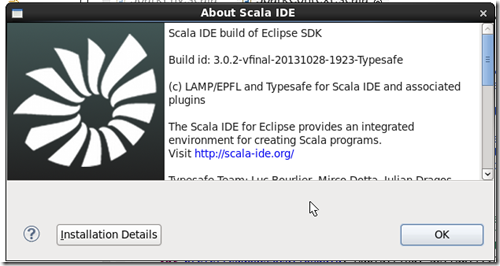

2、下载scala IDE 3.0.2,这个版本ide的支持scala 2.10版。

二、配置工作

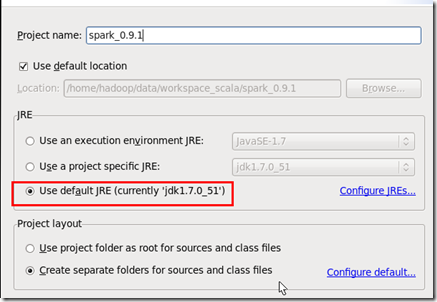

1、在ide中新建scala项目,注意jre要用jdk1.7版的。如下图:

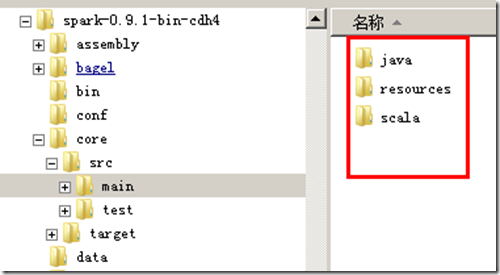

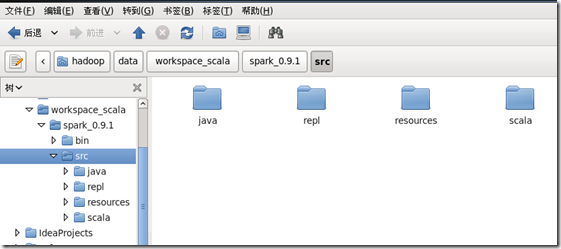

2、找到spark-0.9.1-bin-cdh4\core\src\main,目录下java、resources、scala三个目录,如下图

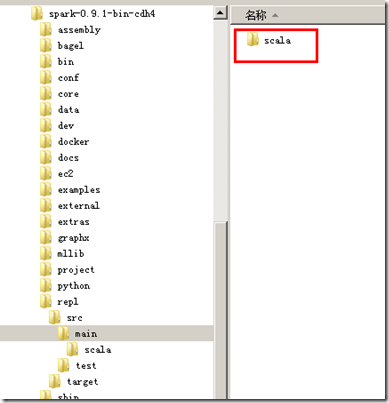

找到spark-0.9.1-bin-cdh4\repl\src\main,目录下有sacla一个目录,如下图

将java、resources、scala、scala共4个目录及文件到项目ide的src目录下,repl\src\main下的sacla目录在ide里改为repl,ide中的目录结构如下:

然后在ide中刷新,更新项目目录。

3、在ide弹出项目的“properties”窗口。

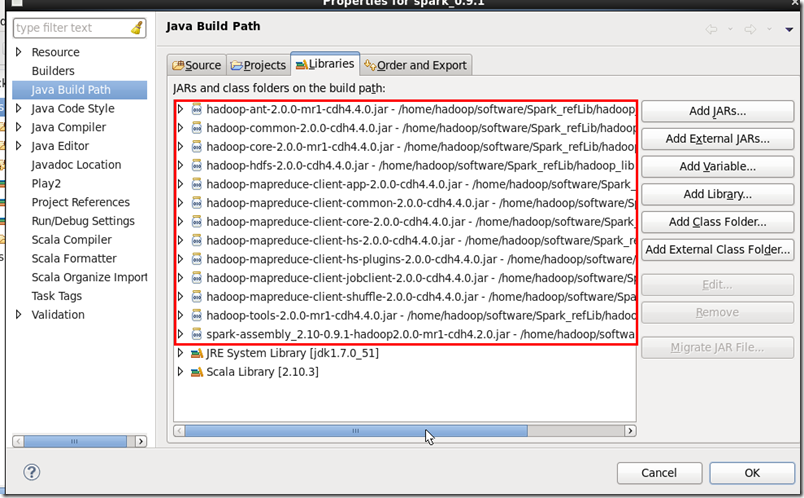

A、在”Java Build Path\Libraries”找到添加Hadoop和Spark的包,如下图所示:

其中,hadoop的包来自hadoop的shark目录下的jar文件。spark-assembly_2.10-0.9.1……cdh4.2.0.jar文件即是release版的spark文件,但在此处,要对文件做修改,把里边的org\apache\spark目录删除掉。

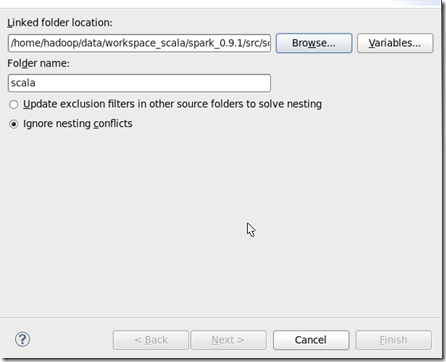

B、在”Java Build Path\Source”页面点击“Link Source……”

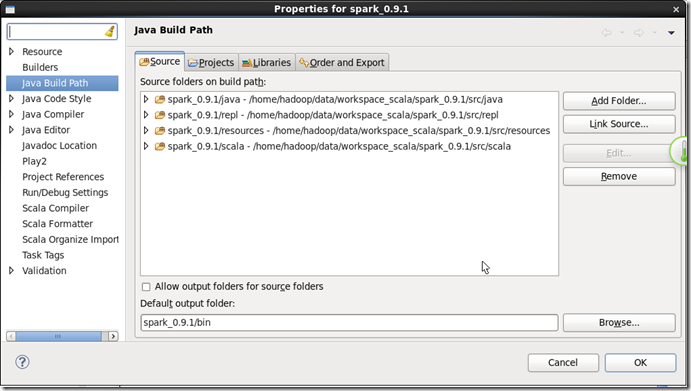

操作4次,分别添加java、resources、scala、repl目录,然后“Remove”按钮,删除项目原有的src目录,结果如下:

最终的项目结构如下图所示:

此时,ide已经可以编译,但有错误,原因是编译配置不对。

4、编译设置

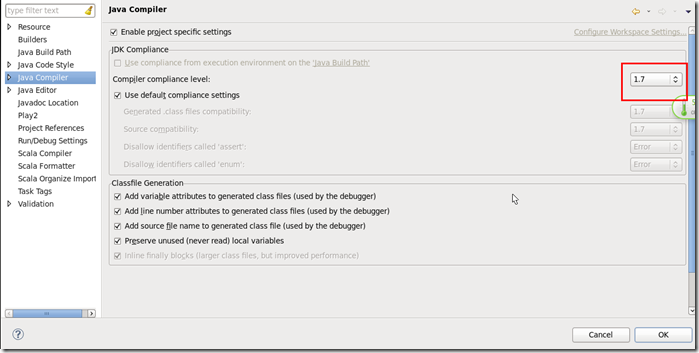

A、java编译配置

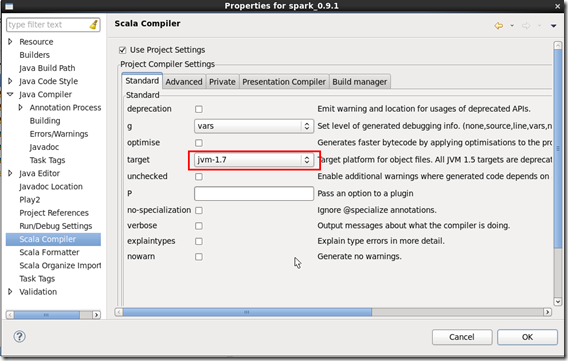

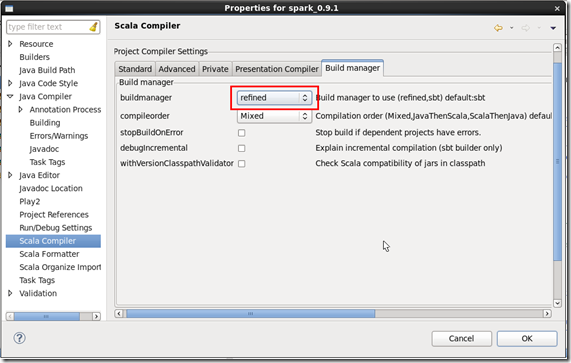

B、scala编译配置

5、运行。

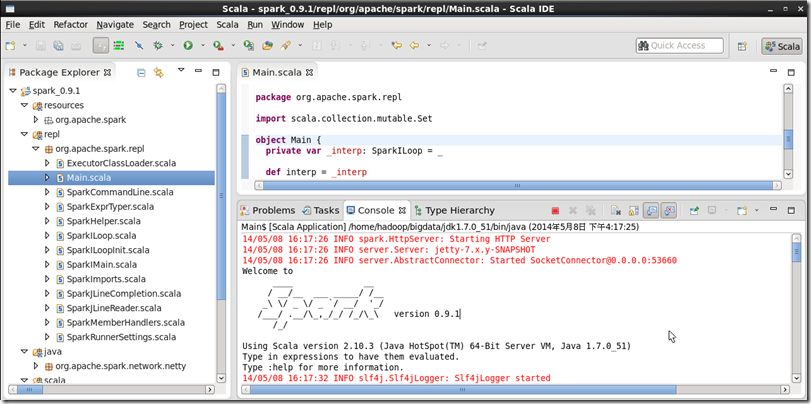

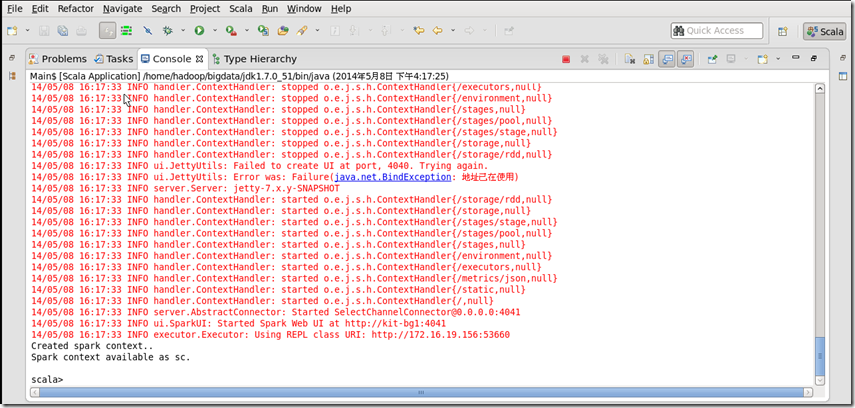

在ide中找到org\apache\spark\repl包下的Main.scala,打开后运行应该可以看到如下内容:

启动完后,与spark-shell的操作界面一样,如下图:

本文详细介绍了如何在Scala IDE中配置并使用Spark 0.9.1版本进行开发,包括下载所需组件、IDE设置、引入依赖、目录结构调整等步骤,最终实现IDE的编译与运行。

本文详细介绍了如何在Scala IDE中配置并使用Spark 0.9.1版本进行开发,包括下载所需组件、IDE设置、引入依赖、目录结构调整等步骤,最终实现IDE的编译与运行。

1970

1970

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?