**

一,面临的挑战

**

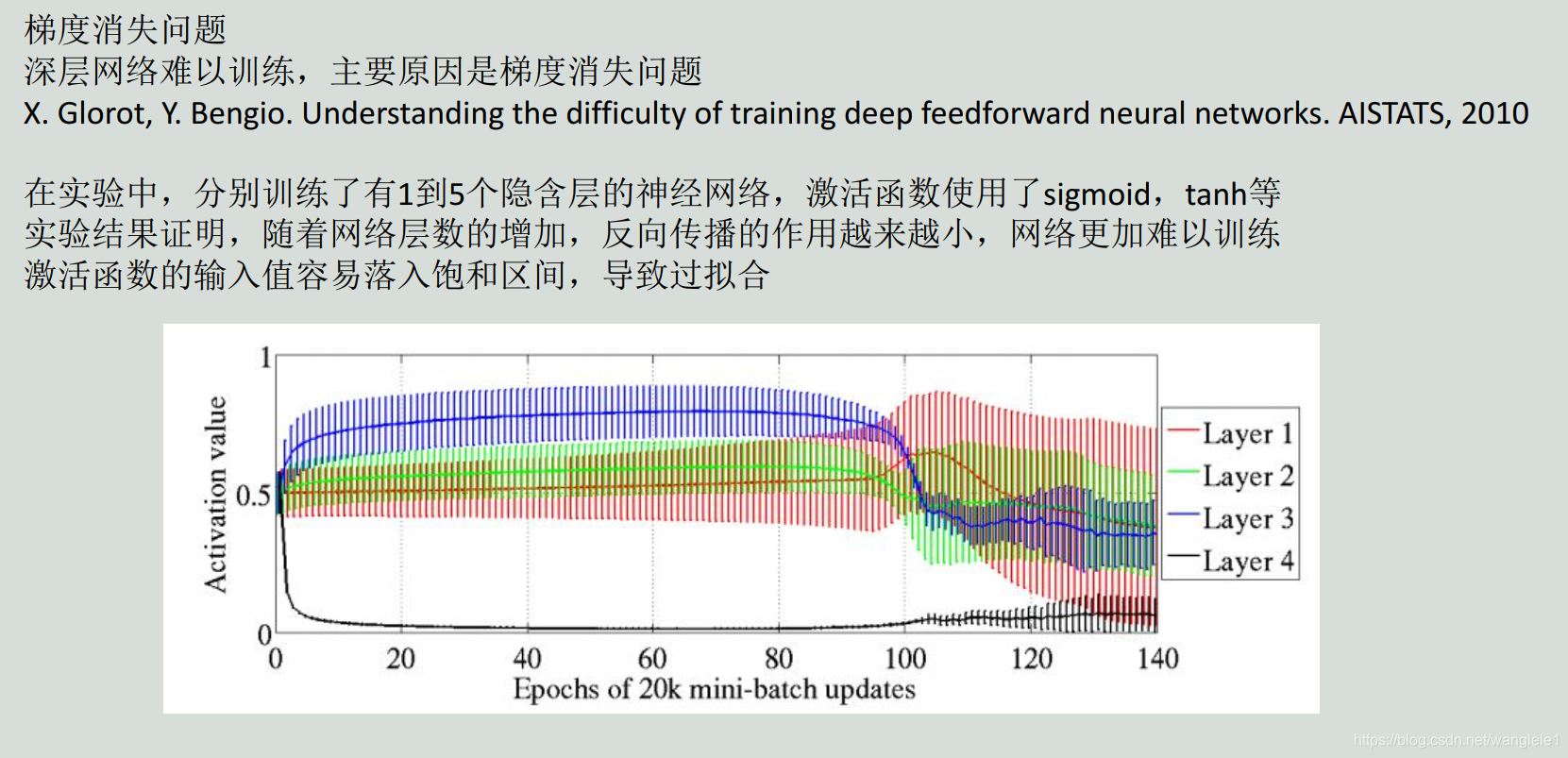

1,梯度消失问题

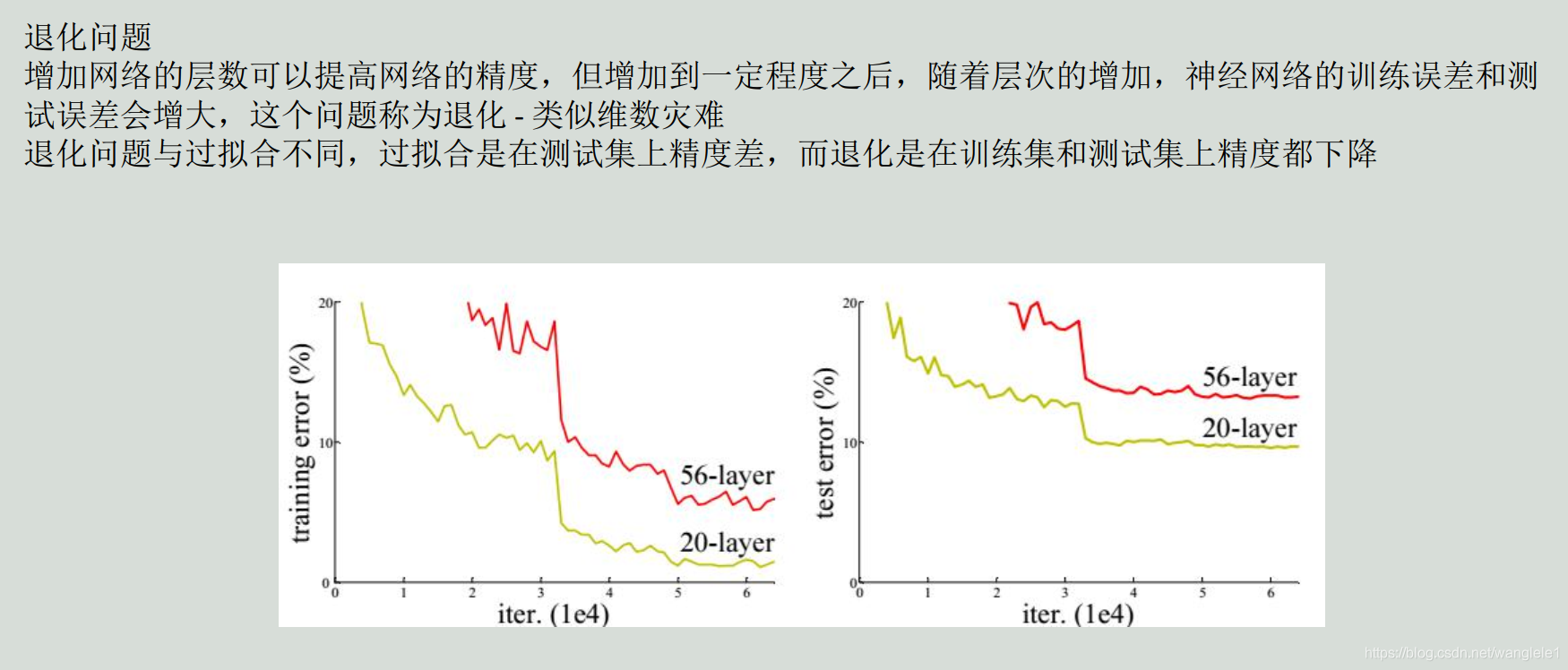

2,退化问题

2,退化问题

**

**

二,改进的方法

**

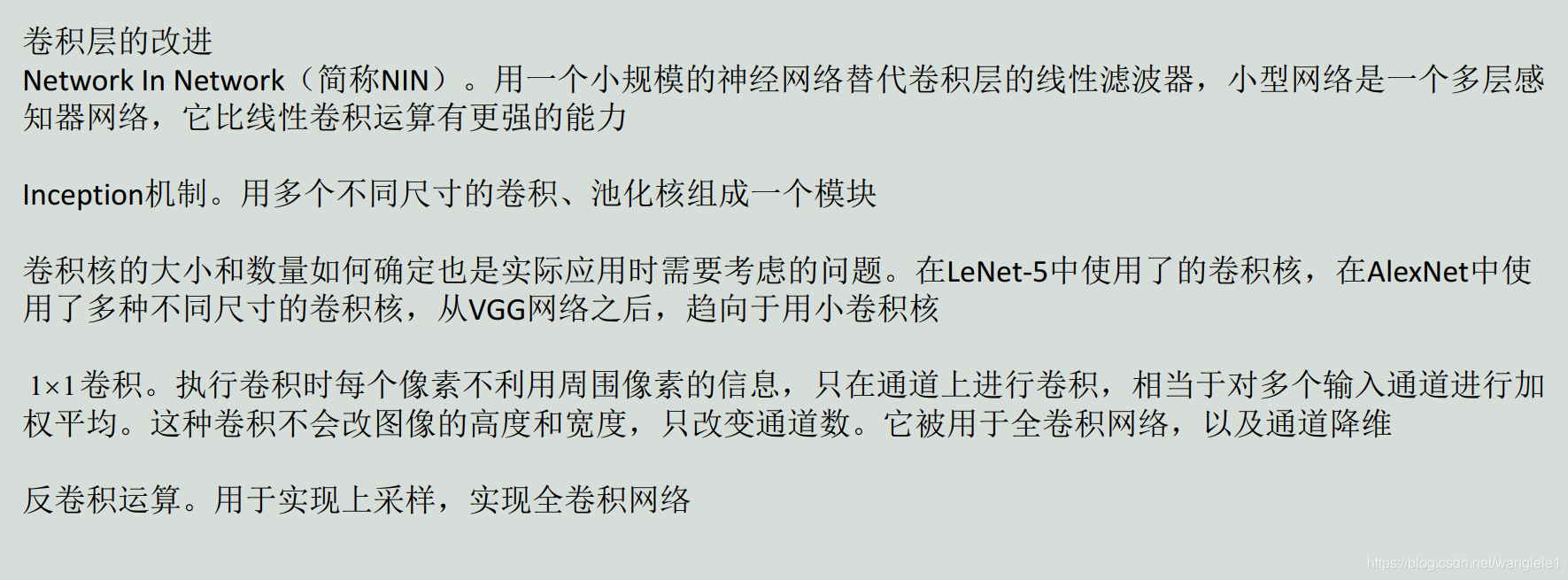

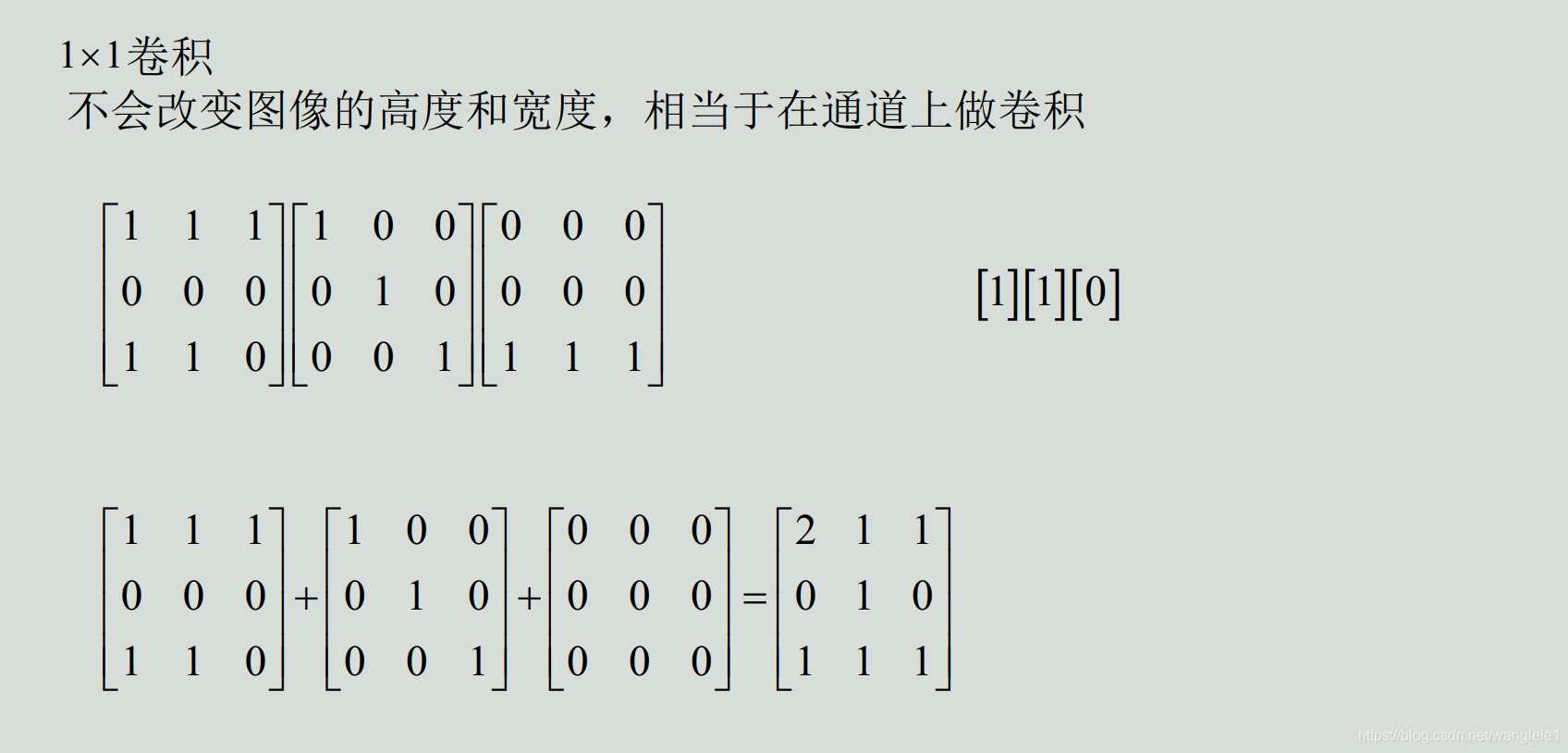

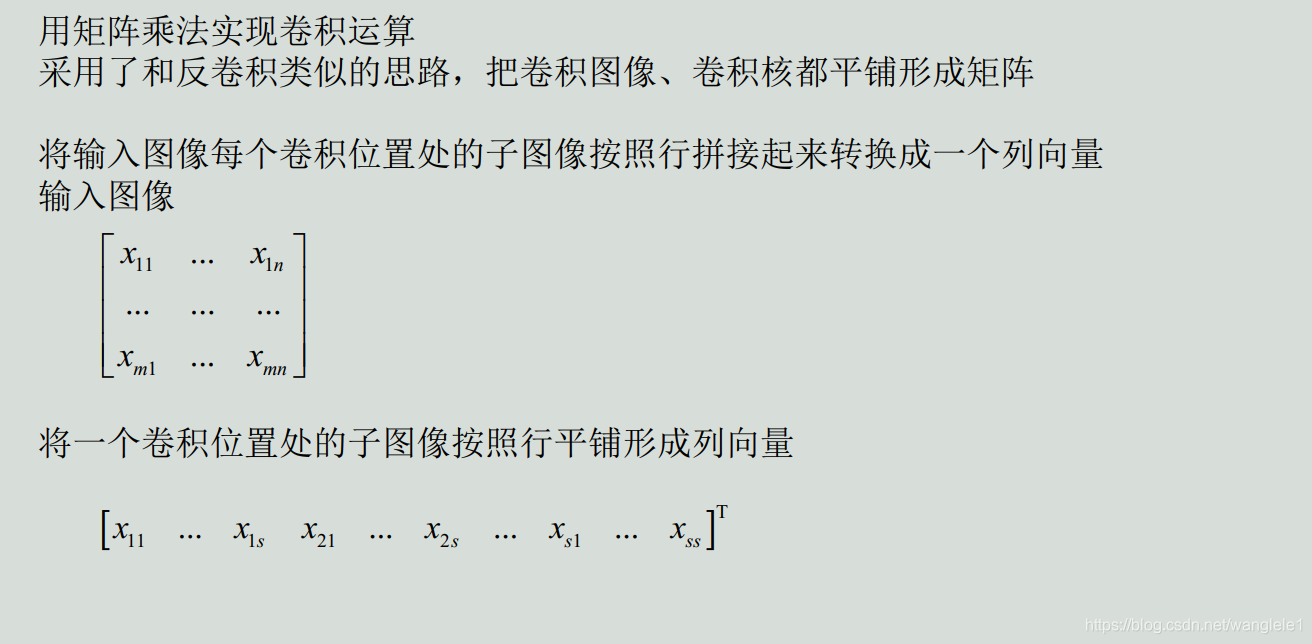

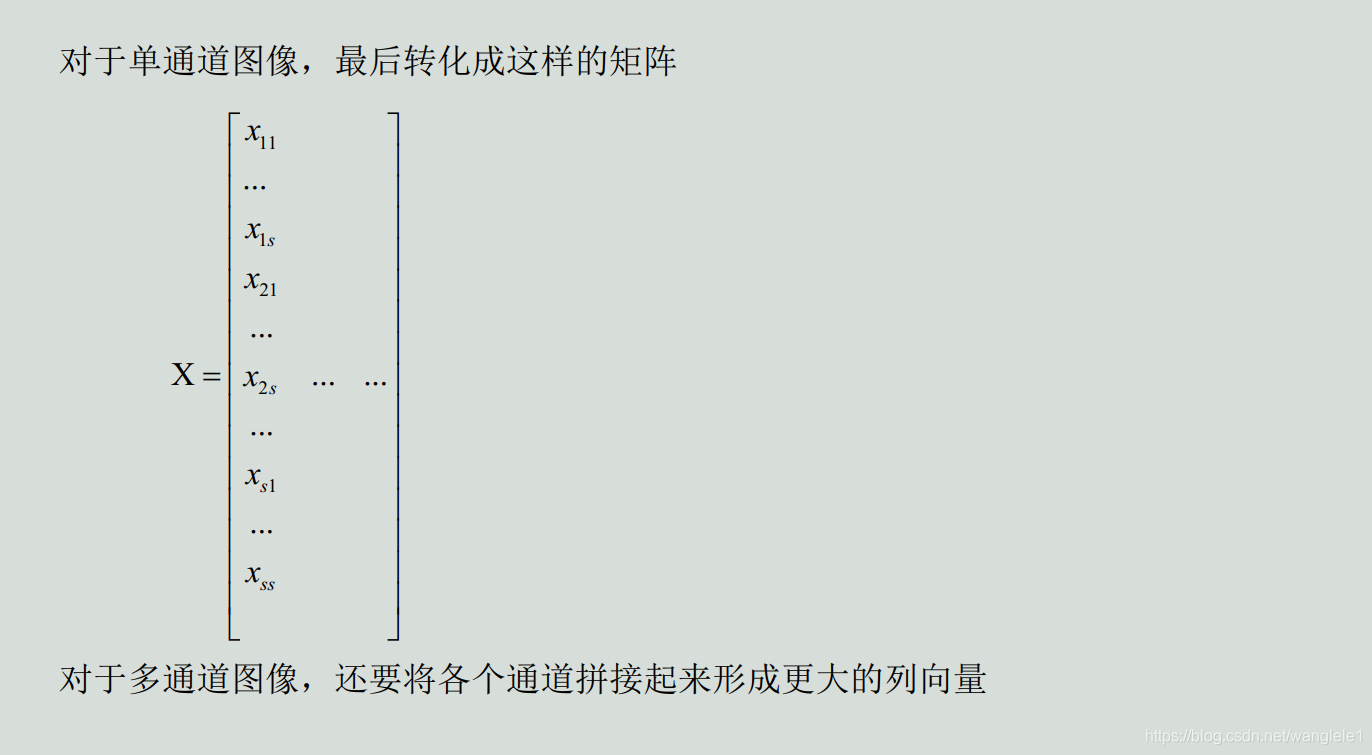

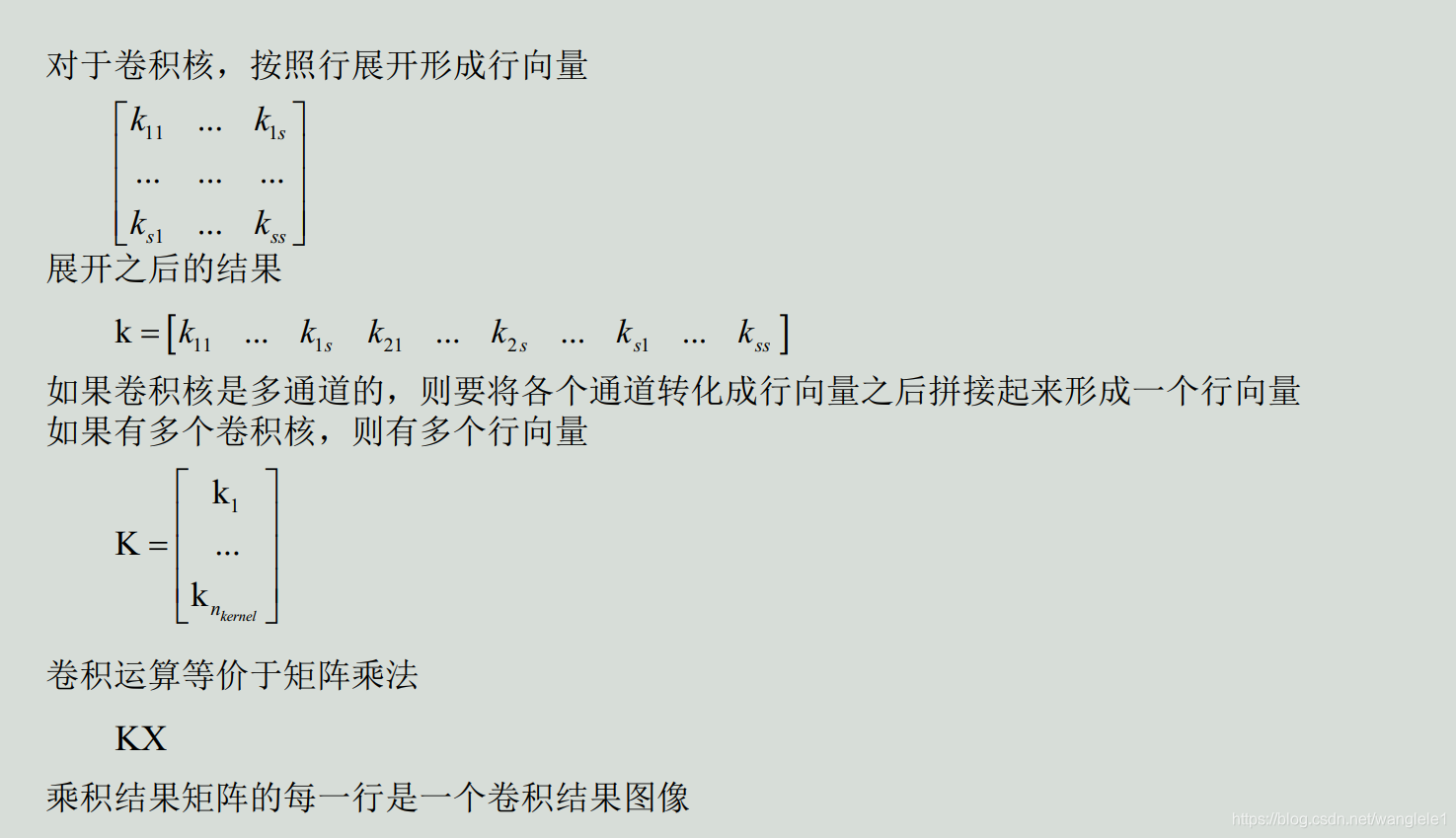

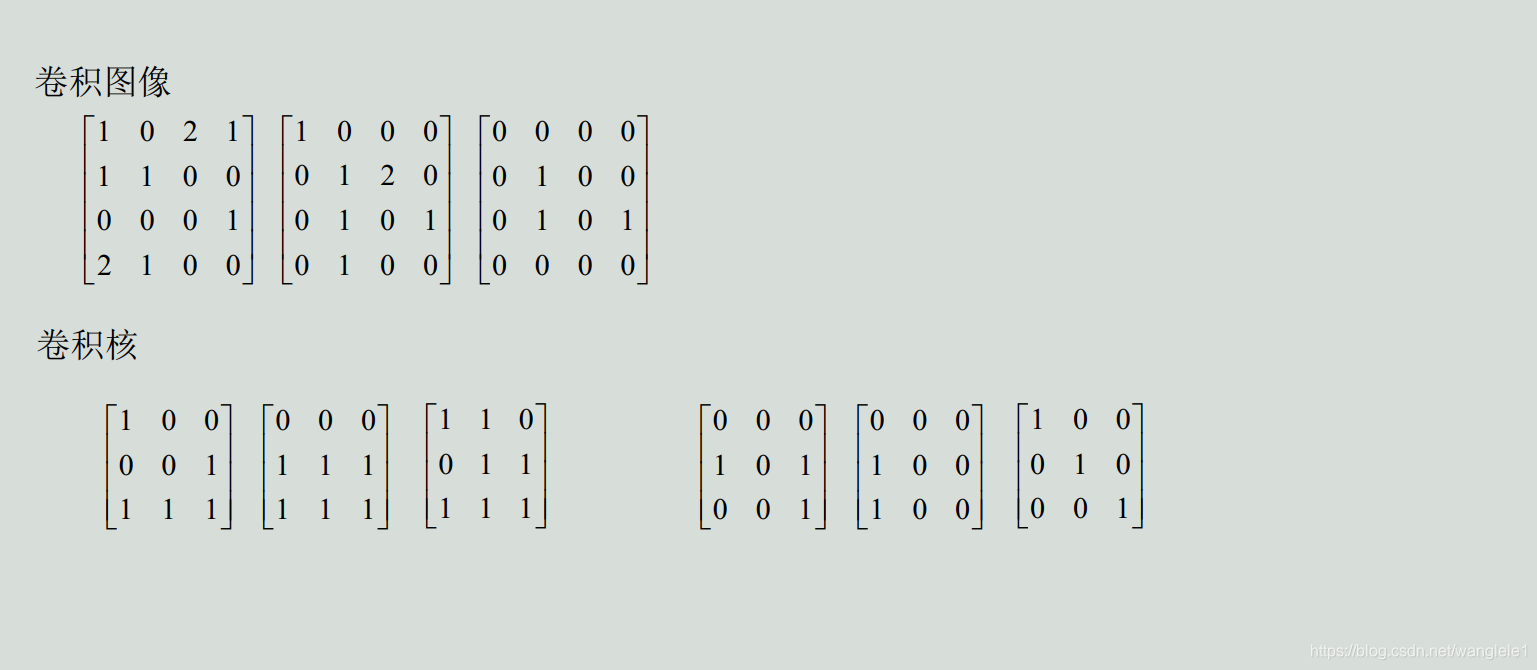

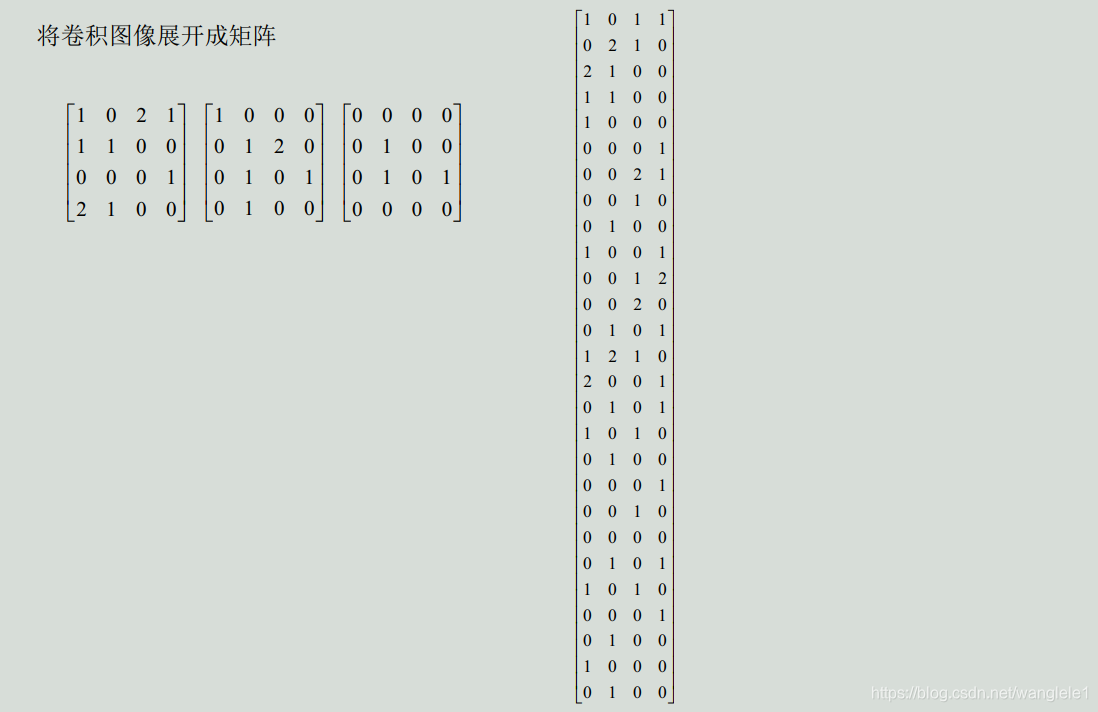

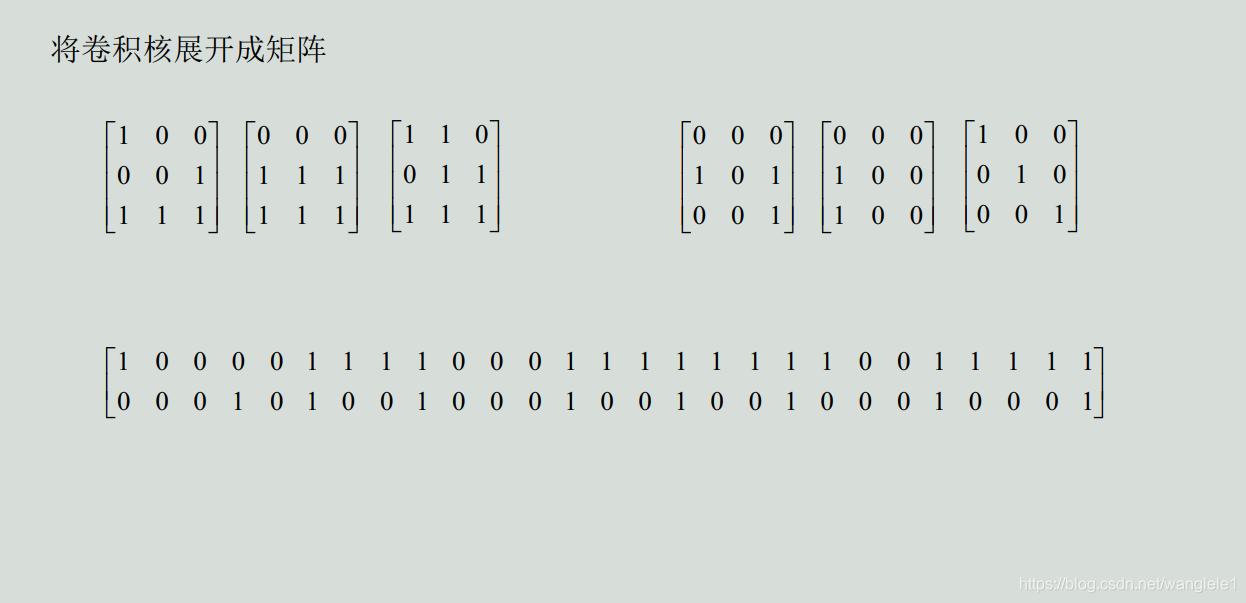

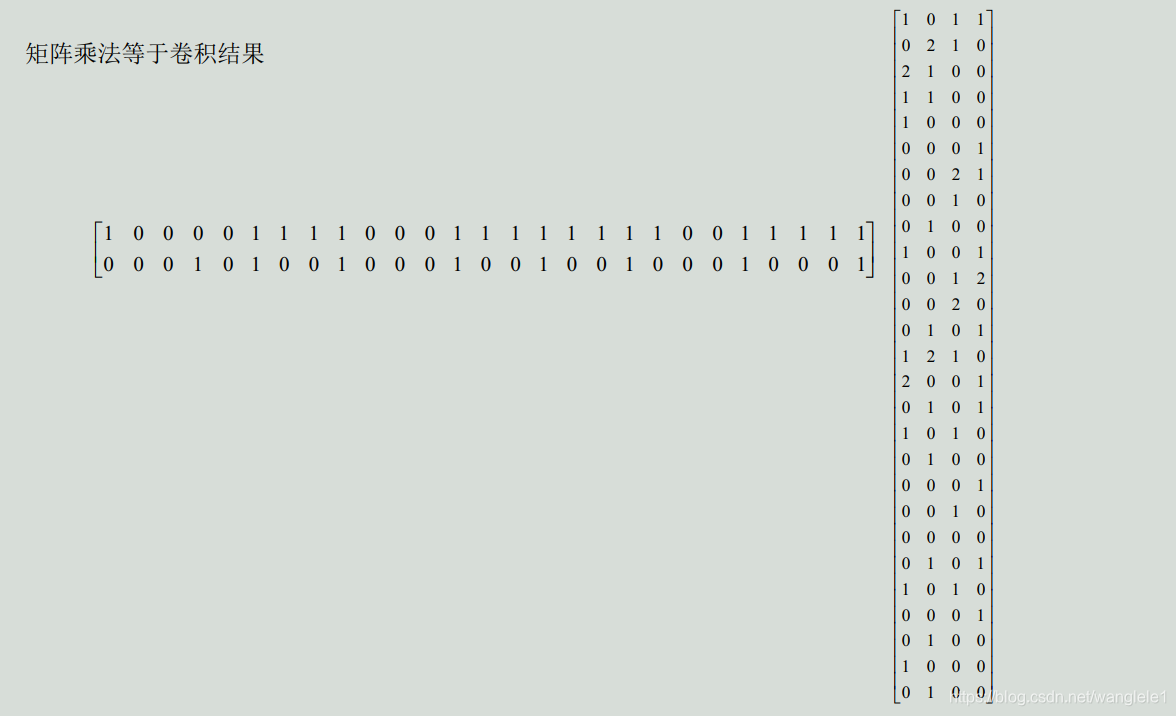

1,卷积层的改进

2,池化层的改进

2,池化层的改进

L-P池化, 混合池化, 随机池化, 以及Spatial pyramid pooling(简称SPP)

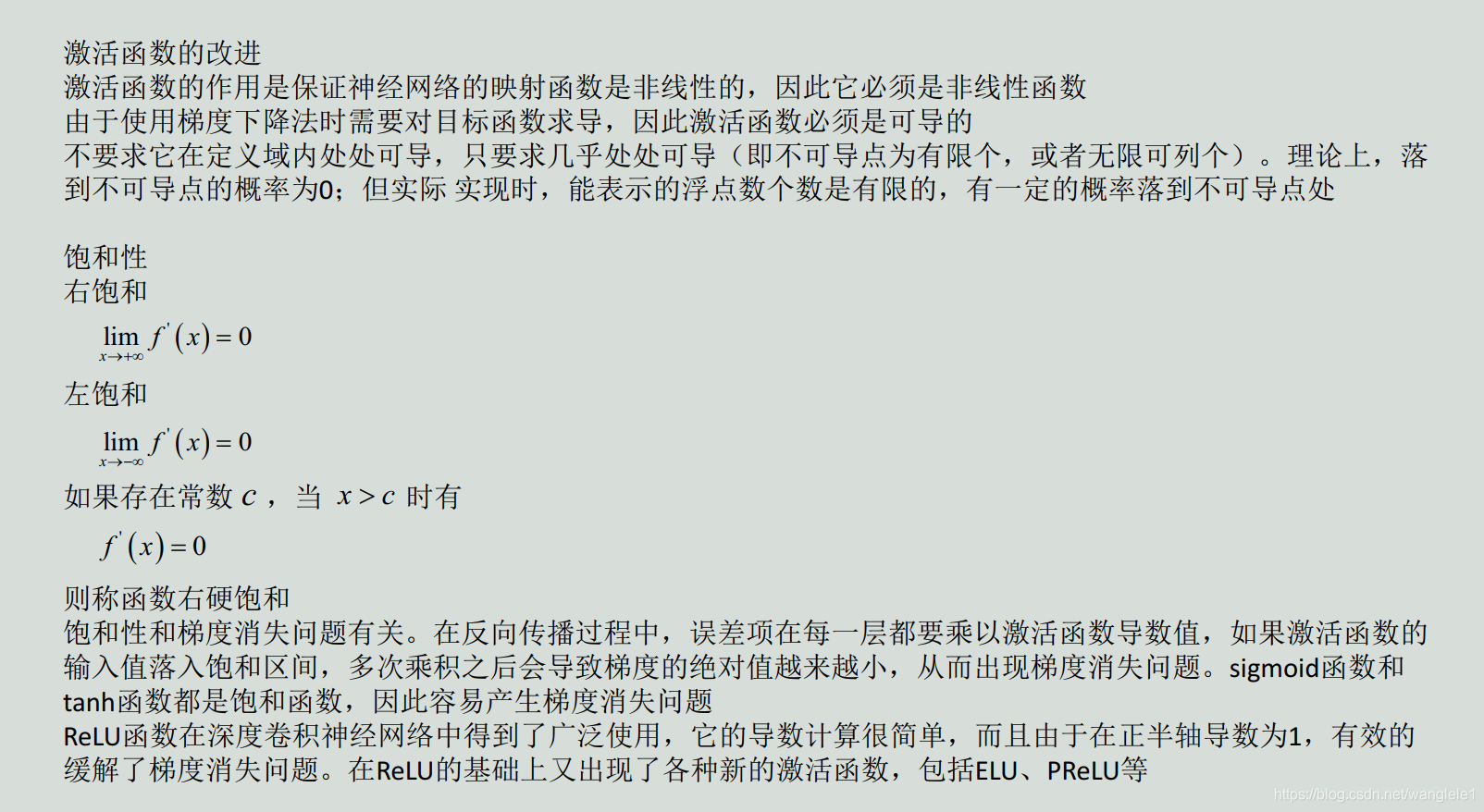

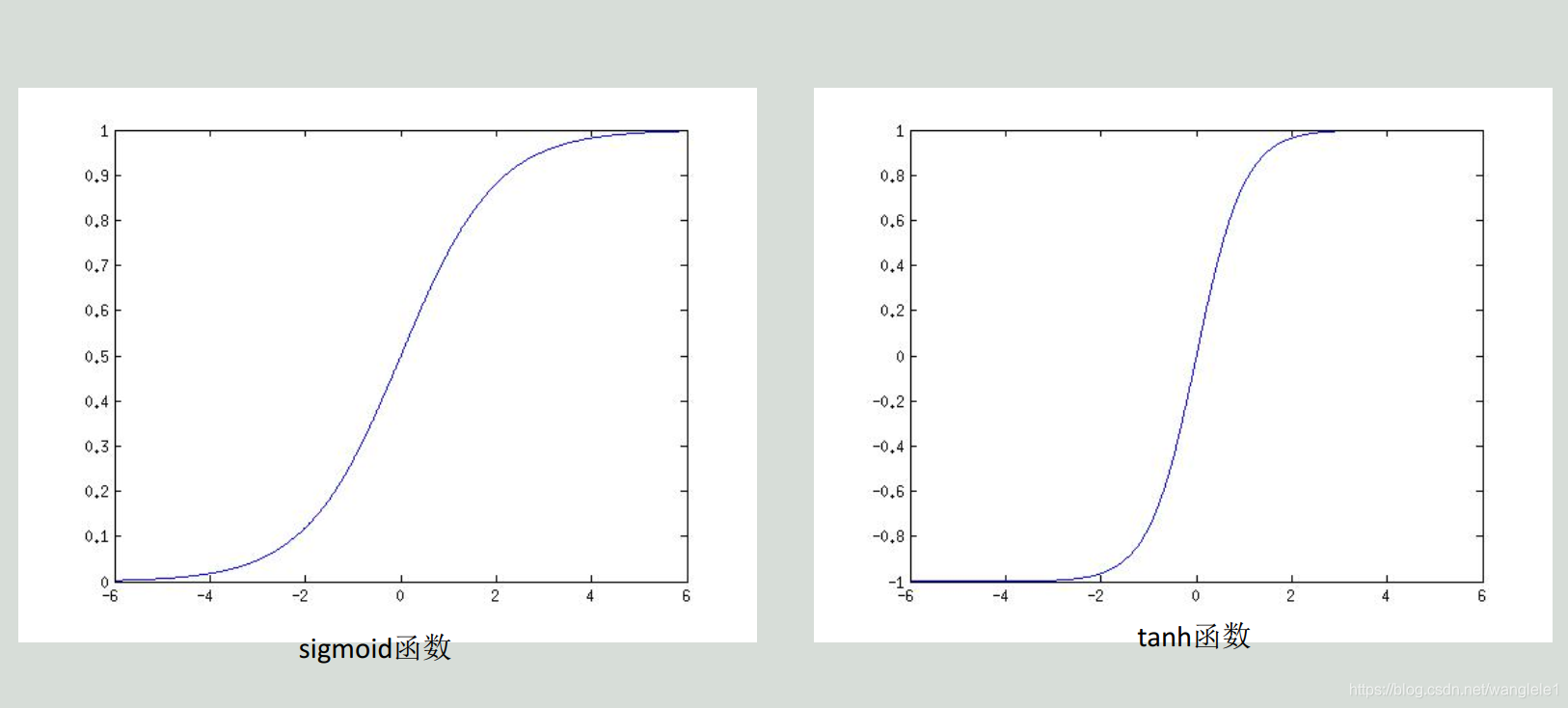

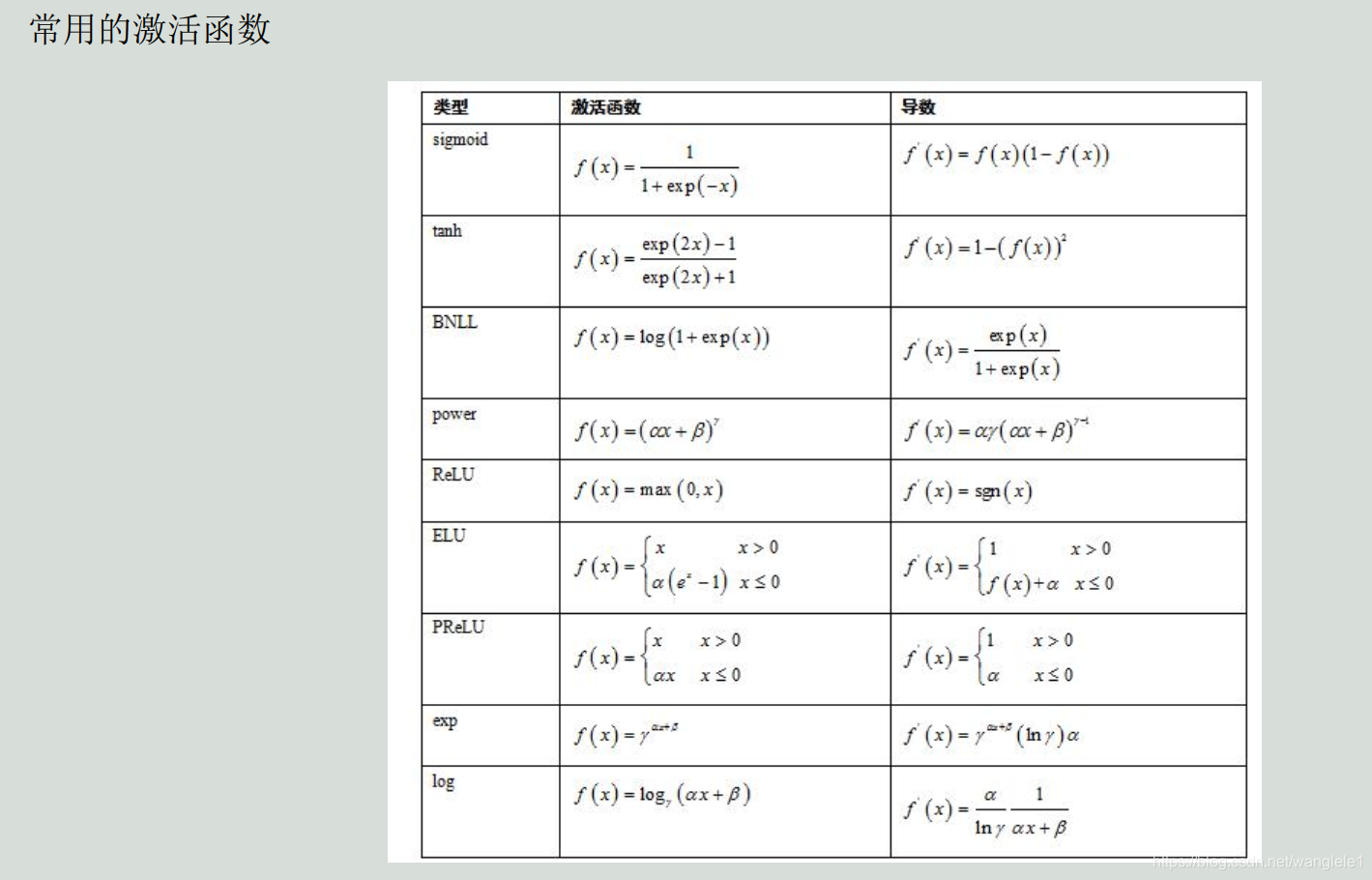

3,激活函数的改进

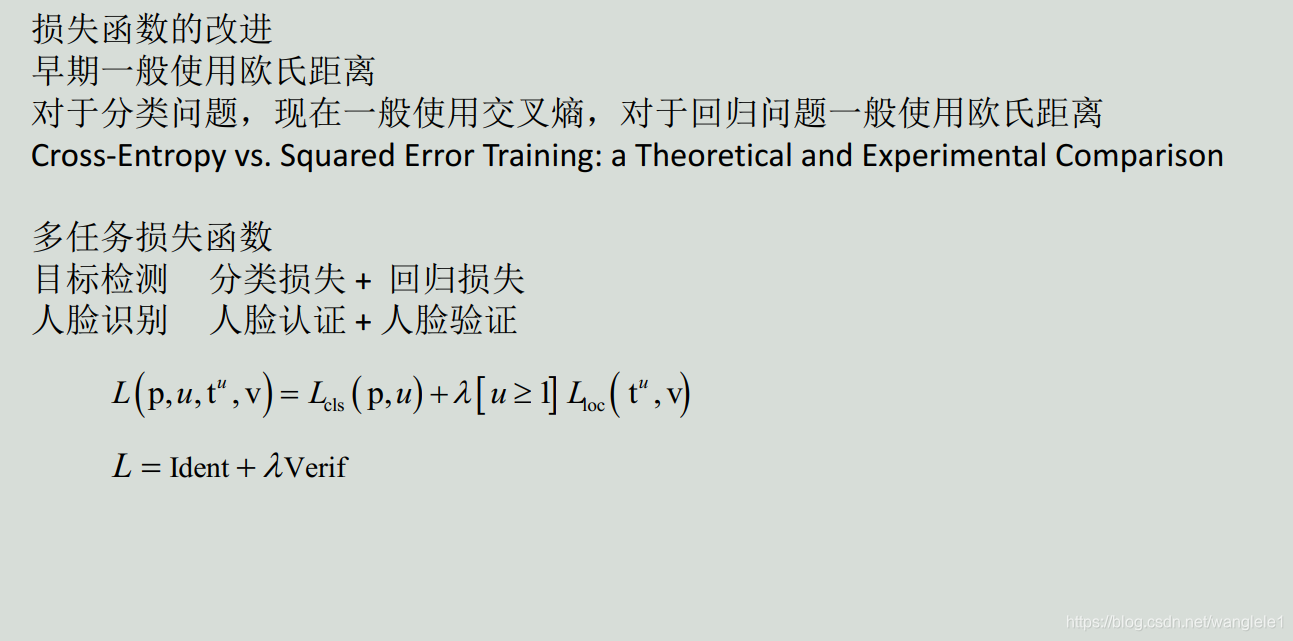

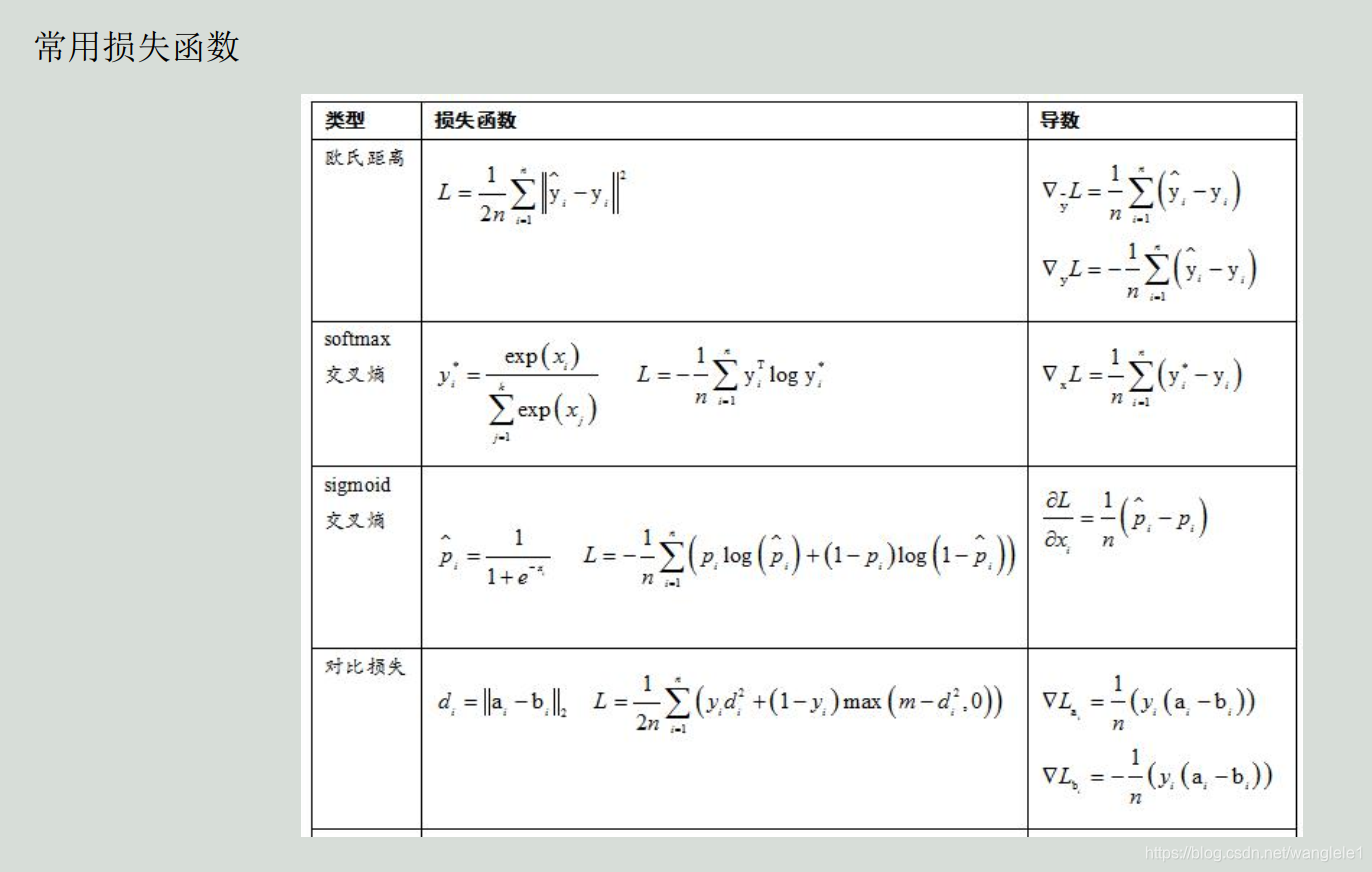

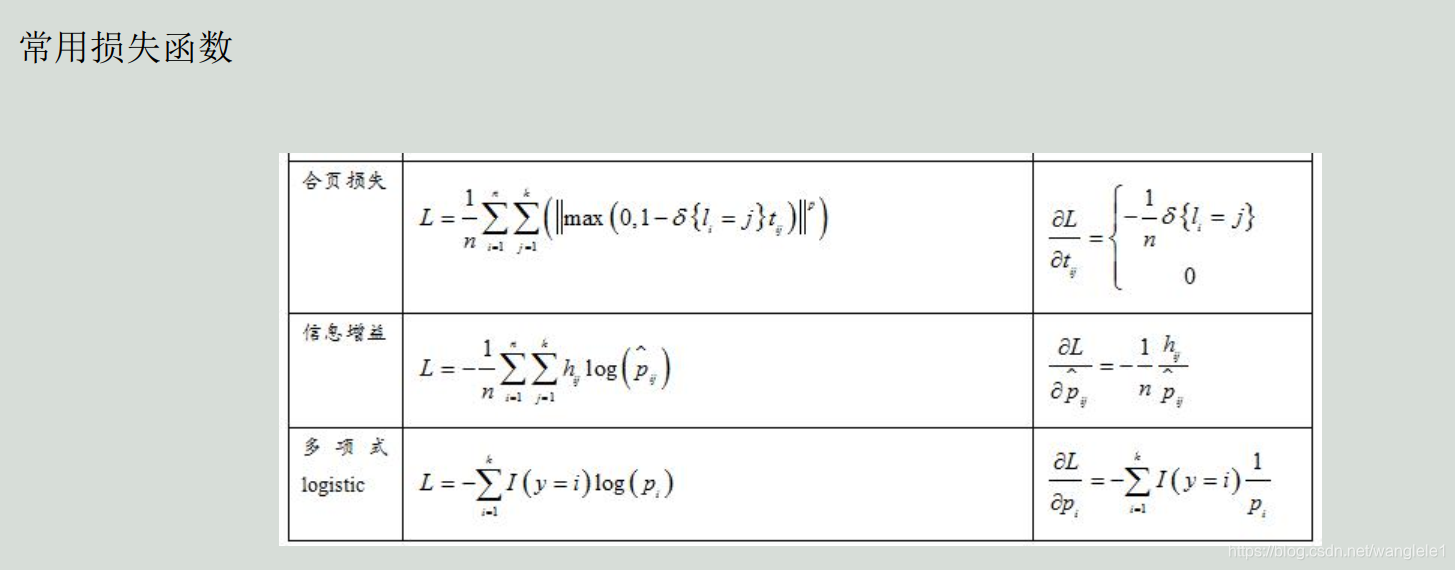

4,损失函数的改进

**

**

三,网络结构改进

**

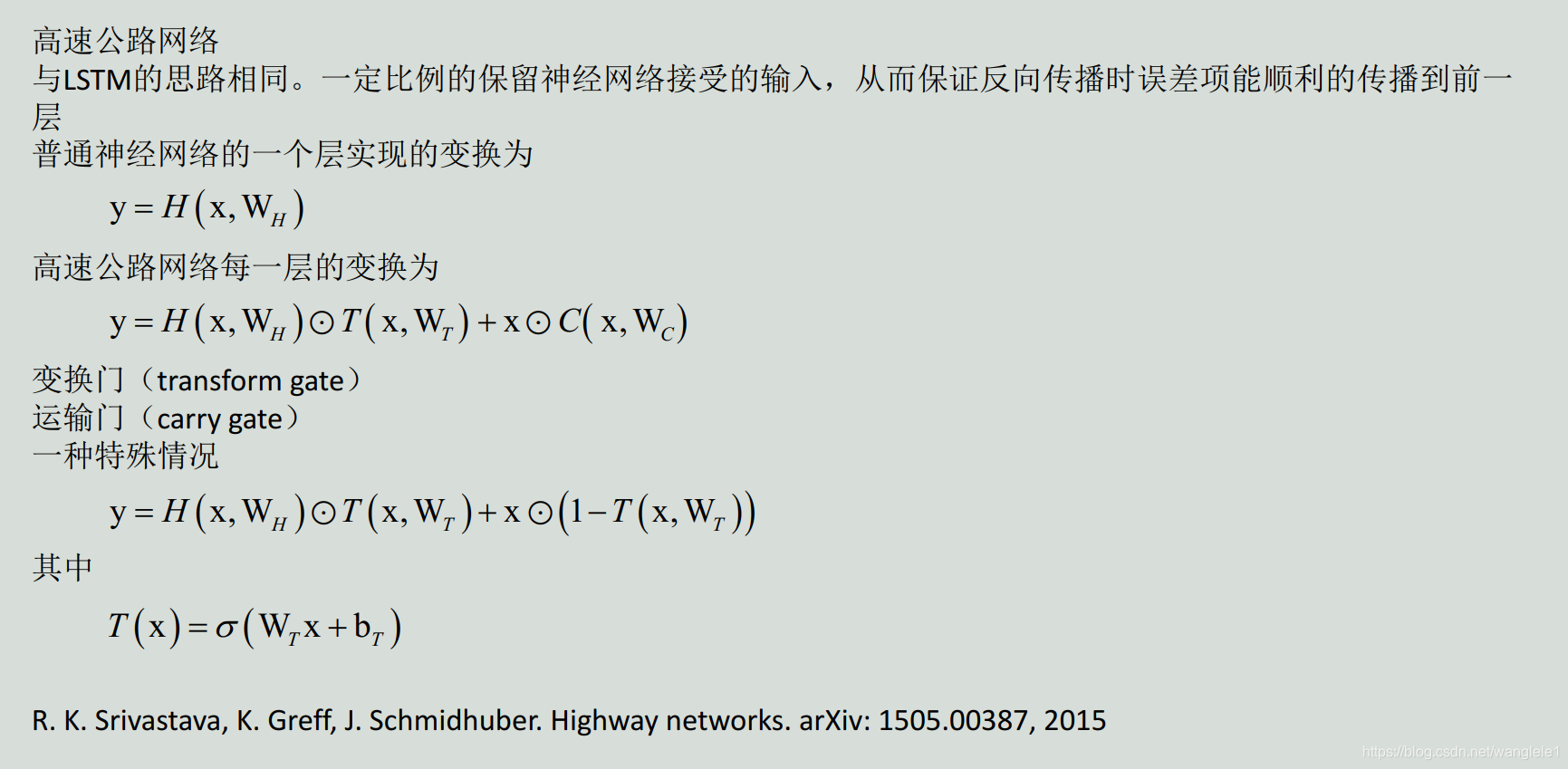

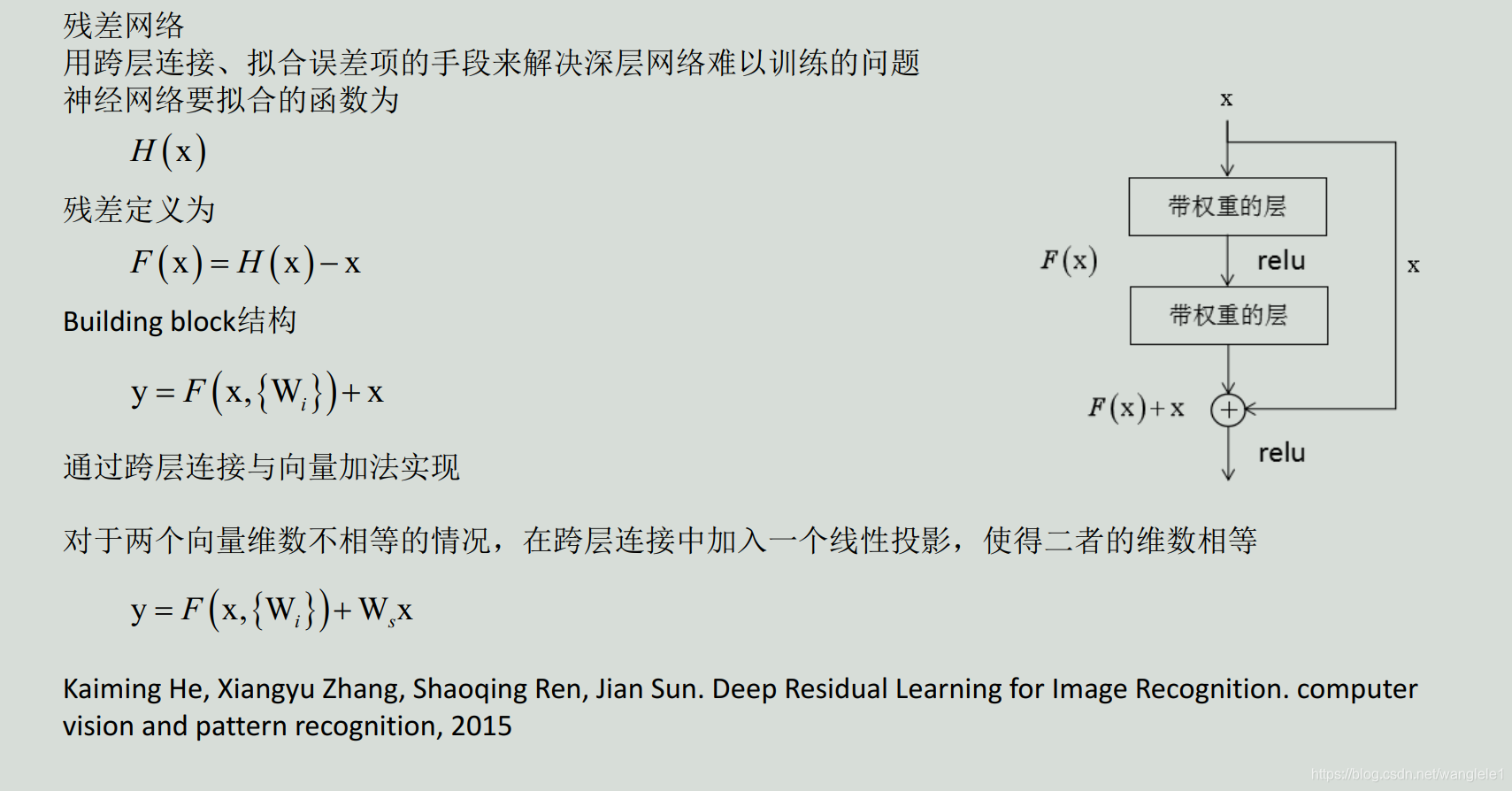

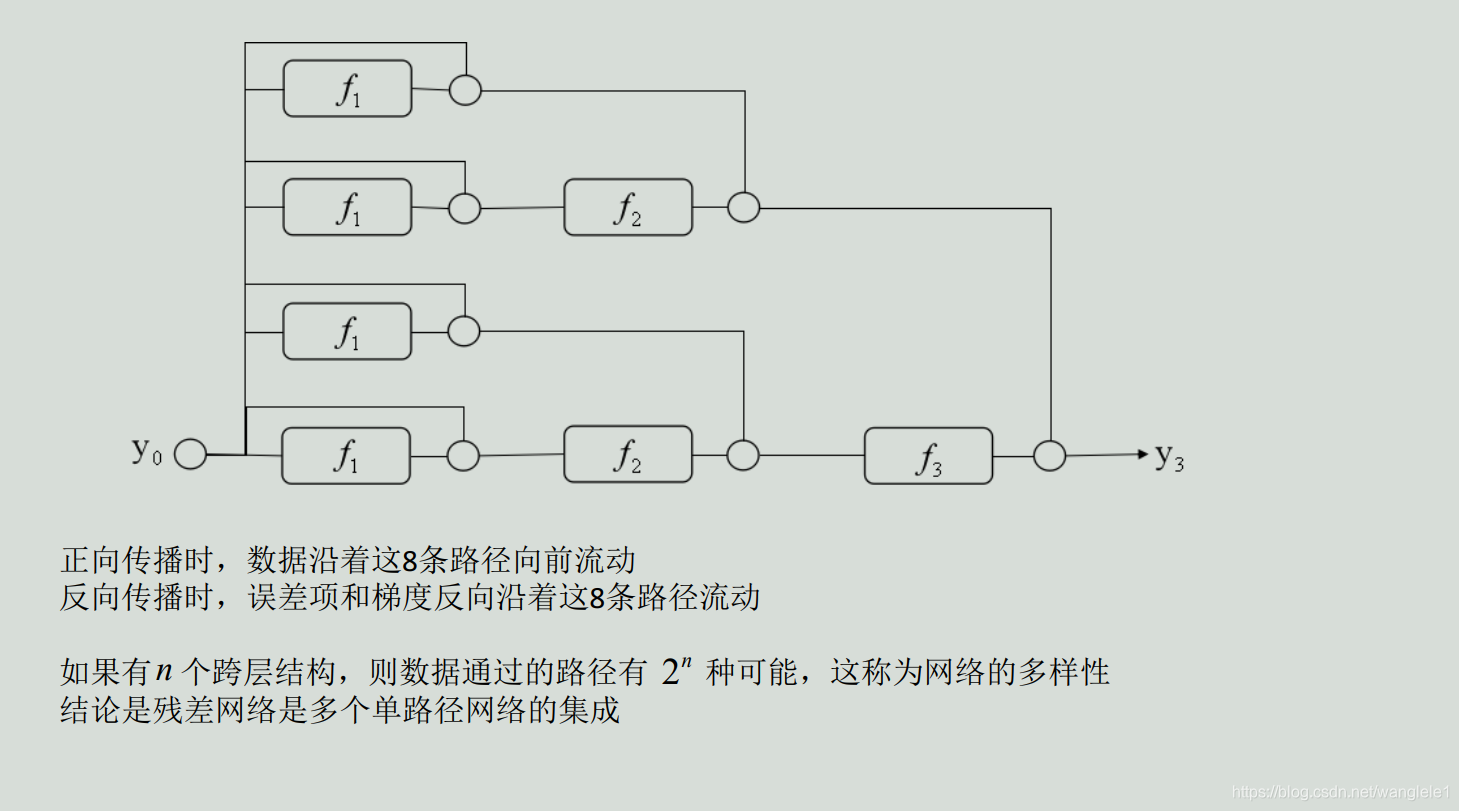

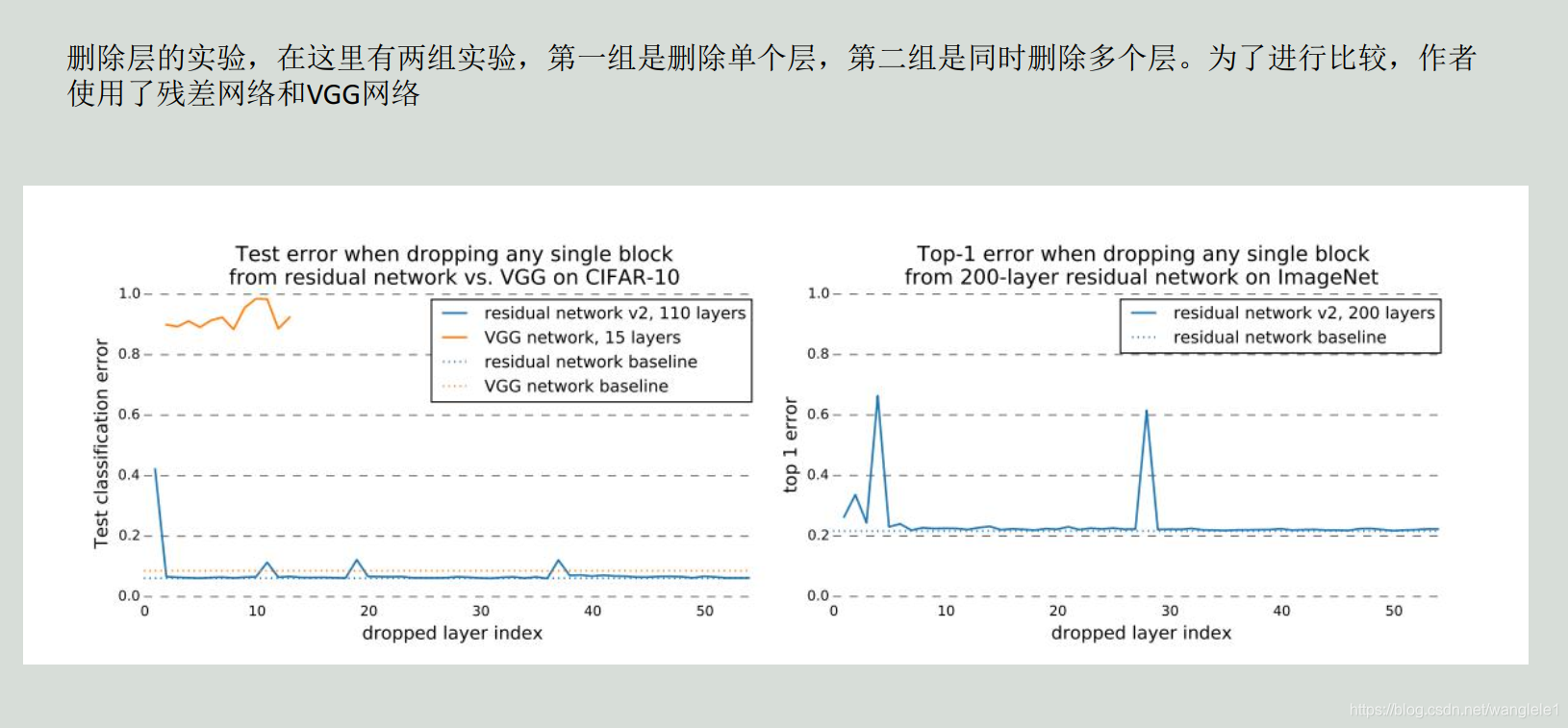

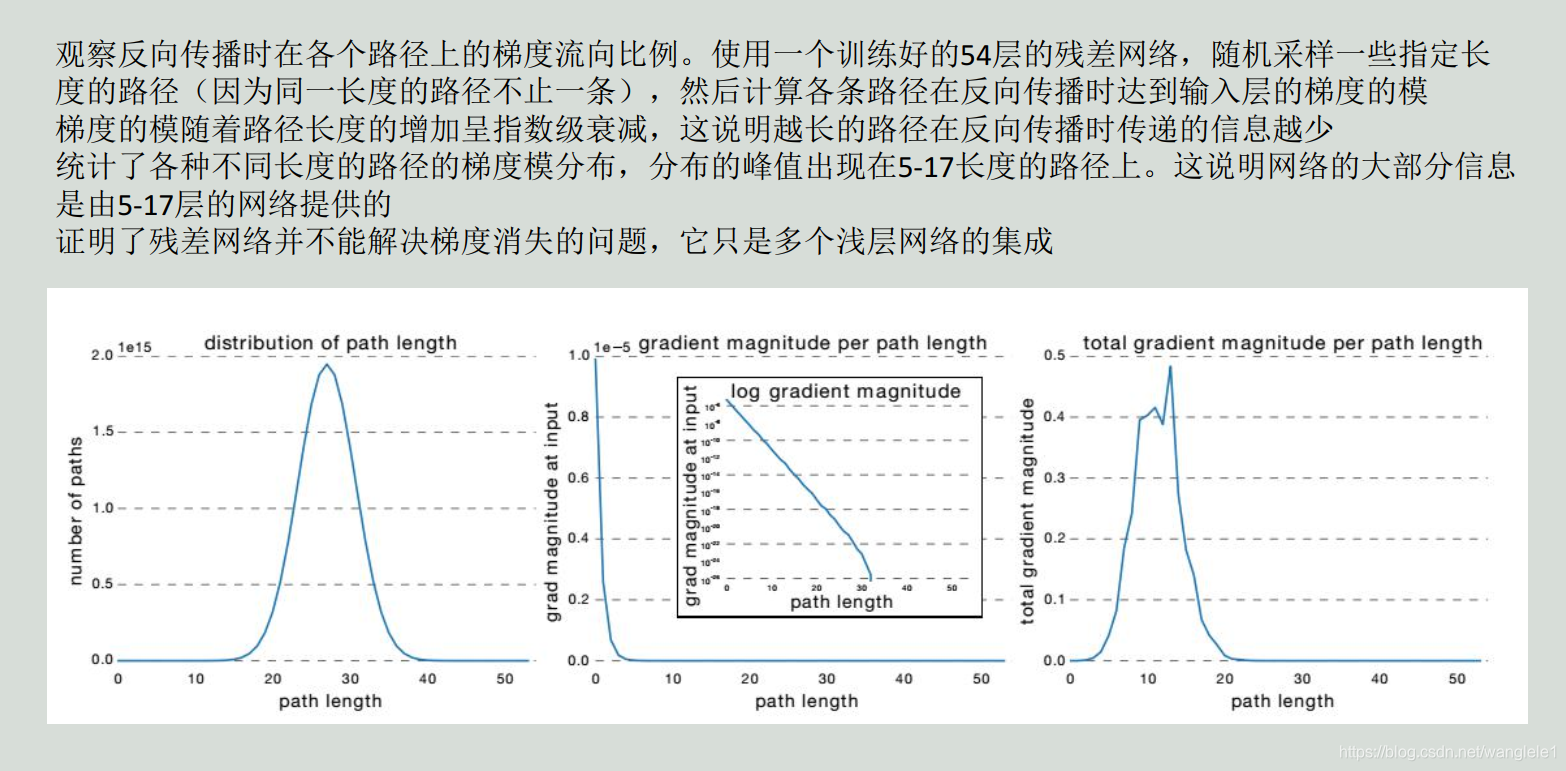

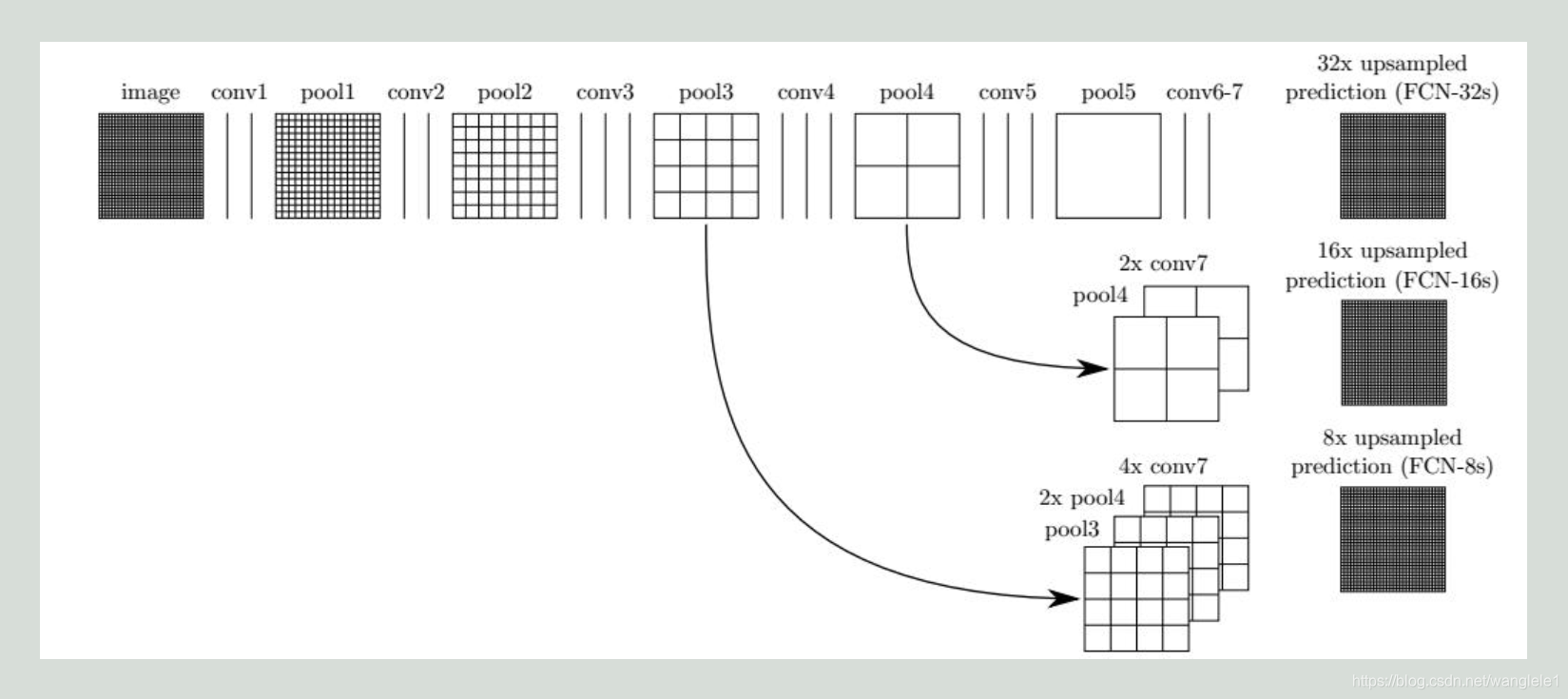

1,跨层连接

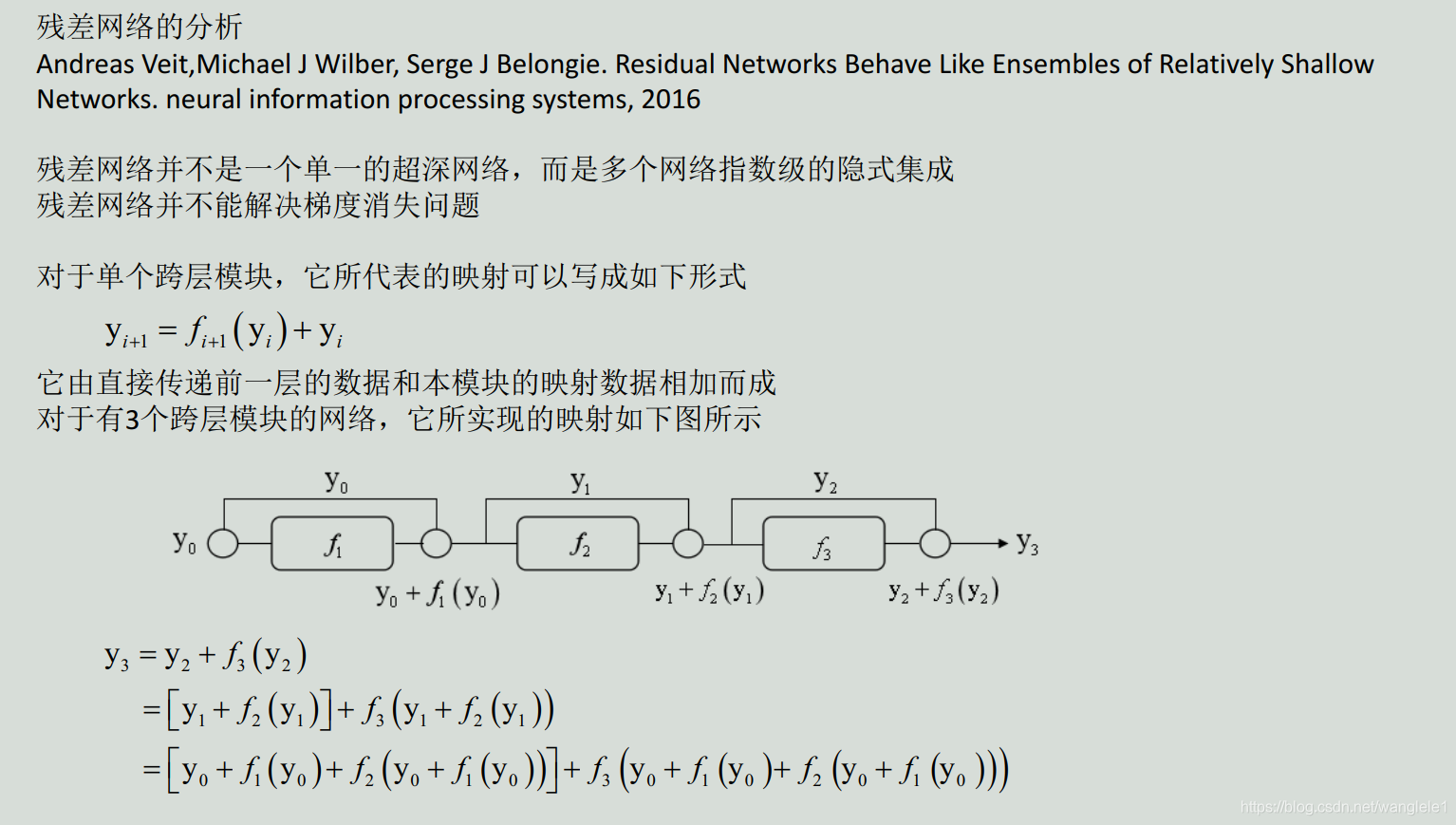

第三组实验是对网络的结构进行变动, 调整层的顺序。 在实验中, 作者打乱某些层的顺序, 这样会影响一部分路径。 具体做法是, 随机的交换多对层的位置, 这些层接受的输入和产生的输出数据尺寸相同。

第三组实验是对网络的结构进行变动, 调整层的顺序。 在实验中, 作者打乱某些层的顺序, 这样会影响一部分路径。 具体做法是, 随机的交换多对层的位置, 这些层接受的输入和产生的输出数据尺寸相同。

但是作者的这种解释有些牵强。 普通意义上的集成学习算法, 其各个弱学习器之间是相互独立的, 而这里的各个网络共享了一些层, 极端情况下, 除了一层不同之外, 另外的层都相同。 另外, 这些网络是同时训练出来的, 而且使用了相同的样本

但是作者的这种解释有些牵强。 普通意义上的集成学习算法, 其各个弱学习器之间是相互独立的, 而这里的各个网络共享了一些层, 极端情况下, 除了一层不同之外, 另外的层都相同。 另外, 这些网络是同时训练出来的, 而且使用了相同的样本

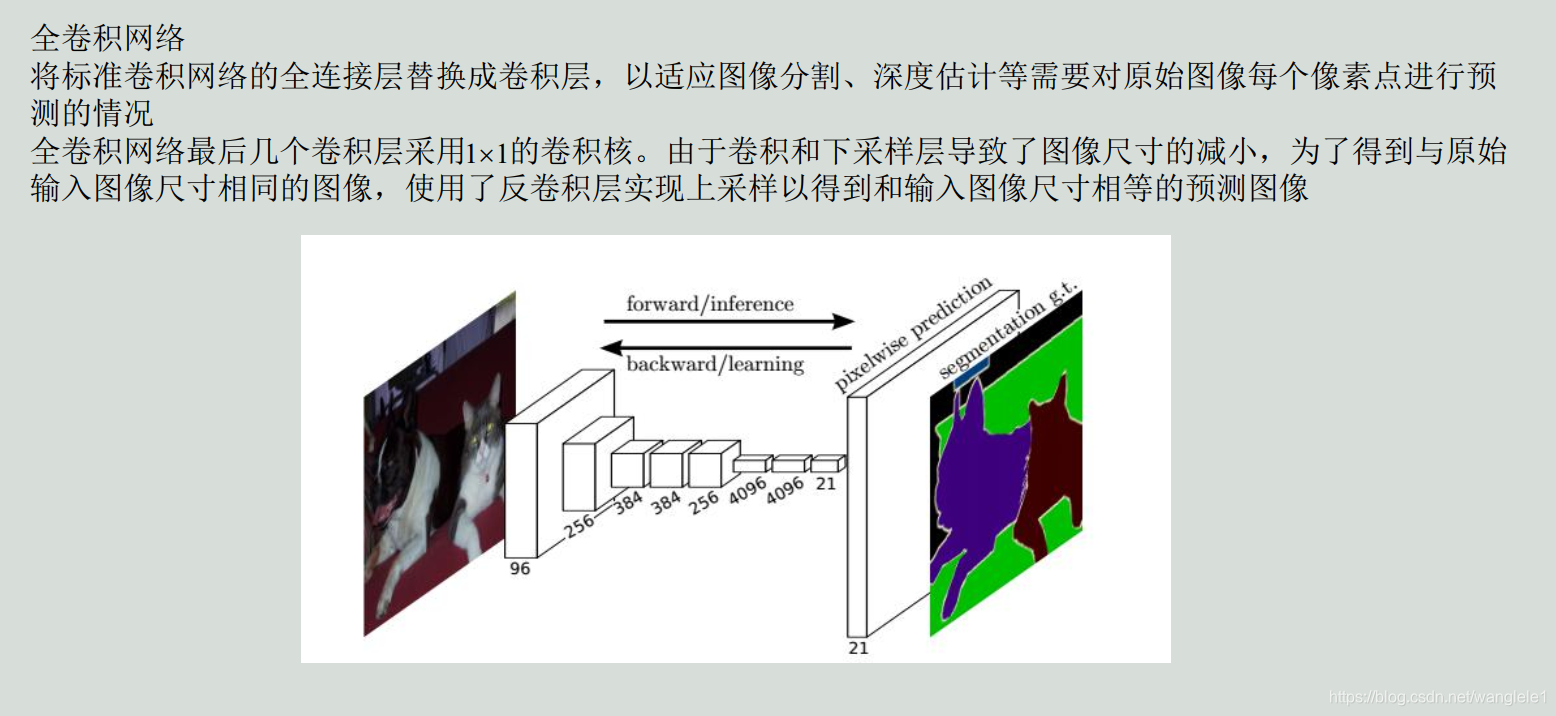

本文探讨了深度学习网络面临的主要挑战,如梯度消失和退化问题,并提出了相应的改进策略,包括卷积层和池化层的创新,激活与损失函数的优化,以及网络结构的革新,如跨层连接等。

本文探讨了深度学习网络面临的主要挑战,如梯度消失和退化问题,并提出了相应的改进策略,包括卷积层和池化层的创新,激活与损失函数的优化,以及网络结构的革新,如跨层连接等。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?