大语言模型原理与工程实践:大语言模型的缩放定律

关键词:大语言模型、缩放定律、模型性能、计算复杂度、参数优化、工程实践、未来趋势

1. 背景介绍

近年来,大语言模型(Large Language Models,LLMs)在自然语言处理领域取得了突破性进展。从GPT-3到ChatGPT,再到最新的GPT-4,这些模型展现出惊人的语言理解和生成能力,引发了学术界和工业界的广泛关注。在这一系列的发展中,一个引人注目的现象逐渐浮现:随着模型规模的增大,其性能似乎遵循某种可预测的规律。这种规律被称为"缩放定律"(Scaling Laws),它不仅揭示了大语言模型性能提升的内在机制,也为未来模型的设计和优化提供了重要指导。

本文将深入探讨大语言模型的缩放定律,从理论基础到实践应用,全面分析这一重要概念对人工智能领域的深远影响。我们将剖析缩放定律的核心原理,探讨其在模型设计、训练和应用中的关键作用,并展望未来大语言模型的发展趋势。

2. 核心概念与联系

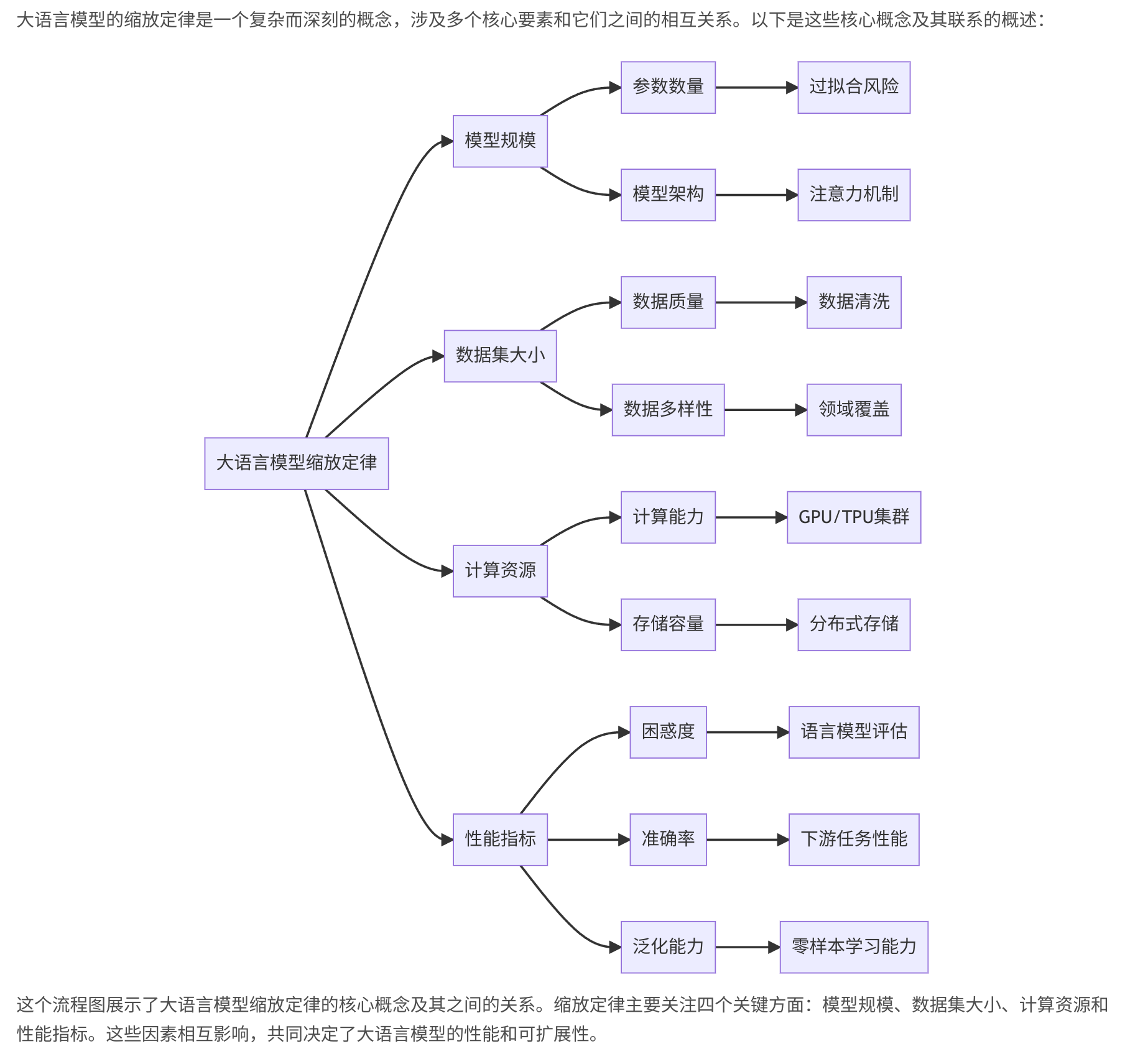

大语言模型的缩放定律是一个复杂而深刻的概念,涉及多个核心要素和它们之间的相互关系。以下是这些核心概念及其联系的概述:

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?