【NLP】天池新闻文本分类(五)——基于深度学习的文本分类2

前言

本文是NLP之新闻文本分类挑战赛(赛题链接)。

的第五篇:基于深度学习得文本分类2。上一篇是基于深度学习的文本分类1,介绍了基于FastText的文本分类。本篇将介绍Word2Vec的文本表示方法、使用TextCNN、TextRNN进行文本分类、以及使用HAN网络结构进行文本分类。

Word2Vec文本法

Word2Vec词向量

word2vec模型背后的基本思想是对出现在上下文环境里的词进行预测。对于每一条输入文本,我们选取一个上下文窗口和一个中心词,并基于这个中心词去预测窗口里其他词出现的概率。因此,word2vec模型可以方便地从新增语料中学习到新增词的向量表达,是一种高效的在线学习算法(online learning)。

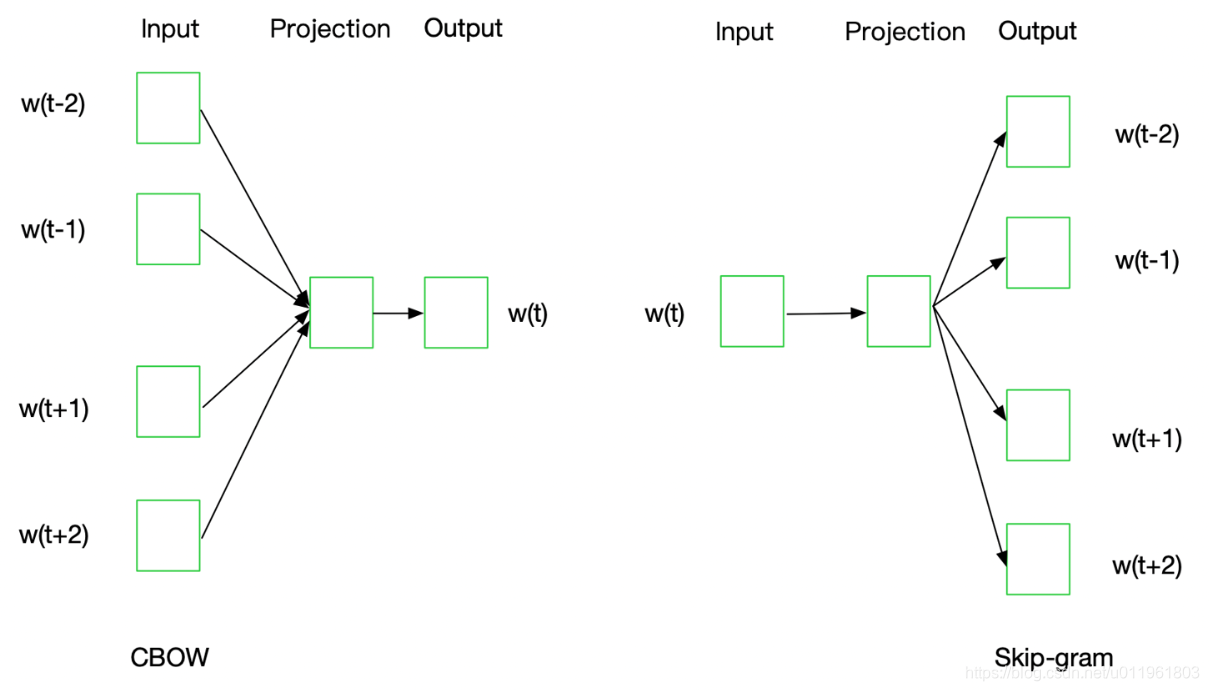

word2vec的主要思路:通过单词和上下文彼此预测,对应的两个算法分别为:

- Skip-grams (SG):预测上下文

- Continuous Bag of Words (CBOW):预测目标单词

另外提出两种更加高效的训练方法:

- Hierarchical softmax

- Negative sampling

1. Skip-grams原理和网络结构

Word2Vec模型中,主要有Skip-Gram和CBOW两种模型,从直观上理解,Skip-Gram是给定input word来预测上下文。而CBOW是给定上下文,来预测input word。

Word2Vec模型实际上分为了两个部分,第一部分为建立模型,第二部分是通过模型获取嵌入词向量。

Word2Ve

本文介绍了NLP中新闻文本分类的方法,包括Word2Vec的词向量表示,TextCNN、TextRNN的文本分类,以及HAN的层级注意力网络。详细阐述了Skip-grams和CBOW模型,以及TextCNN和TextRNN的网络结构和前向传播过程。

本文介绍了NLP中新闻文本分类的方法,包括Word2Vec的词向量表示,TextCNN、TextRNN的文本分类,以及HAN的层级注意力网络。详细阐述了Skip-grams和CBOW模型,以及TextCNN和TextRNN的网络结构和前向传播过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?