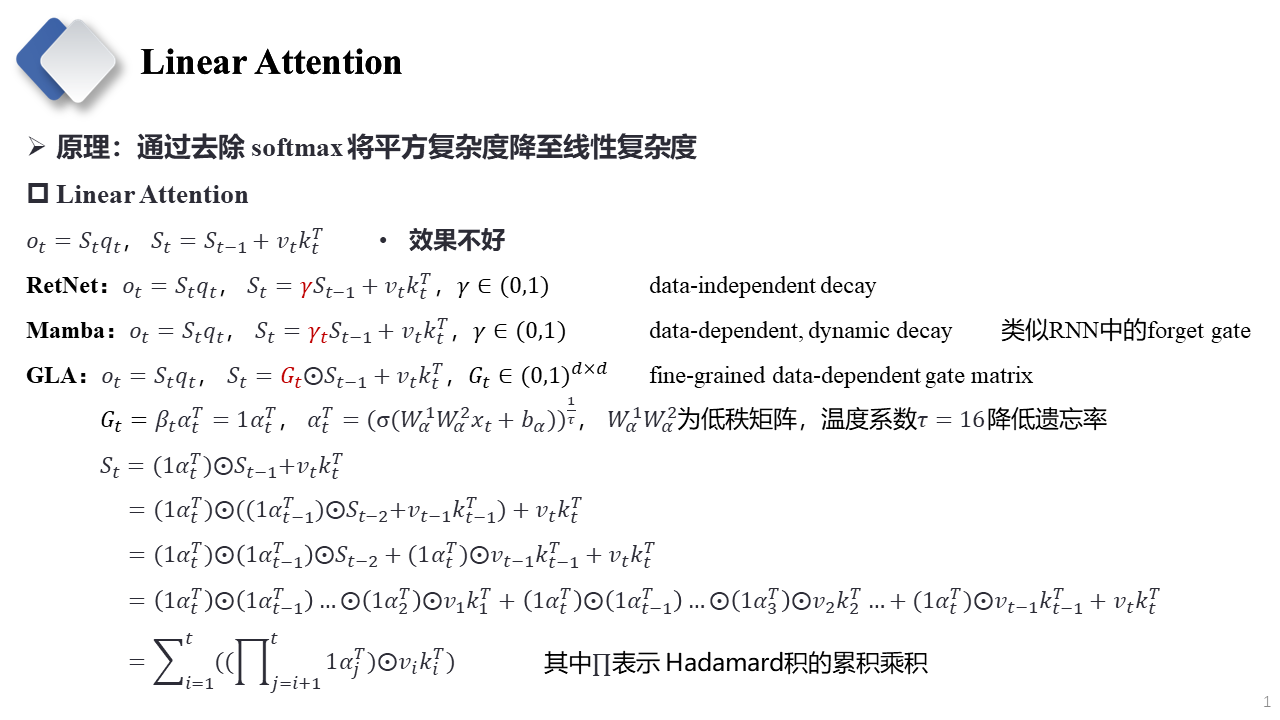

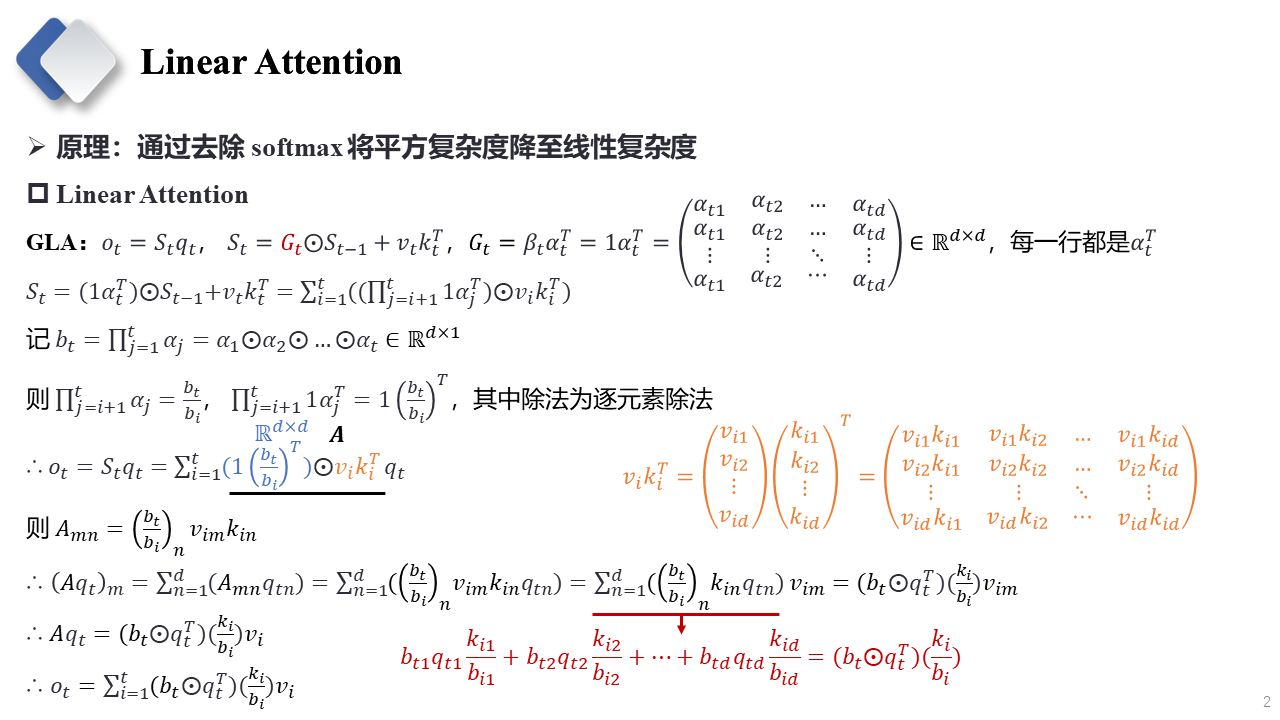

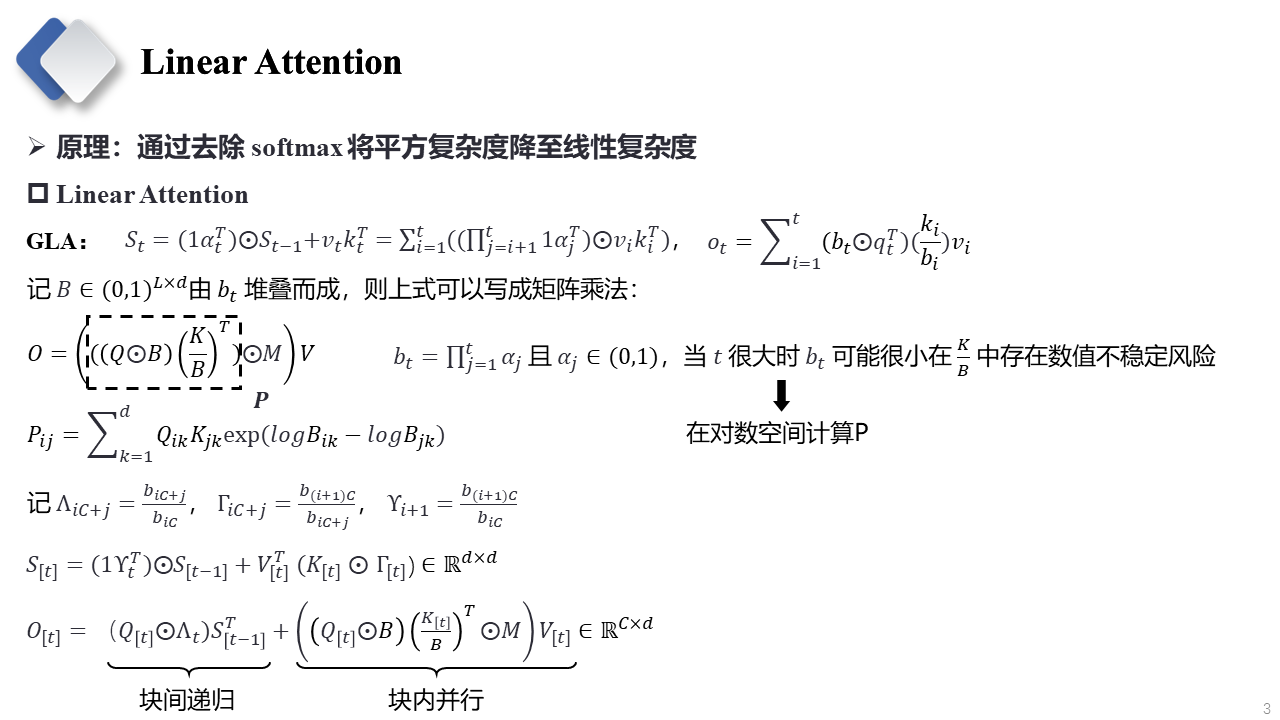

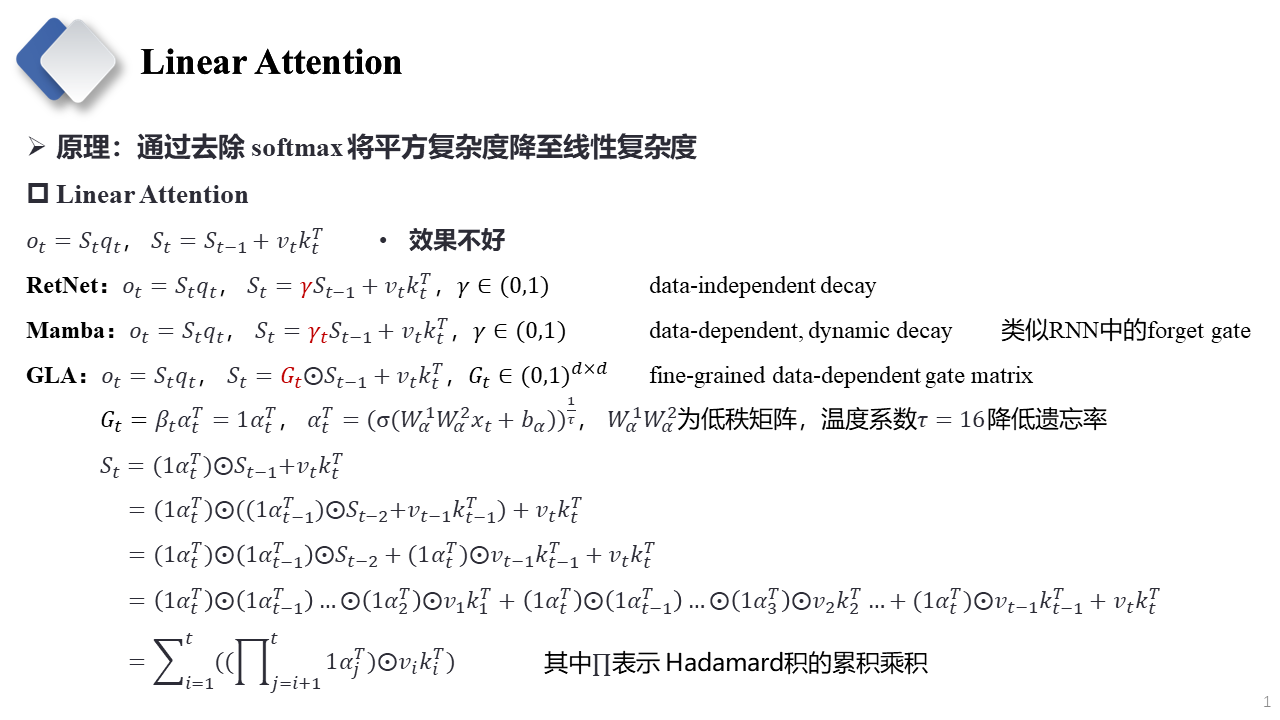

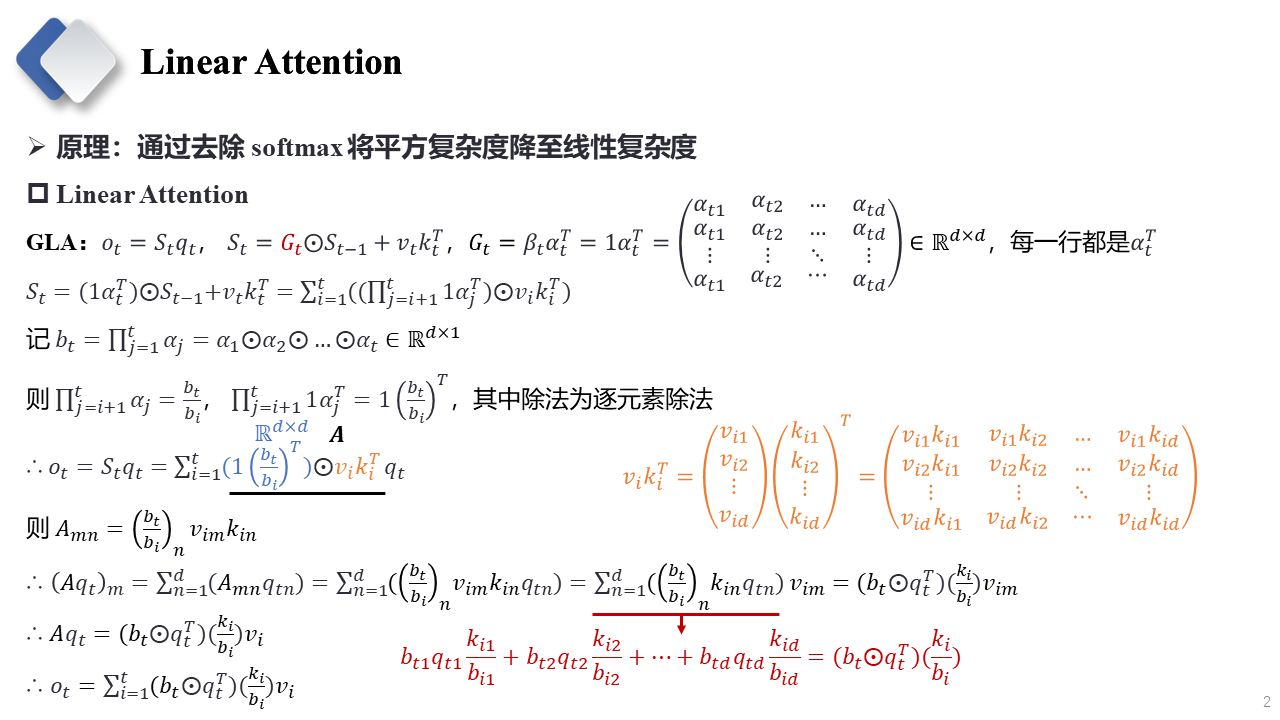

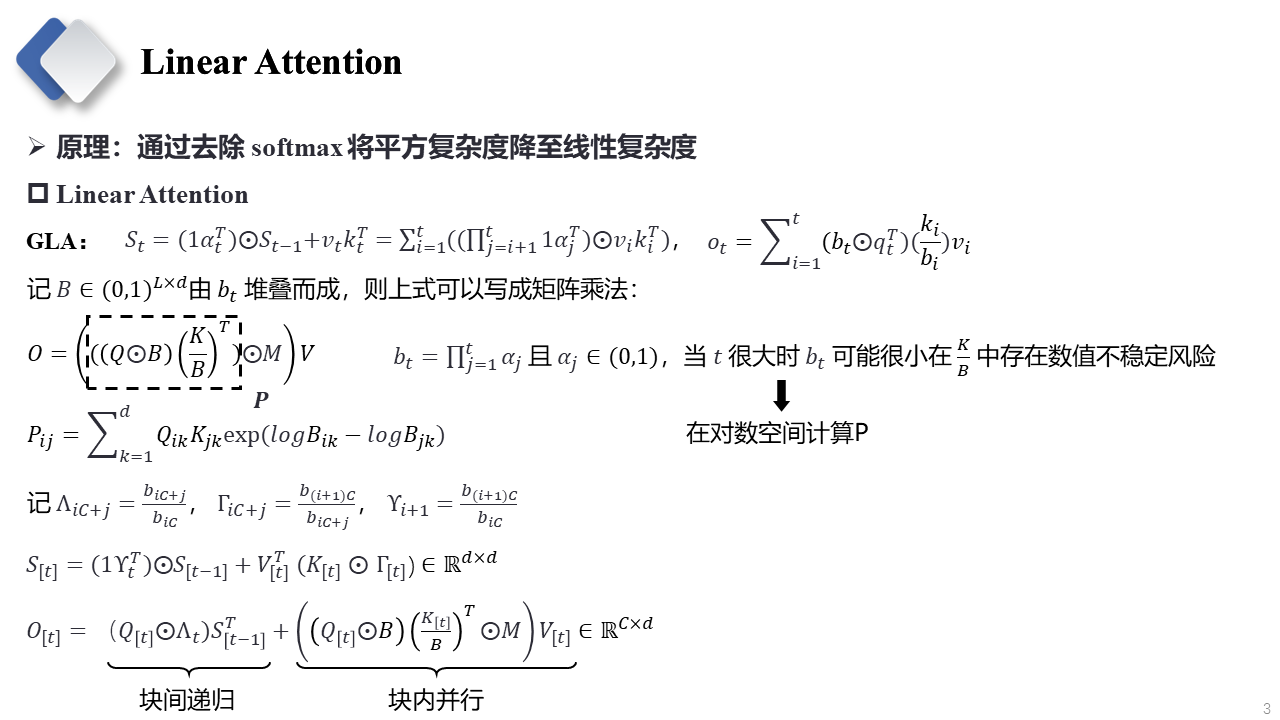

上一章《Linear Attention续集》简单介绍Linear Attention训练中的Memory-efficient和Hardware-efficient方法,这章主要介绍Gated Linear Attention(GLA)的原理。(本文仅供学习参考,禁止商用盗用,转载请注明出处)

上一章《Linear Attention续集》简单介绍Linear Attention训练中的Memory-efficient和Hardware-efficient方法,这章主要介绍Gated Linear Attention(GLA)的原理。(本文仅供学习参考,禁止商用盗用,转载请注明出处)

174

174

589

589

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?