文章目录

[新手专用]Windows快速本地部署DeepSeek

1. 安装ollama

1.1 下载ollama

1.1.1 方法一:ollama官网下载。

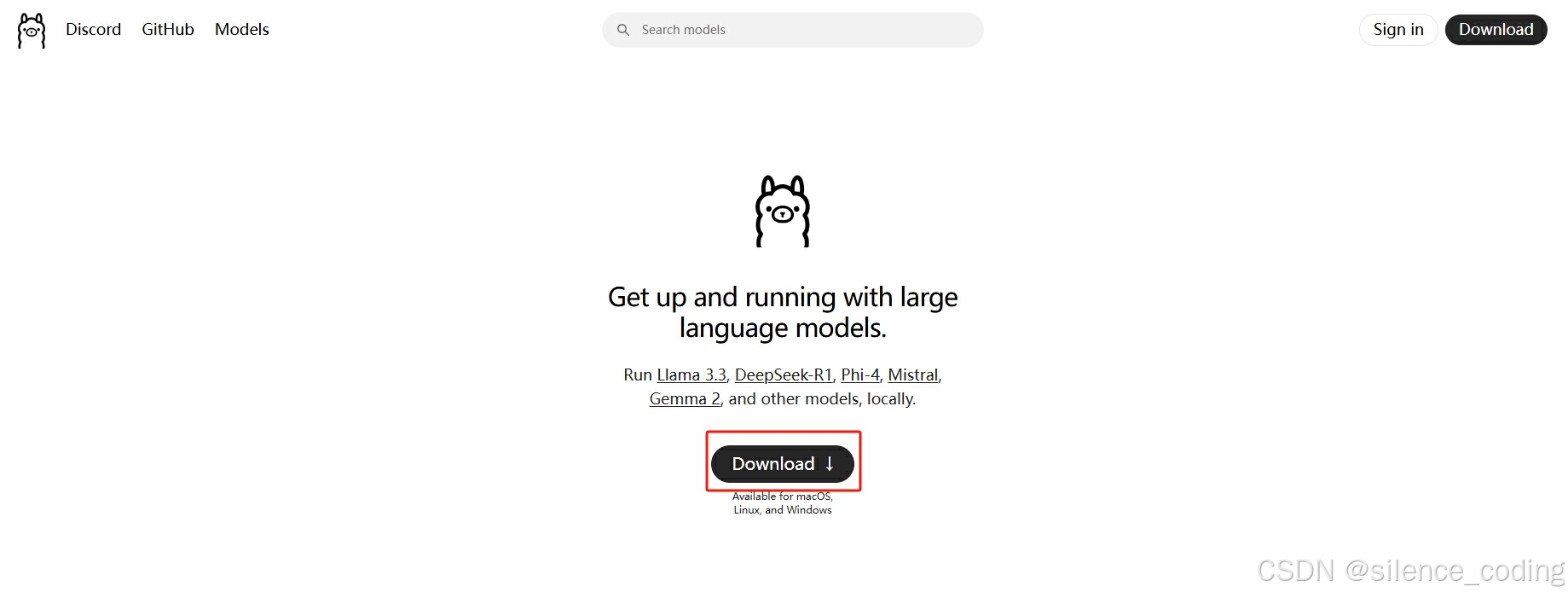

第一步:登录

ollama官方网址:https://ollama.com/,选中网页中间Download下载。

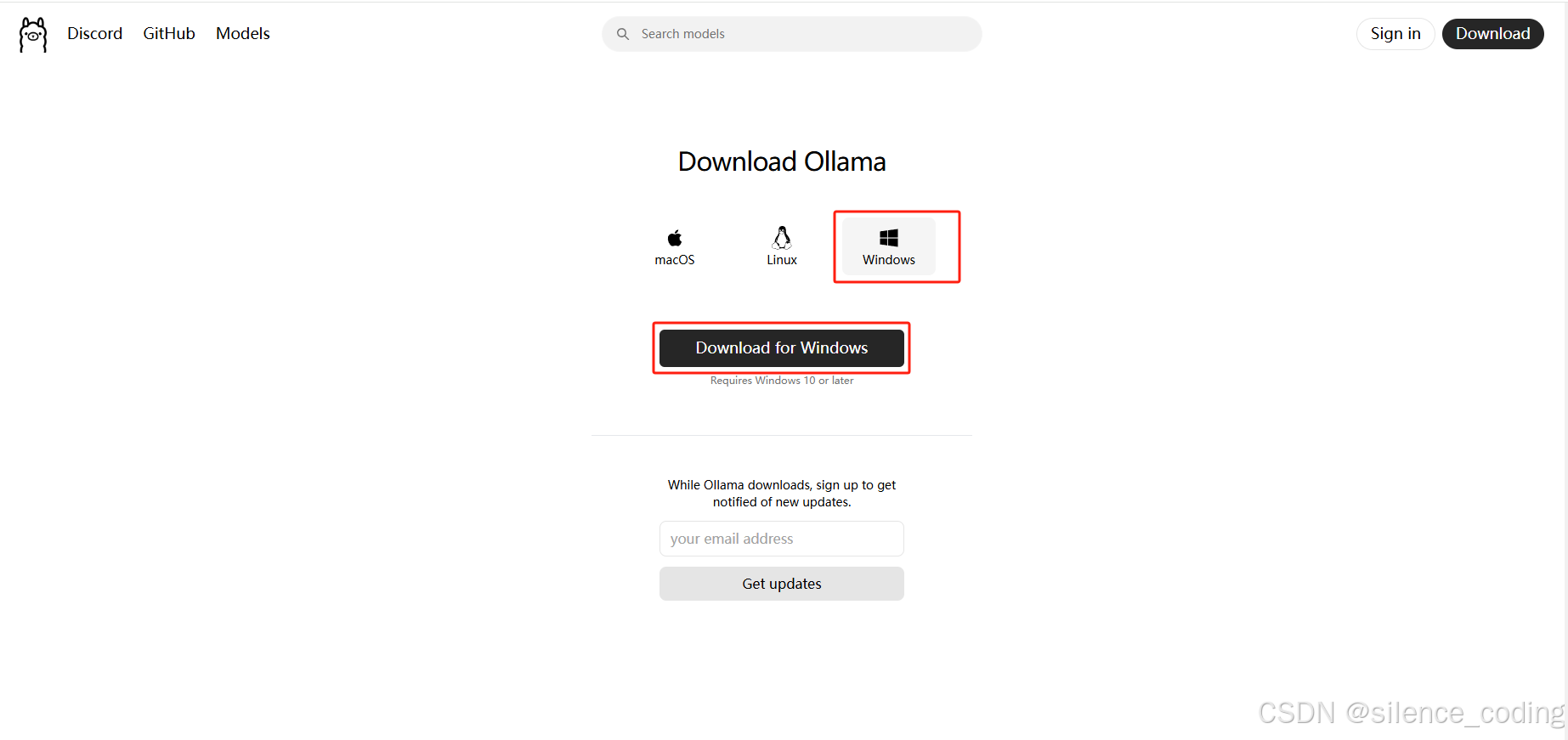

第二步:根据环境类型选择要下载的

ollama文件,本篇采用Windows进行本地部署,故选择Download for Windows。

1.1.2 方法二:Github下载ollama

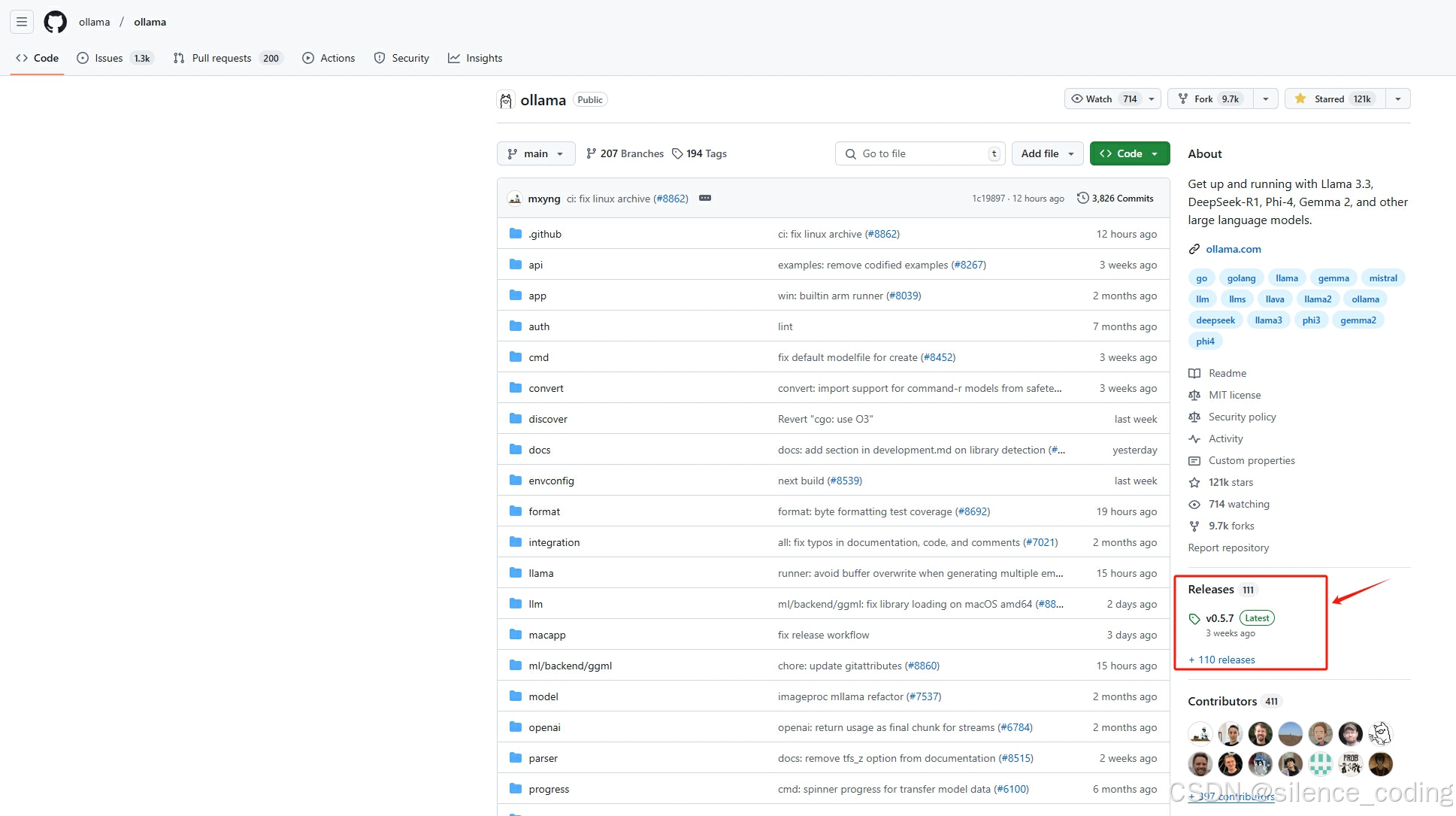

第一步:访问

ollama的Github项目地址:https://github.com/ollama/ollama

第二步:选择最新

Releases发行版,截止当前最新版本为v 0.5.7

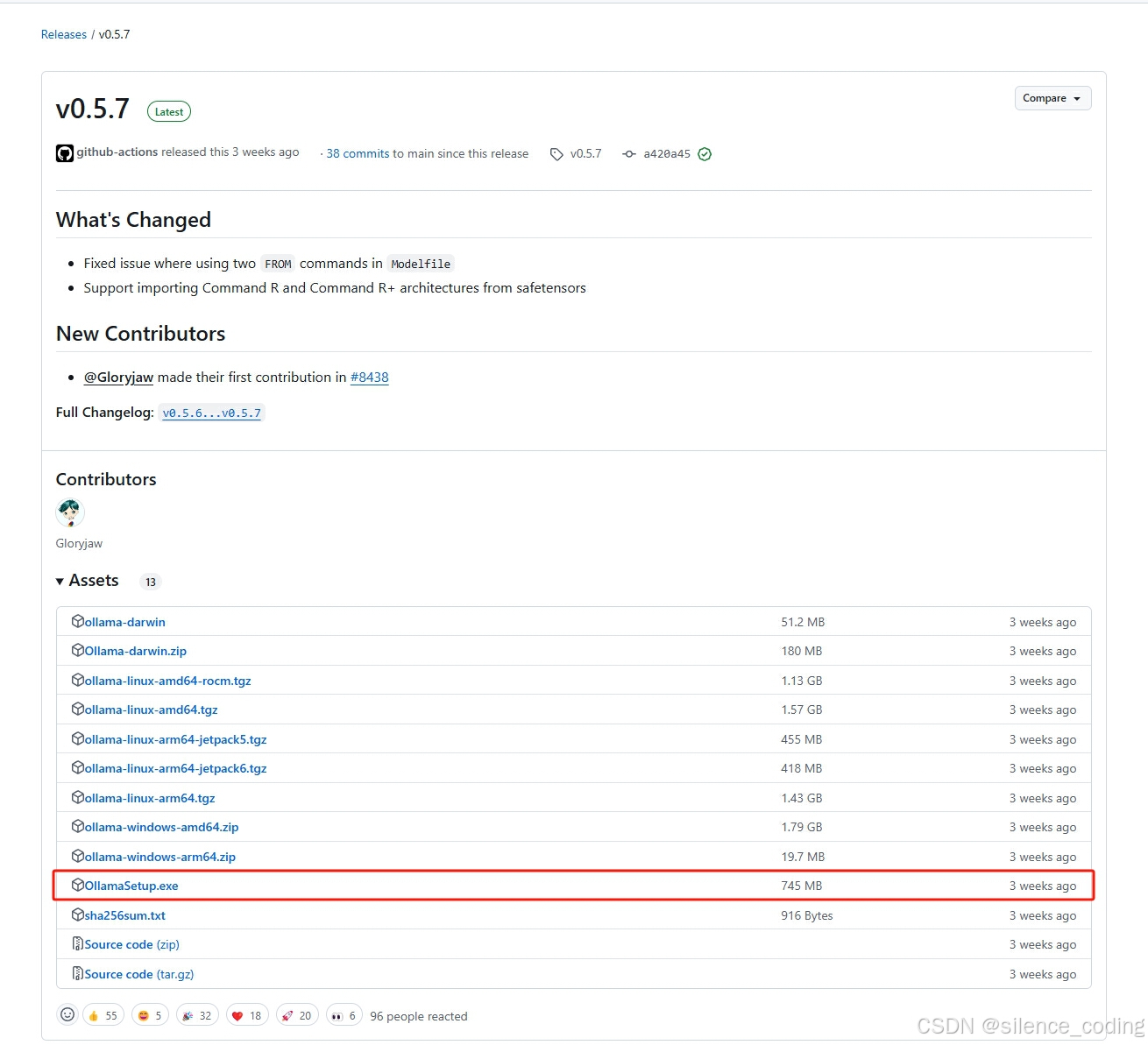

第三步:根据环境类型选择要下载的

ollama文件,本篇采用Windows进行本地部署,故选择OllamaSetup.exe。

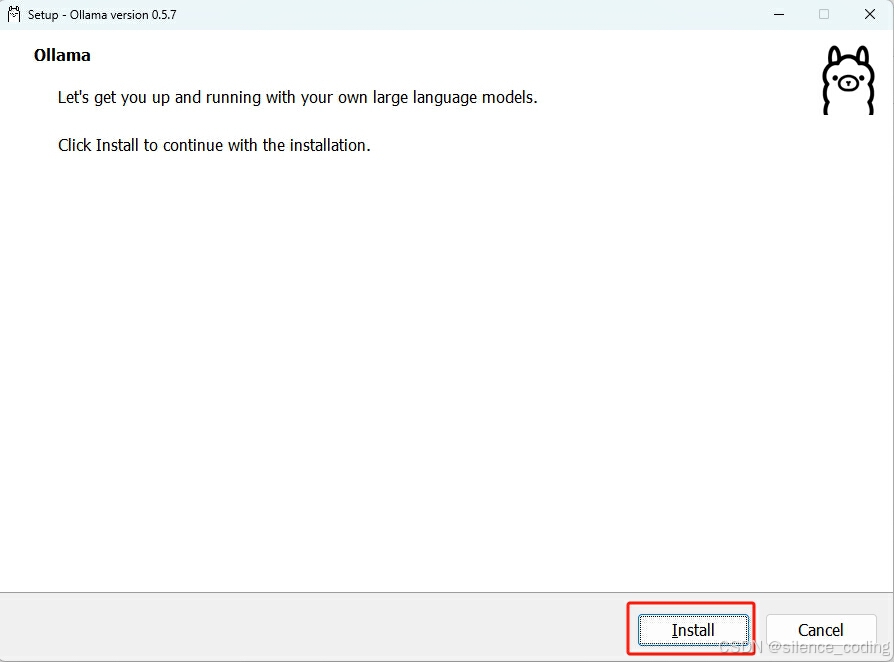

1.2 安装ollama

双击

ollamaSetup.exe进行安装,一直点击next直至安装完成。

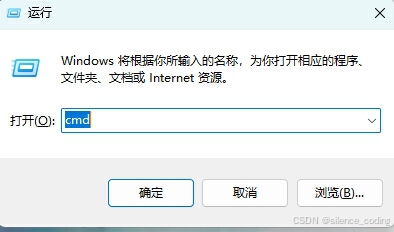

1.3 检查ollama安装结果

第一步:

Win+R打开命令行输入cmd

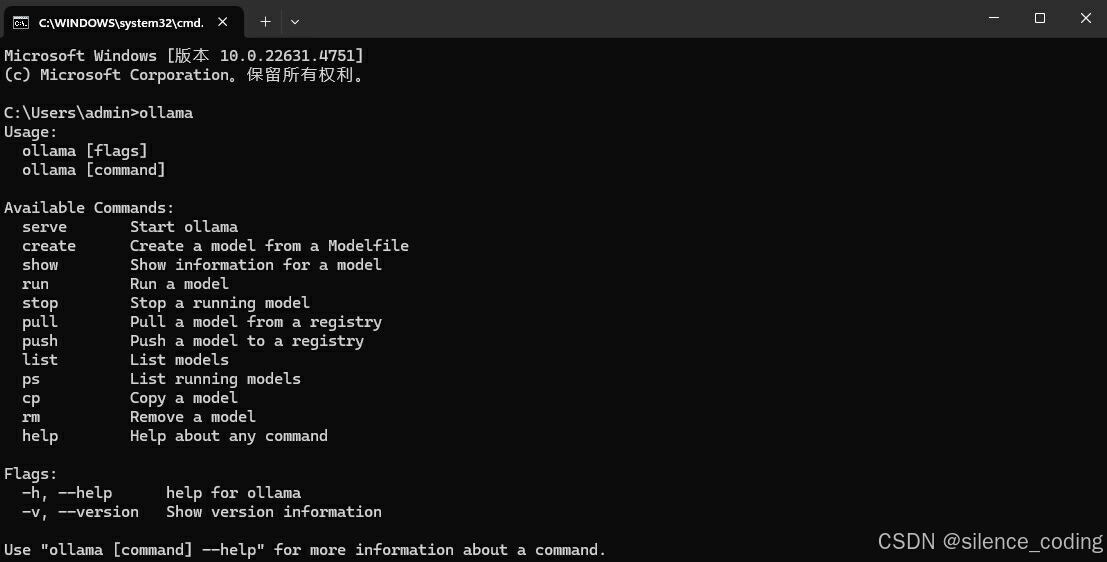

第二步:输入命令

ollama,如果出现以下结果即为安装成功

1.4 配置ollama运行环境变量

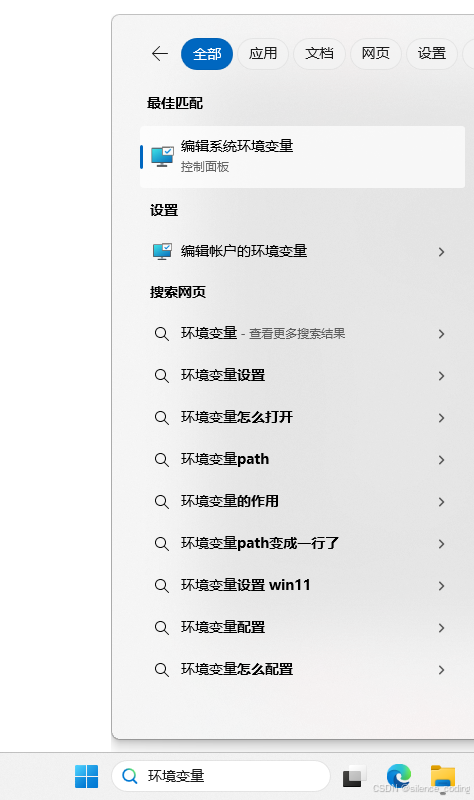

第一步:编辑环境变量,新手可以采用以下2种方法。

- Windows 11系统可以在搜索栏直接搜索环境变量。

- 设置->系统->系统信息->高级系统设置

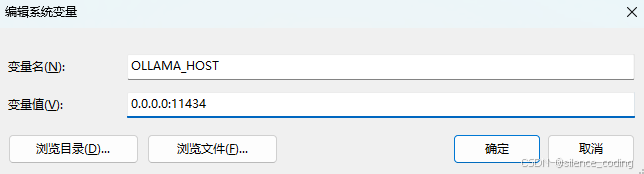

第二步:新建系统环境变量

OLLAMA_HOST。

- 0.0.0.0:代表的是本地

- 11434:

ollama默认端口

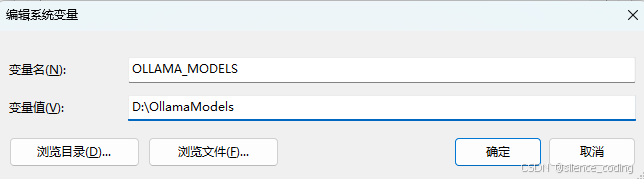

第三步:新建系统环境变量

OLLAMA_MODELS。

- 用于存放

ollama托管的模型文件。

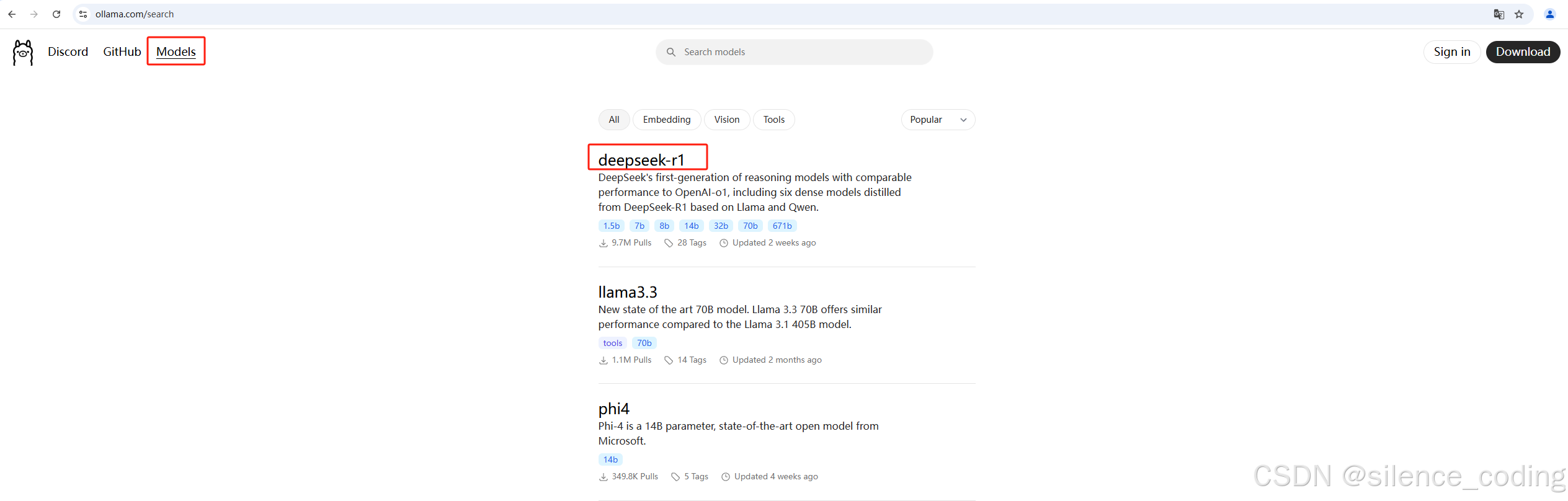

2. ollama安装DeepSeek模型

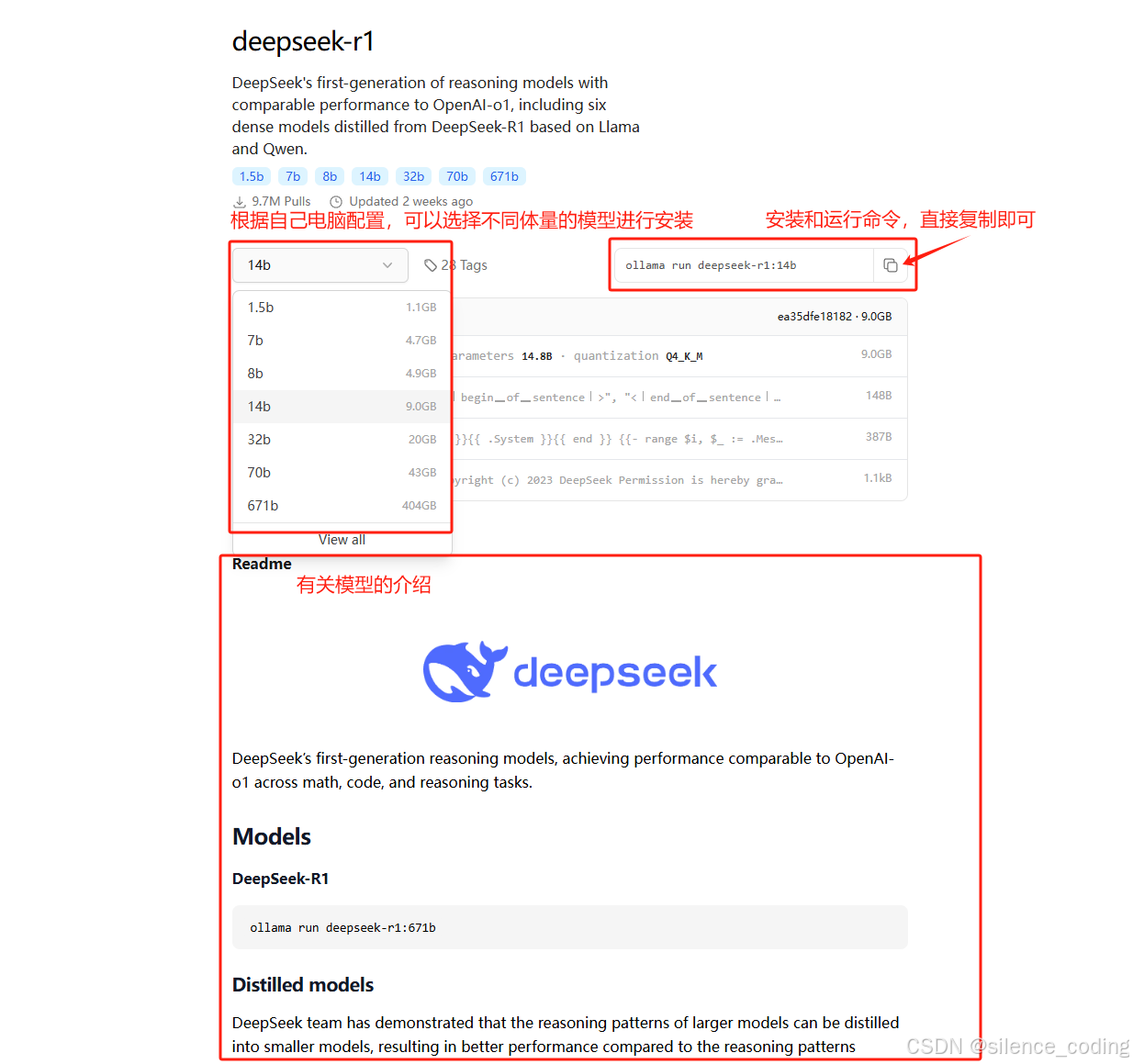

第一步:访问Ollama官网,点击左上角的Model进行模型选择,此处选择

deepseek-r1。

- 除了

deepseek外,还可以根据自己需要进行其他模型的部署安装,安装流程同deepseek流程。

第二步:根据自己电脑显存,选择适合的模型,然后点击右侧安装和运行命令进行

deepseek模型安装以下结果仅供参考:

1.5b模型:预计4GB显存能运行。

7b、8b模型:预计8GB显存能运行(如果仅需体验本地安装和日常问答运行,选7b即可)。

14b模型:预计12GB显存能运行(RTX 3080可以流畅运行)。

32b模型:预计24GB显存能运行(RTX 4090可以流畅运行)。

671b模型:目前deepseek官网能体验到的最强的模型。

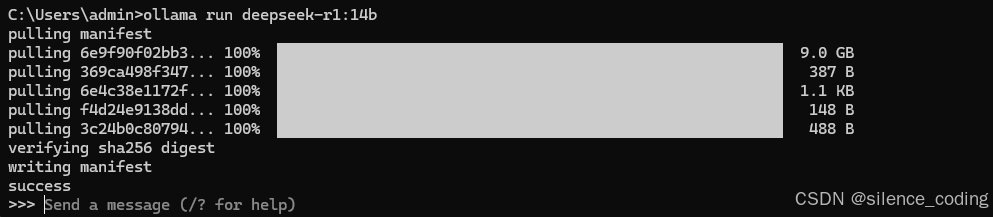

第三步:Win+R输入cmd命令进行命令行,输入命令。

- 第一次输入命令,

ollama会自动下载模型。- 第二次输入命令,即可本地运行

deepseek模型。

ollama run deepseek-r1:14b

3. 运行deepseek模型

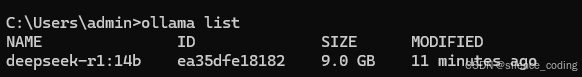

3.1 查看已安装模型

ollama list

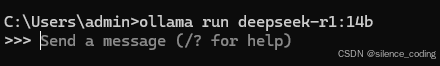

3.2 运行已安装模型

// deepseek-r1:14b可换成ollama list中任意一个模型名称

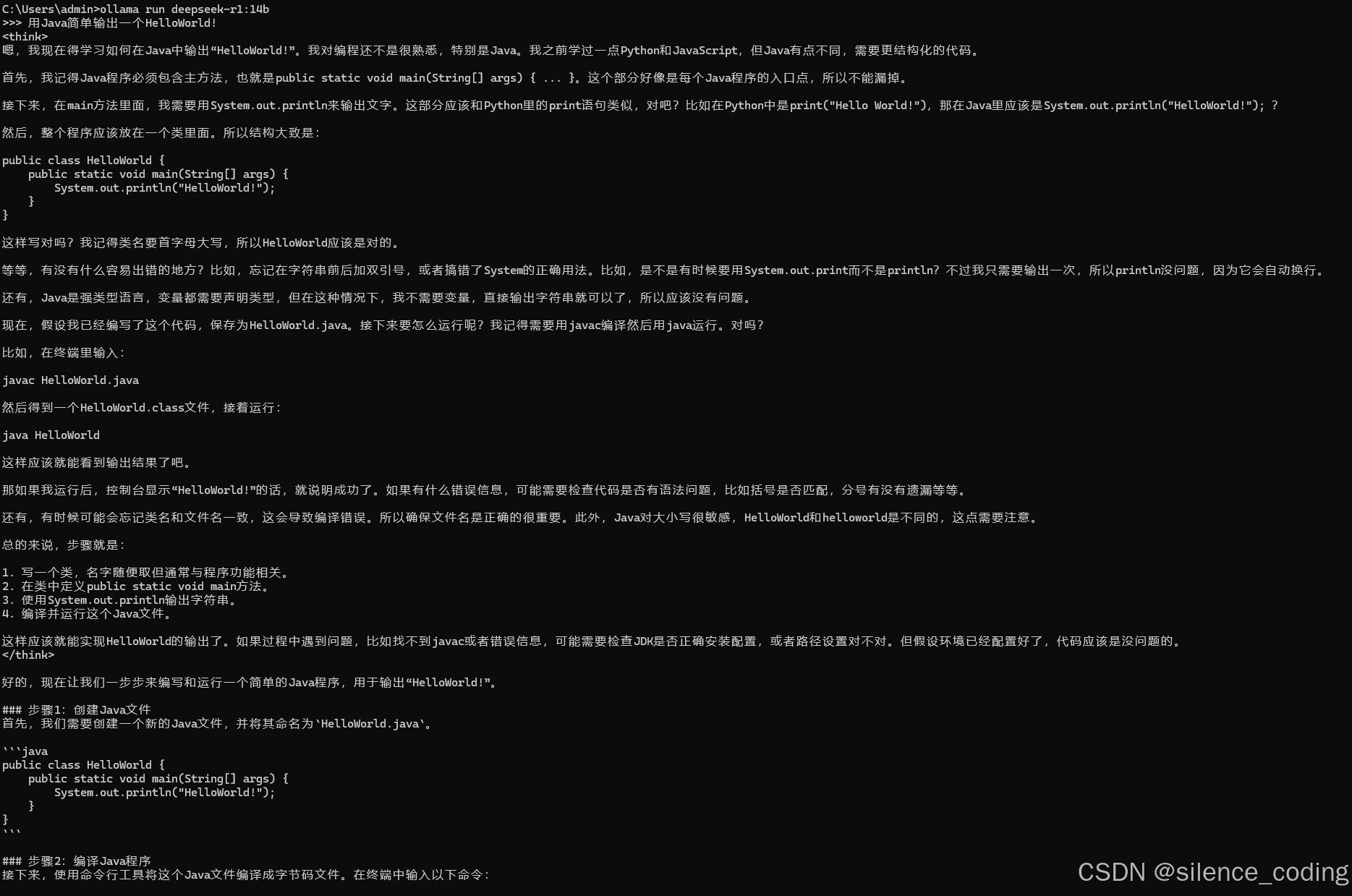

ollama run deepseek-r1:14b

3.3 使用已安装模型

直接输入想要查询的文本内容

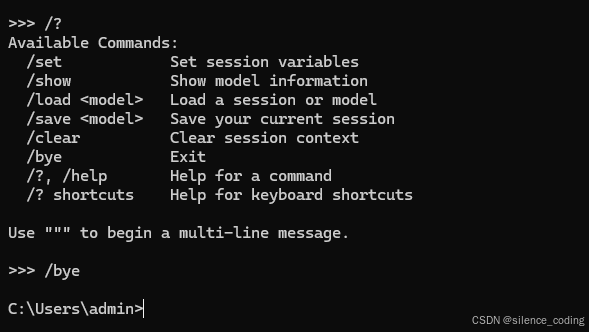

3.4 相关命令&退出模型

// 查看相关命令

>> /?

// 退出模型命令

>> /bye

1893

1893

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?