一、ollama 是什么

Ollama是一个强大的开源框架,主要用于在本地机器上便捷地部署和运行大型语言模型(LLM)。以下是关于Ollama的详细功能和特点:

- 简化部署:Ollama旨在简化在Docker容器中部署大型语言模型的过程,使得非专业用户也能方便地管理和运行这些复杂的模型。

- 捆绑模型组件:它将模型权重、配置和数据捆绑到一个包中,称为Modelfile,这有助于优化设置和配置细节,包括GPU使用情况。

- 支持多种模型:Ollama支持多种大型语言模型,如Llama 2、Code Llama、Mistral、Gemma等,并允许用户根据特定需求定制和创建自己的模型。

- 跨平台支持:它支持macOS和Linux平台,Windows平台的预览版也已发布。用户可以通过简单的安装过程,在多种操作系统环境下顺利部署和使用Ollama。

- 轻量级与可扩展:作为轻量级框架,Ollama保持了较小的资源占用,同时具备良好的可扩展性,允许用户根据需要调整配置以适应不同规模的项目和硬件条件。

- API支持:Ollama提供了一个简洁的API,使得开发者能够轻松创建、运行和管理大型语言模型实例,降低了与模型交互的技术门槛。

- 预构建模型库:它包含一系列预先训练好的大型语言模型,用户可以直接选用这些模型应用于自己的应用程序,无需从头训练或自行寻找模型源。

- 模型导入:支持从特定平台(如GGUF)导入已有的大型语言模型,也兼容PyTorch或Safetensors等深度学习框架,允许用户将基于这些框架训练的模型集成到Ollama中。

- 自定义提示:允许用户为模型添加或修改提示(prompt engineering),以引导模型生成特定类型或风格的文本输出。

- 资源管理:通过提供基于Web的用户界面(Open WebUI),用户可以方便地访问和管理Ollama的接口,实现模型的训练、部署和监控。

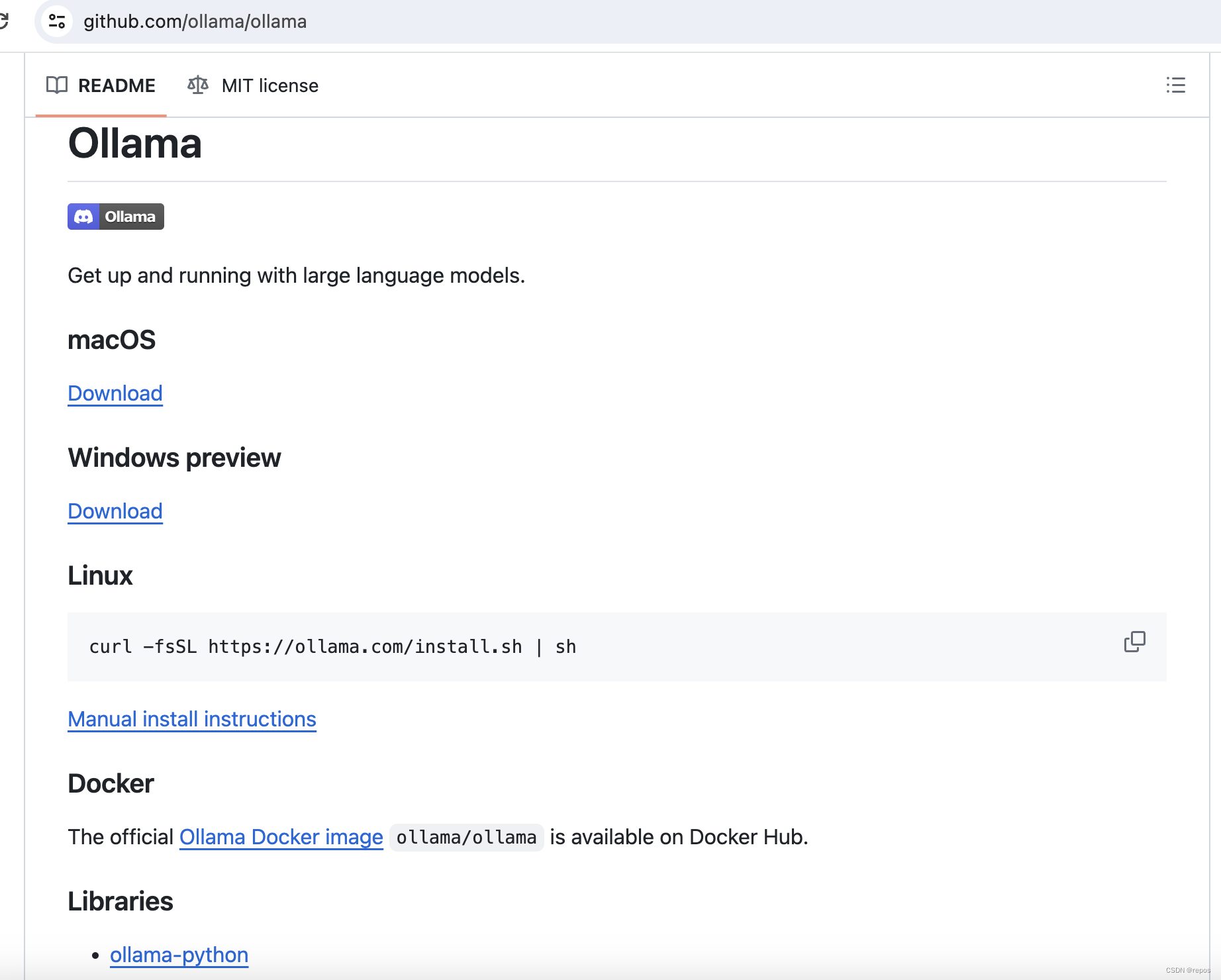

二、ollama 安装

https://github.com/ollama/ollama

三、ollama常用命令

Ollama的常用命令主要包括以下几个方面,以下将按照功能进行分点表示和归纳:

- 服务管理:

ollama serve:启动Ollama服务。systemctl daemon-reload&systemctl restart ollama(针对Linux系统):重启Ollama服务。

- 模型操作:

ollama create:从模型文件创建模型。ollama show:显示模型信息。ollama run [模型名称]:运行模型,其中[模型名称]为要运行的模型名。ollama pull [模型名称]:从注册表中拉取模型。ollama push:将模型推送到注册表。ollama list:列出所有模型。ollama cp:复制模型。ollama rm [模型名称]:删除模型,其中[模型名称]为要删除的模型名。

- 帮助与版本信息:

ollama --help或ollama help:获取有关Ollama任何命令的帮助信息。ollama --version或ollama -v:显示版本信息。

- 服务状态与配置:

netstat -tulpn | grep 11434:确认服务端口状态,查看Ollama服务是否在运行。- 配置服务HOST(针对Linux系统):

- 服务器环境下,修改

/etc/systemd/system/ollama.service文件,设置Environment="OLLAMA_HOST=0.0.0.0:11434"。 - 虚拟机环境下,根据虚拟机内网IP地址,设置类似

Environment="OLLAMA_HOST=服务器内网IP地址:11434"的配置。

- 服务器环境下,修改

- 其他命令(针对Linux系统):

curl -fsSL https://ollama.com/install.sh | sh:下载并安装Ollama Linux系统的命令。ollama run llama3:进入llama3运行环境。

2204

2204

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?