self.fc = nn.Sequential(

nn.Linear(oup, _make_divisible(inp // reduction, 8)),

SiLU(),

nn.Linear(_make_divisible(inp // reduction, 8), oup),

nn.Sigmoid()

)

def forward(self, x):

b, c, _, _ = x.size()

y = self.avg_pool(x).view(b, c)

y = self.fc(y).view(b, c, 1, 1)

return x * y

定义MBConv模块和Fused-MBConv模块

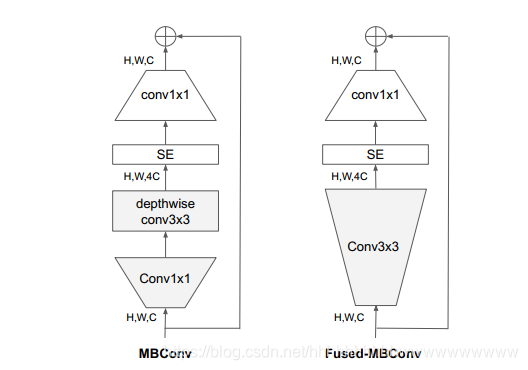

这两个模块是整个模型实现的核心,模块的详细构造如下图:

我们可以看到MBConv模块,经过1×1的卷积,然后channel放大四倍,再经过depthwise conv3×3的卷积,然后经过SE模块后,再经过1×1的卷积,把channel恢复到输入的大小,最后和上层的输入融合。

Fused-MBConv模块比MBConv模块简单些,先经过3×3的卷积,把channel放大四倍,然后经过SE模块,再经过1×1的卷积,最后和上层的输入融合。下面是实现MBConv模块和Fused-MBConv模块的详细代码:

class MBConv(nn.Module):

“”"

定义MBConv模块和Fused-MBConv模块,将fused设置为1或True是Fused-MBConv,否则是MBConv

:param inp:输入的channel

:param oup:输出的channel

:param stride:步长,设置为1时图片的大小不变,设置为2时,图片的面积变为原来的四分之一

:param expand_ratio:放大的倍率

:return:

“”"

def init(self, inp, oup, stride, expand_ratio, fused):

super(MBConv, self).init()

assert stride in [1, 2]

hidden_dim = round(inp * expand_ratio)

self.identity = stride == 1 and inp == oup

if fused:

self.conv = nn.Sequential(

fused

nn.Conv2d(inp, hidden_dim, 3, stride, 1, bias=False),

nn.BatchNorm2d(hidden_dim),

SiLU(),

SELayer(inp, hidden_dim),

pw-linear

nn.Conv2d(hidden_dim, oup, 1, 1, 0, bias=False),

nn.BatchNorm2d(oup),

)

else:

self.conv = nn.Sequential(

pw

nn.Conv2d(inp, hidden_dim, 1, 1, 0, bias=False),

nn.BatchNorm2d(hidden_dim),

SiLU(),

dw

nn.Conv2d(hidden_dim, hidden_dim, 3, stride, 1, groups=hidden_dim, bias=False),

nn.BatchNorm2d(hidden_dim),

SiLU(),

SELayer(inp, hidden_dim),

pw-linear

nn.Conv2d(hidden_dim, oup, 1, 1, 0, bias=False),

nn.BatchNorm2d(oup),

)

def forward(self, x):

if self.identity:

return x + self.conv(x)

else:

return self.conv(x)

主体模块

class EfficientNetv2(nn.Module):

def init(self, cfgs, num_classes=1000, width_mult=1.):

super(EfficientNetv2, self).init()

self.cfgs = cfgs

building first layer

input_channel = _make_divisible(24 * width_mult, 8)

layers = [conv_3x3_bn(3, input_channel, 2)]

building inverted residual blocks

block = MBConv

for t, c, n, s, fused in self.cfgs:

output_channel = _make_divisible(c * width_mult, 8)

for i in range(n):

layers.append(block(input_channel, output_channel, s if i == 0 else 1, t, fused))

input_channel = output_channel

self.features = nn.Sequential(*layers)

building last several layers

output_channel = _make_divisible(1792 * width_mult, 8) if width_mult > 1.0 else 1792

self.conv = conv_1x1_bn(input_channel, output_channel)

self.avgpool = nn.AdaptiveAvgPool2d((1, 1))

self.classifier = nn.Linear(output_channel, num_classes)

self._initialize_weights()

def forward(self, x):

x = self.features(x)

x = self.conv(x)

x = self.avgpool(x)

x = x.view(x.size(0), -1)

x = self.classifier(x)

return x

def _initialize_weights(self):

for m in self.modules():

if isinstance(m, nn.Conv2d):

n = m.kernel_size[0] * m.kernel_size[1] * m.out_channels

m.weight.data.normal_(0, math.sqrt(2. / n))

if m.bias is not None:

m.bias.data.zero_()

elif isinstance(m, nn.BatchNorm2d):

m.weight.data.fill_(1)

m.bias.data.zero_()

elif isinstance(m, nn.Linear):

m.weight.data.normal_(0, 0.001)

m.bias.data.zero_()

理解这段代码,我们还需要了解输入参数cfgs,以efficientnetv2_s为例:

def efficientnetv2_s(**kwargs):

“”"

Constructs a EfficientNetV2-S model

“”"

cfgs = [

t, c, n, s, fused

[1, 24, 2, 1, 1],

[4, 48, 4, 2, 1],

[4, 64, 4, 2, 1],

[4, 128, 6, 2, 0],

[6, 160, 9, 1, 0],

[6, 272, 15, 2, 0],

]

return EfficientNetv2(cfgs, **kwargs)

第一列“t”指的是MBConv模块和Fused-MBConv模块第一个输入后放大的倍率。

第二列“c”,channel,指的是输出的channel。

第三列“n”,指定的是MBConv模块和Fused-MBConv模块堆叠的个数。

第四列“s”,指的是卷积的步长,步长为1,图片的大小不变,步长为图片的面积缩小为原来的四分之一,实现降维。

第五列“fused”,选择MBConv模块或Fused-MBConv模块,为1这是Fused-MBConv模块,0则是MBConv模块,对应了前面摘要提过了,在浅层用Fused-MBConv代替MBConv。

完整代码

====

import torch

import torch.nn as nn

import math

all = [‘efficientnetv2_s’, ‘efficientnetv2_m’, ‘efficientnetv2_l’, ‘efficientnetv2_xl’]

from torchsummary import summary

#这个函数的目的是确保Channel能被8整除。

def _make_divisible(v, divisor, min_value=None):

“”"

这个函数的目的是确保Channel能被8整除。

:param v:

:param divisor:

:param min_value:

:return:

“”"

if min_value is None:

min_value = divisor

new_v = max(min_value, int(v + divisor / 2) // divisor * divisor)

Make sure that round down does not go down by more than 10%.

if new_v < 0.9 * v:

new_v += divisor

return new_v

SiLU (Swish) activation function

if hasattr(nn, ‘SiLU’):

SiLU = nn.SiLU

else:

For compatibility with old PyTorch versions

class SiLU(nn.Module):

def forward(self, x):

return x * torch.sigmoid(x)

class SELayer(nn.Module):

def init(self, inp, oup, reduction=4):

super(SELayer, self).init()

self.avg_pool = nn.AdaptiveAvgPool2d(1)

self.fc = nn.Sequential(

nn.Linear(oup, _make_divisible(inp // reduction, 8)),

SiLU(),

nn.Linear(_make_divisible(inp // reduction, 8), oup),

nn.Sigmoid()

)

def forward(self, x):

b, c, _, _ = x.size()

y = self.avg_pool(x).view(b, c)

y = self.fc(y).view(b, c, 1, 1)

return x * y

def conv_3x3_bn(inp, oup, stride):

return nn.Sequential(

nn.Conv2d(inp, oup, 3, stride, 1, bias=False),

nn.BatchNorm2d(oup),

SiLU()

)

def conv_1x1_bn(inp, oup):

return nn.Sequential(

nn.Conv2d(inp, oup, 1, 1, 0, bias=False),

nn.BatchNorm2d(oup),

SiLU()

)

class MBConv(nn.Module):

“”"

定义MBConv模块和Fused-MBConv模块,将fused设置为1或True是Fused-MBConv,否则是MBConv

:param inp:输入的channel

:param oup:输出的channel

:param stride:步长,设置为1时图片的大小不变,设置为2时,图片的面积变为原来的四分之一

:param expand_ratio:放大的倍率

:return:

(1)Python所有方向的学习路线(新版)

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

(2)Python学习视频

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

(3)100多个练手项目

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数初中级Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python爬虫全套学习资料》送给大家,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

由于文件比较大,这里只是将部分目录截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频

如果你觉得这些内容对你有帮助,可以添加下面V无偿领取!(备注:python)

手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数初中级Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python爬虫全套学习资料》送给大家,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

由于文件比较大,这里只是将部分目录截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频

如果你觉得这些内容对你有帮助,可以添加下面V无偿领取!(备注:python)

[外链图片转存中…(img-EVdqunvK-1711207030679)]

文章详细介绍了EfficientNetv2模型中使用的MBConv和Fused-MBConv模块的结构,包括它们的组成部分、操作步骤以及在模型构建中的作用。重点讨论了这两种模块如何通过卷积、通道扩展、SE模块等进行特征提取和融合。

文章详细介绍了EfficientNetv2模型中使用的MBConv和Fused-MBConv模块的结构,包括它们的组成部分、操作步骤以及在模型构建中的作用。重点讨论了这两种模块如何通过卷积、通道扩展、SE模块等进行特征提取和融合。

723

723

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?