参考视频:手写数字识别 1.2 神经网络_哔哩哔哩_bilibili

可视化网站:

Multiclass SVM optimization demo (stanford.edu)

A Neural Network Playground (tensorflow.org)

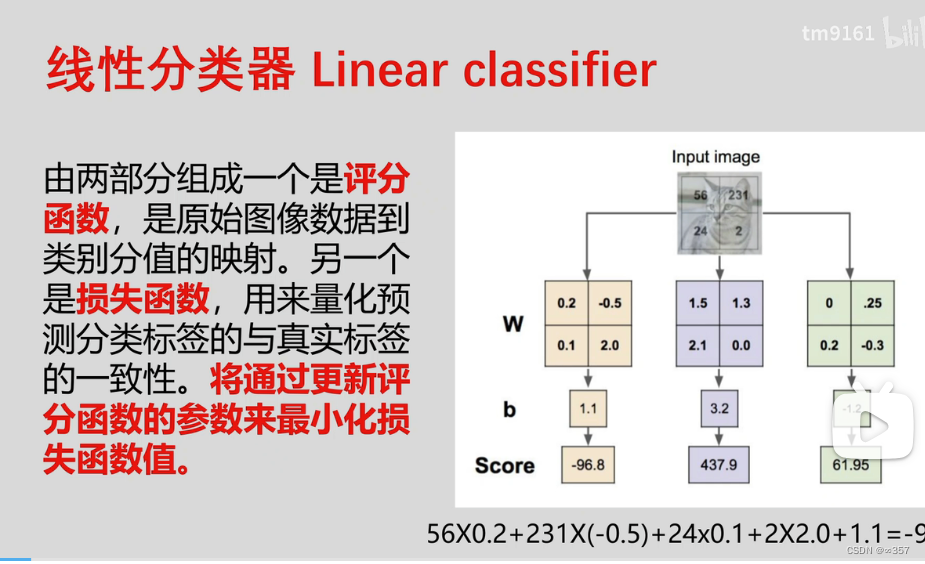

1 线性分类器

1.1 线性分类器:

目标是让 损失函数变小!

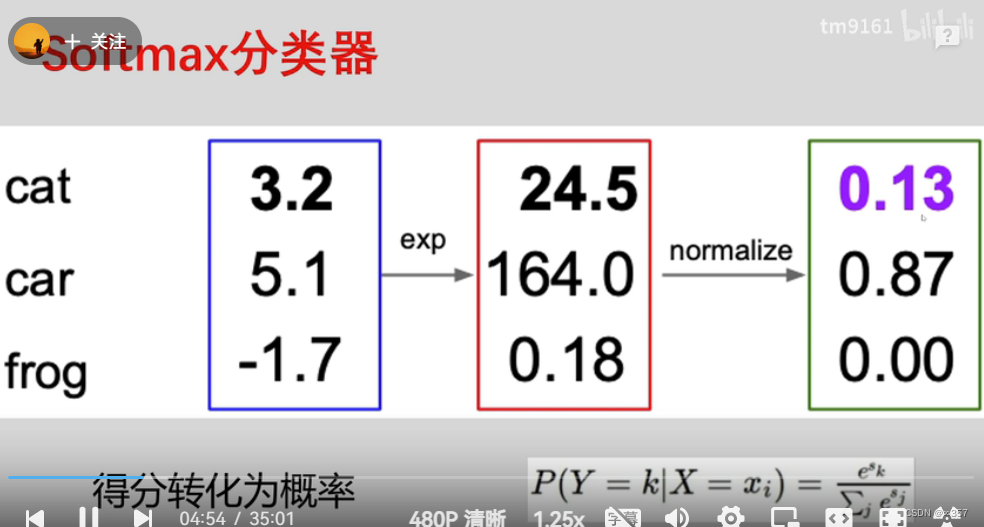

1.2 Softmax分类器

核心作用:将分数变为函数值(在用交叉熵损失函数计算损失函数之前要进行这个处理!!)

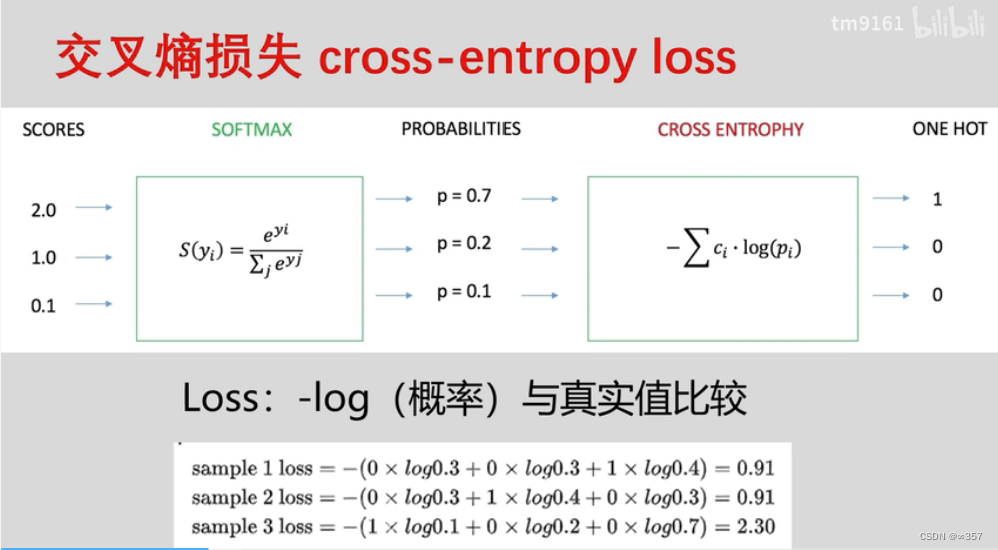

1.3 交叉熵损失:

损失函数的值 越小说明越好! 找到最小的损失函数对应的 (1,0,0)类似的向量之后就可以判断类别了

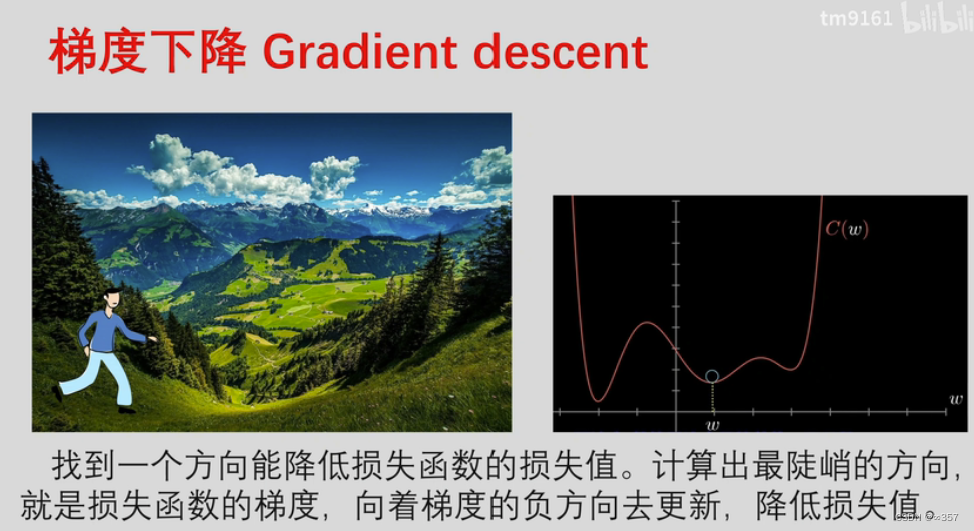

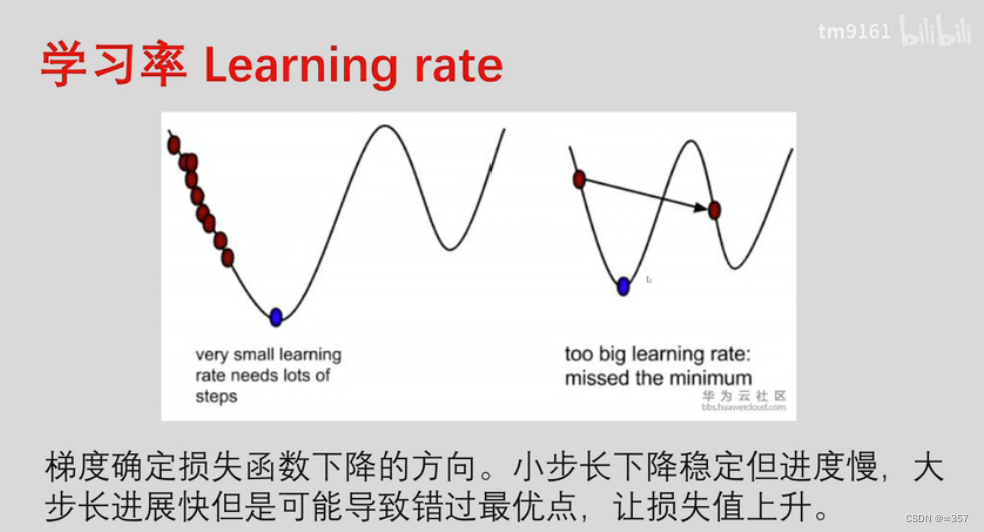

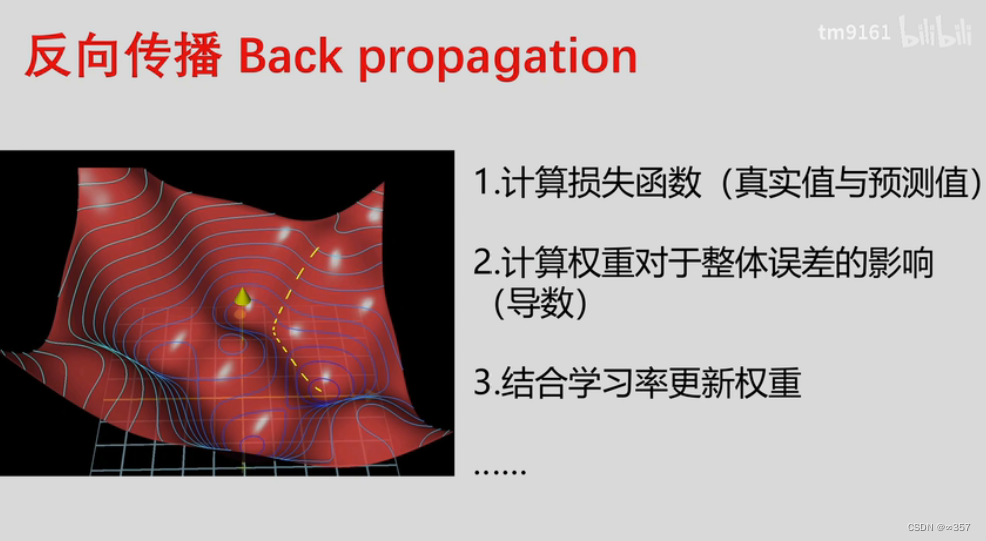

1.4 梯度下降:(用反向传播高效的计算梯度)

目的:找到最小的损失函数!

找出最陡的方向的反方向,每次走多少:学习率

1.5 学习率(步长也要训练)

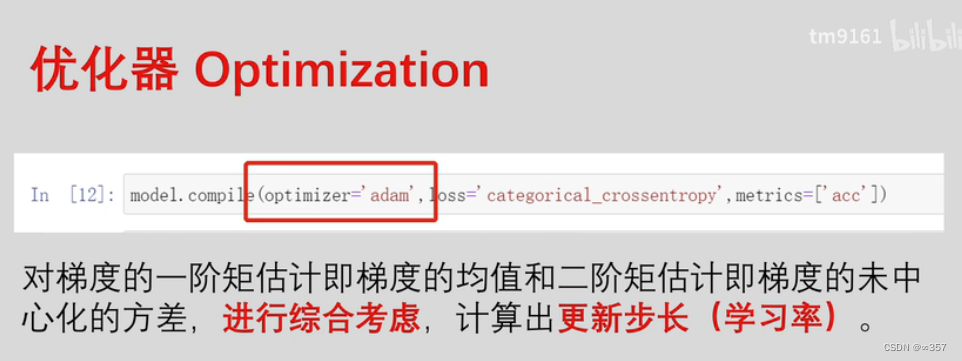

1.6 优化器(用于计算步长)

步长的变化可以用 优化器计算:

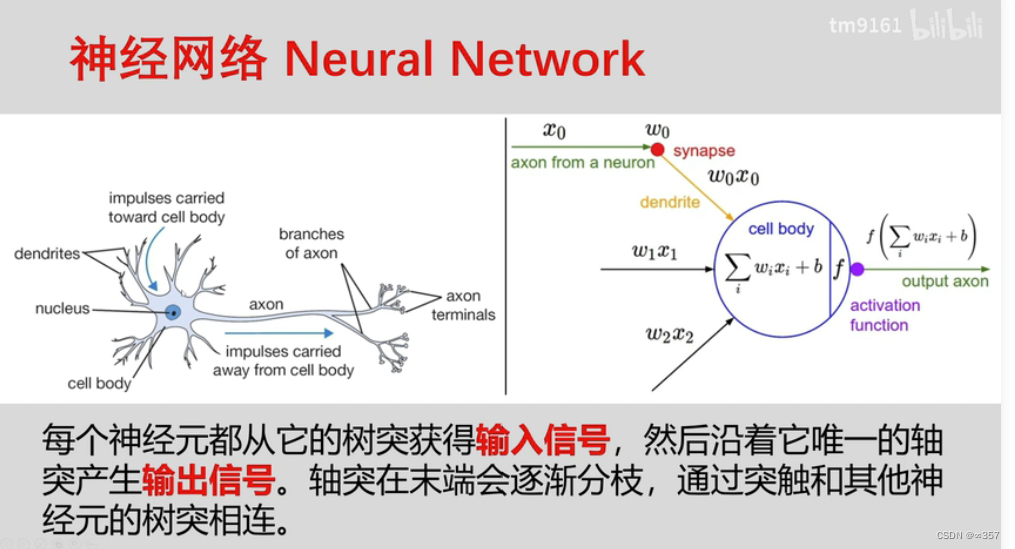

2 神经网络

2.1 概述

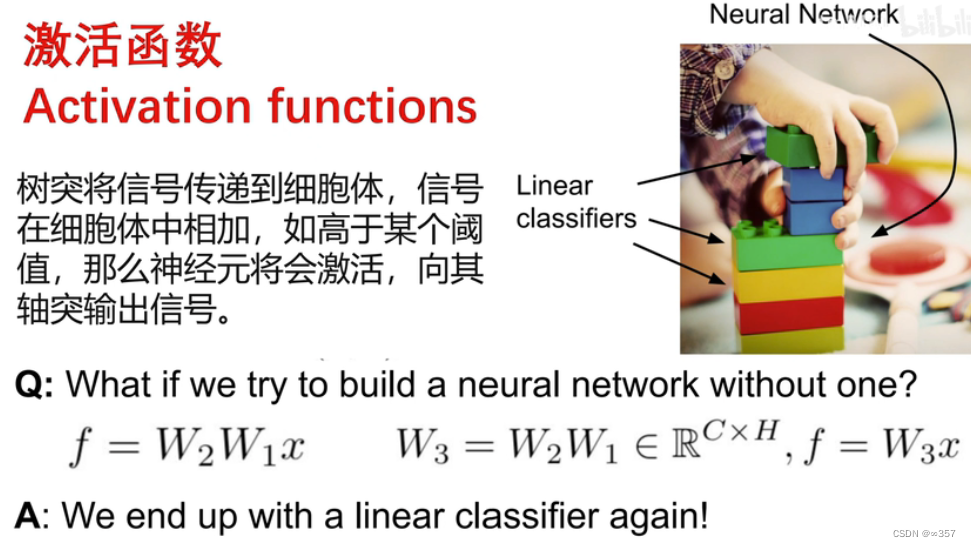

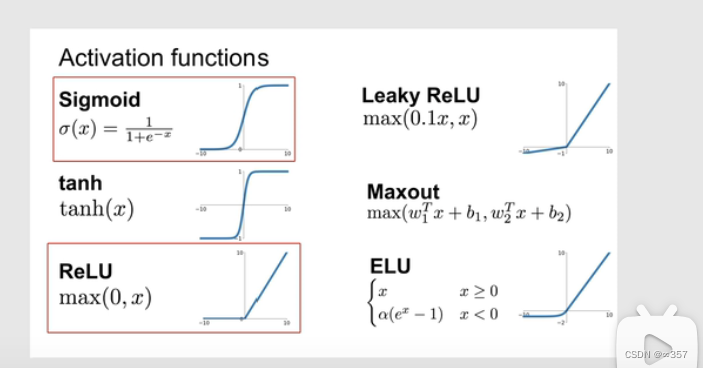

2.2 激活函数

没有进行激活函数的作用,只是线性函数的叠加是没有用的!!!

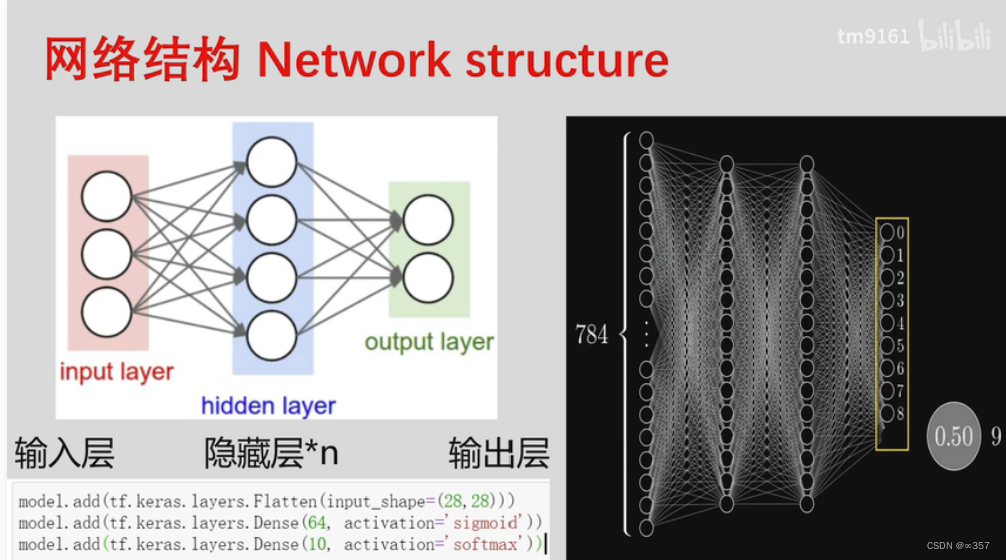

2.3 网络结构

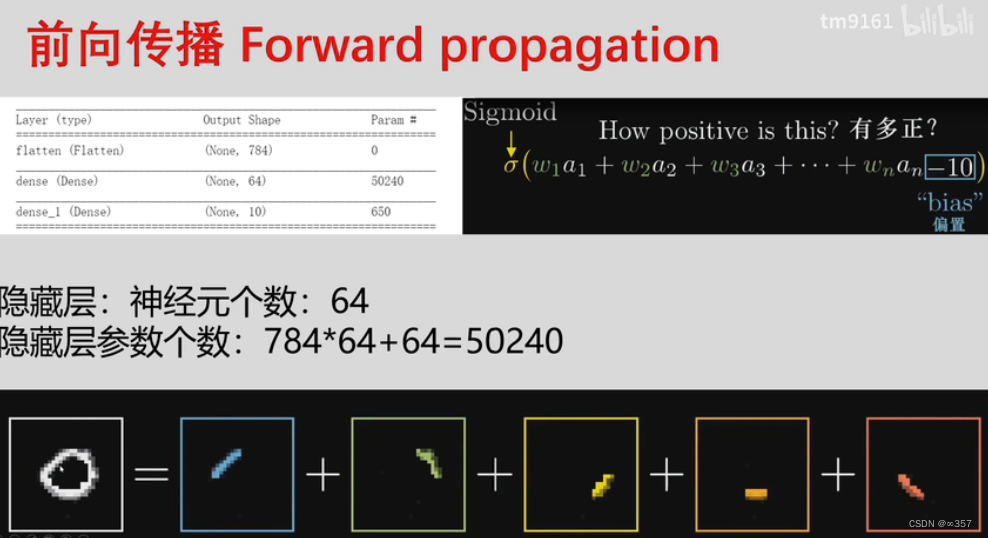

2.4 前向传播

这个结果不一定对,但是会得到初始的权重和偏置项

2.5 反向传播:(高效的计算梯度!)

本文详细介绍了神经网络中的线性分类器、softmax分类、交叉熵损失函数、梯度下降优化、学习率选择以及神经网络的激活函数、网络结构和前向传播、反向传播等关键概念,帮助读者理解这些基础技术在机器学习中的作用。

本文详细介绍了神经网络中的线性分类器、softmax分类、交叉熵损失函数、梯度下降优化、学习率选择以及神经网络的激活函数、网络结构和前向传播、反向传播等关键概念,帮助读者理解这些基础技术在机器学习中的作用。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?