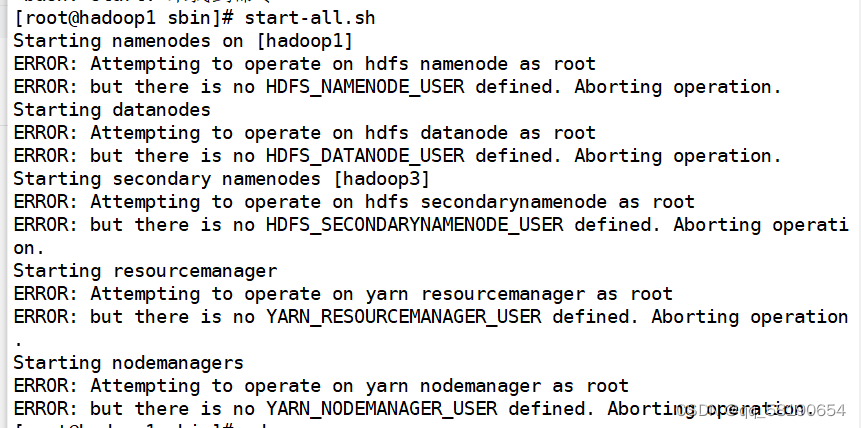

【结果显示如下:】

【查资料】

【第一种方法:】在sbin下查找start-dfs.sh和stop-dfs.sh两个文件,在其顶部都添加上

#!/usr/bin/env bash

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

在start-yarn.sh和stop-yarn.sh两个文件的顶部都添加上

#!/usr/bin/env bash

YARN_RESOURCEMANAGER_USER=root

HADOOP_SECURE_DN_USER=yarn

YARN_NODEMANAGER_USER=rootresource /etc/profile之后并没有启动成功节点,显然第一种方法对我没用。

【第二种方法:】

先【cd ~】一下回到目录,接着【vim /etc/profile】在环境变量中添加以下配置

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YA

博主尝试多种方法启动Hadoop完全分布式环境,包括在启动脚本中添加resource /etc/profile,修改环境变量,以及逐个启动dfs和yarn。最终发现需在sbin目录下执行启动命令才成功启动所有节点。

博主尝试多种方法启动Hadoop完全分布式环境,包括在启动脚本中添加resource /etc/profile,修改环境变量,以及逐个启动dfs和yarn。最终发现需在sbin目录下执行启动命令才成功启动所有节点。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1061

1061

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?