今天看《Deep Network-Enabled Haze Visibility Enhancement for Visual IoT-Driven Intelligent Transportation Systems》

论文地址:https://drive.google.com/file/d/1EktkeJZDcI6AEgCYsYzzIwE9-JxbXxUN/view

标题是“物联网驱动的可视智能交通系统的深度网络化雾霾能见度增强”

一、摘要

1.1 英文原文

The Internet of Things (IoT) has recently emerged as a revolutionary communication paradigm where a large number of objects and devices are closely interconnected to enable smart industrial environments. The tremendous growth of visual sensors can significantly promote the traffic situational awareness, traffic safety management, and intelligent vehicle navigation in intelligent transportation systems (ITSs). However, due to the absorption and scattering of light by the turbid medium in atmosphere, the visual IoT inevitably suffers from imaging quality degradation, e.g., contrast reduction, color distortion, etc. This negative impact can not only reduce the imaging quality, but also bring challenges for the deployment of several high-level vision tasks (e.g., object detection, tracking, recognition, etc.) in the ITS. To improve imaging quality under the hazy environment, we propose a deep network-enabled three-stage dehazing network (termed TSDNet) for promoting the visual IoT-driven ITS. In particular, the proposed TSDNet mainly contains three parts, i.e., multiscale attention module for estimating the hazy distribution in the RGB image domain, two-branch extraction module for learning the hazy features, and multifeature fusion module for integrating all characteristic information and reconstructing the haze-free image. Numerous experiments have been implemented on synthetic and real-world imaging scenarios. Dehazing results illustrated that our TSDNet remarkably outperformed several state-of-the-art methods in terms of both qualitative and quantitative evaluations. The high-accuracy object detection results have also demonstrated the superior dehazing performance of the TSDNet under hazy atmosphere conditions. The source code is available at https://github.com/gy65896/TSDNet.

1.2 理解

如今物联网(the Internet of things,IoT)迅速发展,大气环境却遭受到不好的影响,成像质量不断降低,如照片失真、对比度降低等,进而影响目标检测、追踪等任务的进行。为此,作者提出了一种了三阶段去雾网络(Three-Stage Dehazing Network,TSDNet)改善图像质量。该网络三阶段对应三个部分:用于评估RGB图像领域中雾霾分布的多尺度注意模块、用于学习雾霾特征的二分支提取模块以及用于融合所有特征信息和重构无雾图像的多特征融合模块。

二、引言

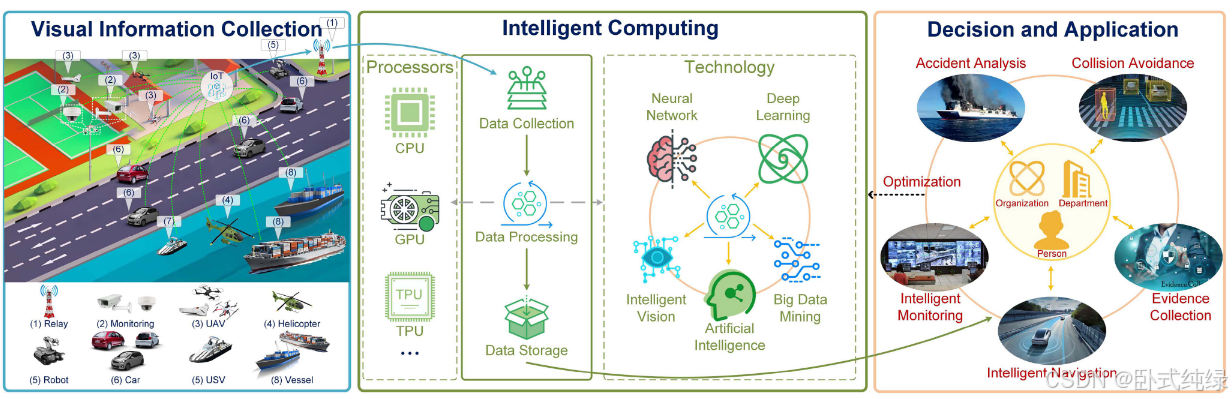

通讯、网络等发展迅速,导致物联网引起了工业和学术界的注意。视觉传感器的发展直接促进了工业物联网在视觉驱动的视频监控中的扩展。下图展示了物联网的分布式计算和高度可扩展性使得智能交通系统(Intelligent Traffic Systems,ITS)部署成为可能。

图中主要展示的是视觉物联网交通系统的工作流程图,主要包括视觉信息采集、智能计算、决策和应用。(其中UAV和USV分别代表无人飞行器和无人水面艇)尽管如此,大气中混浊介质对环境光的散射和吸收仍然导致了人们采集的视频和图像质量下降(在大雾的环境下)。这就使得前景和背景模糊难以区分,目标信息被隐藏。所以设计一种去雾器就显得很有必要。

在此之前就有一些基于先验的方法提出,例如He等人提出的暗通道先验(Dark Channel Prior,DCP),主要从RGB图像中抑制大雾。但DCP在大片天空和白色风景时不起作用,性能较差。相似的方法也都具有较差的泛化能力。收到深度学习的启发,再者卷积神经网络方法已经应用到很多低程度的视觉任务中,且目前很少有方法将大雾可视化增强于不同的物联网化的智能交通系统场景中执行。故作者有了这样的想法。

作者本篇论文的主要贡献有以下三点:

- 提出了一种大雾环境下用于提升基于物联网的视觉智能交通系统的深度网络化大雾可视化增强方法;

- 多尺度注意模块能够评估大雾分布;

- 在人工合成和真实世界图像中进行了全面的去雾实验以阐述作者网络的优势。

三、相关工作

3.1 基于先验的去雾方法

首先定义雾霾形成公式:

其中x是二维图像中的像素索引,IJA分别是去雾处理的图像、无雾图像以及大气光值。代表与散射系数β和场景深度d相关的投射图t。

He等人发现无雾图像在至少一个色彩通道中包含低值像素并提出了DCP。基于DCP理论和大气散射模型,通过估计雾霾的厚度来生成修复后的图像。但白色场景和天空区域下的一些像素并不一定遵循DCP,因为它们会造成低照度和不自然的失真。所以很多人也也在DCP的基础上提出了改进,如F-LDCP。

另外,也有人们构建了一些物理现实的先验策略。Fattal提出了一种本地特征模型(CL)用于解释雾霾场景下的色彩线条。Zhu等人采用色彩减弱先验(CAP)来建模雾霾图像的场景深度并通过监督学习方法评估深度信息。先验去雾方法的有效性很大程度上依赖假设的准确性。当先验信息不充分时,算法也将提供一个不令人满意的修复结果。

3.2 基于学习的去雾方法

数据驱动的卷积神经网络已经被应用于图像修复任务中。早期卷积神经网络的去雾工作尝试通过评估大气散射模型的传播来重建无雾图像,例如DehazeNet和MSCNN。Zhang等人提出的紧密连接的金字塔去雾网络(DCPDN)可以用来学习传播图和大气光值。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?