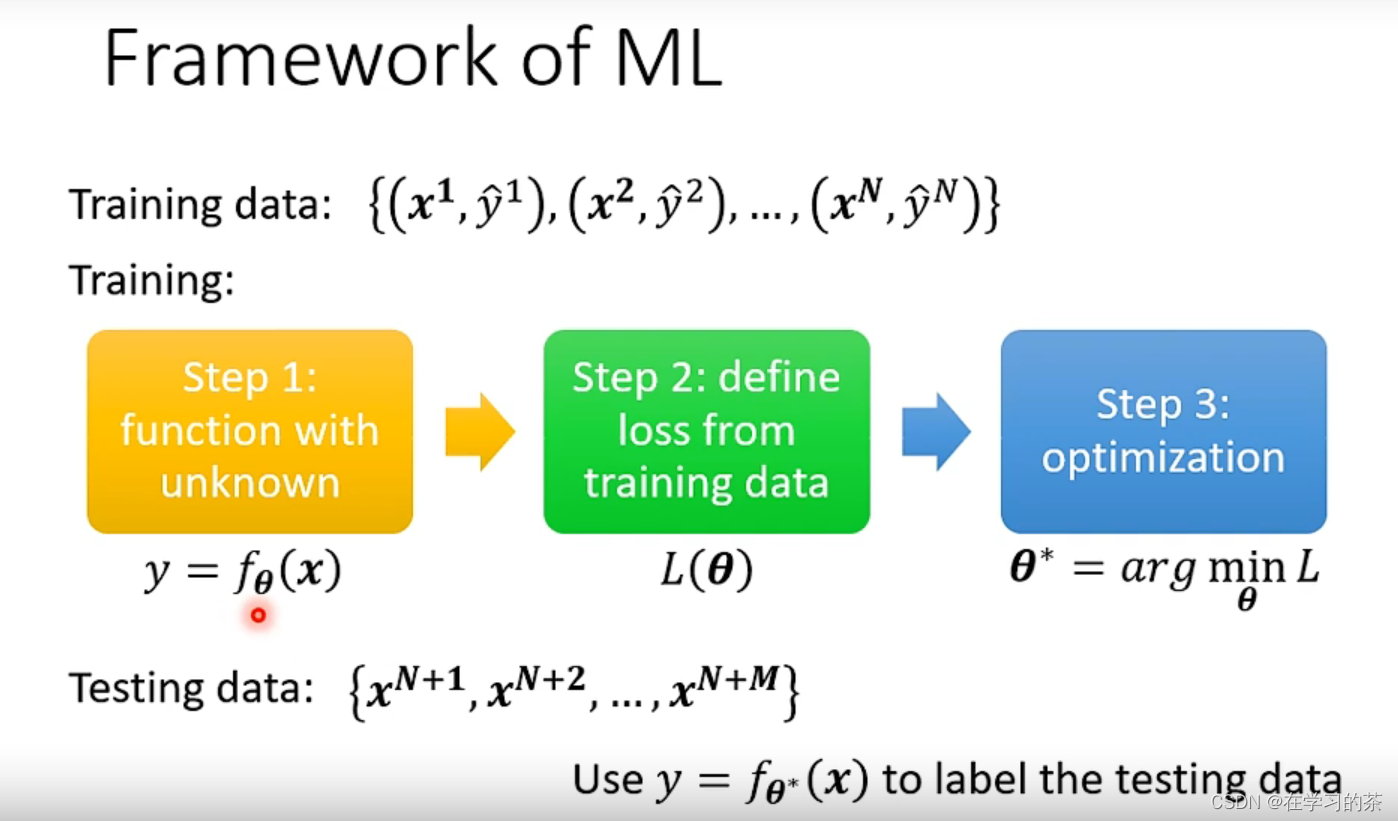

再次回顾ML过程

定义参数——定义损失函数——梯度下降优化参数

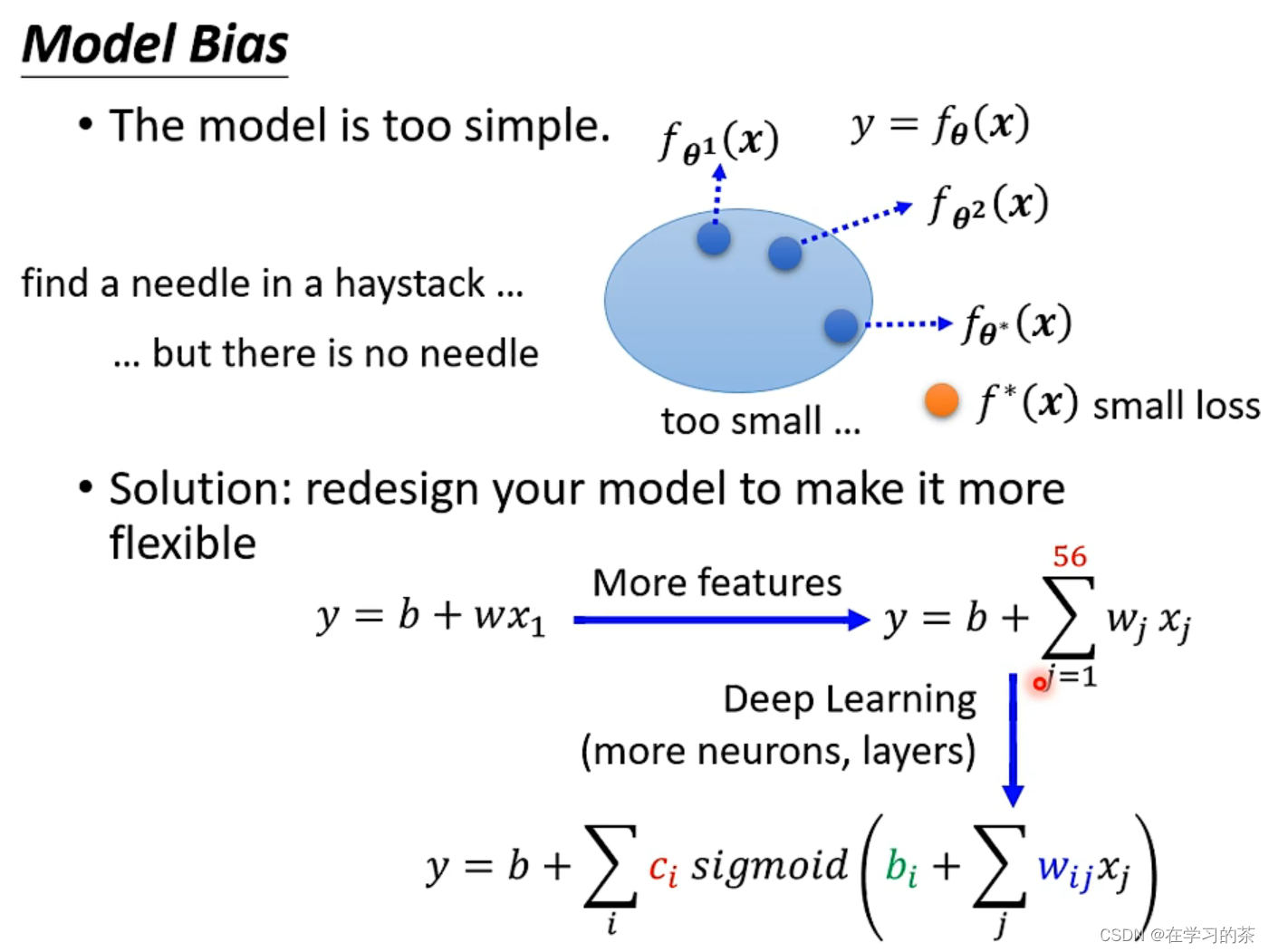

欠拟合(Model Bias)

解决欠拟合:① 增加线性模型参数,赋予更多弹性②使用dl的弹性进行拟合

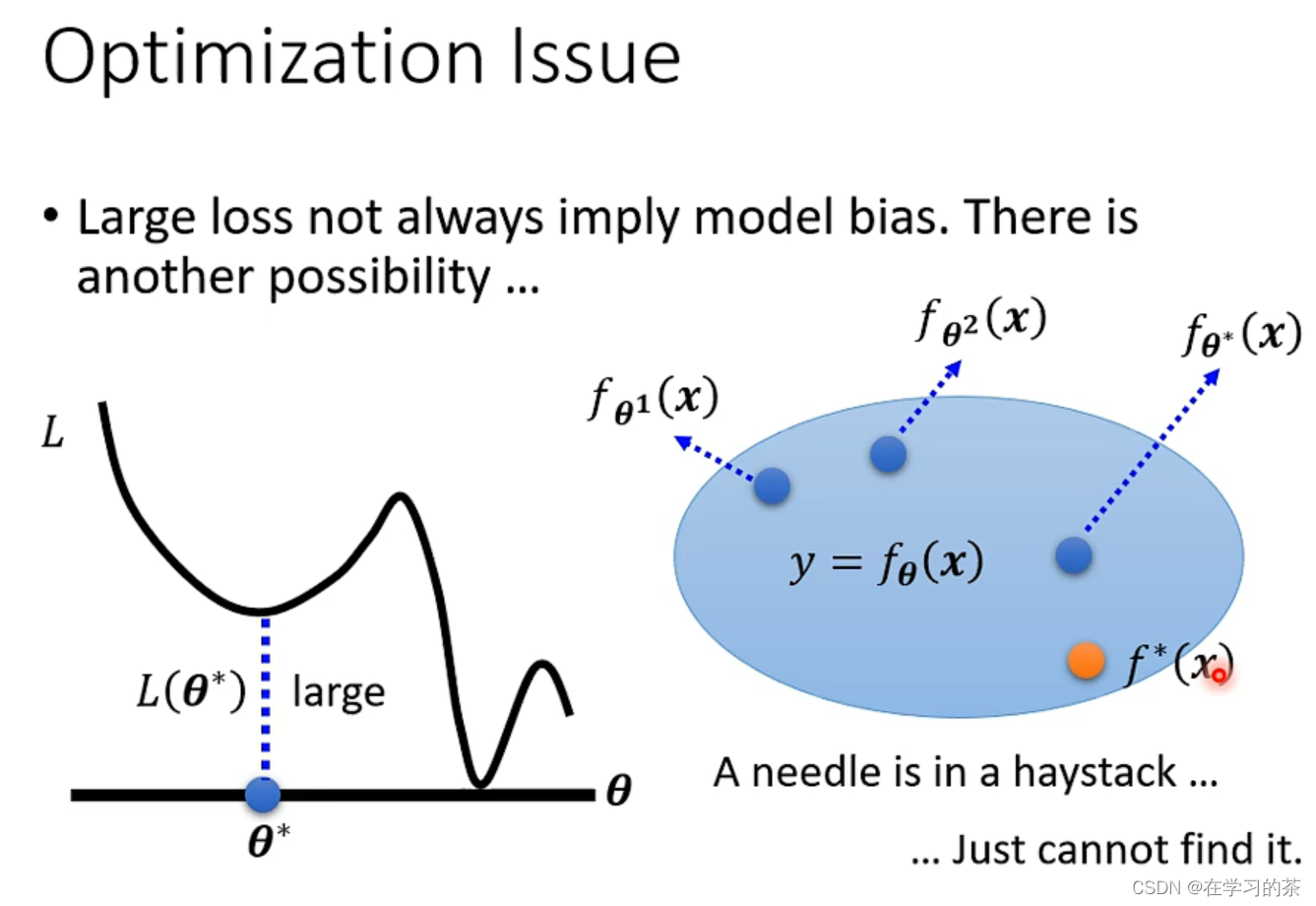

局部最小值情况

注意!此类情况测试集以及预测效果都不好,而Overfitting是测试好的不行,而预测很离谱!

所以说当我们适当增加模型弹性,导致结果很离谱,那就可能是Optimization Issue(优化问题)

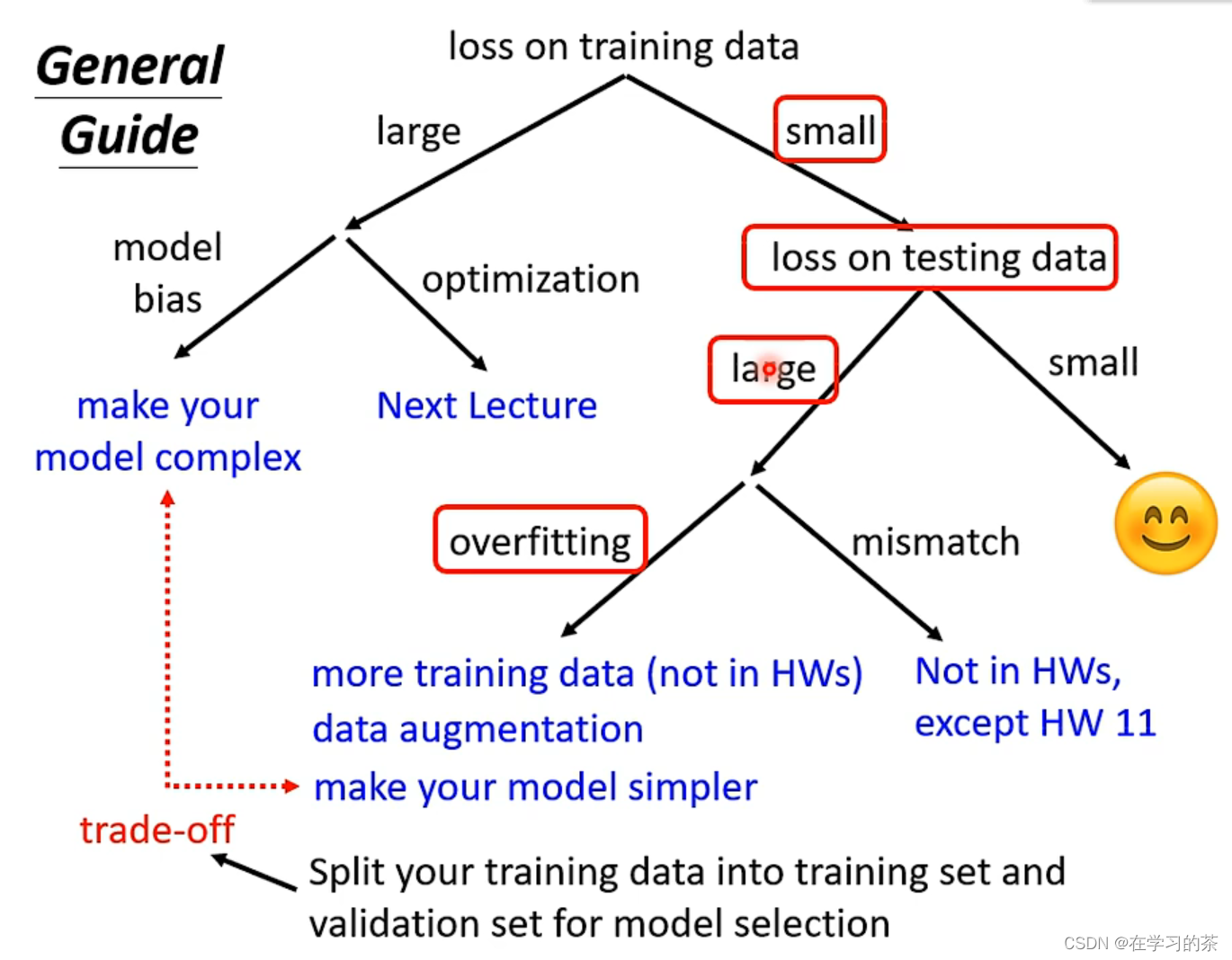

关于loss的评估图

mismatch的情况是训练集和测试集分布不一样,

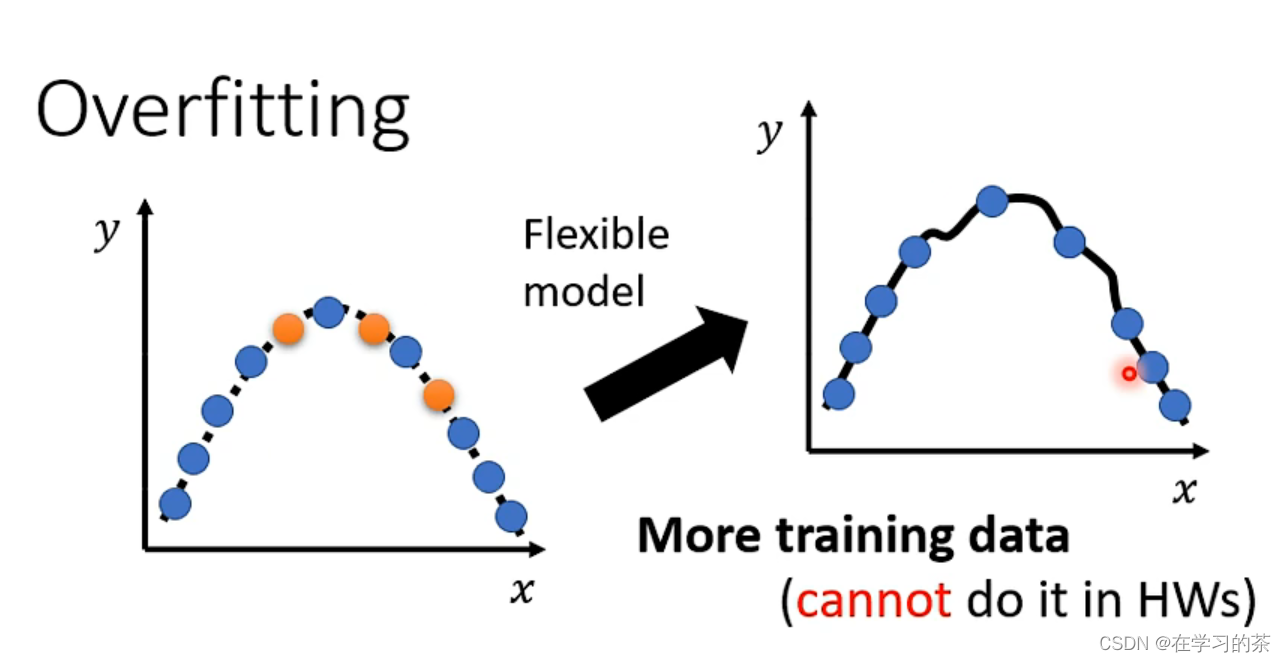

Overfitting的情况,最好的解决方法就是增加训练集

HOW???

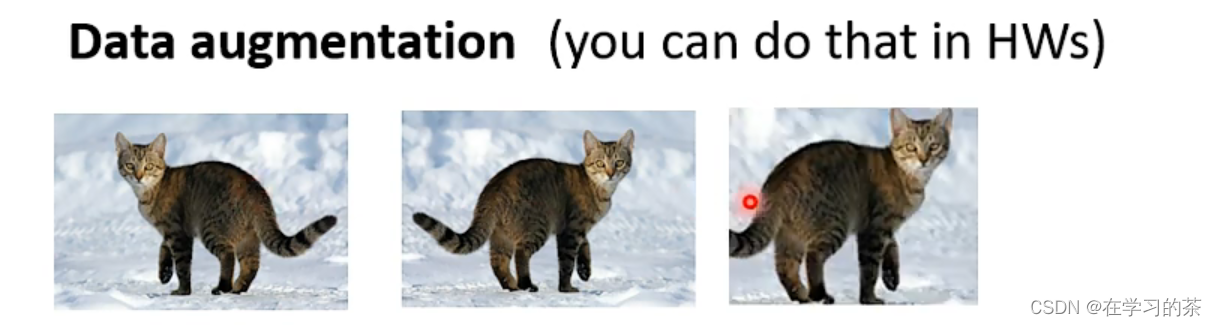

①增加训练集!

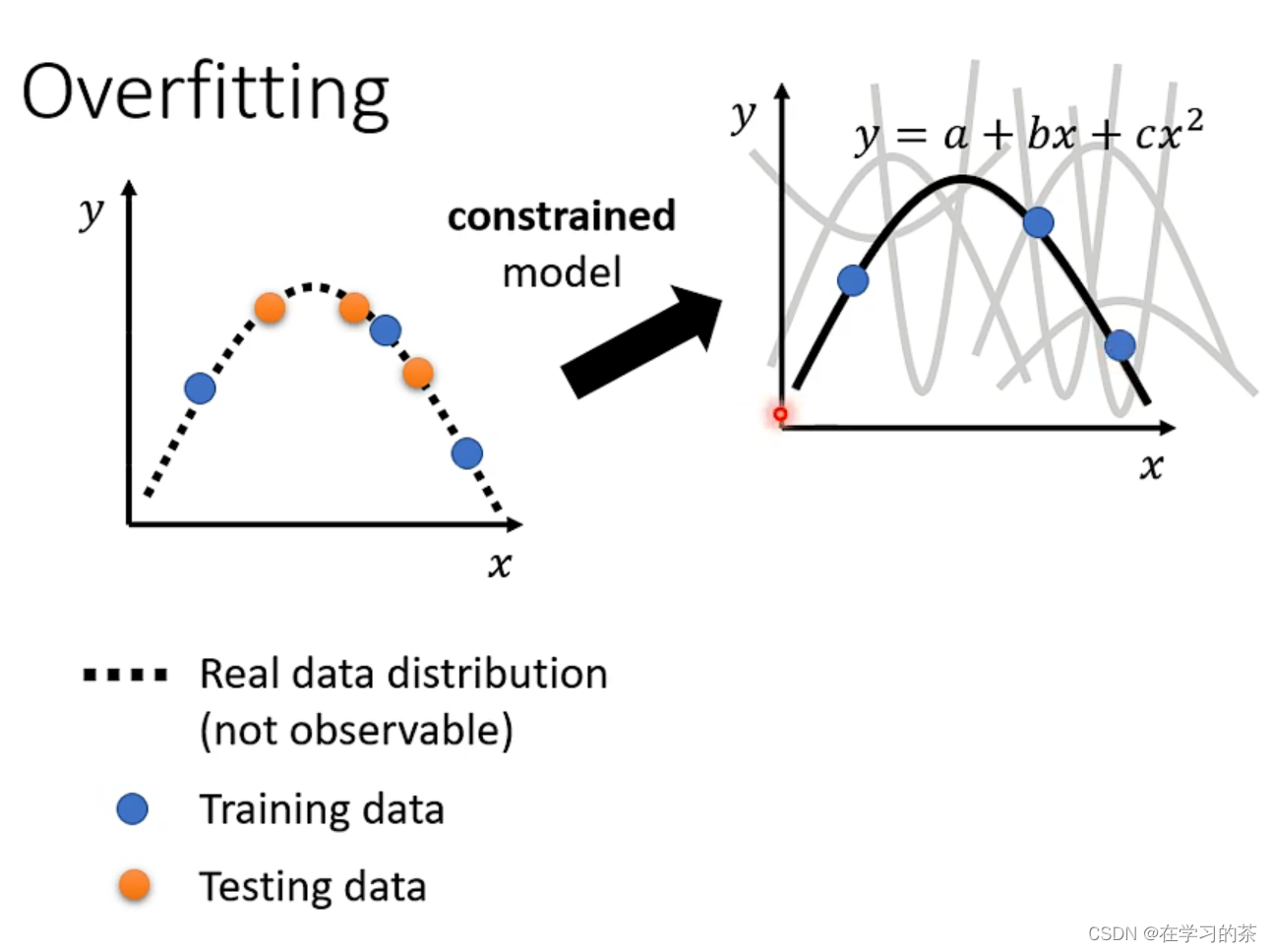

②规定模型,如定义二次曲线

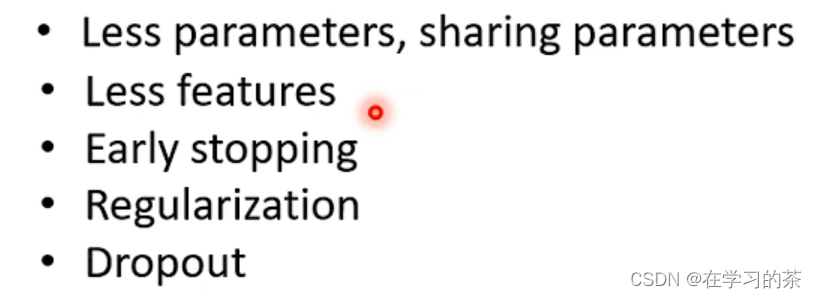

第二类方法是限制Model,我们还可以有如下方法限制Model:给少量神经元数目或使神经元共用参数如CNN(限制模型,如图像模型)

具体方法还有下面

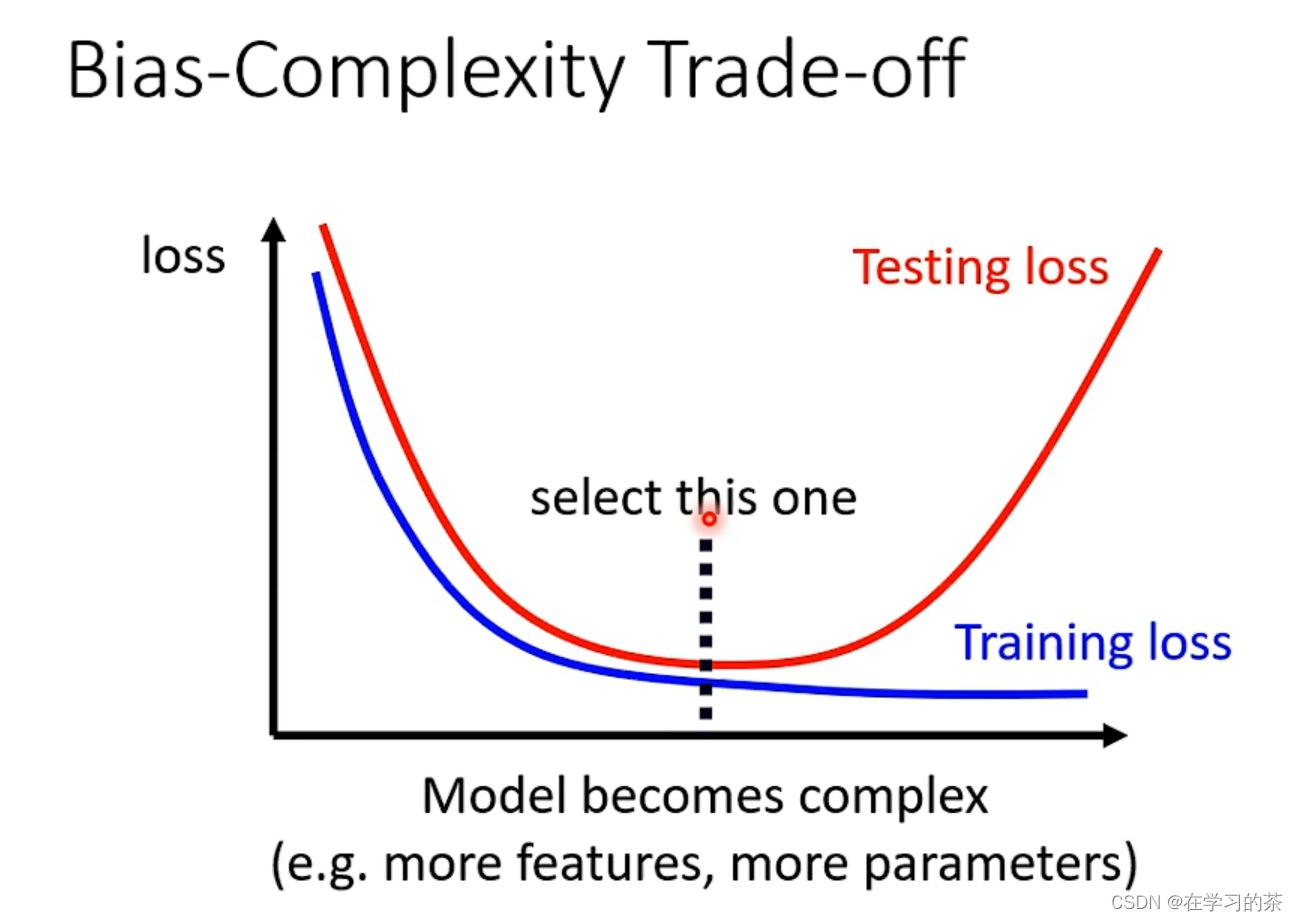

给出一个模型复杂度和Loss的关系

我们很容易发现,并不是模型越复杂(参数,变量过多)Test loss就越好,最好的是一个恰当的点

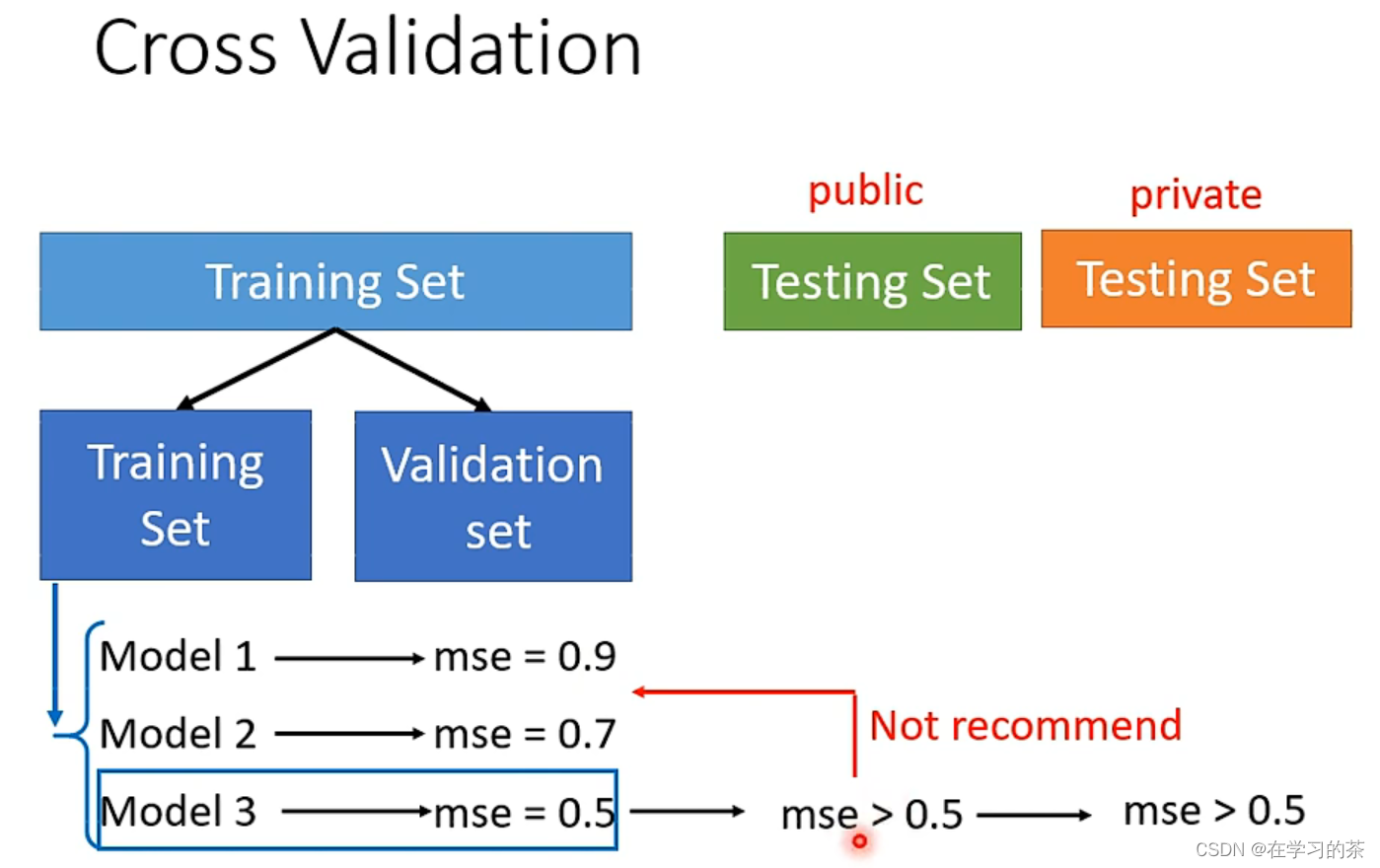

再说一下数据集分类

把训练集分为训练和验证集评估好坏

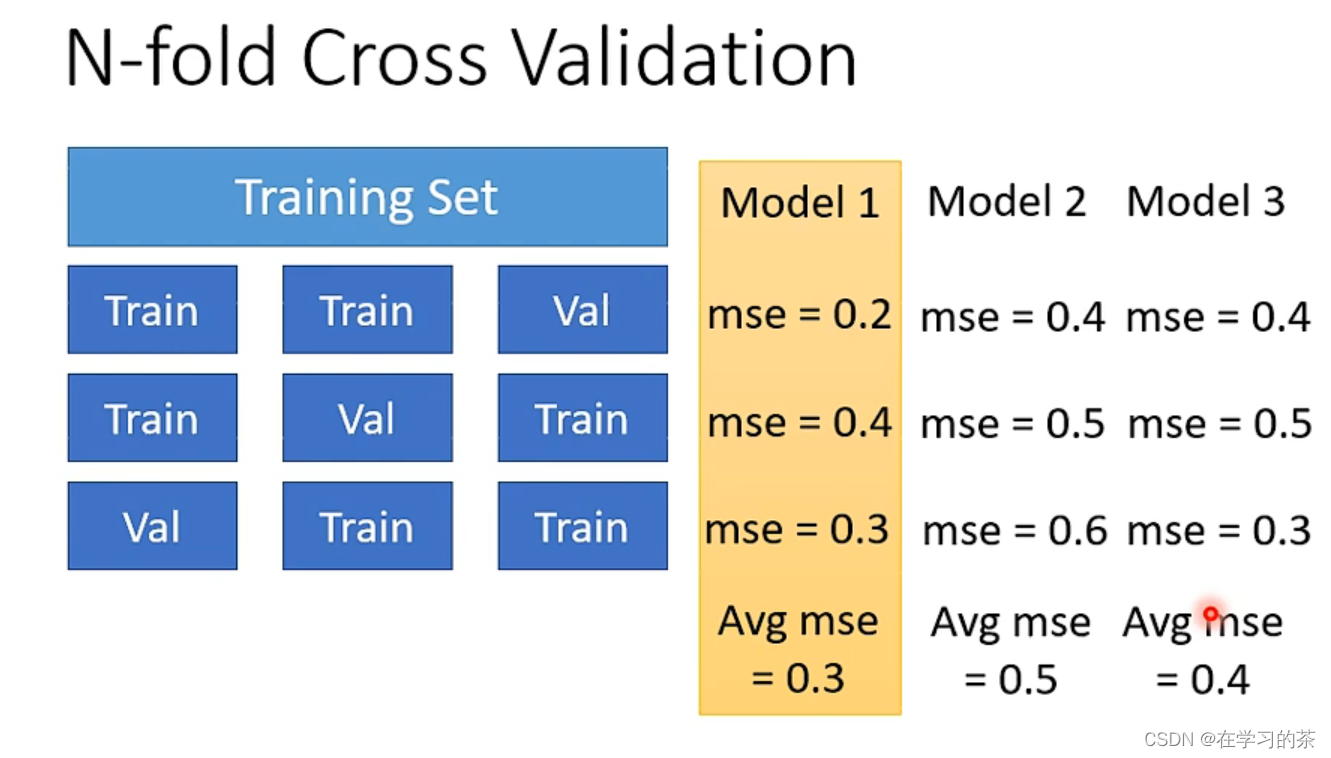

当然也可以用随机森林的思想,如下

随机验证集进行MSE检验Model

本文回顾了机器学习过程中欠拟合和局部最小值的问题。欠拟合可通过增加模型参数或使用深度学习解决;局部最小值可能导致优化问题,解决方案包括增加训练集或限制模型复杂度。通过模型复杂度与Loss的关系图,强调找到适中模型的重要性。数据集管理上,建议将训练集划分为训练和验证集,以及使用随机验证集评估模型性能。

本文回顾了机器学习过程中欠拟合和局部最小值的问题。欠拟合可通过增加模型参数或使用深度学习解决;局部最小值可能导致优化问题,解决方案包括增加训练集或限制模型复杂度。通过模型复杂度与Loss的关系图,强调找到适中模型的重要性。数据集管理上,建议将训练集划分为训练和验证集,以及使用随机验证集评估模型性能。

1371

1371

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?