【莫烦Python】PyTorch 神经网络_哔哩哔哩_bilibili https://www.bilibili.com/video/BV1Vx411j7kT?p=7

https://www.bilibili.com/video/BV1Vx411j7kT?p=7

.ToTensor():

![]()

transf = transforms.ToTensor()

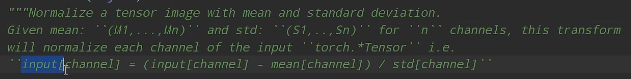

img_tensor = transf(img).Normalize((0.5,0.5,0.5),(0.5,0.5,0.5)):

均值和标准差

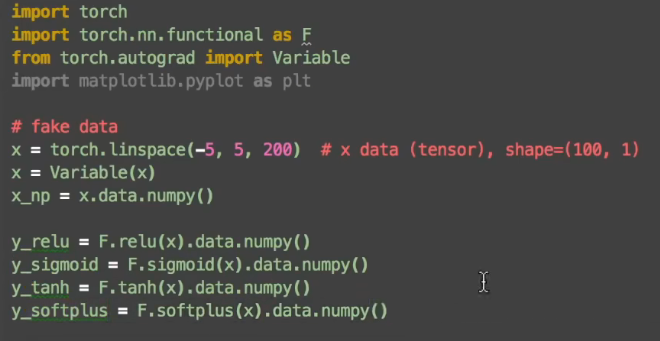

之前版本导入激活函数:

import torch.nn.functional as F

x = F.relu(self.conv1(x)) 现在直接:

import torch.nn as nn

nn.Conv2d(input_c, branch_features, kernel_size=1, stride=1, padding=0, bias=False),

nn.BatchNorm2d(branch_features),

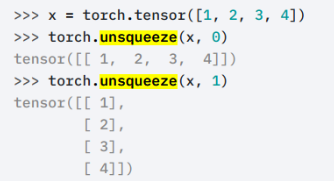

nn.ReLU(inplace=True)torch.unsqueeze(): 扩展维度

返回一个新的张量,对输入的既定位置插入维度1

torch.squeeze(): 压缩维度

返回一个新的张量,对输入的既定位置减少维度1,减少一个[]

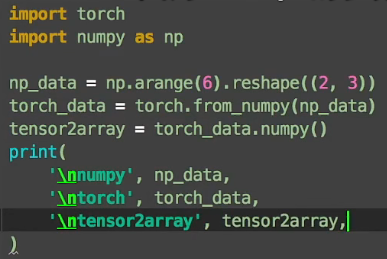

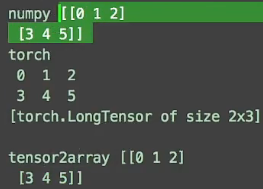

类型转换:

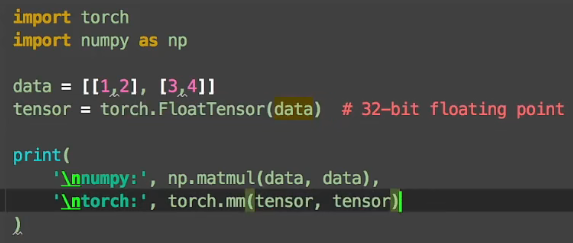

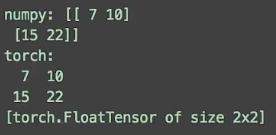

矩阵相乘:

np中可以 A = np.array(data) A.dot(B)

定义变量和是否记录反向传播路径:

variable和tensor合并,直接

tensor = torch.FloatTensor([[1,2],[3,4]])

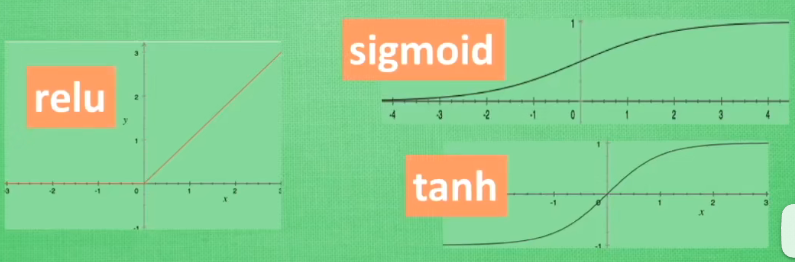

variable = tensor.requires_grad_(requires_grad = True)激活函数activation functions:使得输出结果具有非线性特征

该教程介绍了PyTorch中神经网络的数据预处理步骤,包括ToTensor()转换和Normalize()的使用,以及如何导入和应用激活函数。内容涵盖了张量维度操作如unsqueeze()和squeeze(),并讨论了矩阵相乘和变量定义。此外,还涉及了神经网络构建中的卷积层、批量归一化和ReLU激活函数的应用。

该教程介绍了PyTorch中神经网络的数据预处理步骤,包括ToTensor()转换和Normalize()的使用,以及如何导入和应用激活函数。内容涵盖了张量维度操作如unsqueeze()和squeeze(),并讨论了矩阵相乘和变量定义。此外,还涉及了神经网络构建中的卷积层、批量归一化和ReLU激活函数的应用。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?