基于知识蒸馏的神经网络人脸标志点检测

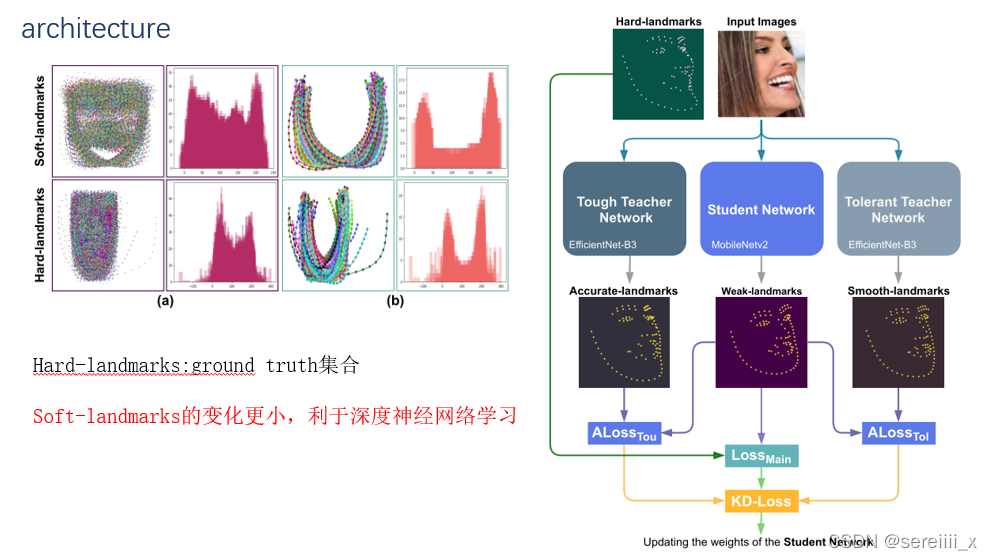

(a)显示了所有面部关键点的分布,为了更好的可视化,在(b)中只显示属于面部边界的关键点。

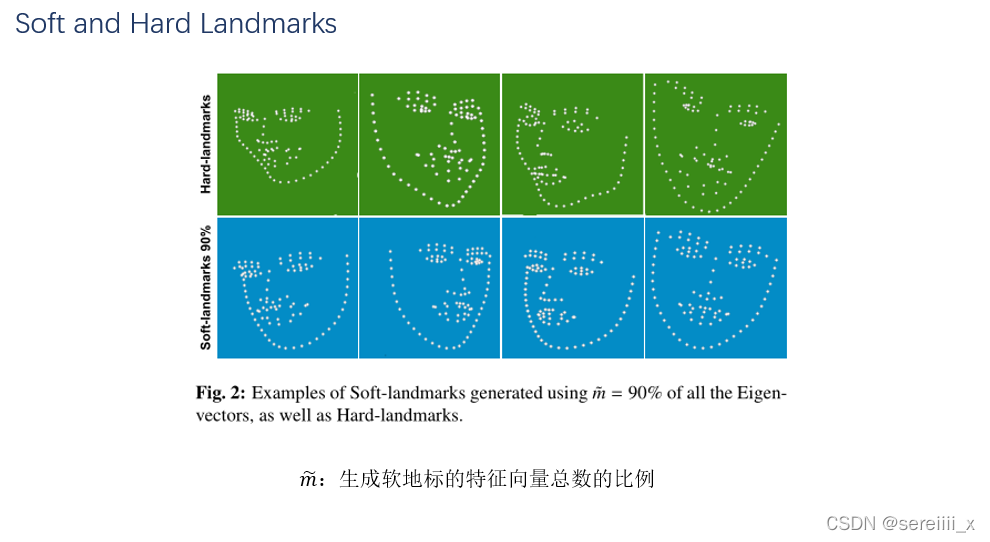

与原始的hard-landmarks相比,soft-landmarks的精度较低,但更容易预测

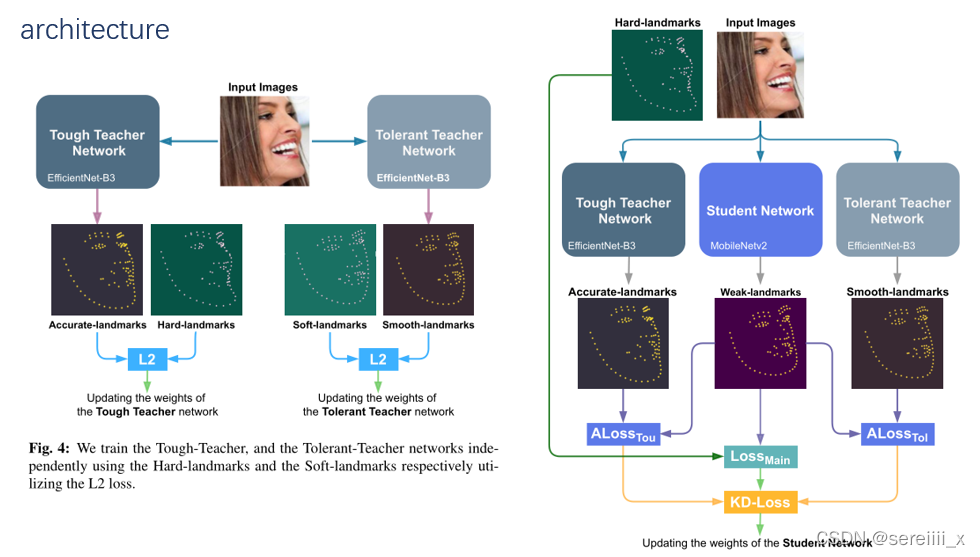

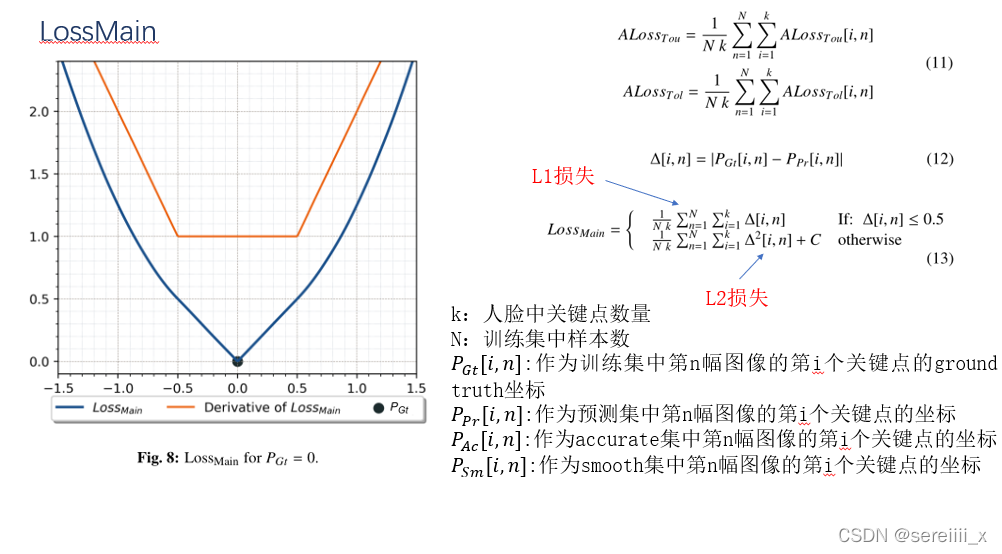

使用L2损失函数独立训练两个teacher网络

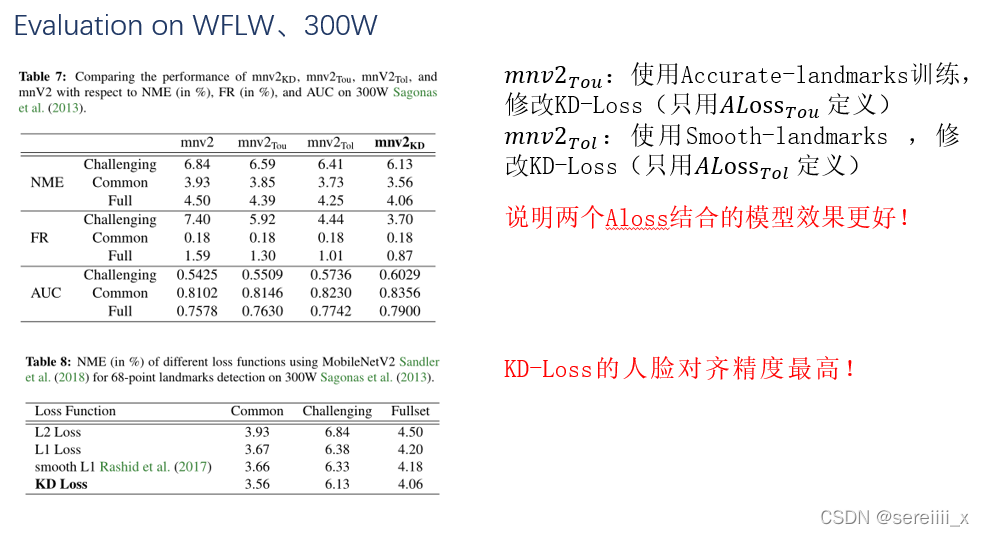

第二阶段,使用KD-Loss训练学生网络。更具体地说,KD-Loss使用由两个教师网络生成的地标点来指导学生更准确地学习面孔对齐任务。

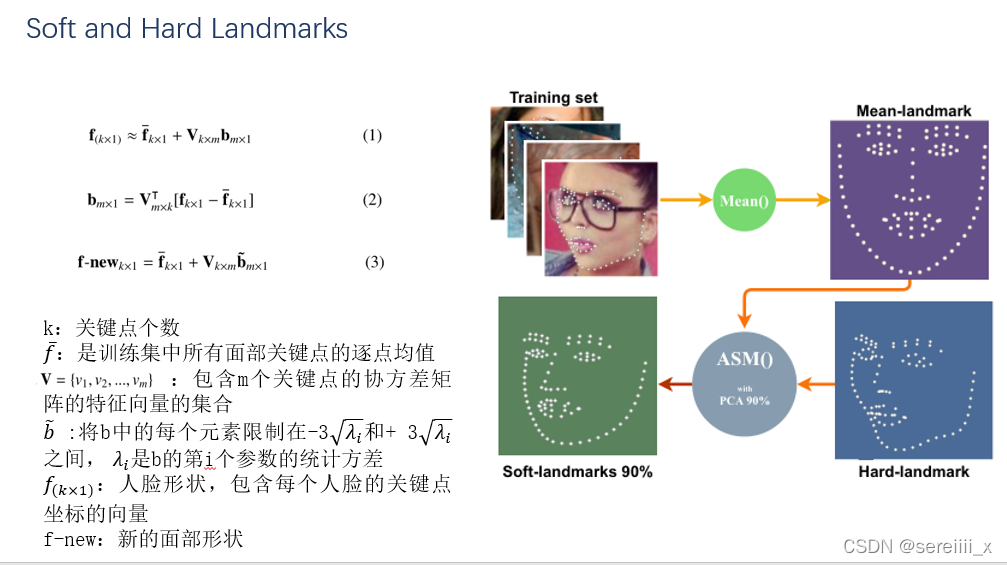

公式123生成soft-landmarks

参数m越小,我们用来创建f-new的特征向量就越少,因此,生成的f-new变得更类似于Mean-landmark。

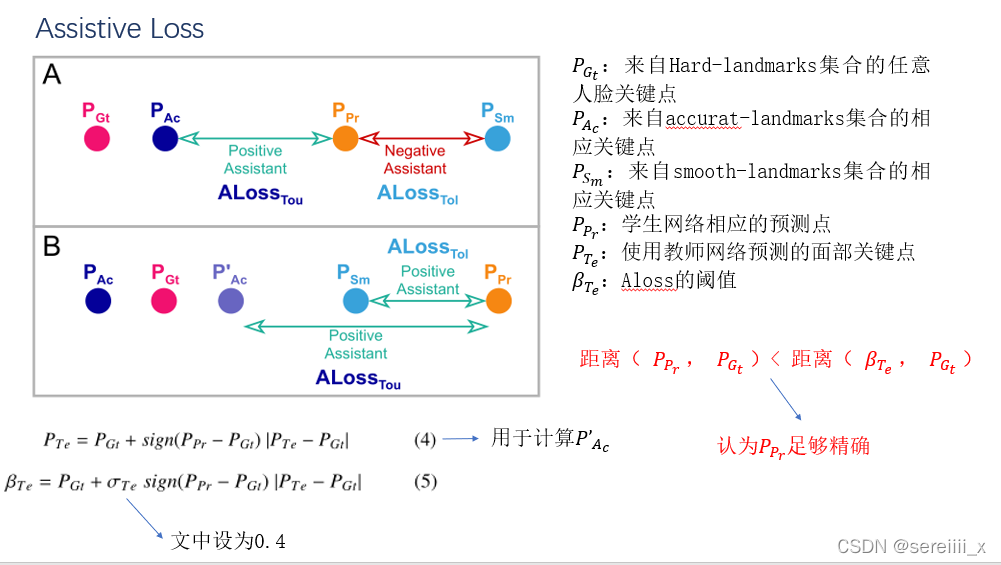

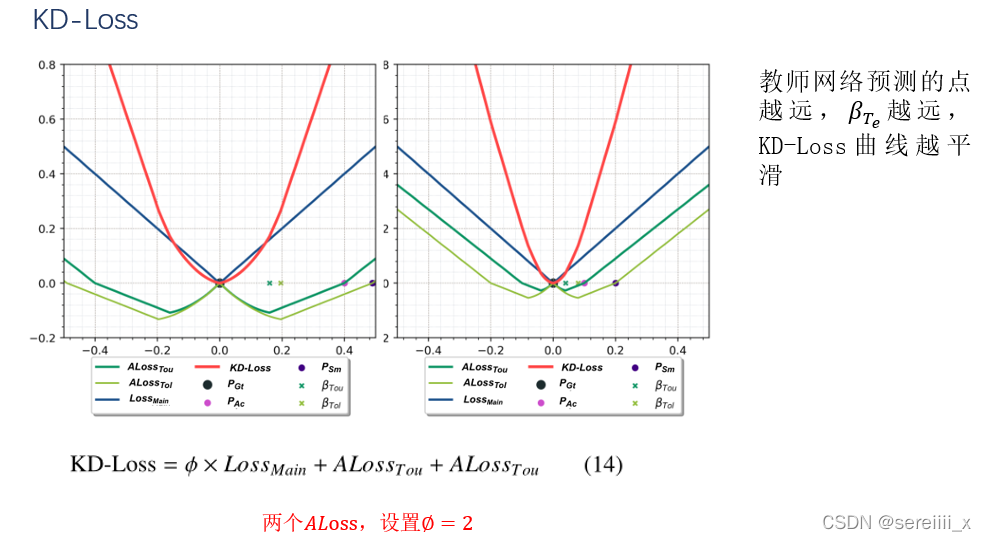

(辅助损失)

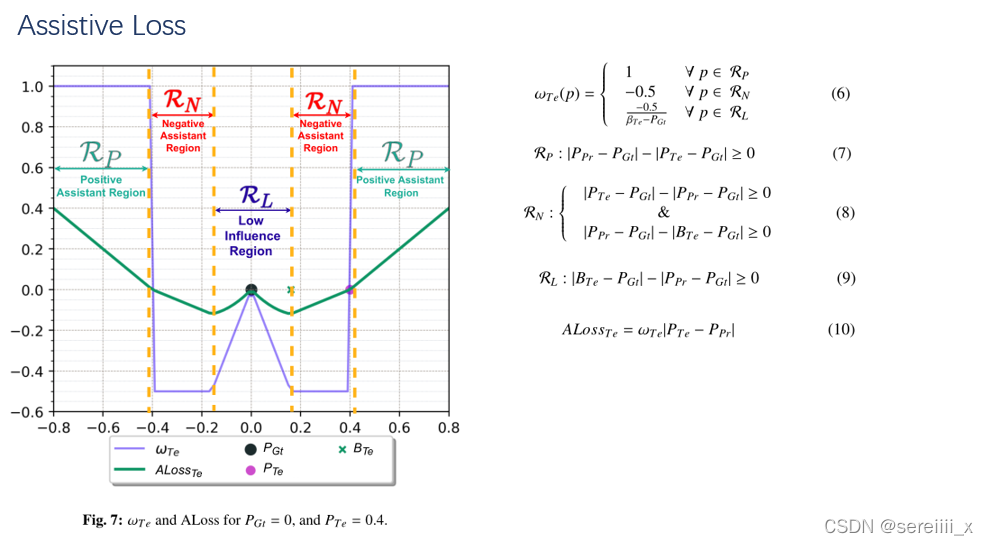

根据PAc的位置分为A、B两种情况,辅助损失函数可以为正辅助或为负辅助

(ALoss使用每个Teacher网络预测的面部关键点来引导Student网络走向ground truth)

Bte的位置:0.4*0.4=0.16

在Bte处,Aloss损失函数最小

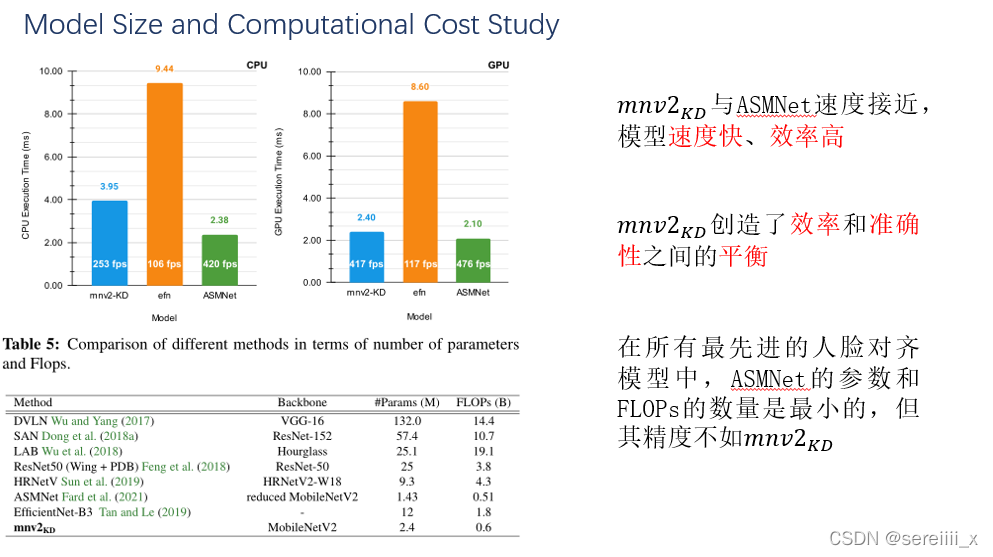

FLOPs 是floating point of operations的缩写,是浮点运算次数,可以用来衡量算法/模型复杂度。

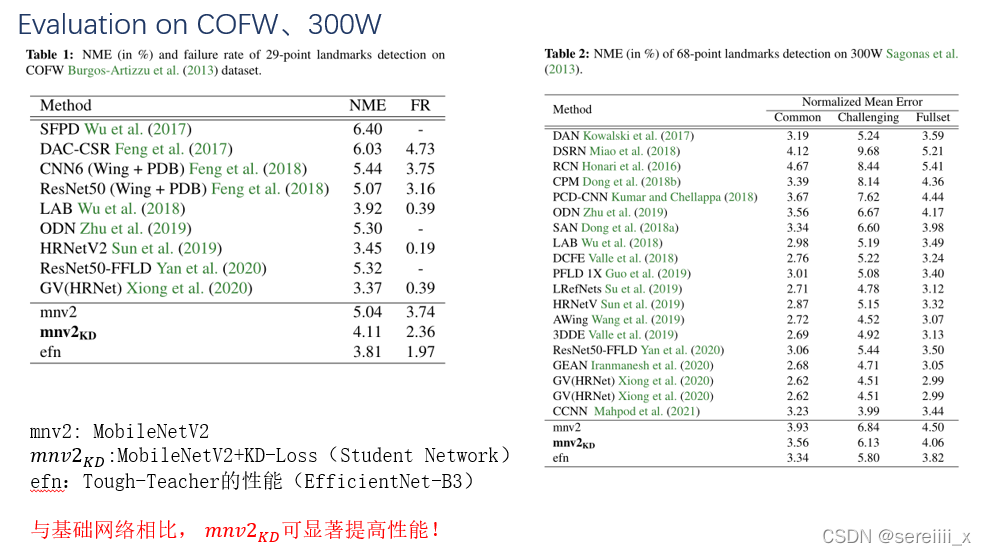

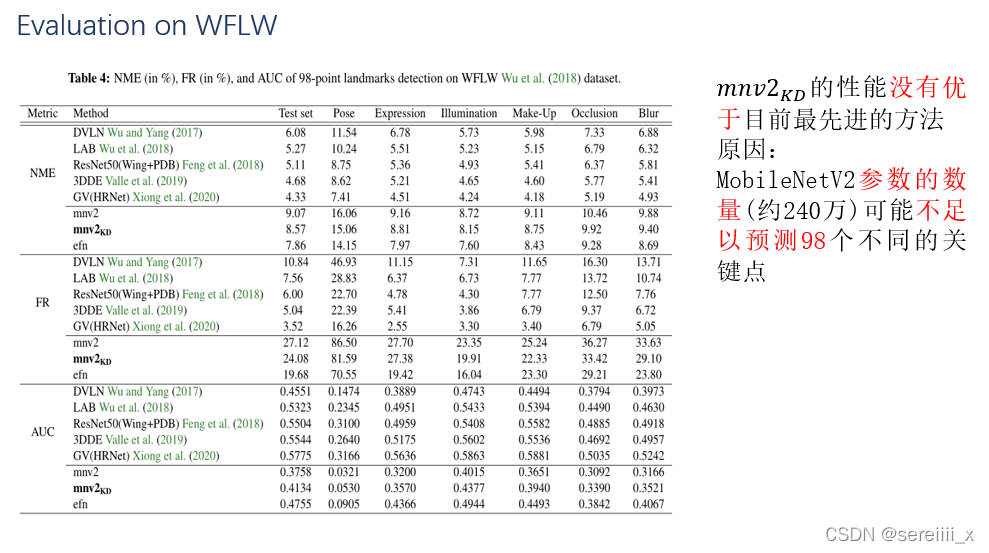

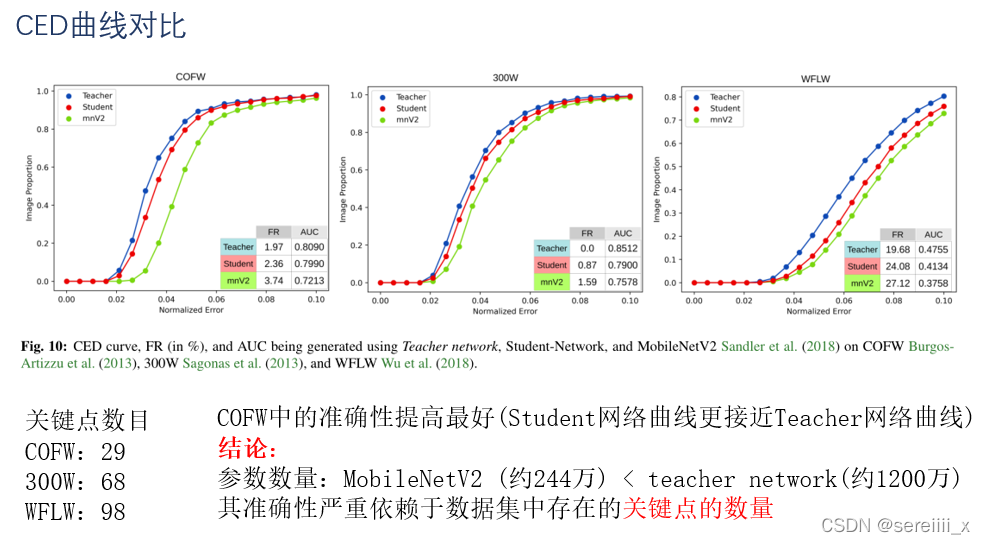

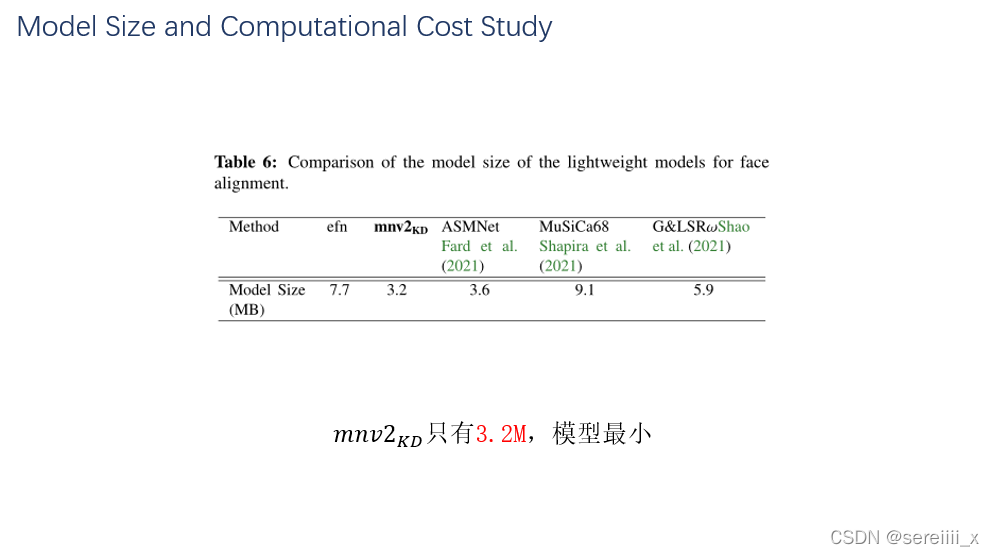

模型大小很大程度上依赖于将模型图形加载到内存(GPU或RAM)的时间。因此,我们的mnv2KD可以被认为比表6中报告的其他方法更有效(就模型大小而言)。

本文探讨了如何通过基于知识蒸馏的方法改进神经网络人脸标志点检测,利用soft-landmarks和KD-Loss提高模型的准确性。通过两阶段训练,首先独立训练教师网络,然后学生网络借助教师生成的软地标进行学习,同时结合辅助损失优化关键点定位。文章还提及了模型的FLOPs效率和模型大小的优势。

本文探讨了如何通过基于知识蒸馏的方法改进神经网络人脸标志点检测,利用soft-landmarks和KD-Loss提高模型的准确性。通过两阶段训练,首先独立训练教师网络,然后学生网络借助教师生成的软地标进行学习,同时结合辅助损失优化关键点定位。文章还提及了模型的FLOPs效率和模型大小的优势。

1632

1632

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?