Gradient Descent (机器学习中的第三个步骤)

目标:找一个最好的函数来解决最优化问题(optimization problem)

(机器学习的第二步中,定了一个loss function(function的function)能评价找到的function有多不好)

我们首先随机选择loss fuction的参数,并求其偏微分,求得方向 逐步得到目标参数

在这个过程中 会出现一些问题

- learning rate的设置

可用Adagrad - Stochastic Descent(随机梯度下降)

每看到一个样本就更新一次参数=》速度快 - Feature Scaling(特征缩放)

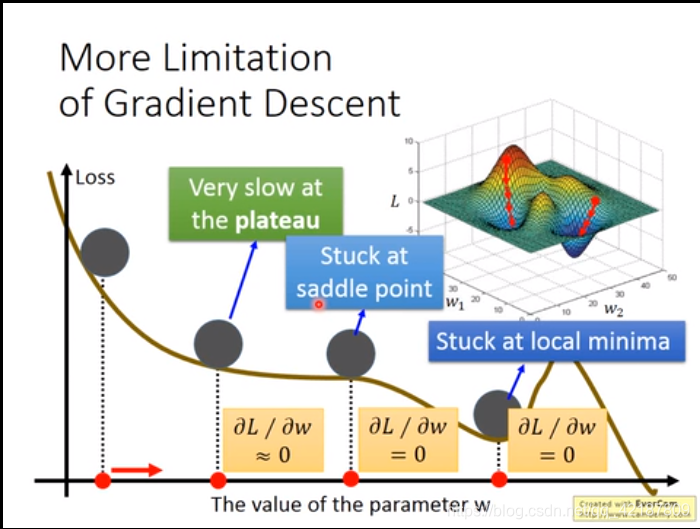

局限:卡在微分为0的地方

本文介绍机器学习中的梯度下降算法,该算法作为机器学习第三步骤,旨在寻找最优函数以解决优化问题。通过设定损失函数并随机选取参数进行偏微分求解,逐步逼近目标参数。文章讨论了学习率设置及使用Adagrad等方法调整的问题,并提到了随机梯度下降等变种方法。

本文介绍机器学习中的梯度下降算法,该算法作为机器学习第三步骤,旨在寻找最优函数以解决优化问题。通过设定损失函数并随机选取参数进行偏微分求解,逐步逼近目标参数。文章讨论了学习率设置及使用Adagrad等方法调整的问题,并提到了随机梯度下降等变种方法。

632

632

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?