bilibili视频评论翻页逻辑

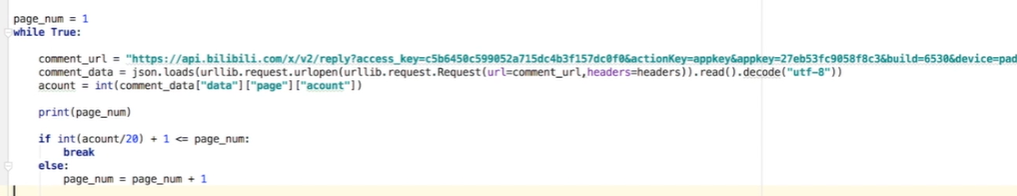

翻页功能 (Android App抓包 不是web端 但原理都适用)

设 1. 总评论数y

2. 第几页(当前爬到第几页)z

利用 z小于等于y就会有数据的逻辑

一页20条数据 发一页的请求拿20条数据

int(y/20)+1<=z 为真 break 为假 继续z+1 则继续发送页请求

因为int(4001/20)+1永远等于201页 而当前页数z范围在1-201

num: 2, size(一页20条): 20, count: 1626, acount(总评论数): 4001

664

664

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?