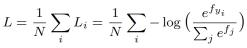

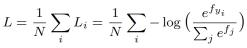

原始的softmax的loss损失是一个交叉熵损失:

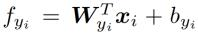

其中:

将其代入第一个式子,得出了损失函数如下,

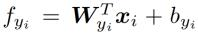

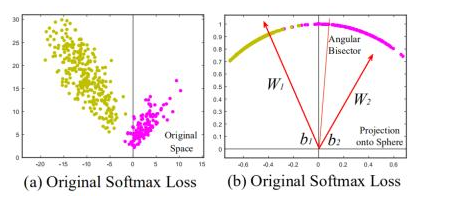

原始Softmax loss的特征分布结果:

进行归一化操作,将其都映射到一个单位球面上

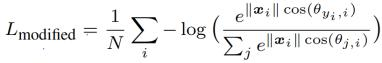

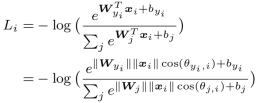

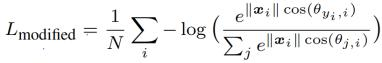

令||W||=1,b=0,并且引入夹角,得出Modified Softmax Loss公式如下:

Modified Softmax Loss的特征分布结果

原始的softmax的loss损失是一个交叉熵损失:

其中:

将其代入第一个式子,得出了损失函数如下,

原始Softmax loss的特征分布结果:

进行归一化操作,将其都映射到一个单位球面上

令||W||=1,b=0,并且引入夹角,得出Modified Softmax Loss公式如下:

Modified Softmax Loss的特征分布结果

3946

3946

543

543

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?