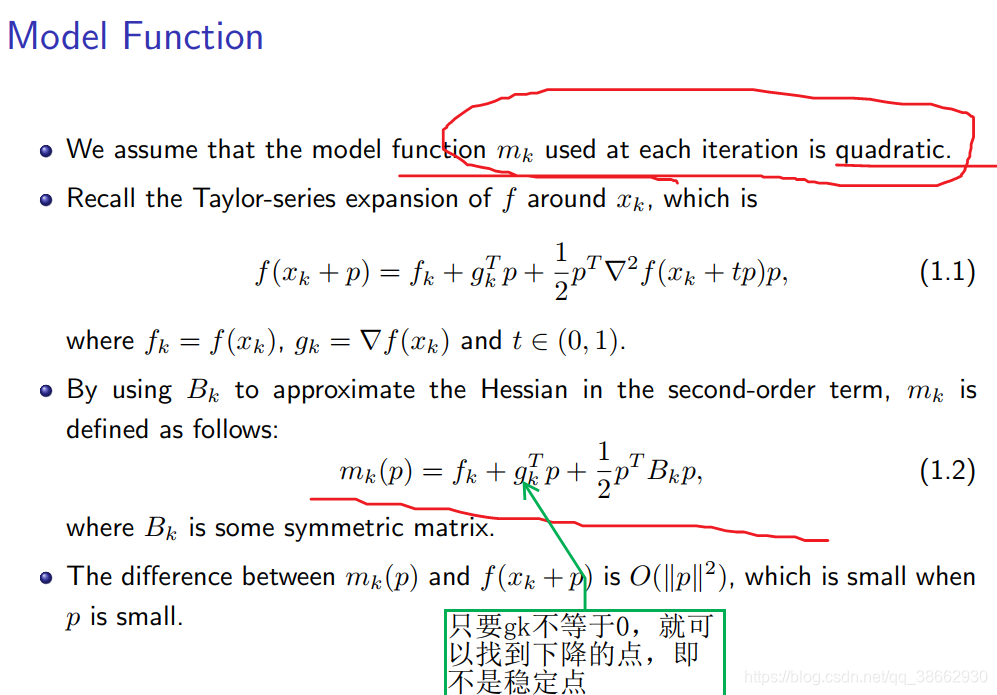

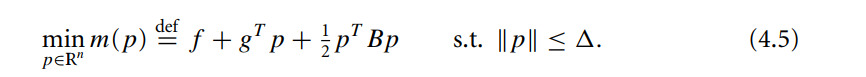

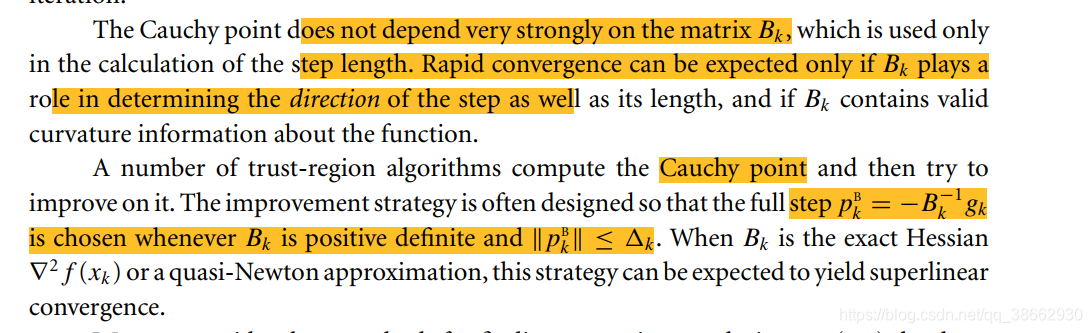

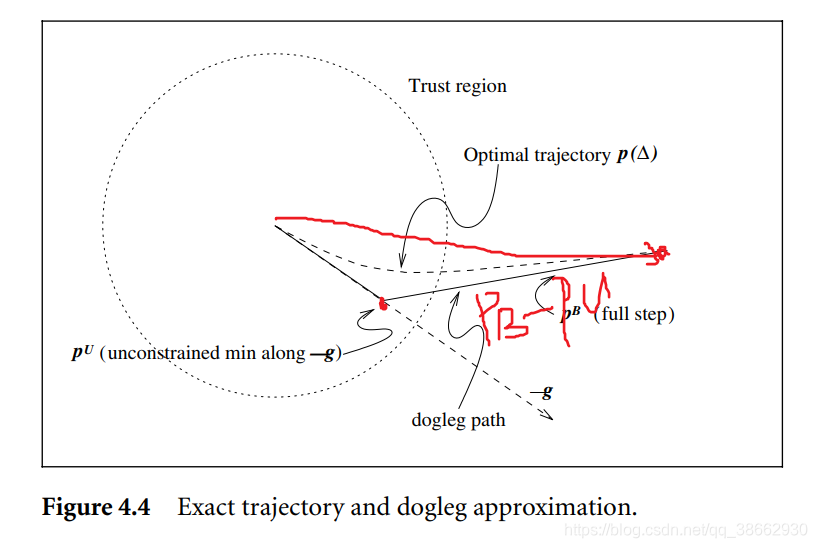

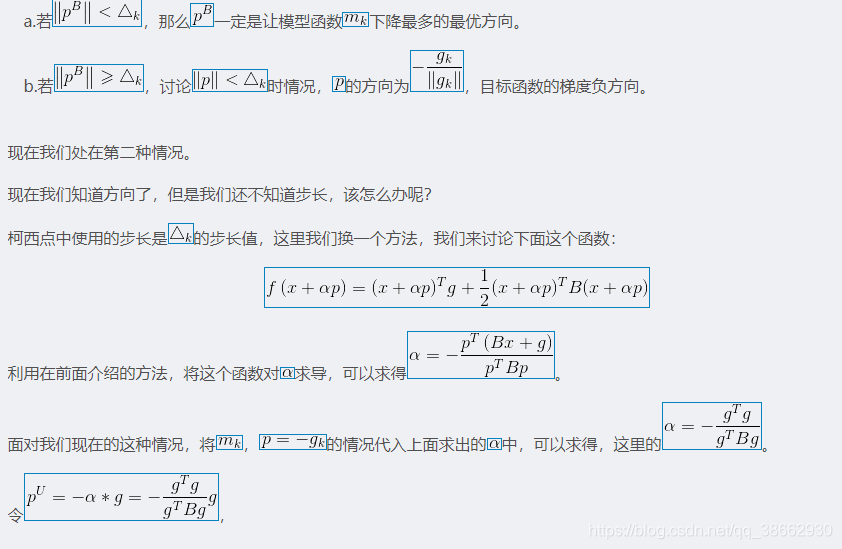

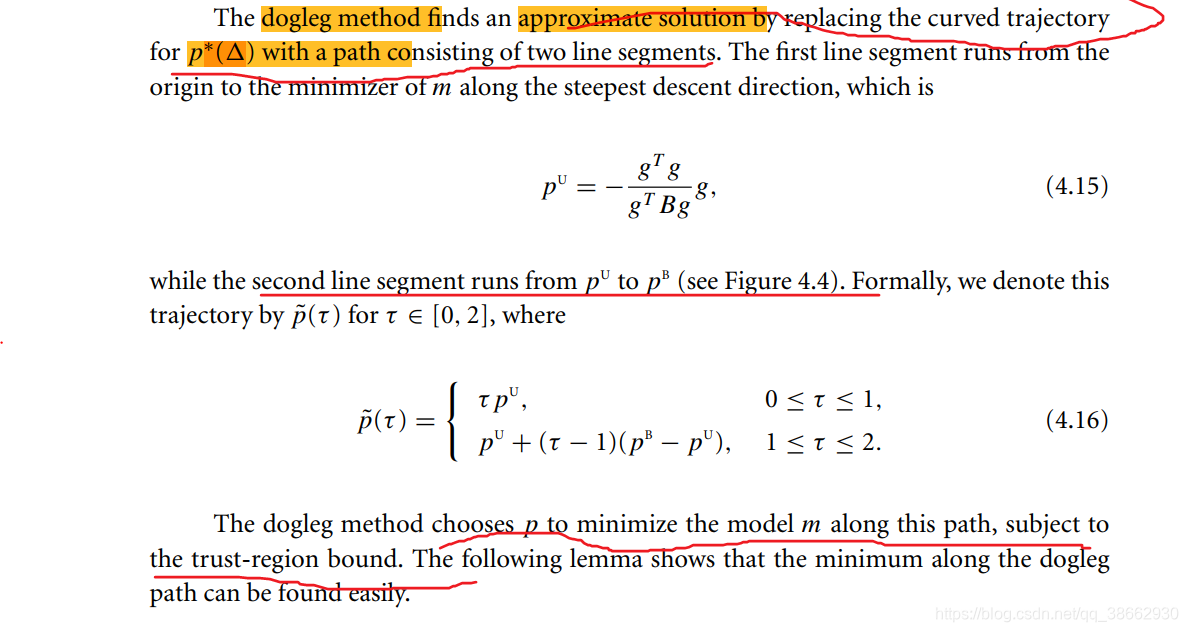

上文中提到的近似柯西方向是延梯度方向下降一定步长,但是没有充分利用B矩阵,为此DOgleg 方法,当PB在信赖域中时利用PB,否则的话利用梯度方向下降一定步长,并且下降步长的计算方法也有所不同:

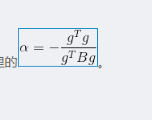

在柯西方法中是

τ

Δ

/

∣

∣

g

∣

∣

\tau\Delta/||g||

τΔ/∣∣g∣∣,而Dogleg 中下降步长

a

=

−

g

T

g

g

T

B

g

a=-\frac{g^Tg}{g^TBg}

a=−gTBggTg

P

k

B

P_k^B

PkB是全局最优点,如果其在可行域当中的话,理所当然,我们应将它作为更新步

省支二次项后沿梯度方向下降最快,下降步长为

Δ

\Delta

Δ

说明:令

f

=

x

g

T

+

1

2

x

T

B

x

f=xg^T+\frac{1}{2}x^TBx

f=xgT+21xTBx 记

g

=

d

f

d

x

=

g

+

B

T

x

g=\frac{df}{dx}=g+B^Tx

g=dxdf=g+BTx,可以计算出

P

U

P^U

PU

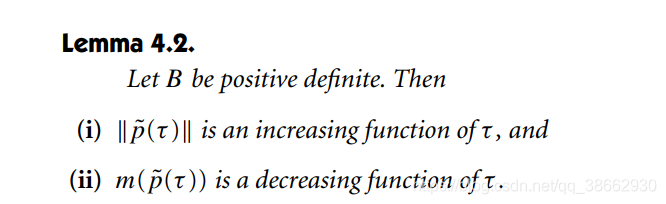

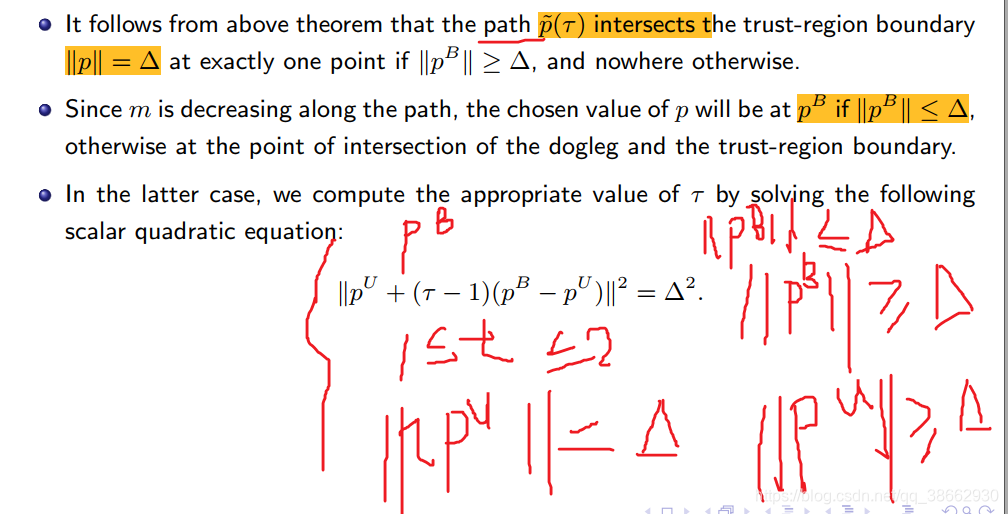

由引理知,当

P

(

τ

)

P(\tau)

P(τ)与信赖域相交时(),则取得最优的

P

(

τ

)

P(\tau)

P(τ)

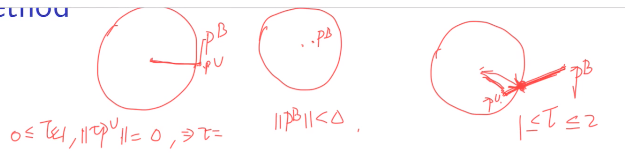

因此以下有三种情况:即PU在外部,PB在内部,PB在外部且PU在内部

部分来源于

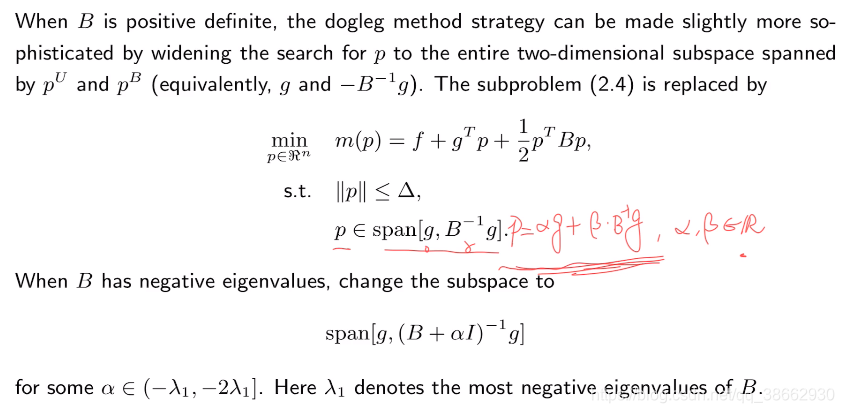

拓展:二维子空间方法:即在

P

U

P^U

PU,

P

B

P^B

PB形成的子空间中,寻找最佳的P,

未知量是关于

β

,

α

\beta,\alpha

β,α,代入目标函数中,求出这两个变量便可以求出最佳的P,由于在空间中搜索,待定的P的选择性增多

本文深入探讨了Dogleg方法在优化算法中的应用,特别是在梯度下降和信赖域算法的结合上。文章对比了Dogleg方法与柯西方法在下降步长计算上的不同,详细解释了Dogleg方法如何选择更优的下降方向,以及在不同情况下如何确定最佳的下降步长。

本文深入探讨了Dogleg方法在优化算法中的应用,特别是在梯度下降和信赖域算法的结合上。文章对比了Dogleg方法与柯西方法在下降步长计算上的不同,详细解释了Dogleg方法如何选择更优的下降方向,以及在不同情况下如何确定最佳的下降步长。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?