目录

1. 量化的作用

量化将网络中主要算子(卷积)由原先的浮点计算转成低精度的Int8计算,减少模型大小并提升性能

2. 编译

(1) 编译宏

编译MNN时开启 MNN_BUILD_QUANTOOLS 宏,即开启量化工具的编译

(2) 编译产物

量化模型的工具: quantized.out

量化模型与浮点模型的对比工具:testQuanModel.out

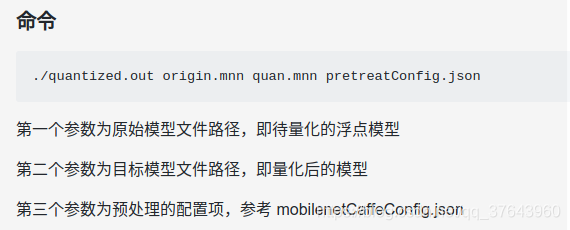

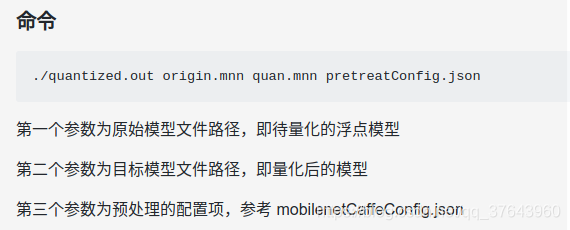

3. 量化工具的使用

cd MNN/build ./quantized.out ../benchmark/models/

目录

量化将网络中主要算子(卷积)由原先的浮点计算转成低精度的Int8计算,减少模型大小并提升性能

(1) 编译宏

编译MNN时开启 MNN_BUILD_QUANTOOLS 宏,即开启量化工具的编译

(2) 编译产物

量化模型的工具: quantized.out

量化模型与浮点模型的对比工具:testQuanModel.out

cd MNN/build ./quantized.out ../benchmark/models/

1680

1680

1946

1946

890

890

1008

1008

558

558

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?