《PyTorch 深度学习实践》–线性模型

《PyTorch 深度学习实践》--线性模型

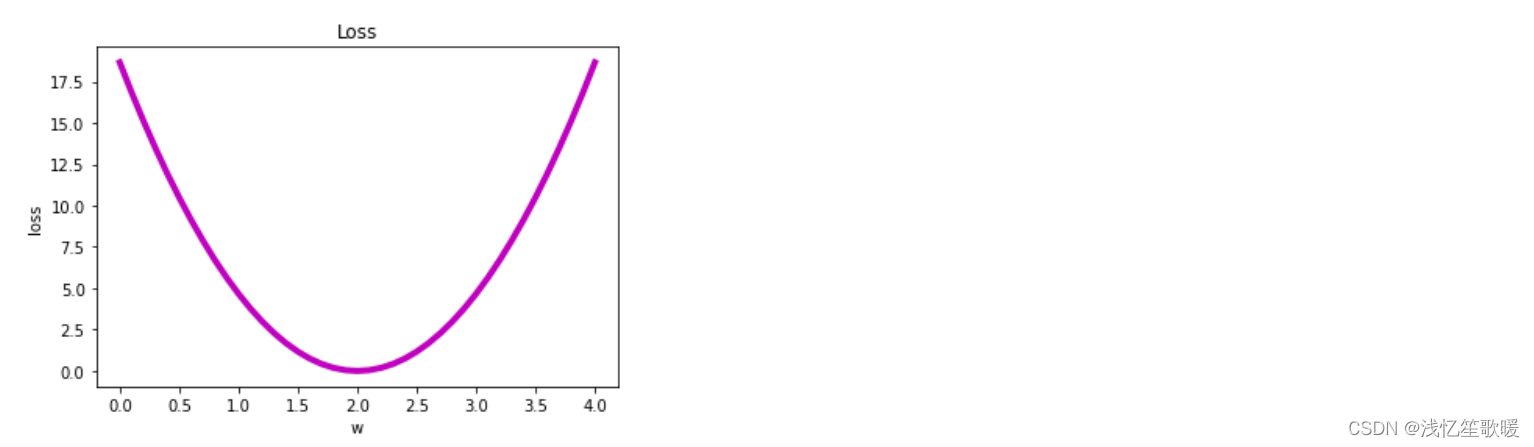

y=wx 代码实现

# 课堂练习

import numpy as np

import matplotlib.pyplot as plt

# step1 准备数据集

x_data=[1.0,2.0,3.0]

y_data=[2.0,4.0,6.0]

x_num=len(x_data) #样本总数

# step2 选择模型 y=wx

# 前向传播

def forward(x):

return w*x

# 定义损失函数

def loss(x,y):

y_pred=forward(x)

return (y_pred-y)**2

# step3 模型训练

w_list=[]

loss_list=[]

# 从0.0一直到4.1以0.1为间隔进行w的取值

for w in np.arange(0.0,4.1,0.1):

print('w={}'.format(w))

w_list.append(w)

loss_run=0

for x_val,y_val in zip(x_data,y_data):

y_pred=forward(x_val)

loss_run+=loss(x_val,y_val)

print('\t',x_val,y_val,y_pred,loss_run)

print('整体损失total_loss:{}'.format(loss_run/x_num))

loss_list.append(loss_run/x_num)

# 绘图

plt.figure()

plt.plot(w_list,loss_list,'m',linewidth=4)

plt.title('Loss')

plt.xlabel('w')

plt.ylabel('loss')

plt.show()

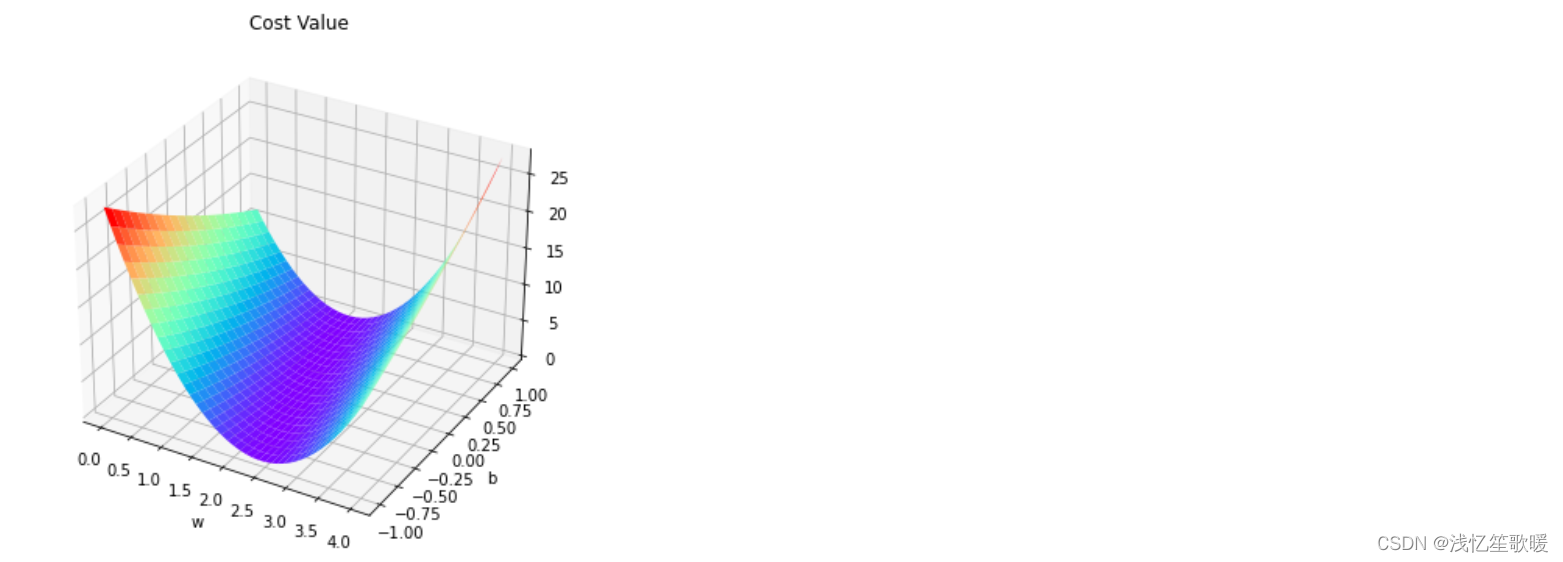

y=wx+b 代码实现

# 课后习题

import numpy as np

import matplotlib.pyplot as plt

# step1 准备数据集

x_data=[1.0,2.0,3.0]

y_data=[2.0,4.0,6.0]

x_num=len(x_data) #样本总数

# step2 选择模型 y=wx+b

# 前向传播

def forward(x):

return w*x+b

# 定义损失函数

def loss(x,y):

y_pred=forward(x)

return (y_pred-y)**2

# step3 模型训练

#构造二维网络 使用穷举法

W=np.arange(0.0,4.1,0.1)

B=np.arange(-1.0,1.1,0.1)

[w,b]=np.meshgrid(W,B)

loss_run=0

for x_val,y_val in zip(x_data,y_data):

y_pred=forward(x_val)

loss_run+=loss(x_val,y_val)

#引入 matplotlib 3D画图

fig=plt.figure(figsize=(10,6))

ax=fig.add_subplot(projection='3d')

ax.plot_surface(w,b,loss_run/x_num,rstride=1, # retride(row)指定行的跨度

cstride=1, # retride(column)指定列的跨度

cmap='rainbow') # 设置颜色映射

plt.xlabel('w')

plt.ylabel('b')

ax.set_title('Cost Value')

plt.show()

参考资料

《PyTorch 深度学习实践》: https://www.bilibili.com/video/BV1Y7411d7Ys?p=2&vd_source=435453f6c8cc1940667595c415308e92

该博客介绍了使用PyTorch实现线性模型的过程,包括y=wx和y=wx+b两种情况。首先,通过创建数据集,然后定义前向传播和损失函数,接着进行模型训练,展示不同w值下损失函数的变化。对于y=wx+b的情况,通过二维网格搜索穷举w和b的组合,并用3D图展示损失函数的表面,以直观理解参数对损失的影响。

该博客介绍了使用PyTorch实现线性模型的过程,包括y=wx和y=wx+b两种情况。首先,通过创建数据集,然后定义前向传播和损失函数,接着进行模型训练,展示不同w值下损失函数的变化。对于y=wx+b的情况,通过二维网格搜索穷举w和b的组合,并用3D图展示损失函数的表面,以直观理解参数对损失的影响。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?