翻译来自牛津大学cs课程 NLP的deep learning

github地址:https://github.com/oxford-cs-deepnlp-2017/lectures

视频课程地址:http://media.podcasts.ox.ac.uk/comlab/deep_learning_NLP/2017-01_deep_NLP_1b_friends.mp4

前言

接上一篇文章:

牛津大学CS课程_Deep learning for NLP https://blog.youkuaiyun.com/qq_35314511/article/details/86712670

P.S. 上一期忘记贴视频地址了,已经补上

距离上一期翻译过了很久,这段时间接了几个兼职项目,忙飞了。。。

本期是这门课的第二讲:Lecture 1b Deep Neural Networks Are Our Friends

这一期的老师是来自google deepmind的wang ling(我也不知道中文名)

上一期介绍了这门课所需的知识储备,数学啊机器学习什么什么的,以及目前nlp的几大板块(语音处理,机器翻译,图像理解,语义结构),这一期主要是介绍机器学习的基本概念。

1b的ppt和视频都很长,内容虽然很多,但是从浅到深铺垫的非常好,不过后半部分对数学功底的要求很高(我这个战五渣)!!!由于难度跨度非常大,这一讲我会按照ppt的2个part分2期翻译。这一期主要是视频前20分钟的内容,对应ppt前100页(Part I)。

尽管如此,本期的篇幅还是会相当~~相当~~~相当长,但我个人还是习惯于把总结和感想放在末尾。

如果我的文章能对你有帮助那就万分荣幸。

let’s go

Lecture 1b

内容概要

Part I - Neural Networks are our friends 第一部分 - 神经网络是我们的朋友

○ Numbers are our friends ○数字是我们的朋友

○ Variables are our friends ○变量是我们的朋友

○ Operators are our friends ○操作是我们的朋友

○ Functions are our friends ○函数是我们的朋友

○ Parameters are our friends ○参数是我们的朋友

○ Cost Functions are our friends ○成本函数是我们的朋友

○ Optimizers are our friends ○优化算法是我们的朋友

○ Gradients are our friends ○函数梯度是我们的朋友

Part 2 - Into Deep Learning 第二部分 - 进入深度学习

○ Nonlinear Neural Models ○非线性神经模型

○ Multilayer Perceptrons ○多层感知器

○ Using Discrete Variables ○使用离散变量

○ Example Applications ○示例应用程序

第一部分

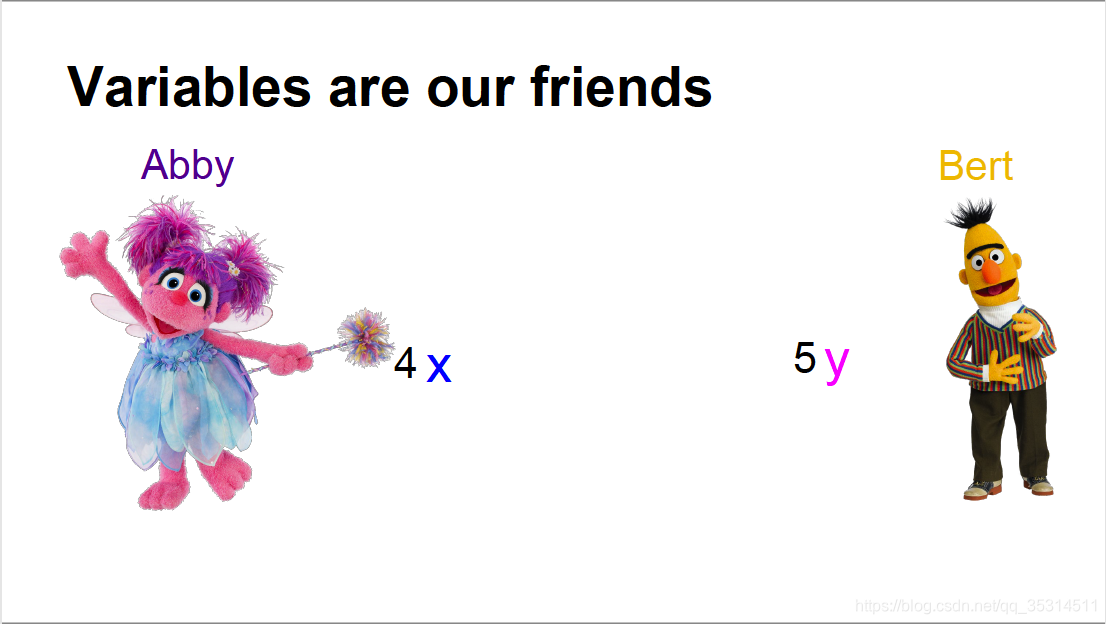

Abby 和 Bert 分别有4个苹果和5个香蕉(数字)

这里用x和y分别指代苹果和香蕉(变量)

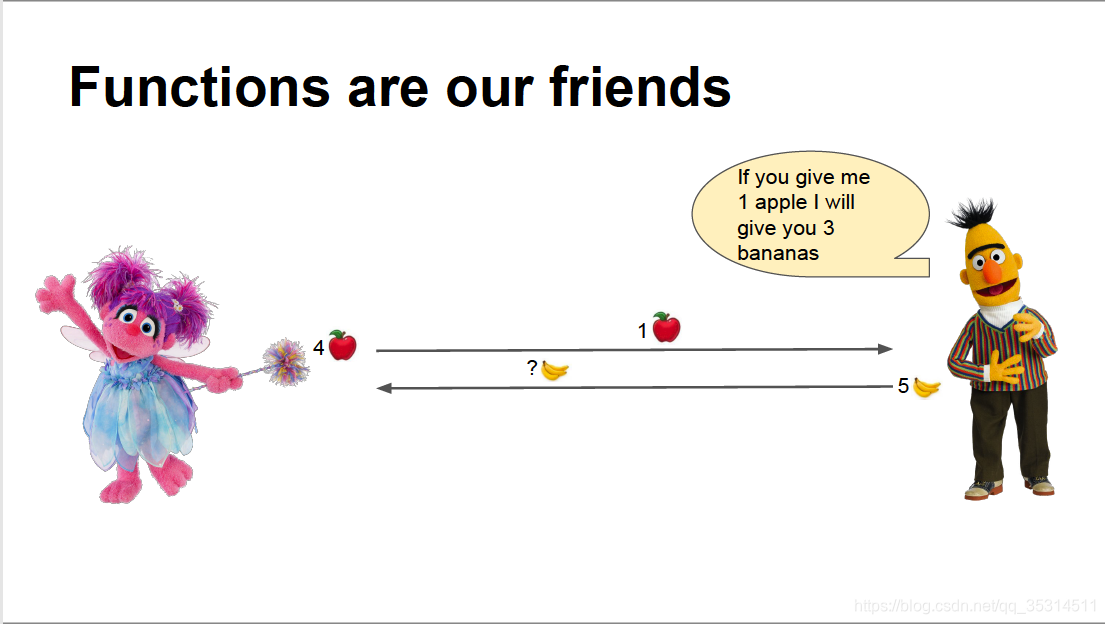

Abby给了Bert1个苹果,Ber就会t给Abby3个香蕉

到这里为止我们会轻易的得出结论函数 Y = 3 X Y = 3X Y=3X

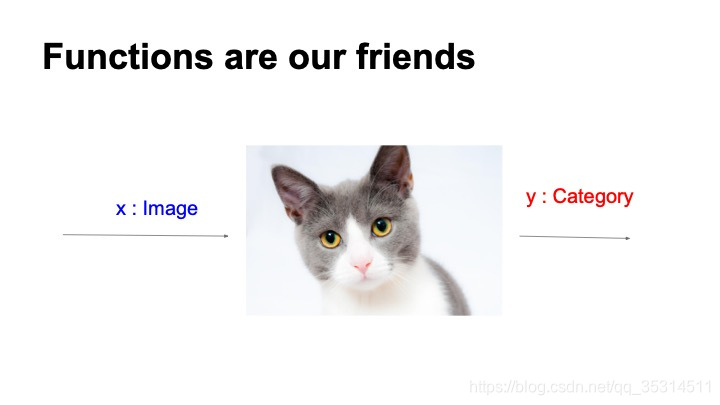

比如语言翻译,谷歌Alpha Go和图像识别都是经过X(输入)到Y(输出)的函数过程。

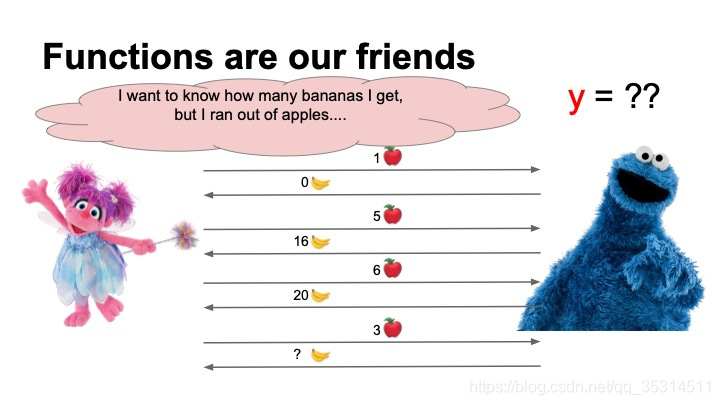

接下来要我们自己去找函数的规律

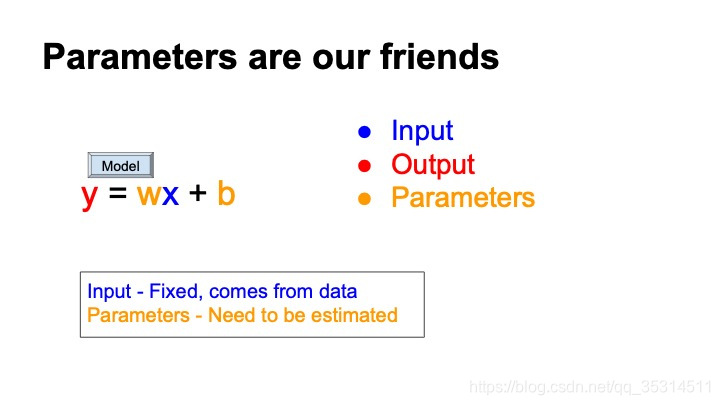

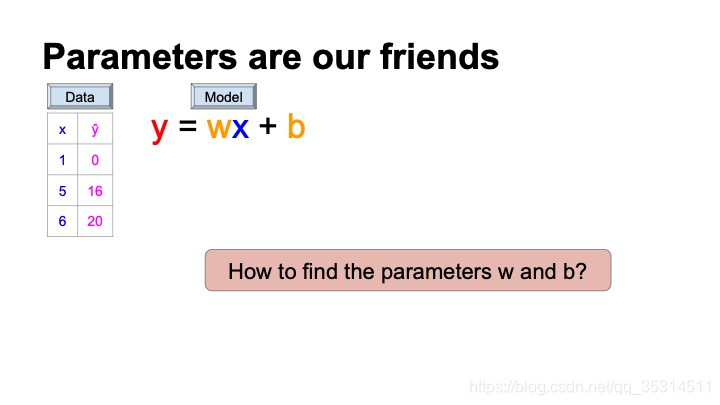

作为举例,我们用了一个线性函数的模型 y = w x + b y =wx + b y=wx+b

其中x是输入,y是输出,w和b是参数

输入来自我们的数据,是固定的;参数则是我们的系统要估算的;

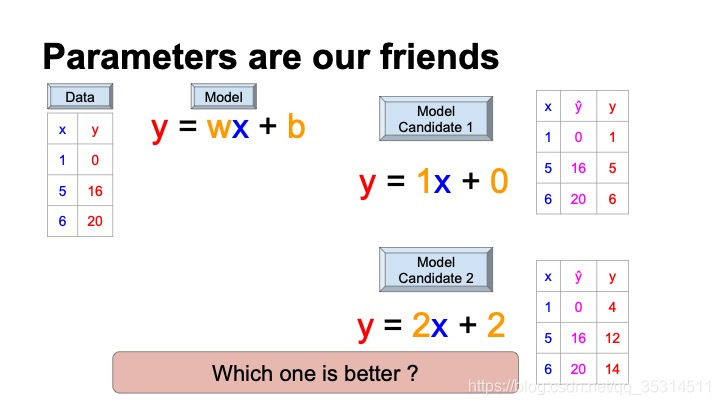

在这里我们有2个候选模型,判断候选模型的优劣的时候我们使用Cost function成本函数(方差的和)

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

669

669

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?