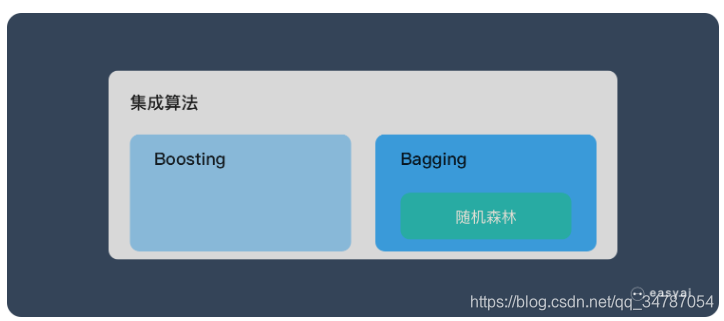

1.集成算法包括

2.构造随机森林的4个步骤

3.随机森林用于回归和分类

处理分类问题

对于测试样本,森林中每棵决策树会给出最终类别,最后综合考虑森林内每一棵决策树的输出类别,以投票方式来决定测试样本的类别

处理回归问题

以每棵决策树输出的均值为最终结果

4.随机森林的随机性

Ⅰ:样本的随机性,从训练集中随机抽取一定数量的样本,作为每颗决策树的根节点样本;

Ⅱ:属性的随机性,在建立每颗决策树时,随机抽取一定数量的候选属性,从中选择最合适的属性作为分裂节点。

5.采样和完全分裂

首先是两个随机采样的过程,随机森林对输入的数据要进行行、列的采样。

行采样,采用有放回的方式,也就是在采样得到的样本集合中,可能有重复的样本。

假设输入样本为N个,那么采样的样本也为N个。这样使得在训练的时候,每一棵树的输入样本都不是全部的样本,使得相对不容易出现过拟合over-fitting。

列采样,从M个feature中,选择m个(m << M)。之后就是对采样之后的数据使用完全分裂的方式建立出决策树,这样决策树的某一个叶子节点要么是无法继续分裂的,要么里面的所有样本的都是指向的同一个分类。

6.随机森林不用剪枝

由于之前的两个随机采样的过程保证了随机性,所以就算不剪枝,也不会出现over-fitting。

参考:

https://www.cnblogs.com/ahu-lichang/p/7392566.html

https://blog.youkuaiyun.com/weixin_43612023/article/details/100007338

随机森林是一种集成学习方法,包括样本的随机抽取和属性的随机选择。在处理分类问题时,通过投票决定测试样本的类别;处理回归问题时,取所有决策树预测值的均值作为结果。随机森林通过行、列采样避免过拟合,且不需剪枝。

随机森林是一种集成学习方法,包括样本的随机抽取和属性的随机选择。在处理分类问题时,通过投票决定测试样本的类别;处理回归问题时,取所有决策树预测值的均值作为结果。随机森林通过行、列采样避免过拟合,且不需剪枝。

3231

3231

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?