Adversarial Logit Pairing

we introduce enhanced defenses using a technique we call logit pairing, a method that encourages logits for pairs of examples to be similar.

本文提出了一种logit pairing方法做防御。

0. Recall

0.1 Adversarial Training

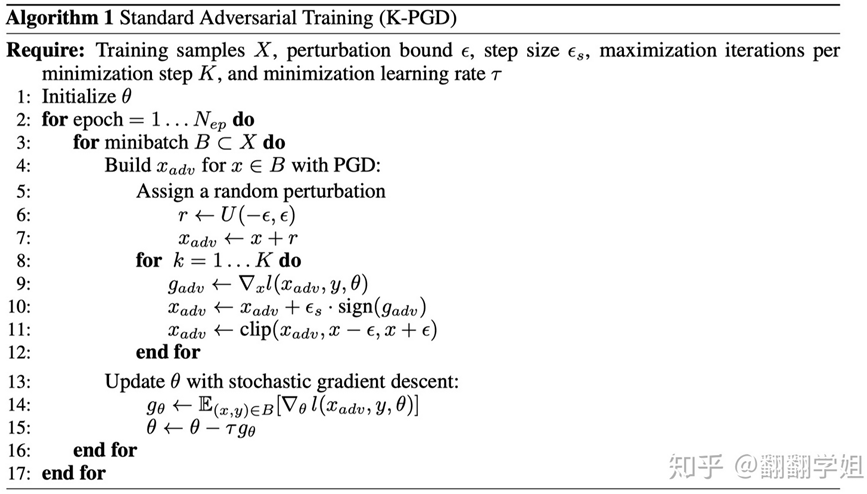

Algotirhm

图片来源见水印。

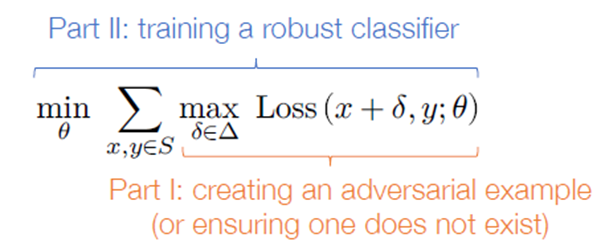

Formulation

0.2 FGSM and AT

在[Explaining and harnessing adversarial examples论文中,作者

- 提出了

FGSM; - 提出了对抗训练。

J ~ ( θ , x , y ) = α J ( θ , x , y ) + ( 1 − α ) J ( θ , x + ϵ sign ( ∇ x J ( θ , x , y ) ) \tilde{J}(\theta, x, y)=\alpha J(\theta, x, y)+(1-\alpha) J\left(\theta, x+\epsilon \operatorname{sign}\left(\nabla_{x} J(\theta, x, y)\right)\right. J~(θ,x,y)=αJ(θ,x,y)+(1−α)J(θ,x+ϵsign(∇xJ(θ,x,y))

1. Introduction

Contributions:

- 在大规模数据集(

ImageNet)上开展了对抗训练; - 提出了

Logit Pairing. 一种鼓励两对样本logit相似的方法。本文提出了两种logit pairing:clean and adversarial.(ALP和CLP) - 实验表明,使用本文提出的

CLP方法就能像对抗训练一样提高模型的鲁棒性,并在一定程度上防御住黑盒PGD攻击; - 实验表明,基于

ALP训练的模型不管是白盒还是黑盒攻击下,都能获得很好的鲁棒性; - 还发现,基于

ALP训练模型得到的攻击样本攻击性很强,对于之前最强的防御方法都不能防御住攻击(ensemble adverarial training)。

2. Definitions and threat models

**约束:**威胁模型明确了攻击者(方)的能力,本文将攻击方法界定在可以进行 L ∞ L_{\infty} L∞操作方法上。这是一种简化操作,但是更适合用于和benchmark工作进行对比。

针对两种威胁模型(threat model):

- White box:攻击者掌握了模型的所有信息(架构、参数等);

- **Black box:**攻击者无法获得模型的架构和参数,只能有限次查询。

3. The Challenges of defending ImageNet classifiers

首先,之前已经提出了很多的防御方法,但是目前除了基于Madry(PGD)的对抗训练方法还未被攻破外,其它方法基本都已经不能有效的起到防御作用。因此,本文基于Madry的方法开展研究,并首次将该方法应用于大数据集(ImageNet)。

同时,本文还提及了Adversarial machine learning at scale,包括一些结论:

- 使用单步攻击攻击方法对抗训练得到的模型,在单步攻击方法下还能得到一定的鲁棒性(不能防御住多步攻击方法的攻击);

- 多步迭代攻击方法(

Iter.l.l. & Iter. basic)对抗训练并未实现。

本文的工作不同的两点包括:

- 直接基于

Madry对抗训练方法在ImageNet数据集上提高了模型的鲁棒性(第一次); - 另外,以

Madry的方法为baseline,本文提出了新的强化的防御方法,大大提高了模型在ImageNet数据集上的鲁棒性。

注意:在使用PGD生成对抗样本时,采用随机初始化操作。

4. Methods

4.1 Adversarial Training

PGD是一个通用的一阶攻击方法,也即如果某种方法对PGD攻击鲁棒,则对所有的一阶攻击方法都应该鲁棒。

本文的对抗训练使用PGD作为基本攻击方法(use AT with PGD as the underlying basis for our methods.):

arg min θ E ( x , y ) ∈ p ^ data ( max δ ∈ S L ( θ , x + δ , y ) ) \underset{\theta}{\arg \min } \mathbb{E}_{(x, y) \in \hat{p}_{\text {data }}}\left(\max _{\delta \in S} L(\theta, x+\delta, y)\right) θargminE(x,y)∈p^data (δ∈SmaxL(θ,x+δ,y))

其中,

- p ^ d a t a \hat p_{data} p^data是潜在的训练数据分布;

- L ( θ , x , y ) L(\theta,x,y) L(θ,x,

本文提出Adversarial Logit Pairing方法用于防御。介绍了对抗训练、FGSM等相关知识,界定攻击方法。在MNIST、SVHN、ImageNet数据集实验,结果表明该方法能提高模型鲁棒性,还与标签平滑、Mixup等方法对比,显示出较好效果。

本文提出Adversarial Logit Pairing方法用于防御。介绍了对抗训练、FGSM等相关知识,界定攻击方法。在MNIST、SVHN、ImageNet数据集实验,结果表明该方法能提高模型鲁棒性,还与标签平滑、Mixup等方法对比,显示出较好效果。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4352

4352

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?