当sigmoid函数和MSE一起使用时会出现梯度消失。原因如下:

(1)MSE对参数的偏导

(2)corss-entropy对参数的偏导

由上述公式可以看出,在使用MSE时,w、b的梯度均与sigmoid函数对z的偏导有关系,而sigmoid函数的偏导在自变量非常大或者非常小时,偏导数的值接近于零,这将导致w、b的梯度将不会变化,也就是出现所谓的梯度消失现象。而使用cross-entropy时,w、b的梯度就不会出现上述的情况。所以MSE不适用于分类问题。

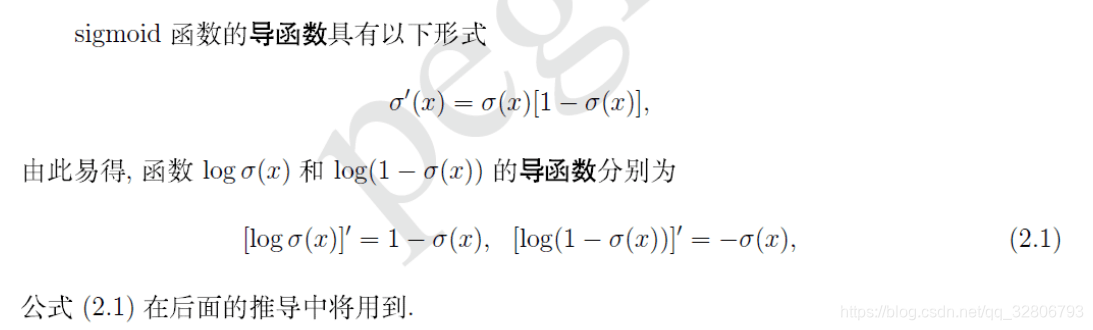

这里指出log求导的一个公式,解释,为啥使用交叉熵的时候不会出现sigmoid的导数

博客指出,sigmoid函数和MSE一起使用会出现梯度消失现象。MSE对参数的偏导与sigmoid函数对z的偏导有关,在自变量极端情况下,sigmoid偏导接近零,导致梯度不变化。而使用交叉熵时则不会出现此情况,因此MSE不适用于分类问题。

博客指出,sigmoid函数和MSE一起使用会出现梯度消失现象。MSE对参数的偏导与sigmoid函数对z的偏导有关,在自变量极端情况下,sigmoid偏导接近零,导致梯度不变化。而使用交叉熵时则不会出现此情况,因此MSE不适用于分类问题。

5078

5078

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?