一,什么是DQN?

学习资料:

强化学习与神经网络

如图显示,主要由DNN+Q-Learning组成。

Q-Learning已经显示了它的强大。由于场景复杂,状态太多,计算机运行有限。DQN就为解决这个而生。

强大的DQN输入输出有两种,第一种,输入状态和动作,输出为Q表。第二种,输入状态,输出动作。

分析第二种情况:

反向传播更新DNN。

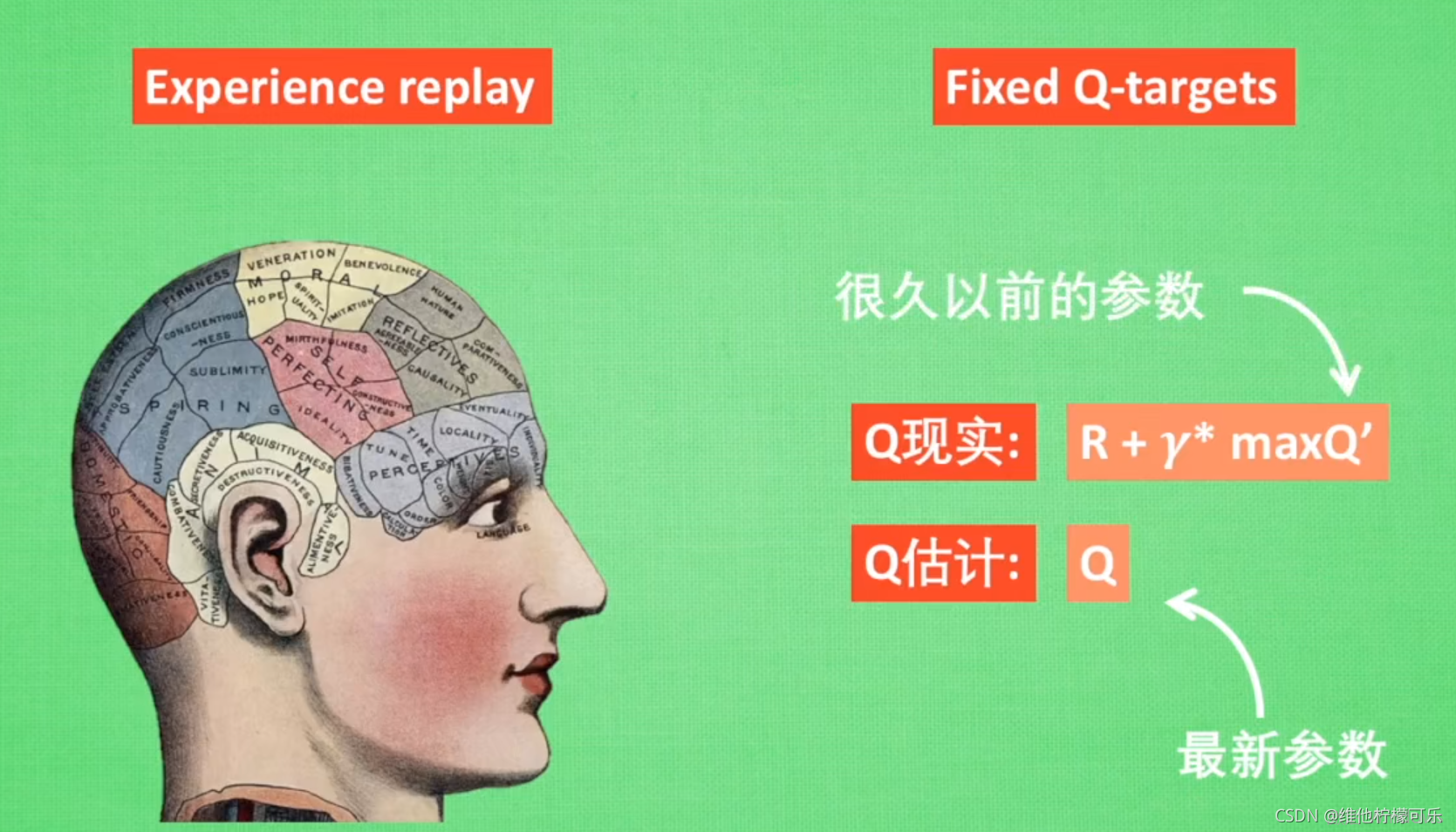

使得DQN无比强大的两大原因:第一,Experience replay;第二,Fixed Q-targets;

二,DQN算法更新(using Tensorflow)

DQN(Deep Q-Network)是强化学习中的一种算法,它结合了深度学习和Q-Learning,用于处理复杂的高维状态空间。DQN通过使用经验回放缓冲区和固定Q目标来稳定训练过程,其核心组成部分包括深度神经网络。该算法可以接受状态作为输入,输出对应的动作值。在Tensorflow等框架中实现DQN,通常涉及反向传播更新网络权重的过程。

DQN(Deep Q-Network)是强化学习中的一种算法,它结合了深度学习和Q-Learning,用于处理复杂的高维状态空间。DQN通过使用经验回放缓冲区和固定Q目标来稳定训练过程,其核心组成部分包括深度神经网络。该算法可以接受状态作为输入,输出对应的动作值。在Tensorflow等框架中实现DQN,通常涉及反向传播更新网络权重的过程。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?