focal loss分析图 (完善知乎的一个评论)

最新推荐文章于 2025-11-05 19:24:12 发布

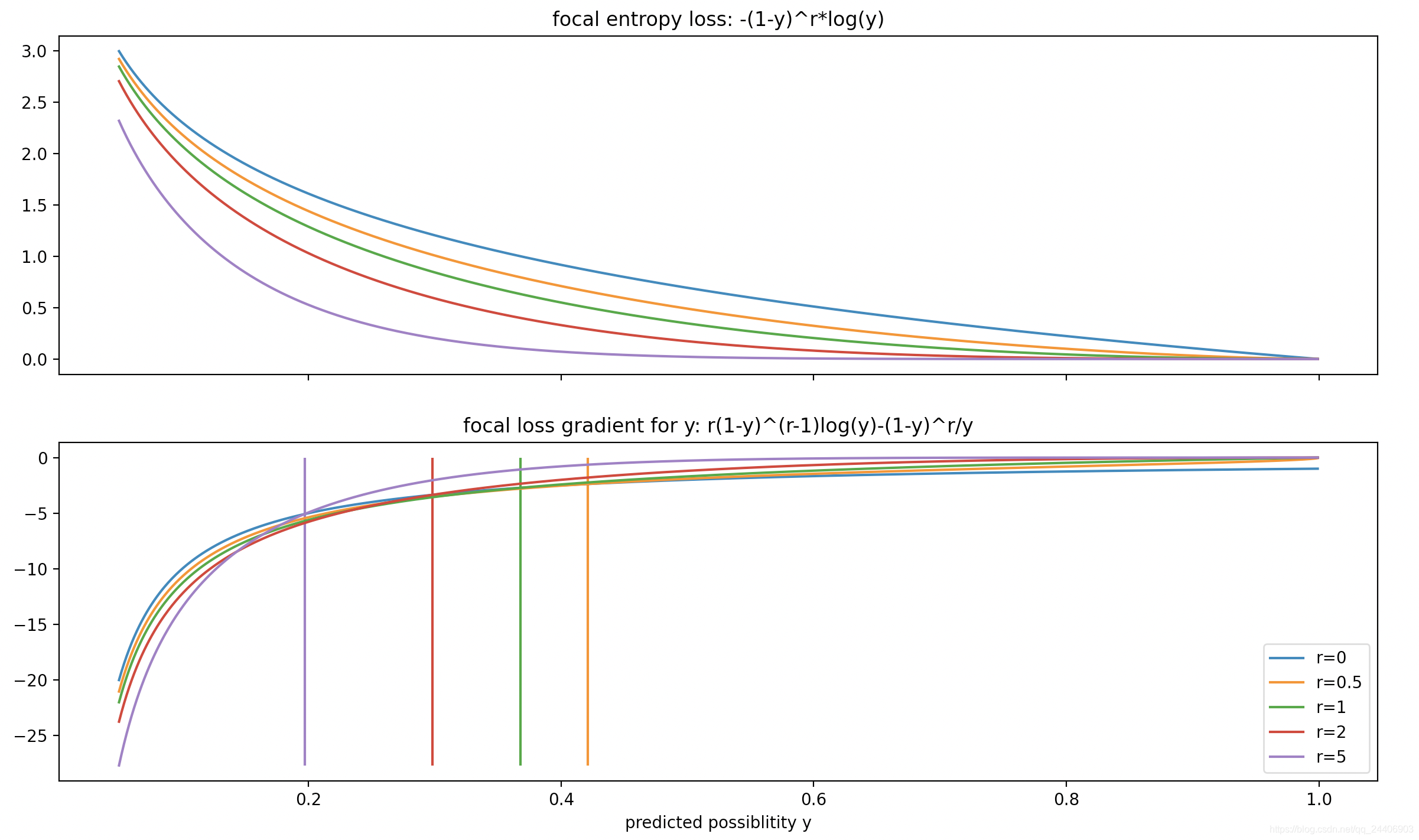

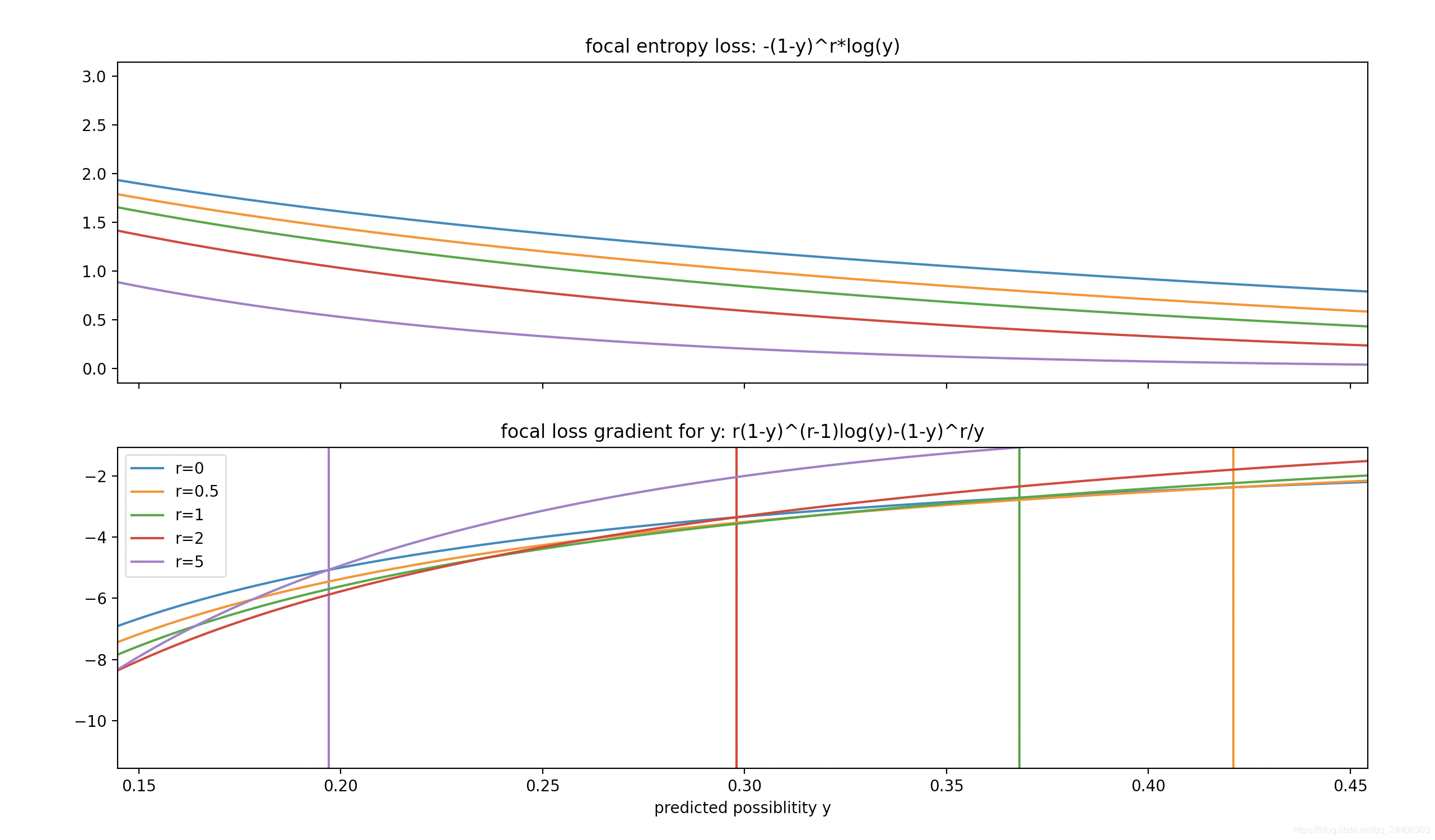

本文探讨了Focal Loss的作用原理,指出样本的重要性取决于其对权值梯度的影响而非直接的损失值。通过分析Focal Loss的导数,发现其在不同r值下对模型预测概率y的影响,揭示了为何r=2时的表现最优。作者提出,关键在于维持不同y值处导数的相对关系,而不是绝对大小,以有效区分难易分类样本。

本文探讨了Focal Loss的作用原理,指出样本的重要性取决于其对权值梯度的影响而非直接的损失值。通过分析Focal Loss的导数,发现其在不同r值下对模型预测概率y的影响,揭示了为何r=2时的表现最优。作者提出,关键在于维持不同y值处导数的相对关系,而不是绝对大小,以有效区分难易分类样本。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?