paper:https://ieeexplore.ieee.org/stamp/stamp.jsp?tp=&arnumber=8333805

简介:目前先有的弱监督目标检测方法大多将其作为一个多示例问题,产生候选区域,然后分类器判断类别的方式进行获得位置信息。本文作者利用图像梯度,提出了一种新的定位目标框的方式。

1.在目标分类网络中,目标所在区域反映到特征上是显著的,基于这个出发点,展开。

首先定义是输入图像,

是图像级的标签,

是图像类别数量,

是图像的高度,

是图像的宽度。第

类目标的得分表示为

.训练集的平均图片个平均分数为

,

.所以,

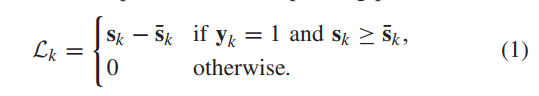

是第k类的平均得分。构建损失函数:

最小化式1使 。

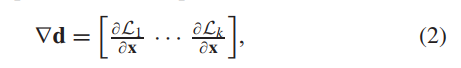

图像x的梯度为

展开;

这儿,是第l层的特征图,

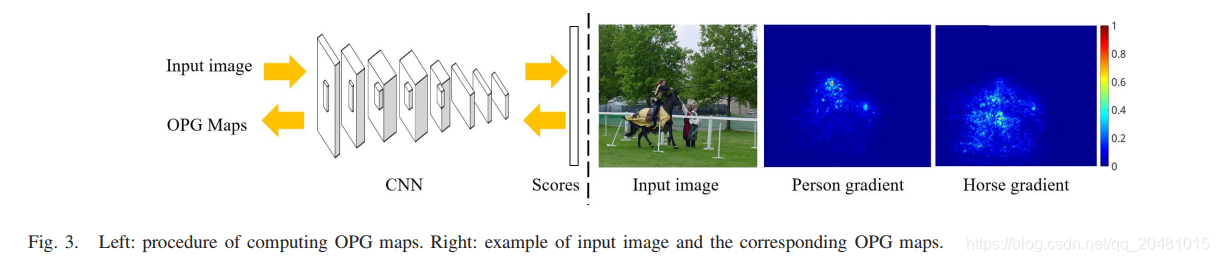

表示第k类得分对图像x的梯度。图像梯度如图三所示。

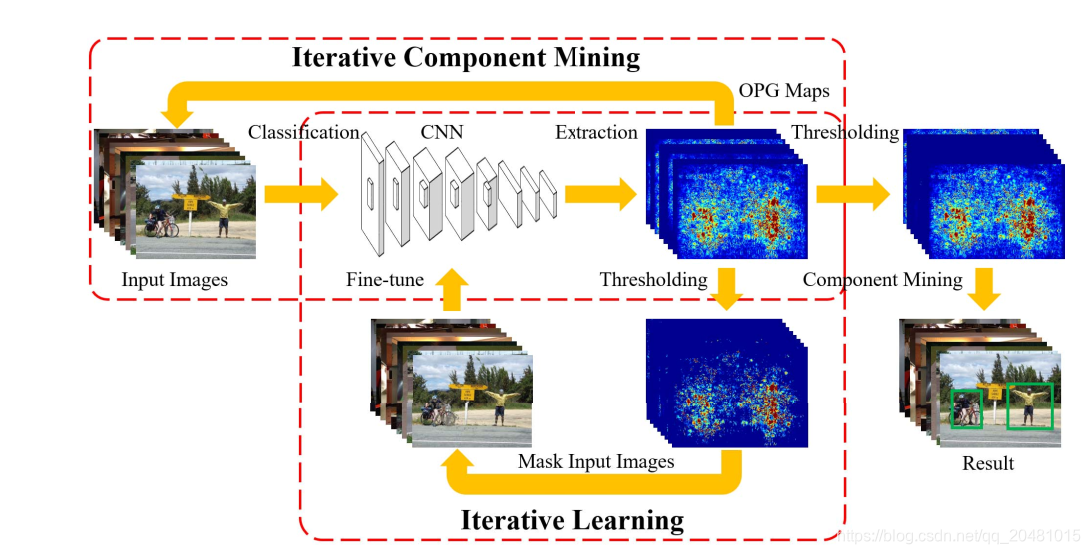

2. Iterative Component Mining

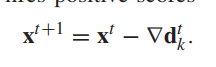

首先将OPG图的像素分为g组,根据相应加权(这其实没搞懂怎么做的),然后使用一个阈值为后验分布将每一组分配给第f个component。最后,用最小包围框提取对象的bounding box。

作者认为这仍然是不足的。为此,迭代地屏蔽已经找到的组件,并用一种新的ICM方案挖掘潜在的对象(或组件)

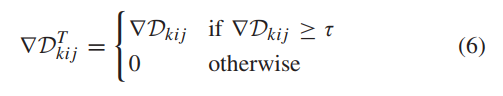

此处, 为了累计梯度,

表示第t次迭代。

就是OPG。

3. Inferring Precise Bounding Box

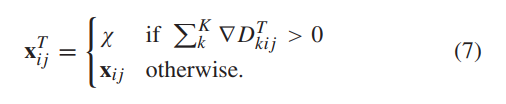

特定对象类别的边界框从对应的OPG映射中获得。直观地说,OPG映射中的高值对应于此图像中对象的关键组件。然而,OPG图中的低值并不一定对应于背景,如图2所示。在某些情况下,响应得分很低,因为接受域会在目标对象最重要的区域触发,这会使该对象不那么重要的区域的响应退化。这是在人类视觉系统中经常观察到的现象。接下来,引入一种迭代的方法来推断一个精确的边界框。 首先对阈值化处理。

然后,产生一个新的掩码图像

有三个选择,

![]() ,

,是均值,

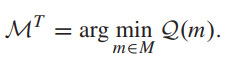

是0到255的随机数。然后更新模型

这儿![]()

4 Average and Max Pooling Layer

到目前为止,所提出的OPG图很容易找到物体的定位特征,如头部的cat。然而,对于物体的定位和检测,我们需要找出物体的所有组成部分,例如猫的身体。这个问题主要是由于CNNs中常用的max pooling的操作。在max池中,只有每个池区域的最大激活被维护并传播到下一层,这通常会忽略给定对象的非显著组件,所以作者设计了平均最大池化(AMP)。

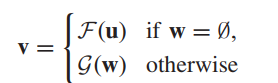

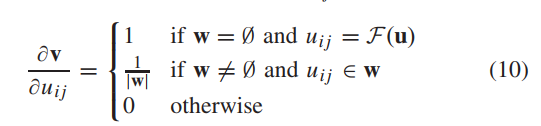

u和v为AMP层的输入和输出。,h和w是u的长度和宽度。定义

导数为;

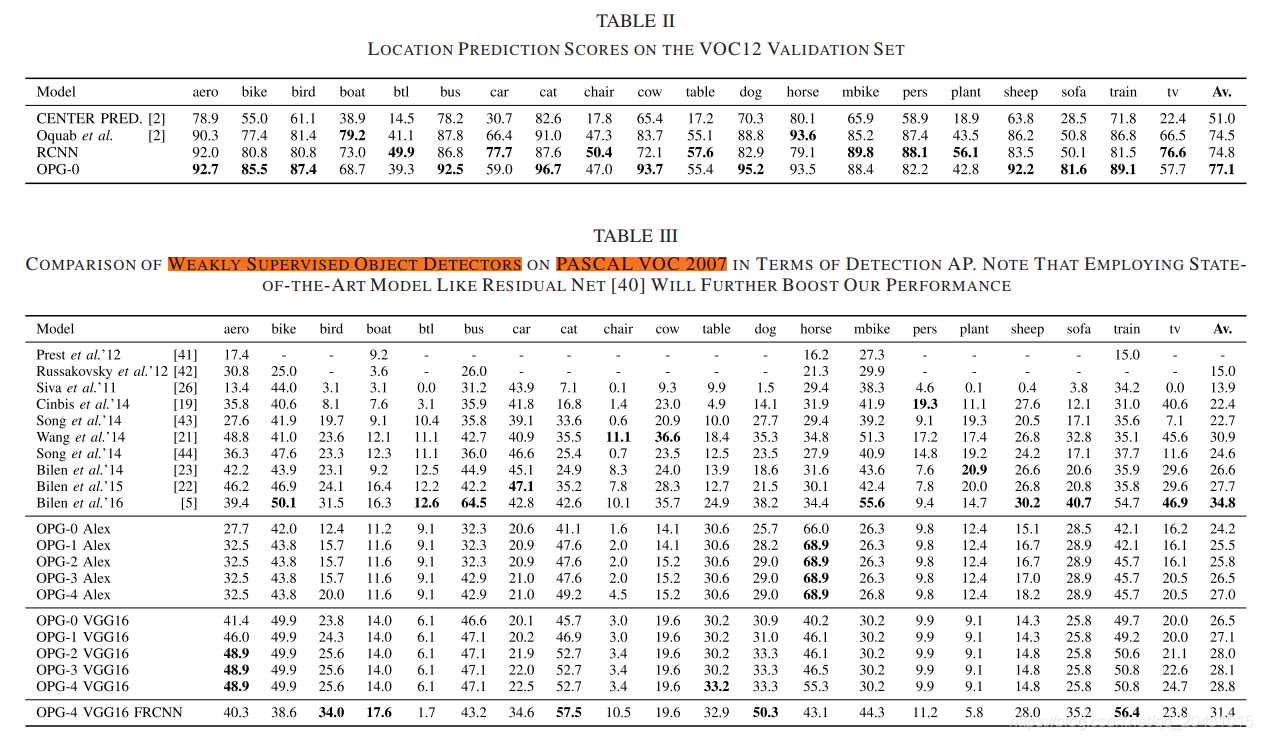

实验结果

本文介绍了一种基于图像梯度的弱监督目标检测方法,通过OPG图定位目标,采用迭代组件挖掘和精确边界框推断提高检测精度,并设计平均最大池化层解决CNNs中maxpooling的问题。

本文介绍了一种基于图像梯度的弱监督目标检测方法,通过OPG图定位目标,采用迭代组件挖掘和精确边界框推断提高检测精度,并设计平均最大池化层解决CNNs中maxpooling的问题。

1366

1366

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?