简介

mycat支持多种数据库

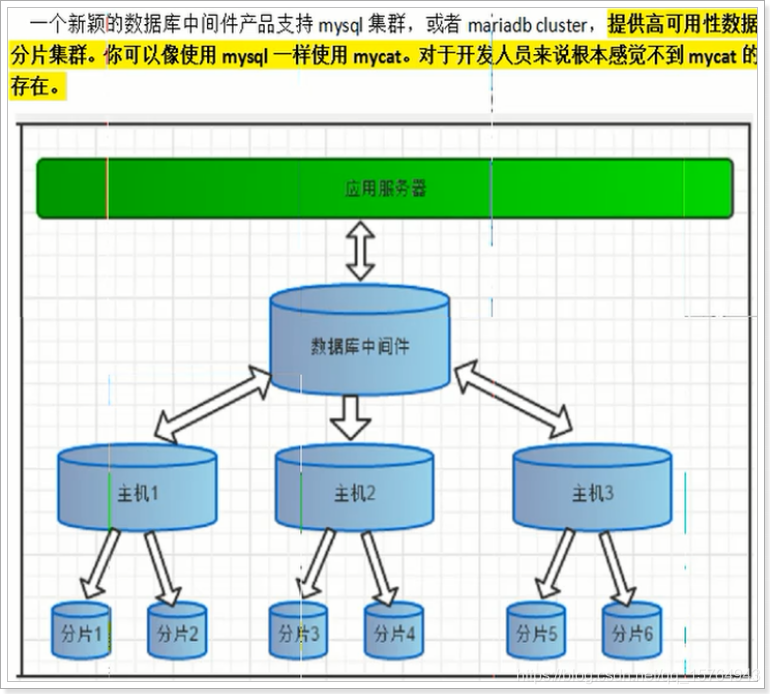

mycat架构

一、海量数据解决方案

1、垂直拆分

一个库中存在海量表

2、水平拆分

一个表中存在海量数据(分片)

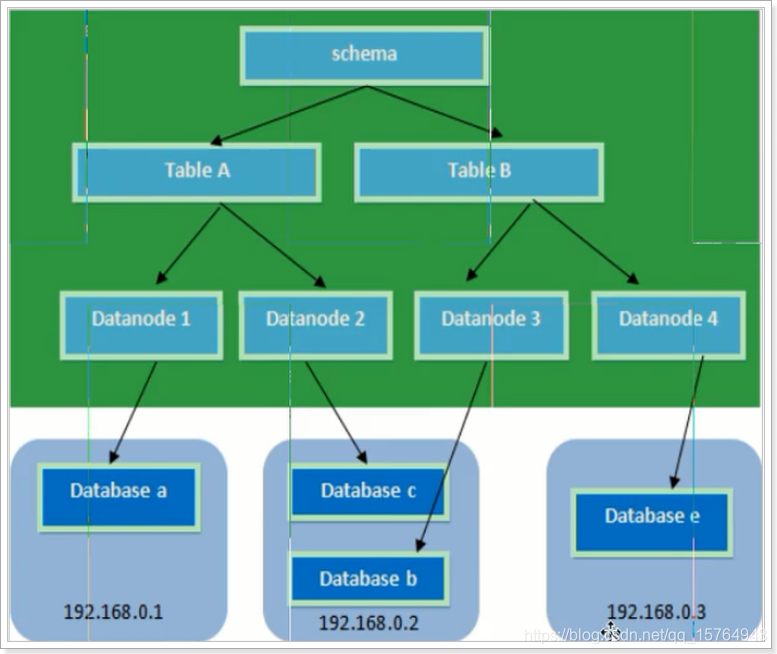

二、MyCat分片策略

Schema:逻辑库

Table:逻辑表

Datanode:物理库

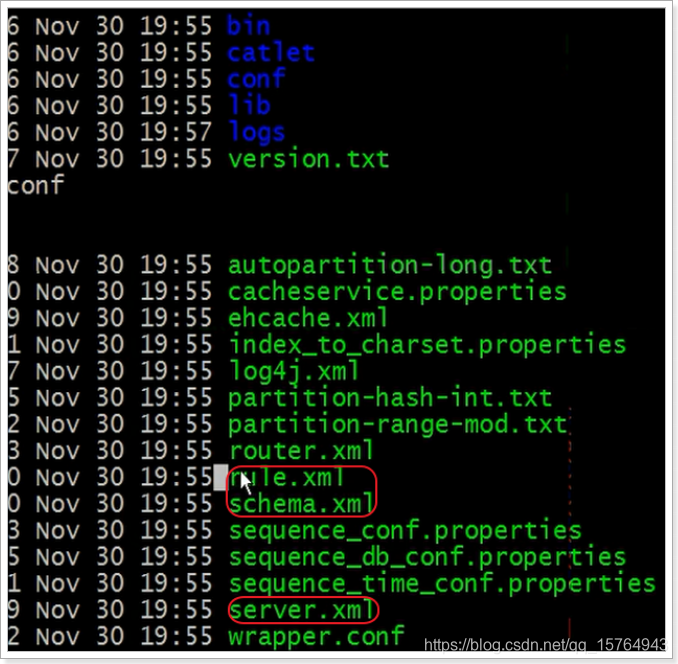

安装

1、下载

官方网站:

http://www.mycat.org.cn/

github地址

https://github.com/MyCATApache

2、安装

第一步:把MyCat的压缩包上传到linux服务器

第二步:解压缩,得到mycat目录

第三步:进入mycat/bin,启动MyCat

启动命令:./mycat start

停止命令:./mycat stop

重启命令:./mycat restart

注意:mysql表名大小写设置;可以使用mysql的客户端直接连接mycat服务。默认服务端口为8066

分片规则

常用的分片规则:总共十个(基本够用)

一、枚举法

<tableRule name="sharding-by-intfile">

<rule>

<columns>user_id</columns>

<algorithm>hash-int</algorithm>

</rule>

</tableRule>

<function name="hash-int" class="io.mycat.route.function.PartitionByFileMap">

<property name="mapFile">partition-hash-int.txt</property>

<property name="type">0</property>

<property name="defaultNode">0</property>

</function>

partition-hash-int.txt 配置:

10000=0

10010=1

上面columns 标识将要分片的表字段,algorithm 分片函数,

其中分片函数配置中,mapFile标识配置文件名称,type默认值为0,0表示Integer,非零表示String,

所有的节点配置都是从0开始,及0代表节点1

/**

* defaultNode 默认节点:小于0表示不设置默认节点,大于等于0表示设置默认节点,结点为指定的值

*

默认节点的作用:枚举分片时,如果碰到不识别的枚举值,就让它路由到默认节点

* 如果不配置默认节点(defaultNode值小于0表示不配置默认节点),碰到

* 不识别的枚举值就会报错,

* like this:can't find datanode for sharding column:column_name val:ffffffff

*/

二、固定分片hash算法

<tableRule name="rule1">

<rule>

<columns>user_id</columns>

<algorithm>func1</algorithm>

</rule>

</tableRule>

<function name="func1" class="io.mycat.route.function.PartitionByLong">

<property name="partitionCount">2,1</property>

<property name="partitionLength">256,512</property>

</function>

配置说明:

上面columns 标识将要分片的表字段,algorithm 分片函数,

partitionCount 分片个数列表,partitionLength 分片范围列表

分区长度:默认为最大2^n=1024 ,即最大支持1024分区

约束 :

count,length两个数组的长度必须是一致的。

1024 = sum((count[i]*length[i])). count和length两个向量的点积恒等于1024

用法例子:

@Test

public void testPartition() {

// 本例的分区策略:希望将数据水平分成3份,前两份各占25%,第三份占50%。(故本例非均匀分区)

// |<---------------------1024------------------------>|

// |<----256--->|<----256--->|<----------512---------->|

// | partition0 | partition1 | partition2 |

// | 共2份,故count[0]=2 | 共1份,故count[1]=1 |

int[] count = new int[] { 2, 1 };

int[] length = new int[] { 256, 512 };

PartitionUtil pu = new PartitionUtil(count, length);

// 下面代码演示分别以offerId字段或memberId字段根据上述分区策略拆分的分配结果

int DEFAULT_STR_HEAD_LEN = 8; // cobar默认会配置为此值

long offerId = 12345;

String memberId = "qiushuo";

// 若根据offerId分配,partNo1将等于0,即按照上述分区策略,offerId为12345时将会被分配到partition0中

int partNo1 = pu.partition(offerId);

// 若根据memberId分配,partNo2将等于2,即按照上述分区策略,memberId为qiushuo时将会被分到partition2中

int partNo2 = pu.partition(memberId, 0, DEFAULT_STR_HEAD_LEN);

Assert.assertEquals(0, partNo1);

Assert.assertEquals(2, partNo2);

}

如果需要平均分配设置:平均分为4分片,partitionCount*partitionLength=1024

<function name="func1" class="org.opencloudb.route.function.PartitionByLong">

<property name="partitionCount">4</property>

<property name="partitionLength">256</property>

</function>

三、范围约定

<tableRule name="auto-sharding-long">

<rule>

<columns>user_id</columns>

<algorithm>rang-long</algorithm>

</rule>

</tableRule>

<function name="rang-long" class="io.mycat.route.function.AutoPartitionByLong">

<property name="mapFile">autopartition-long.txt</property>

</function>

# range start-end ,data node index

# K=1000,M=10000.

0-500M=0

500M-1000M=1

1000M-1500M=2

或

0-10000000=0

10000001-20000000=1

配置说明:

上面columns 标识将要分片的表字段,algorithm 分片函数,

rang-long 函数中mapFile代表配置文件路径

所有的节点配置都是从0开始,及0代表节点1,此配置非常简单,即预先制定可能的id范围到某个分片

四、求模法

<tableRule name="mod-long">

<rule>

<columns>user_id</columns>

<algorithm>mod-long</algorithm>

</rule>

</tableRule>

<function name="mod-long" class="io.mycat.route.function.PartitionByMod">

<!-- how many data nodes -->

<property name="count">3</property>

</function>

配置说明:

上面columns 标识将要分片的表字段,algorithm 分片函数,

此种配置非常明确即根据id与count(你的结点数)进行求模预算,相比方式1,此种在批量插入时需要切换数据源,id不连续

五、日期列分区法

<tableRule name="sharding-by-date">

<rule>

<columns>create_time</columns>

<algorithm>sharding-by-date</algorithm>

</rule>

</tableRule>

<function name="sharding-by-date" class="io.mycat.route.function..PartitionByDate">

<property name="dateFormat">yyyy-MM-dd</property>

<property name="sBeginDate">2014-01-01</property>

<property name="sPartionDay">10</property>

</function>

配置说明:

上面columns 标识将要分片的表字段,algorithm 分片函数,

配置中配置了开始日期,分区天数,即默认从开始日期算起,分隔10天一个分区

还有一切特性请看源码

Assert.assertEquals(true, 0 == partition.calculate("2014-01-01"));

Assert.assertEquals(true, 0 == partition.calculate("2014-01-10"));

Assert.assertEquals(true, 1 == partition.calculate("2014-01-11"));

Assert.assertEquals(true, 12 == partition.calculate("2014-05-01"));

六、通配取模

<tableRule name="sharding-by-pattern">

<rule>

<columns>user_id</columns>

<algorithm>sharding-by-pattern</algorithm>

</rule>

</tableRule>

<function name="sharding-by-pattern" class="io.mycat.route.function.PartitionByPattern">

<property name="patternValue">256</property>

<property name="defaultNode">2</property>

<property name="mapFile">partition-pattern.txt</property>

</function>

partition-pattern.txt

# id partition range start-end ,data node index

###### first host configuration

1-32=0

33-64=1

65-96=2

97-128=3

######## second host configuration

129-160=4

161-192=5

193-224=6

225-256=7

0-0=7

配置说明:

上面columns 标识将要分片的表字段,algorithm 分片函数,patternValue 即求模基数,defaoultNode 默认节点,如果不配置了默认,则默认是0即第一个结点

mapFile 配置文件路径

配置文件中,1-32 即代表id%256后分布的范围,如果在1-32则在分区1,其他类推,如果id非数字数据,则会分配在defaoultNode 默认节点

String idVal = "0";

Assert.assertEquals(true, 7 == autoPartition.calculate(idVal));

idVal = "45a";

Assert.assertEquals(true, 2 == autoPartition.calculate(idVal));

七、ASCII码求模通配

<tableRule name="sharding-by-prefixpattern">

<rule>

<columns>user_id</columns>

<algorithm>sharding-by-prefixpattern</algorithm>

</rule>

</tableRule>

<function name="sharding-by-pattern" class="io.mycat.route.function.PartitionByPrefixPattern">

<property name="patternValue">256</property>

<property name="prefixLength">5</property>

<property name="mapFile">partition-pattern.txt</property>

</function>

partition-pattern.txt

# range start-end ,data node index

# ASCII

# 48-57=0-9

# 64、65-90=@、A-Z

# 97-122=a-z

###### first host configuration

1-4=0

5-8=1

9-12=2

13-16=3

###### second host configuration

17-20=4

21-24=5

25-28=6

29-32=7

0-0=7

配置说明:

上面columns 标识将要分片的表字段,algorithm 分片函数,patternValue 即求模基数,prefixLength ASCII 截取的位数

mapFile 配置文件路径

配置文件中,1-32 即代表id%256后分布的范围,如果在1-32则在分区1,其他类推

此种方式类似方式6只不过采取的是将列种获取前prefixLength位列所有ASCII码的和进行求模sum%patternValue ,获取的值,在通配范围内的

即 分片数,

/**

* ASCII编码:

* 48-57=0-9阿拉伯数字

* 64、65-90=@、A-Z

* 97-122=a-z

*

*/

如

String idVal="gf89f9a";

Assert.assertEquals(true, 0==autoPartition.calculate(idVal));

idVal="8df99a";

Assert.assertEquals(true, 4==autoPartition.calculate(idVal));

idVal="8dhdf99a";

Assert.assertEquals(true, 3==autoPartition.calculate(idVal));

八、编程指定

<tableRule name="sharding-by-substring">

<rule>

<columns>user_id</columns>

<algorithm>sharding-by-substring</algorithm>

</rule>

</tableRule>

<function name="sharding-by-substring" class="io.mycat.route.function.PartitionDirectBySubString">

<property name="startIndex">0</property> <!-- zero-based -->

<property name="size">2</property>

<property name="partitionCount">8</property>

<property name="defaultPartition">0</property>

</function>

配置说明:

上面columns 标识将要分片的表字段,algorithm 分片函数

此方法为直接根据字符子串(必须是数字)计算分区号(由应用传递参数,显式指定分区号)。

例如id=05-100000002

在此配置中代表根据id中从startIndex=0,开始,截取siz=2位数字即05,05就是获取的分区,如果没传默认分配到defaultPartition

九、字符串拆分hash解析

<tableRule name="sharding-by-stringhash">

<rule>

<columns>user_id</columns>

<algorithm>sharding-by-stringhash</algorithm>

</rule>

</tableRule>

<function name="sharding-by-substring" class="io.mycat.route.function.PartitionByString">

<property name=length>512</property> <!-- zero-based -->

<property name="count">2</property>

<property name="hashSlice">0:2</property>

</function>

配置说明:

上面columns 标识将要分片的表字段,algorithm 分片函数

函数中length代表字符串hash求模基数,count分区数,hashSlice hash预算位

即根据子字符串 hash运算

hashSlice : 0 means str.length(), -1 means str.length()-1

/**

* "2" -> (0,2)<br/>

* "1:2" -> (1,2)<br/>

* "1:" -> (1,0)<br/>

* "-1:" -> (-1,0)<br/>

* ":-1" -> (0,-1)<br/>

* ":" -> (0,0)<br/>

*/

public class PartitionByStringTest {

@Test

public void test() {

PartitionByString rule = new PartitionByString();

String idVal=null;

rule.setPartitionLength("512");

rule.setPartitionCount("2");

rule.init();

rule.setHashSlice("0:2");

// idVal = "0";

// Assert.assertEquals(true, 0 == rule.calculate(idVal));

// idVal = "45a";

// Assert.assertEquals(true, 1 == rule.calculate(idVal));

//last 4

rule = new PartitionByString();

rule.setPartitionLength("512");

rule.setPartitionCount("2");

rule.init();

//last 4 characters

rule.setHashSlice("-4:0");

idVal = "aaaabbb0000";

Assert.assertEquals(true, 0 == rule.calculate(idVal));

idVal = "aaaabbb2359";

Assert.assertEquals(true, 0 == rule.calculate(idVal));

}

十、一致性hash

<tableRule name="sharding-by-murmur">

<rule>

<columns>user_id</columns>

<algorithm>murmur</algorithm>

</rule>

</tableRule>

<function name="murmur" class="io.mycat.route.function.PartitionByMurmurHash">

<property name="seed">0</property><!-- 默认是0-->

<property name="count">2</property><!-- 要分片的数据库节点数量,必须指定,否则没法分片—>

<property name="virtualBucketTimes">160</property><!-- 一个实际的数据库节点被映射为这么多虚拟节点,默认是160倍,也就是虚拟节点数是物理节点数的160倍-->

<!--

<property name="weightMapFile">weightMapFile</property>

节点的权重,没有指定权重的节点默认是1。以properties文件的格式填写,以从0开始到count-1的整数值也就是节点索引为key,以节点权重值为值。所有权重值必须是正整数,否则以1代替 -->

<!--

<property name="bucketMapPath">/etc/mycat/bucketMapPath</property>

用于测试时观察各物理节点与虚拟节点的分布情况,如果指定了这个属性,会把虚拟节点的murmur hash值与物理节点的映射按行输出到这个文件,没有默认值,如果不指定,就不会输出任何东西 -->

</function>

一致性hash预算有效解决了分布式数据的扩容问题,前1-9中id规则都多少存在数据扩容难题,而10规则解决了数据扩容难点

MyCat集群

mycat做了数据库的代理,在高并发的情况下,必然也会面临单节点性能问题,所以需要部署多个mycat节点。

cp mycat mycat2 -R

vim wrapper.conf

#设置jmx端口

wrapper.java.additional.7=-Dcom.sun.management.jmxremote.port=1985

vim server.xml

#设置服务端口以及管理端口

<property name="serverPort">8067</property>

<property name="managerPort">9067</property>

#重新启动服务

./startup_nowrap.sh

tail -f ../logs/mycat.log

表分片实现

1、配置分片

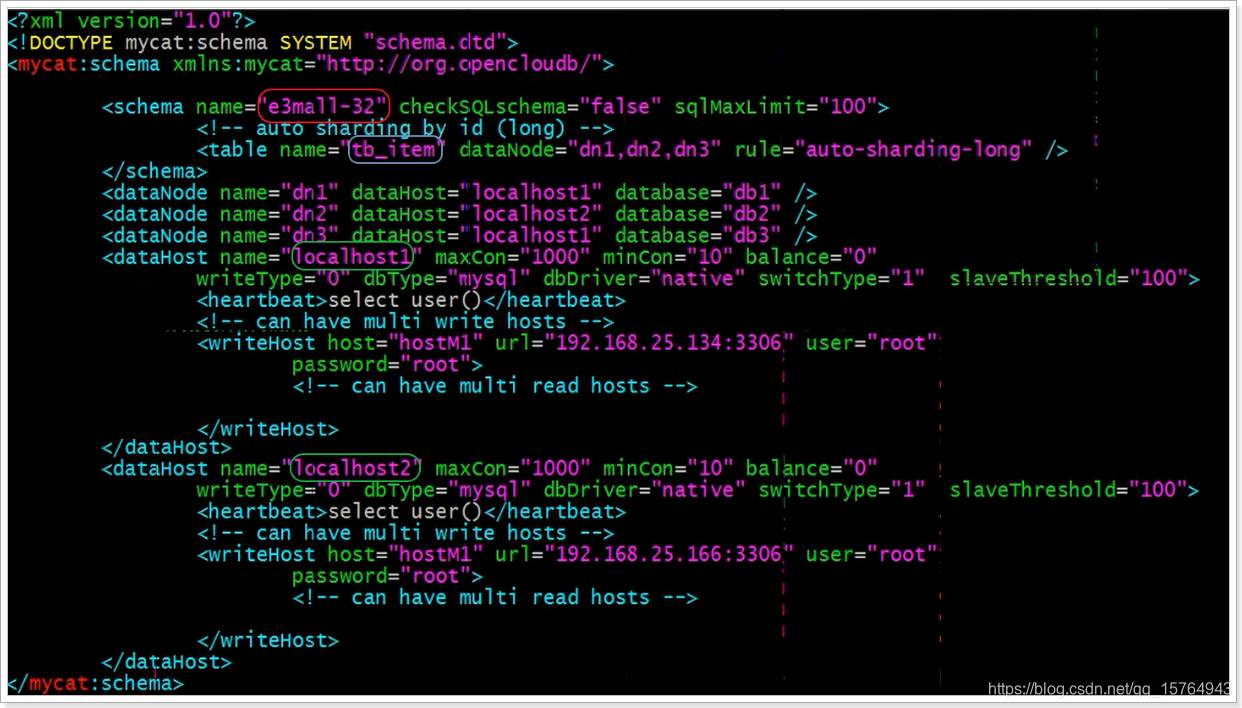

1)schema.xml

如:配置一个数据库e3mall-32,其中有一张表tb_item

该表数据分片到三个数据库(其中一个物理库有两个库),分片规则按主键(一张表主键id值5000000数据三个数据库记录超过15000000将无法插入数据),

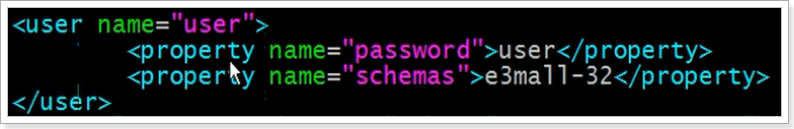

2)server.xml

配置数据库用户名和密码

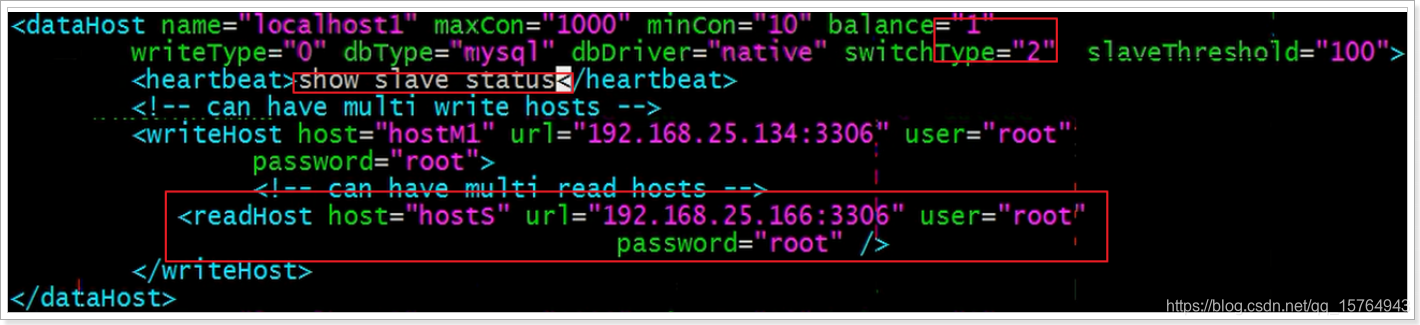

2、配置读写分离

注意:配置对应的两台mysql服务需要配置主从分离

配置说明:

(1) 设置 balance="1"与writeType=“0”

Balance参数设置:

- balance=“0”, 所有读操作都发送到当前可用的writeHost上。

- balance=“1”,所有读操作都随机的发送到readHost。

- balance=“2”,所有读操作都随机的在writeHost、readhost上分发

WriteType参数设置: - writeType=“0”, 所有写操作都发送到可用的writeHost上。

- writeType=“1”,所有写操作都随机的发送到readHost。

- writeType=“2”,所有写操作都随机的在writeHost、readhost分上发。

“readHost是从属于writeHost的,即意味着它从那个writeHost获取同步数据,因此,当它所属的writeHost宕机了,则它也不会再参与到读写分离中来,即“不工作了”,这是因为此时,它的数据已经“不可靠”了。基于这个考虑,目前mycat 1.3和1.4版本中,若想支持MySQL一主一从的标准配置,并且在主节点宕机的情况下,从节点还能读取数据,则需要在Mycat里配置为两个writeHost并设置banlance=1。”

(2) 设置 switchType=“2” 与slaveThreshold=“100”

switchType 目前有三种选择:

-1:表示不自动切换

1 :默认值,自动切换

2 :基于MySQL主从同步的状态决定是否切换

“Mycat心跳检查语句配置为 show slave status ,dataHost 上定义两个新属性: switchType=“2” 与slaveThreshold=“100”,此时意味着开启MySQL主从复制状态绑定的读写分离与切换机制。Mycat心跳机制通过检测 show slave status 中的 “Seconds_Behind_Master”, “Slave_IO_Running”, “Slave_SQL_Running” 三个字段来确定当前主从同步的状态以及Seconds_Behind_Master主从复制时延。“

案例

读写分离

MyCat做中间件,实现读写分离

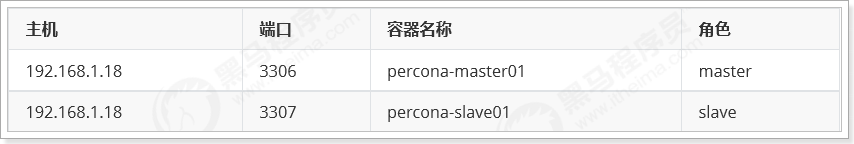

1、基本环境

两台数据库,配置了读写分离

2、server.xml配置

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE mycat:server SYSTEM "server.dtd">

<mycat:server xmlns:mycat="http://io.mycat/">

<system>

<property name="nonePasswordLogin">0</property>

<property name="useHandshakeV10">1</property>

<property name="useSqlStat">0</property>

<property name="useGlobleTableCheck">0</property>

<property name="sequnceHandlerType">2</property>

<property name="subqueryRelationshipCheck">false</property>

<property name="processorBufferPoolType">0</property>

<property name="handleDistributedTransactions">0</property>

<property name="useOffHeapForMerge">1</property>

<property name="memoryPageSize">64k</property>

<property name="spillsFileBufferSize">1k</property>

<property name="useStreamOutput">0</property>

<property name="systemReserveMemorySize">384m</property>

<property name="useZKSwitch">false</property>

</system>

<!--这里是设置的itcast用户和虚拟逻辑库-->

<user name="itcast" defaultAccount="true">

<property name="password">itcast123</property>

<property name="schemas">itcast</property>

</user>

</mycat:server>

3、schema.xml配置

<?xml version="1.0"?>

<!DOCTYPE mycat:schema SYSTEM "schema.dtd">

<mycat:schema xmlns:mycat="http://io.mycat/">

<!--配置数据表-->

<schema name="itcast" checkSQLschema="false" sqlMaxLimit="100">

<table name="tb_ad" dataNode="dn1" rule="mod-long" />

</schema>

<!--配置分片关系-->

<dataNode name="dn1" dataHost="cluster1" database="itcast" />

<!--配置连接信息-->

<dataHost name="cluster1" maxCon="1000" minCon="10" balance="3"

writeType="1" dbType="mysql" dbDriver="native" switchType="1" slaveThreshold="100">

<heartbeat>select user()</heartbeat>

<writeHost host="W1" url="192.168.1.18:3306" user="root"

password="root">

<readHost host="W1R1" url="192.168.1.18:3307" user="root"

password="root" />

</writeHost>

</dataHost>

</mycat:schema>

balance属性说明: 负载均衡类型,目前的取值有3 种:

- balance=“0”, 不开启读写分离机制,所有读操作都发送到当前可用的writeHost 上。

- balance=“1”,全部的readHost 与stand by writeHost 参与select 语句的负载均衡,简单的说,当双 主 双从模式(M1->S1,M2->S2,并且M1 与M2 互为主备),正常情况下,M2,S1,S2 都参与select 语句的负 载均衡。

- balance=“2”,所有读操作都随机的在writeHost、readhost 上分发。

- balance=“3”,所有读请求随机的分发到wiriterHost 对应的readhost 执行,writerHost 不负担读压 力, 注意balance=3 只在1.4 及其以后版本有,1.3 没有

4、rule.xml配置

<tableRule name="mod-long">

<rule>

<columns>id</columns>

<algorithm>mod-long</algorithm>

</rule>

</tableRule>

<function name="mod-long" class="io.mycat.route.function.PartitionByMod">

<property name="count">1</property>

</function>

数据分片

MyCat做中间件,实现指定表数据分片和读写分离存储

1、配置Master

#搭建master

#创建目录

mkdir /data/mysql/master02

cd /data/mysql/master02

mkdir conf data

chmod 777 * -R

#创建配置文件

cd /data/mysql/master02/conf

vim my.cnf

#输入如下内容

[mysqld]

log-bin=mysql-bin #开启二进制日志

server-id=1 #服务id,不可重复 sql_mode='STRICT_TRANS_TABLES,NO_ZERO_IN_DATE,NO_ZERO_DATE,ERROR_FOR_DIVISION_BY_ZERO ,NO_AUTO_CREATE_USER,NO_ENGINE_SUBSTITUTION'

#创建容器

docker create --name percona-master02 -v /data/mysql/master02/data:/var/lib/mysql -v /data/mysql/master02/conf:/etc/my.cnf.d -p 3316:3306 -e MYSQL_ROOT_PASSWORD=root percona:5.7.23

#启动

docker start percona-master02 && docker logs -f percona-master02

#创建同步账户以及授权

create user 'itcast'@'%' identified by 'itcast';

grant replication slave on *.* to 'itcast'@'%';

flush privileges;

#查看master状态

show master status;

2、配置Slave

#搭建从库

#创建目录

mkdir /data/mysql/slave02

cd /data/mysql/slave02

mkdir conf data

chmod 777 * -R

#创建配置文件

cd /data/mysql/slave02/conf

vim my.cnf

#输入如下内容

[mysqld]

server-id=2 #服务id,不可重复 sql_mode='STRICT_TRANS_TABLES,NO_ZERO_IN_DATE,NO_ZERO_DATE,ERROR_FOR_DIVISION_BY_ZERO ,NO_AUTO_CREATE_USER,NO_ENGINE_SUBSTITUTION'

#创建容器

docker create --name percona-slave02 -v /data/mysql/slave02/data:/var/lib/mysql -v /data/mysql/slave02/conf:/etc/my.cnf.d -p 3317:3306 -e MYSQL_ROOT_PASSWORD=root percona:5.7.23

#启动

docker start percona-slave02 && docker logs -f percona-slave02

#设置master相关信息

CHANGE MASTER TO

master_host='192.168.1.18',

master_user='itcast',

master_password='itcast',

master_port=3316,

master_log_file='xxxxxx',

master_log_pos=xxxx;

#启动同步

start slave;

#查看master状态

show slave status;

3、MyCat配置文件----schema.xml

<?xml version="1.0"?>

<!DOCTYPE mycat:schema SYSTEM "schema.dtd">

<mycat:schema xmlns:mycat="http://io.mycat/">

<!--配置数据表-->

<schema name="itcast" checkSQLschema="false" sqlMaxLimit="100">

<table name="tb_ad" dataNode="dn1,dn2" rule="mod-long" />

</schema>

<!--配置分片关系-->

<dataNode name="dn1" dataHost="cluster1" database="itcast" />

<dataNode name="dn2" dataHost="cluster2" database="itcast" />

<!--配置连接信息-->

<dataHost name="cluster1" maxCon="1000" minCon="10" balance="3" writeType="1" dbType="mysql" dbDriver="native" switchType="1" slaveThreshold="100">

<heartbeat>select user()</heartbeat>

<writeHost host="W1" url="192.168.1.18:3306" user="root" password="root">

<readHost host="W1R1" url="192.168.1.18:3307" user="root" password="root" />

</writeHost>

</dataHost>

<dataHost name="cluster2" maxCon="1000" minCon="10" balance="3" writeType="1" dbType="mysql" dbDriver="native" switchType="1" slaveThreshold="100">

<heartbeat>select user()</heartbeat>

<writeHost host="W2" url="192.168.1.18:3316" user="root" password="root">

<readHost host="W2R1" url="192.168.1.18:3317" user="root" password="root" />

</writeHost>

</dataHost>

</mycat:schema>

4、MyCat配置文件----rule.xml

<function name="mod-long" class="io.mycat.route.function.PartitionByMod">

<property name="count">2</property>

</function>

5、重启MyCat

./startup_nowrap.sh && tail -f ../logs/mycat.log

本文介绍了MyCat数据库中间件,它支持多种数据库,可解决海量数据问题。涵盖安装步骤,包括下载和在Linux服务器上解压启动;阐述分片规则、集群部署;详细说明表分片实现,含配置分片和读写分离;最后通过案例展示了MyCat实现读写分离和数据分片的方法。

本文介绍了MyCat数据库中间件,它支持多种数据库,可解决海量数据问题。涵盖安装步骤,包括下载和在Linux服务器上解压启动;阐述分片规则、集群部署;详细说明表分片实现,含配置分片和读写分离;最后通过案例展示了MyCat实现读写分离和数据分片的方法。

1335

1335

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?