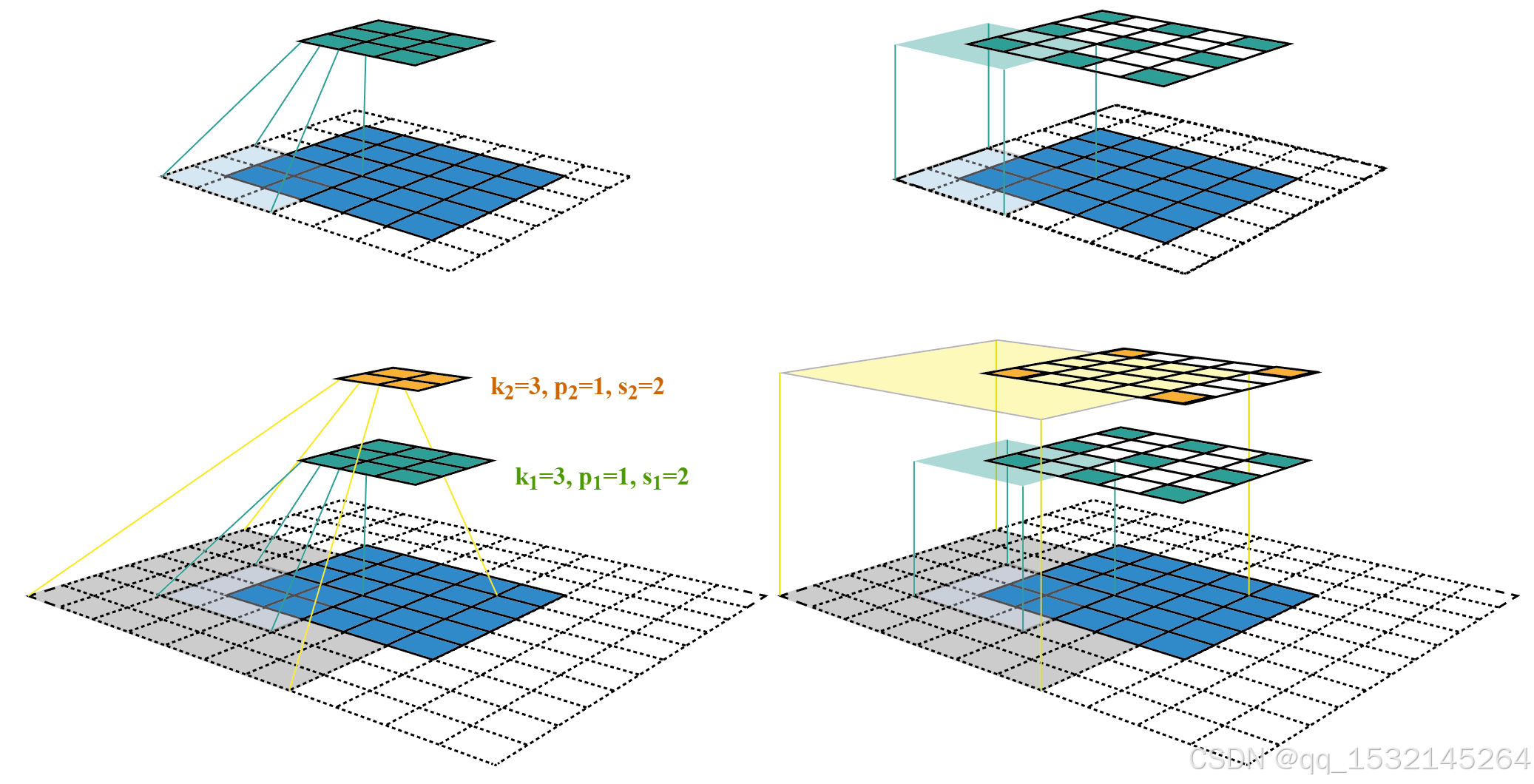

1、不同网络深度的感受野

感受野是指在卷积神经网络中,隐藏层神经元或输出像素点 在原始输入数据上所能“感知”的区域大小。

感受野的大小直接影响了网络能够捕获的上下文信息量,对于模型理解场景的全局和局部特性非常关键。 较大的感受野有助于网络更好地整合全局信息,而较小的感受野则更有利于捕捉细节信息。

通常来说, 随着网络深度的增加,后续层的感受野会逐渐增大,这有助于网络捕捉到更大范围的上下文信息。

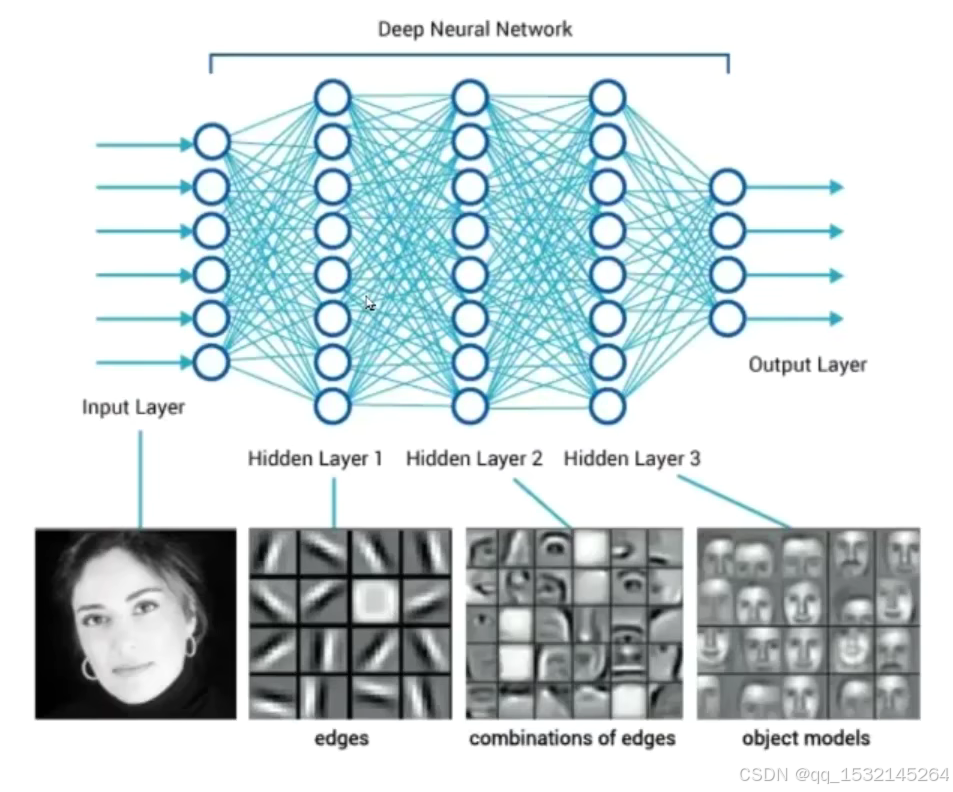

低层网络的感受野比较小,几何细节信息表征能力强,虽然特征图分辨率高,但是语义信息表征能力弱;

深层网络的感受野比较大,语义信息表征能力强,但是特征图分辨率低,几何信息表征能力弱。

语义信息 主要关注于数据的含义和上下文关系,而 几何信息 则侧重于数据的物理形状和空间位置。

比如,输入一张人脸数据,浅层网络学习到的数据特征一般就是某些边缘或者部位的信息,而深层网络学习到的就是整张人脸的数据特征。

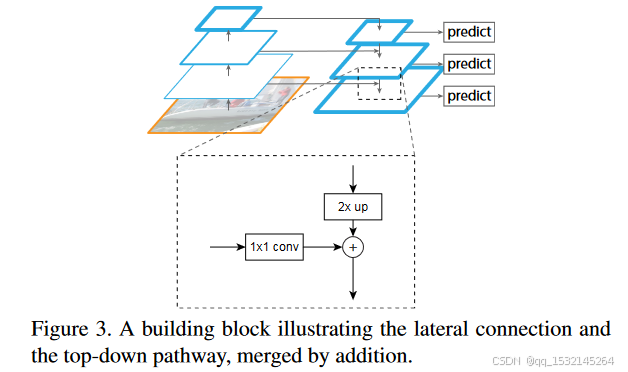

2、FPN(Feature Pyramid Netwok)

FPN 网络的本质是,融合高层和低层的 feature map 。即 把低分辨率、高语义信息的高层特征和高分辨率、低语义信息的低层特征进行自上而下的侧边连接,使得所有尺度下的特征都有丰富的语义信息。

流程:

1.自底向上

即普通的神经网络前向传播过程(卷积、下采样)。

2.自上而下

把高层特征图进行上采样,然后把该特征横向连接(lateral connection)至前一层特征,使得 feature map 含有更丰富信息。

3.横向连接

前一层的特征图经过 1×1的卷积核卷积,目的为改变通道数,因为要和后一层上采样的特征图通道数相同。

feature map 的横向连接采用 张量相加 。

[REFERENCE]

多尺度特征融合总结(金字塔结构)

489

489

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?