摘要

本文详细介绍了一个基于大语言模型(LLM)的智能运维 Agent 系统的设计与实现。该系统采用多 Agent 协同的架构,通过事件驱动的方式实现了自动化运维流程。系统集成了先进的 AI 能力,能够实现故障自动诊断、预测性维护、知识沉淀等核心功能。

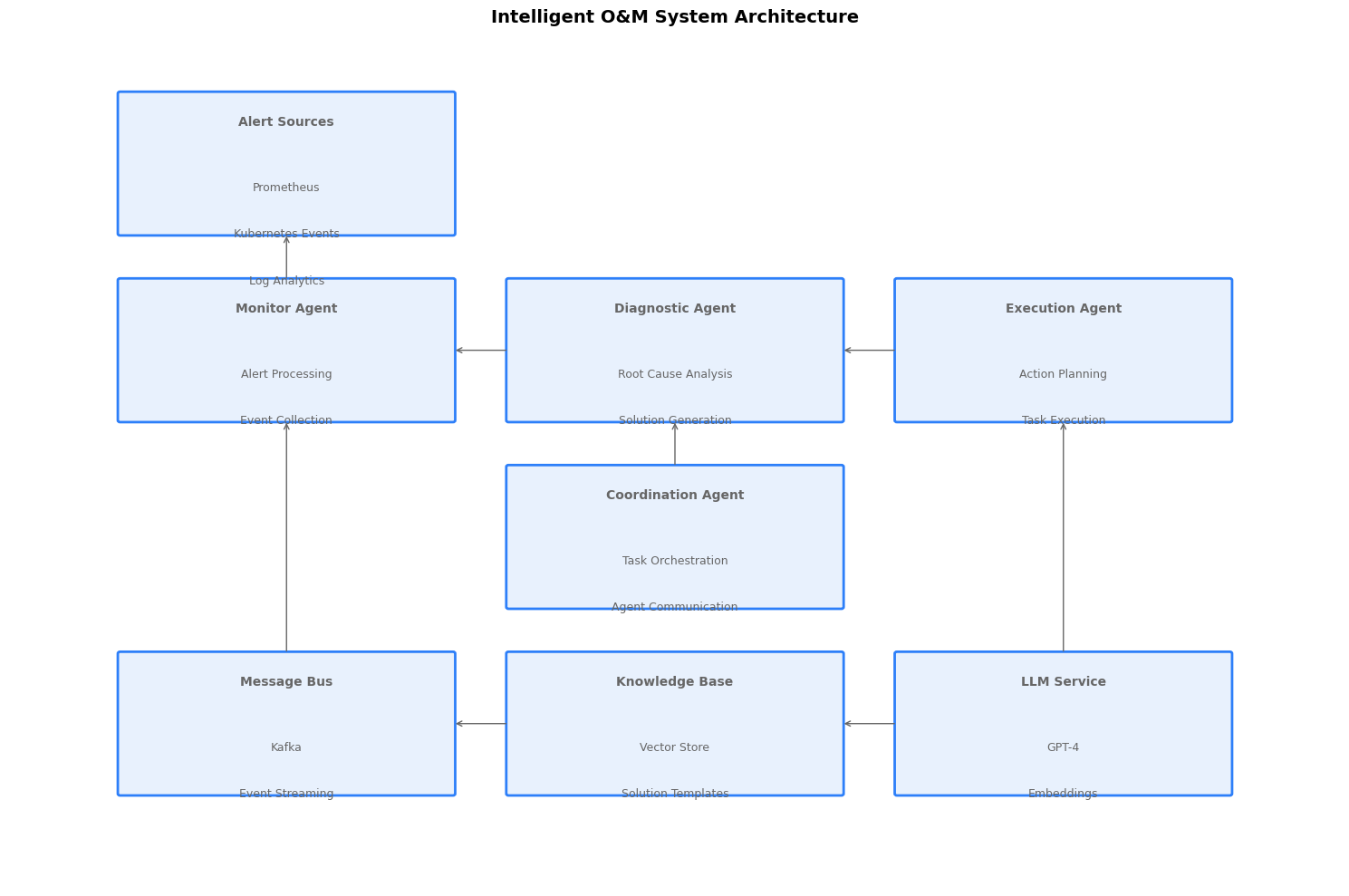

一、运维 Agent 架构设计

在设计智能运维 Agent 系统时,我们采用了模块化和事件驱动的架构思想,将复杂的运维场景分解为多个独立的能力域,并通过消息总线实现各组件的解耦和协同。

1.1 Agent 能力矩阵

在设计之初,我们将运维场景分解为五个核心能力域,每个域由专门的 Agent 负责:

| Agent 类型 | 核心能力 | 主要职责 |

|---|---|---|

| 监控分析 Agent | 数据采集、异常检测 | 负责系统指标采集、告警产生和初步分析 |

| 故障诊断 Agent | 根因分析、方案推荐 | 进行多维度故障诊断,输出解决方案 |

| 执行操作 Agent | 自动化修复、资源管理 | 执行修复操作,管理系统资源 |

| 决策协调 Agent | 任务编排、风险控制 | 协调多个 Agent 行为,控制执行风险 |

| 知识管理 Agent | 知识库维护、经验沉淀 | 管理运维知识,支持经验复用 |

每个 Agent 都具有明确的职责边界和能力定义,通过标准化的接口进行交互。这种设计既保证了单个 Agent 的独立性和可维护性,又能够通过协作实现复杂的运维场景。

1.2 系统架构设计

整体系统采用事件驱动的微服务架构,核心组件包括:

核心组件说明:

- 消息总线:基于 Kafka 实现的事件流处理系统,负责 Agent 间的消息传递和事件流转,确保系统各组件间的解耦和可扩展性。

- Agent 调度器:负责 Agent 生命周期管理和任务分发,包括 Agent 的创建、销毁、负载均衡等核心功能,确保系统资源的高效利用。

- LLM 服务:提供智能分析和决策能力,集成了大语言模型,为各个 Agent 提供自然语言理解、知识推理等AI能力支持。

- 知识库:基于向量数据库实现的运维知识存储,存储历史案例、最佳实践等运维知识,支持相似案例检索和知识复用。

- 执行引擎:对接 Kubernetes 等基础设施的操作接口,负责将 Agent 的决策转化为实际的运维操作,并确保执行的安全性和可控性。

1.3 技术栈选型

系统的技术栈选型基于以下几个层面:

-

基础设施层

- 容器编排:选用 Kubernetes 作为容器编排平台,提供强大的容器管理和服务编排能力

- 消息队列:采用 Kafka 实现可靠的事件流处理

- 数据存储:使用 MongoDB 存储运维数据,Redis 提供高性能缓存支持

-

Agent 框架层

- 开发语言:选用 Python 3.10+ 作为主要开发语言,利用其丰富的生态系统

- Agent 框架:采用 LangChain 作为 Agent 开发框架,简化 AI 能力的集成

- LLM 模型:使用 GPT-4 作为核心语言模型,提供强大的自然语言理解能力

-

运维工具层

- 监控系统:使用 Prometheus 进行系统监控和指标采集

- 日志系统:采用 ELK Stack 进行日志管理和分析

- 追踪系统:使用 Jaeger 实现分布式追踪,帮助问题定位

二、核心功能实现

2.1 监控告警处理

监控告警是整个系统的入口,我们采用 Prometheus + LLM 的组合方案:

classAlertProcessordef__init__selfasyncdefprocess_alertself, alert: Alert# 1. 获取告警上下文await# 2. LLM 分析await0.3# 3. 结果处理returnasyncdef_get_alert_contextself, alert: Alertdict# 获取相关指标数据await30# 获取相关日志await5return"metrics""logs""service_info"await

2.2 智能故障诊断

故障诊断模块采用 RAG(检索增强生成)技术,结合历史案例和实时数据:

classDiagnosticAgentdef__init__self# 向量数据库客户端# LLM 客户端asyncdefdiagnoseself, incident: Incident# 1. 检索相关案例awaitfilter"service""severity"5# 2. 生成诊断方案await# 3. 方案验证awaitreturn

2.3 自动化运维流程

实现了基于 K8s Operator 的自动化运维流程:

classAutomationOperatordef__init__selfasyncdefexecute_actionself, action: Action# 1. 风险评估awaitifreturnawait# 2. 执行操作tryawait# 3. 验证结果await# 4. 更新状态awaitreturnexceptasawaitraise

三、系统优化与创新

3.1 知识增强机制

实现知识库的自动更新和优化:

classKnowledgeBasedef__init__selfasyncdefupdate_knowledgeself, case:

dictdict# 1. 提取关键信息await# 2. 生成向量表示await# 3. 更新知识库awaitid'id'"type"'type'"service"'service'"solution"'solution'"effectiveness"'effectiveness_score'

3.2 安全与可控性保障

实现多层级的安全控制机制:

fromimportfromimportOptionalclassRiskLevelEnum1# 只读操作2# 可逆操作3# 不可逆操作4# 关键操作classSecurityControllerdef__init__selfasyncdefvalidate_operationself, operation:

dictdictbool# 1. 风险评估await# 2. 权限检查ifnotawaitreturnFalse# 3. 审计记录await# 4. 人工确认(如果需要)ifreturnawaitreturnTrue

总结与展望

通过实践,我们成功构建了一个高效的运维 Agent 系统,显著提升了运维效率:

- 告警处理时间减少 60%

- 自动化修复率达到 75%

- 误报率降低 80%

大模型算是目前当之无愧最火的一个方向了,算是新时代的风口!有小伙伴觉得,作为新领域、新方向人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,那转行去做大模型是不是一个更好的选择呢?是不是更好就业呢?是不是就暂时能抵抗35岁中年危机呢?

答案当然是这样,大模型必然是新风口!

那如何学习大模型 ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习路线完善出来!

在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

478

478

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?